電子發(fā)燒友網(wǎng)報(bào)道(文/莫婷婷)隨著生成式AI應(yīng)用的爆發(fā)式增長(zhǎng),數(shù)據(jù)中心對(duì)高效、低成本、低功耗AI推理能力的需求急劇上升。高通憑借其在移動(dòng)計(jì)算和通信領(lǐng)域的技術(shù)積累,正試圖通過差異化戰(zhàn)略,在價(jià)值數(shù)千億美元的數(shù)據(jù)中心市場(chǎng)中搶占一席之地。

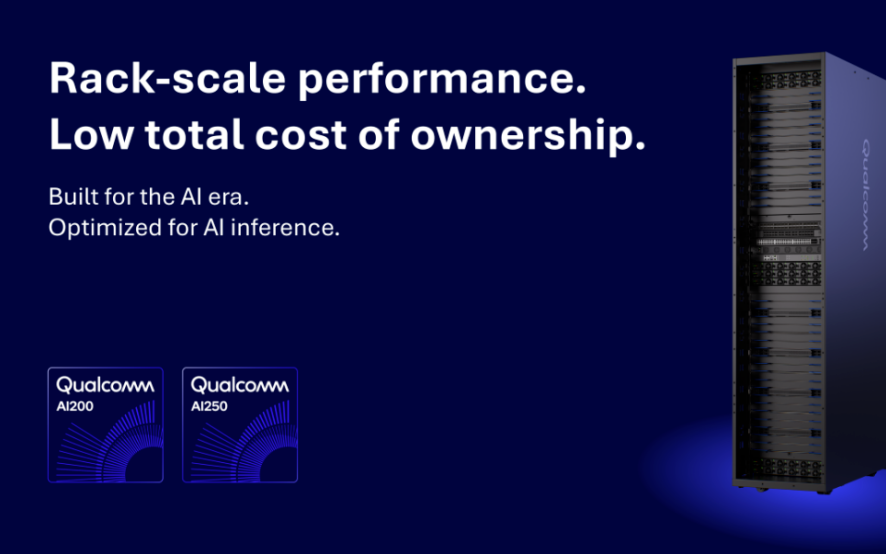

就在10月28日,高通面向數(shù)據(jù)中心連發(fā)兩款A(yù)I芯片,AI200 和 AI250 芯片,打造下一代 AI 推理優(yōu)化解決方案。這一舉措不僅標(biāo)志著高通在AI基礎(chǔ)設(shè)施領(lǐng)域的拓展,也被業(yè)內(nèi)視為其對(duì)英偉達(dá)在AI數(shù)據(jù)中心市場(chǎng)發(fā)起挑戰(zhàn)的關(guān)鍵一步。

支持768 GB LPDDR,高通AI芯片性能、架構(gòu)與能效全面突破

此次發(fā)布的AI200和AI250基于高通的Hexagon神經(jīng)處理單元(NPU)技術(shù),并針對(duì)大型語言模型(LLM)、多模態(tài)模型(LMM)及實(shí)時(shí)AI推理任務(wù)進(jìn)行了深度優(yōu)化,可實(shí)現(xiàn)快速數(shù)據(jù)中心生成式 AI 推理,預(yù)計(jì)分別將于2026年和2027年上市。

高通介紹,AI200 是機(jī)架級(jí)AI推理解決方案,主打高內(nèi)存帶寬與低總擁有成本(TCO),旨在為大型語言和多模態(tài)模型(LLM、LMM)、推理和其他 AI 工作負(fù)載提供較低的TCO和優(yōu)化的性能。

該芯片單卡支持高達(dá)768GB的LPDDR內(nèi)存,遠(yuǎn)超當(dāng)前市場(chǎng)上主流競(jìng)品。作為對(duì)比,英偉達(dá)H100 GPU單卡最大顯存為80GB HBM3,GB300每個(gè)GPU配備288GBHBM3e內(nèi)存,不到AI200的一半;AMD MI300X也僅提供192GB HBM3內(nèi)存。這意味著在處理超大規(guī)模模型時(shí),AI200無需頻繁進(jìn)行數(shù)據(jù)交換或模型切分,顯著提升了推理效率。

另一個(gè)值得關(guān)注的數(shù)據(jù)是,相較于HBM,LPDDR在制造成本上帶來的優(yōu)勢(shì)。目前來看HBM的生產(chǎn)成本大約是LPDDR的2-3倍,這使得AI200能夠在保持高性能的同時(shí),大幅降低單位算力的成本支出,適合需要長(zhǎng)期運(yùn)行、高吞吐量的云服務(wù)提供商和企業(yè)客戶。

在AI200是對(duì)現(xiàn)有市場(chǎng)精準(zhǔn)打擊的同時(shí),高通AI250則是一次顛覆性的技術(shù)創(chuàng)新。

AI250 引入了基于近內(nèi)存計(jì)算的創(chuàng)新內(nèi)存架構(gòu),這一設(shè)計(jì)提供超過 10 倍的有效內(nèi)存帶寬和更低的功耗,對(duì)于AI推理這類高度依賴數(shù)據(jù)流動(dòng)的任務(wù)而言,這意味著更低的延遲和更高的能效比。此外,AI250支持分解式AI推理,實(shí)現(xiàn)更靈活的資源調(diào)度與利用率優(yōu)化,同時(shí)滿足客戶的性能和成本要求。

基于AI200 和 AI250 芯片的機(jī)架解決方案均具有直接液體冷卻以提高熱效率、用于縱向擴(kuò)展的 PCIe、用于橫向擴(kuò)展的以太網(wǎng),支持160kW機(jī)架級(jí)功耗管理,滿足現(xiàn)代數(shù)據(jù)中心對(duì)可擴(kuò)展性與熱管理的嚴(yán)苛要求。此外,二者均支持機(jī)密計(jì)算,確保敏感AI工作負(fù)載在執(zhí)行過程中的數(shù)據(jù)安全。

高通在官方通告中,特別指出兩款產(chǎn)品都支持較低的總體擁有成本(TCO)。TCO指的是在設(shè)備采購(gòu)、運(yùn)維等整個(gè)生命周期需要投入的成本,已經(jīng)成為客戶決策的關(guān)鍵指標(biāo)之一,直面初創(chuàng)企業(yè)或新興市場(chǎng)等對(duì)預(yù)算敏感型客戶群體。

此外,AI數(shù)據(jù)中心產(chǎn)業(yè)對(duì)綠色AI和可持續(xù)算力的需求。在TCO中,電力成本占一半左右,已成為云服務(wù)商的支出大項(xiàng)。而高通強(qiáng)調(diào)“每瓦每美元”的性能指標(biāo),正好直擊產(chǎn)業(yè)痛點(diǎn)。

“借助高通 AI200 和 AI250,我們正在重新定義機(jī)架級(jí) AI 推理的可能性。這些創(chuàng)新的新型人工智能基礎(chǔ)設(shè)施解決方案使客戶能夠以前所未有的總體擁有成本部署生成式人工智能,同時(shí)保持現(xiàn)代數(shù)據(jù)中心所需的靈活性和安全性”,高通技術(shù)公司邊緣解決方案和數(shù)據(jù)中心技術(shù)規(guī)劃高級(jí)副總裁兼總經(jīng)理 Durga Malladi表示。

高通的戰(zhàn)略升級(jí):以AI推理為核心向數(shù)據(jù)中心擴(kuò)張

長(zhǎng)期以來,高通被視為“智能手機(jī)芯片之王”,驍龍系列處理器幾乎定義了安卓旗艦手機(jī)的標(biāo)準(zhǔn)。然而,隨著智能手機(jī)市場(chǎng)趨于飽和,高通開始加速多元化布局,先后進(jìn)入PC、汽車、工業(yè)等領(lǐng)域,就在今年2月,高通正式推出“躍龍”品牌,面向工業(yè)場(chǎng)景。如今,AI數(shù)據(jù)中心成為其下一個(gè)戰(zhàn)略高地。

從高通的通告中可以看到,面向AI數(shù)據(jù)中心,高通已經(jīng)有著清晰的技術(shù)路線圖與商業(yè)化落地計(jì)劃。

高通已明確宣布,將每年推進(jìn)一次數(shù)據(jù)中心AI芯片路線圖更新,持續(xù)迭代性能與能效。AI200計(jì)劃于2026年上市,AI250將于2027年量產(chǎn),形成穩(wěn)定的產(chǎn)品節(jié)奏。

在商業(yè)化進(jìn)展方面,今年5月,高通宣布與沙特阿拉伯的Humain公司合作,為其新建的區(qū)域性AI數(shù)據(jù)中心提供AI推理芯片,該項(xiàng)目預(yù)計(jì)將部署最多可使用200兆瓦電力的系統(tǒng),相當(dāng)于一座中等城市全年數(shù)據(jù)中心的用電總量,能夠支撐數(shù)十萬臺(tái)服務(wù)器的AI運(yùn)算能力。此次合作成為高通在國(guó)家級(jí)AI基建項(xiàng)目中獲得大規(guī)模訂單,具有象征意義。

在開發(fā)者生態(tài)方面,為了打破生態(tài)的壁壘,高通在軟件層面也下足功夫。高通表示AI200和AI250配備了完整的高通AI軟件棧,兼容主流AI框架,并支持一鍵式模型部署。開發(fā)者無需重寫代碼即可將已訓(xùn)練好的模型遷移至高通平臺(tái),極大降低了采用門檻專為無摩擦采用和快速創(chuàng)新而設(shè)計(jì)。

高通AI芯片的發(fā)布,被視為其正式向英偉達(dá)所在的AI數(shù)據(jù)中心領(lǐng)域的統(tǒng)治地位發(fā)起挑戰(zhàn)的標(biāo)志性開端。英偉達(dá)憑借其強(qiáng)大的CUDA生態(tài)、領(lǐng)先的GPU架構(gòu),且在AI訓(xùn)練領(lǐng)域的先發(fā)優(yōu)勢(shì),在數(shù)據(jù)中心市場(chǎng)占據(jù)了超過90%的絕對(duì)主導(dǎo)地位,已成為全球主流云服務(wù)商和AI企業(yè)構(gòu)建大模型訓(xùn)練平臺(tái)的“標(biāo)配”。

而生成式AI從訓(xùn)練階段大規(guī)模轉(zhuǎn)向部署和推理應(yīng)用,云天勵(lì)飛副總裁羅憶預(yù)計(jì),國(guó)產(chǎn)大模型推理算力需求將在2026年超越訓(xùn)練需求。因此AI推理芯片正逐漸成為AI領(lǐng)域的關(guān)鍵,這為后來者提供了錯(cuò)位競(jìng)爭(zhēng)的戰(zhàn)略窗口,而高通正是抓住了這一關(guān)鍵轉(zhuǎn)折點(diǎn)。

與英偉達(dá)以通用GPU為核心、兼顧訓(xùn)練與推理的路線不同,高通選擇了專注AI推理賽道的差異化戰(zhàn)略,并非在英偉達(dá)最擅長(zhǎng)的訓(xùn)練戰(zhàn)場(chǎng)上正面硬剛,而是精準(zhǔn)切入更具規(guī)模潛力的推理環(huán)節(jié),基于高通在高吞吐、低延遲等技術(shù)的優(yōu)勢(shì),通過專用架構(gòu)、能效優(yōu)化和成本控制,構(gòu)建起一條競(jìng)爭(zhēng)路徑。

未來,在AI數(shù)據(jù)中心這片充滿機(jī)遇與挑戰(zhàn)的市場(chǎng)中,高通會(huì)有哪些表現(xiàn),AI200與AI250芯片能否在2026年如期量產(chǎn)并順利導(dǎo)入主流企業(yè)中,又能否在軟件生態(tài)上贏得開發(fā)者的廣泛支持,都將成為關(guān)鍵。

就在10月28日,高通面向數(shù)據(jù)中心連發(fā)兩款A(yù)I芯片,AI200 和 AI250 芯片,打造下一代 AI 推理優(yōu)化解決方案。這一舉措不僅標(biāo)志著高通在AI基礎(chǔ)設(shè)施領(lǐng)域的拓展,也被業(yè)內(nèi)視為其對(duì)英偉達(dá)在AI數(shù)據(jù)中心市場(chǎng)發(fā)起挑戰(zhàn)的關(guān)鍵一步。

支持768 GB LPDDR,高通AI芯片性能、架構(gòu)與能效全面突破

此次發(fā)布的AI200和AI250基于高通的Hexagon神經(jīng)處理單元(NPU)技術(shù),并針對(duì)大型語言模型(LLM)、多模態(tài)模型(LMM)及實(shí)時(shí)AI推理任務(wù)進(jìn)行了深度優(yōu)化,可實(shí)現(xiàn)快速數(shù)據(jù)中心生成式 AI 推理,預(yù)計(jì)分別將于2026年和2027年上市。

高通介紹,AI200 是機(jī)架級(jí)AI推理解決方案,主打高內(nèi)存帶寬與低總擁有成本(TCO),旨在為大型語言和多模態(tài)模型(LLM、LMM)、推理和其他 AI 工作負(fù)載提供較低的TCO和優(yōu)化的性能。

該芯片單卡支持高達(dá)768GB的LPDDR內(nèi)存,遠(yuǎn)超當(dāng)前市場(chǎng)上主流競(jìng)品。作為對(duì)比,英偉達(dá)H100 GPU單卡最大顯存為80GB HBM3,GB300每個(gè)GPU配備288GBHBM3e內(nèi)存,不到AI200的一半;AMD MI300X也僅提供192GB HBM3內(nèi)存。這意味著在處理超大規(guī)模模型時(shí),AI200無需頻繁進(jìn)行數(shù)據(jù)交換或模型切分,顯著提升了推理效率。

另一個(gè)值得關(guān)注的數(shù)據(jù)是,相較于HBM,LPDDR在制造成本上帶來的優(yōu)勢(shì)。目前來看HBM的生產(chǎn)成本大約是LPDDR的2-3倍,這使得AI200能夠在保持高性能的同時(shí),大幅降低單位算力的成本支出,適合需要長(zhǎng)期運(yùn)行、高吞吐量的云服務(wù)提供商和企業(yè)客戶。

在AI200是對(duì)現(xiàn)有市場(chǎng)精準(zhǔn)打擊的同時(shí),高通AI250則是一次顛覆性的技術(shù)創(chuàng)新。

AI250 引入了基于近內(nèi)存計(jì)算的創(chuàng)新內(nèi)存架構(gòu),這一設(shè)計(jì)提供超過 10 倍的有效內(nèi)存帶寬和更低的功耗,對(duì)于AI推理這類高度依賴數(shù)據(jù)流動(dòng)的任務(wù)而言,這意味著更低的延遲和更高的能效比。此外,AI250支持分解式AI推理,實(shí)現(xiàn)更靈活的資源調(diào)度與利用率優(yōu)化,同時(shí)滿足客戶的性能和成本要求。

基于AI200 和 AI250 芯片的機(jī)架解決方案均具有直接液體冷卻以提高熱效率、用于縱向擴(kuò)展的 PCIe、用于橫向擴(kuò)展的以太網(wǎng),支持160kW機(jī)架級(jí)功耗管理,滿足現(xiàn)代數(shù)據(jù)中心對(duì)可擴(kuò)展性與熱管理的嚴(yán)苛要求。此外,二者均支持機(jī)密計(jì)算,確保敏感AI工作負(fù)載在執(zhí)行過程中的數(shù)據(jù)安全。

高通在官方通告中,特別指出兩款產(chǎn)品都支持較低的總體擁有成本(TCO)。TCO指的是在設(shè)備采購(gòu)、運(yùn)維等整個(gè)生命周期需要投入的成本,已經(jīng)成為客戶決策的關(guān)鍵指標(biāo)之一,直面初創(chuàng)企業(yè)或新興市場(chǎng)等對(duì)預(yù)算敏感型客戶群體。

此外,AI數(shù)據(jù)中心產(chǎn)業(yè)對(duì)綠色AI和可持續(xù)算力的需求。在TCO中,電力成本占一半左右,已成為云服務(wù)商的支出大項(xiàng)。而高通強(qiáng)調(diào)“每瓦每美元”的性能指標(biāo),正好直擊產(chǎn)業(yè)痛點(diǎn)。

“借助高通 AI200 和 AI250,我們正在重新定義機(jī)架級(jí) AI 推理的可能性。這些創(chuàng)新的新型人工智能基礎(chǔ)設(shè)施解決方案使客戶能夠以前所未有的總體擁有成本部署生成式人工智能,同時(shí)保持現(xiàn)代數(shù)據(jù)中心所需的靈活性和安全性”,高通技術(shù)公司邊緣解決方案和數(shù)據(jù)中心技術(shù)規(guī)劃高級(jí)副總裁兼總經(jīng)理 Durga Malladi表示。

高通的戰(zhàn)略升級(jí):以AI推理為核心向數(shù)據(jù)中心擴(kuò)張

長(zhǎng)期以來,高通被視為“智能手機(jī)芯片之王”,驍龍系列處理器幾乎定義了安卓旗艦手機(jī)的標(biāo)準(zhǔn)。然而,隨著智能手機(jī)市場(chǎng)趨于飽和,高通開始加速多元化布局,先后進(jìn)入PC、汽車、工業(yè)等領(lǐng)域,就在今年2月,高通正式推出“躍龍”品牌,面向工業(yè)場(chǎng)景。如今,AI數(shù)據(jù)中心成為其下一個(gè)戰(zhàn)略高地。

從高通的通告中可以看到,面向AI數(shù)據(jù)中心,高通已經(jīng)有著清晰的技術(shù)路線圖與商業(yè)化落地計(jì)劃。

高通已明確宣布,將每年推進(jìn)一次數(shù)據(jù)中心AI芯片路線圖更新,持續(xù)迭代性能與能效。AI200計(jì)劃于2026年上市,AI250將于2027年量產(chǎn),形成穩(wěn)定的產(chǎn)品節(jié)奏。

在商業(yè)化進(jìn)展方面,今年5月,高通宣布與沙特阿拉伯的Humain公司合作,為其新建的區(qū)域性AI數(shù)據(jù)中心提供AI推理芯片,該項(xiàng)目預(yù)計(jì)將部署最多可使用200兆瓦電力的系統(tǒng),相當(dāng)于一座中等城市全年數(shù)據(jù)中心的用電總量,能夠支撐數(shù)十萬臺(tái)服務(wù)器的AI運(yùn)算能力。此次合作成為高通在國(guó)家級(jí)AI基建項(xiàng)目中獲得大規(guī)模訂單,具有象征意義。

在開發(fā)者生態(tài)方面,為了打破生態(tài)的壁壘,高通在軟件層面也下足功夫。高通表示AI200和AI250配備了完整的高通AI軟件棧,兼容主流AI框架,并支持一鍵式模型部署。開發(fā)者無需重寫代碼即可將已訓(xùn)練好的模型遷移至高通平臺(tái),極大降低了采用門檻專為無摩擦采用和快速創(chuàng)新而設(shè)計(jì)。

高通AI芯片的發(fā)布,被視為其正式向英偉達(dá)所在的AI數(shù)據(jù)中心領(lǐng)域的統(tǒng)治地位發(fā)起挑戰(zhàn)的標(biāo)志性開端。英偉達(dá)憑借其強(qiáng)大的CUDA生態(tài)、領(lǐng)先的GPU架構(gòu),且在AI訓(xùn)練領(lǐng)域的先發(fā)優(yōu)勢(shì),在數(shù)據(jù)中心市場(chǎng)占據(jù)了超過90%的絕對(duì)主導(dǎo)地位,已成為全球主流云服務(wù)商和AI企業(yè)構(gòu)建大模型訓(xùn)練平臺(tái)的“標(biāo)配”。

而生成式AI從訓(xùn)練階段大規(guī)模轉(zhuǎn)向部署和推理應(yīng)用,云天勵(lì)飛副總裁羅憶預(yù)計(jì),國(guó)產(chǎn)大模型推理算力需求將在2026年超越訓(xùn)練需求。因此AI推理芯片正逐漸成為AI領(lǐng)域的關(guān)鍵,這為后來者提供了錯(cuò)位競(jìng)爭(zhēng)的戰(zhàn)略窗口,而高通正是抓住了這一關(guān)鍵轉(zhuǎn)折點(diǎn)。

與英偉達(dá)以通用GPU為核心、兼顧訓(xùn)練與推理的路線不同,高通選擇了專注AI推理賽道的差異化戰(zhàn)略,并非在英偉達(dá)最擅長(zhǎng)的訓(xùn)練戰(zhàn)場(chǎng)上正面硬剛,而是精準(zhǔn)切入更具規(guī)模潛力的推理環(huán)節(jié),基于高通在高吞吐、低延遲等技術(shù)的優(yōu)勢(shì),通過專用架構(gòu)、能效優(yōu)化和成本控制,構(gòu)建起一條競(jìng)爭(zhēng)路徑。

未來,在AI數(shù)據(jù)中心這片充滿機(jī)遇與挑戰(zhàn)的市場(chǎng)中,高通會(huì)有哪些表現(xiàn),AI200與AI250芯片能否在2026年如期量產(chǎn)并順利導(dǎo)入主流企業(yè)中,又能否在軟件生態(tài)上贏得開發(fā)者的廣泛支持,都將成為關(guān)鍵。

聲明:本文內(nèi)容及配圖由入駐作者撰寫或者入駐合作網(wǎng)站授權(quán)轉(zhuǎn)載。文章觀點(diǎn)僅代表作者本人,不代表電子發(fā)燒友網(wǎng)立場(chǎng)。文章及其配圖僅供工程師學(xué)習(xí)之用,如有內(nèi)容侵權(quán)或者其他違規(guī)問題,請(qǐng)聯(lián)系本站處理。

舉報(bào)投訴

-

高通

+關(guān)注

關(guān)注

78文章

7676瀏覽量

198384

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

熱點(diǎn)推薦

高通挑戰(zhàn)英偉達(dá),發(fā)布768GB內(nèi)存AI推理芯片,“出征”AI數(shù)據(jù)中心

億美元的數(shù)據(jù)中心市場(chǎng)中搶占一席之地。 就在10月28日,高通面向數(shù)據(jù)中心連發(fā)兩款AI芯片,AI2

堪稱史上最強(qiáng)推理芯片!英偉達(dá)發(fā)布 Rubin CPX,實(shí)現(xiàn)50倍ROI

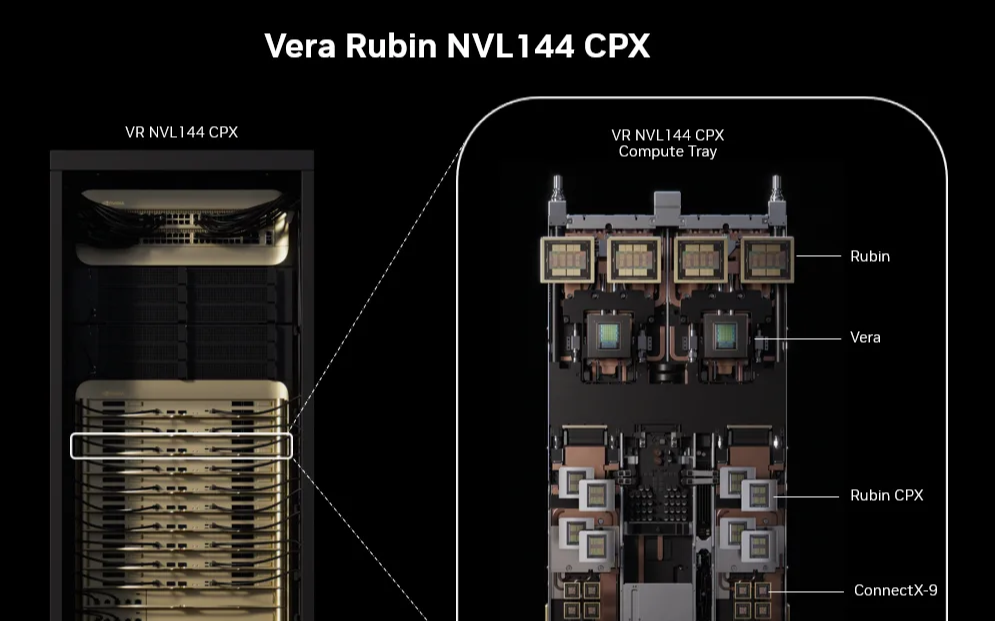

電子發(fā)燒友網(wǎng)報(bào)道(文/梁浩斌)近日,英偉達(dá)在AI infra峰會(huì)上發(fā)布了專為大規(guī)模上下文推理設(shè)計(jì)的全新GPU系列Rubin CPX,性能堪稱

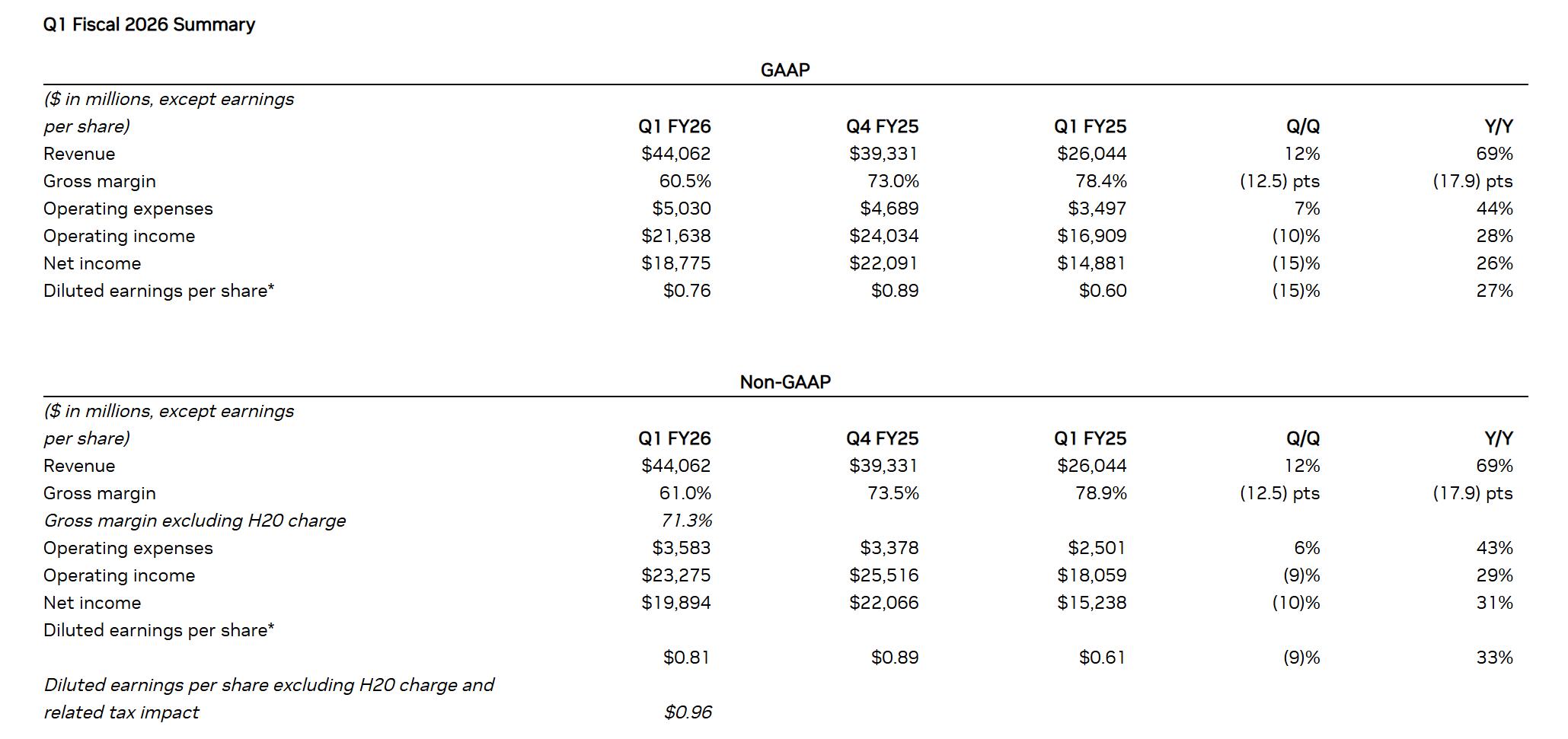

AI推理需求井噴!英偉達(dá)Q1營(yíng)收大漲,H20禁售難擋增長(zhǎng)步伐

報(bào)告,在全球加大AI基礎(chǔ)設(shè)施的浪潮下,英偉達(dá)第一季度總體營(yíng)收達(dá)到440.6億美元,較去年同期增長(zhǎng)69%,高于市場(chǎng)預(yù)期的431億美元;凈利潤(rùn)187.75億美元,同比去年增長(zhǎng)26%。業(yè)績(jī)公布后,英

黃仁勛:英偉達(dá)AI芯片訂單排到2026年 英偉達(dá)上季營(yíng)收加速增長(zhǎng)62%再超預(yù)期

AI芯片總龍頭英偉達(dá)的財(cái)報(bào)終于帶來了驚喜;英偉達(dá)公司發(fā)布

鑫澈導(dǎo)熱與屏蔽方案助力AI數(shù)據(jù)中心高效散熱

隨著AI數(shù)據(jù)中心持續(xù)擴(kuò)張,高功率密度AI芯片帶來過量熱負(fù)荷與電磁干擾問題,散熱與電磁屏蔽已成為影響系統(tǒng)穩(wěn)定與能效的核心

【「AI芯片:科技探索與AGI愿景」閱讀體驗(yàn)】+AI芯片到AGI芯片

建立的基礎(chǔ):

①算力支柱②數(shù)據(jù)支柱③計(jì)算支柱

1)算力

與AI算力有關(guān)的因素:

①晶體管數(shù)量②晶體管速度③芯片架構(gòu)④芯片面積⑤制造工藝⑥芯片

發(fā)表于 09-18 15:31

【「AI芯片:科技探索與AGI愿景」閱讀體驗(yàn)】+AI芯片的需求和挑戰(zhàn)

景嘉微電子、海光信息技術(shù)、上海復(fù)旦微電子、上海壁仞科技、上海燧原科技、上海天數(shù)智芯半導(dǎo)體、墨芯人工智能、沐曦集成電路等。

在介紹完這些云端數(shù)據(jù)中心的AI芯片之后,還為我們介紹了邊緣AI

發(fā)表于 09-12 16:07

睿海光電以高效交付與廣泛兼容助力AI數(shù)據(jù)中心800G光模塊升級(jí)

提供“數(shù)據(jù)高速通道”。

低延遲與高可靠:通過信號(hào)完整性設(shè)計(jì)與超低功耗控制,減少數(shù)據(jù)中心能耗的同時(shí),保障大規(guī)模AI訓(xùn)練的穩(wěn)定性。

前瞻布局:1.6T光模塊研發(fā)已啟動(dòng),為下一代1.6T

發(fā)表于 08-13 19:01

華為面向拉美地區(qū)發(fā)布全新星河AI數(shù)據(jù)中心網(wǎng)絡(luò)方案

在華為數(shù)據(jù)通信創(chuàng)新峰會(huì)2025拉美站期間,以“星河AI數(shù)據(jù)中心網(wǎng)絡(luò),賦AI時(shí)代新動(dòng)能”為主題的分論壇上,華為面向拉美地區(qū)發(fā)布全新升級(jí)的星河

安森美攜手英偉達(dá)推動(dòng)下一代AI數(shù)據(jù)中心發(fā)展

安森美(onsemi,美國(guó)納斯達(dá)克股票代號(hào):ON)宣布與英偉達(dá)(NVIDIA)合作,共同推動(dòng)向800V直流(VDC)供電架構(gòu)轉(zhuǎn)型。這一變革性解決方案將推動(dòng)下一代人工智能(AI)數(shù)據(jù)中心

繼HBM之后,英偉達(dá)帶火又一AI內(nèi)存模組!顛覆AI服務(wù)器與PC

Attached Memory Module,即小型化壓縮附加內(nèi)存模組,是英偉達(dá)主導(dǎo)開發(fā)的一種新型內(nèi)存模塊,是適用于數(shù)據(jù)中心

適用于數(shù)據(jù)中心和AI時(shí)代的800G網(wǎng)絡(luò)

數(shù)據(jù)中心依賴數(shù)千甚至上萬個(gè)GPU集群進(jìn)行高性能計(jì)算,對(duì)帶寬、延遲和數(shù)據(jù)交換效率提出極高要求。

AI云:以生成式AI為核心的云平臺(tái),為多租戶環(huán)境提供

發(fā)表于 03-25 17:35

Cadence顛覆AI數(shù)據(jù)中心設(shè)計(jì)

日前舉辦的英偉達(dá) GTC 2025 開發(fā)者大會(huì)匯聚了眾多行業(yè)精英,共同探討人工智能的未來。而人工智能正在重塑全球數(shù)據(jù)中心的格局。據(jù)預(yù)測(cè),未來將有 1 萬億美元用于 AI 驅(qū)動(dòng)的

英偉達(dá)GTC25亮點(diǎn):NVIDIA Blackwell Ultra 開啟 AI 推理新時(shí)代

英偉達(dá)GTC25亮點(diǎn):NVIDIA Blackwell Ultra 開啟 AI 推理新時(shí)代

英偉達(dá)加速認(rèn)證三星AI內(nèi)存芯片

近日,英偉達(dá)公司正在積極推進(jìn)對(duì)三星AI內(nèi)存芯片的認(rèn)證工作。據(jù)英偉

高通挑戰(zhàn)英偉達(dá)!發(fā)布768GB內(nèi)存AI推理芯片,“出征”AI數(shù)據(jù)中心

高通挑戰(zhàn)英偉達(dá)!發(fā)布768GB內(nèi)存AI推理芯片,“出征”AI數(shù)據(jù)中心

評(píng)論