電子發燒友網報道(文/梁浩斌)隨著AI應用對算力需求的爆發增長,數據中心互連的要求提高,光模塊逐漸從800G邁向1.6T之后,CPO技術也開始受到行業重視。而英偉達、博通等廠商近幾年不斷強調CPO的重要性,也使得CPO已經在業界成為了一個共識:數據中心互連技術的未來,需要CPO技術的支撐。

CPO即共封裝光學,是將光學收發器直接與交換芯片/計算芯片集成在同一封裝中的一種技術。傳統的可插拔光學模塊雖然在較低數據速率下仍有應用空間,但隨著數據中心內部流量以近30%的復合年增長率激增,在信號完整性、功率效率和帶寬密度方面面臨挑戰。CPO通過最小化電氣鏈路長度,在早期實現中將功耗降低30-50%,并支持每秒超過800G和1.6T的高數據速率。

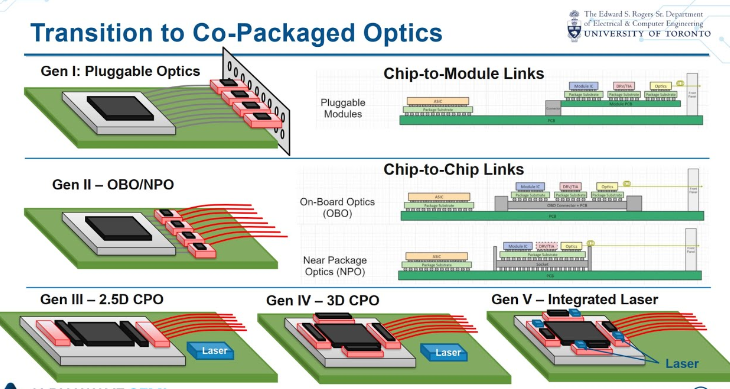

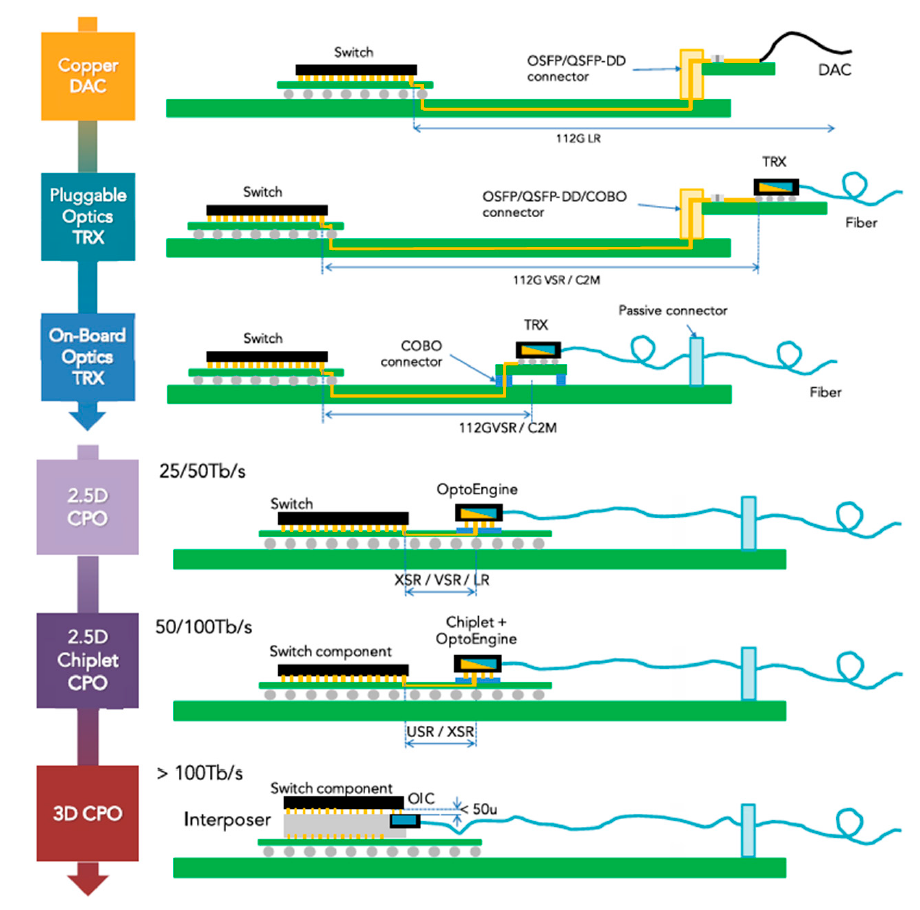

在數據中心互連技術的演變中,從傳統銅線到光纖,再到CPO,尤其是CPO技術中還存在多個發展階段。下文就將通過六個部分,來回顧和展望數據中心互連技術的演變。

DAC電纜(銅質直接連接電纜)

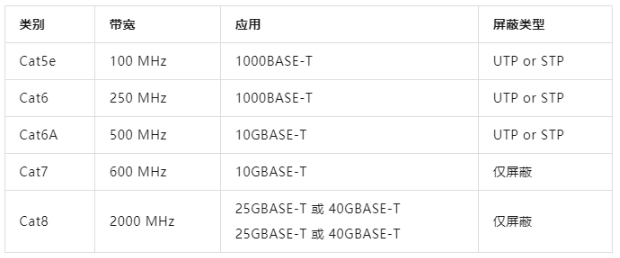

在最早的數據中心內部互連中,數據傳輸是通過銅纜進行的,在這個階段的架構是以交換芯片(Switch)通過OSFP/QSFP-DD連接器連接到DAC電纜為主,支持112G LR速率。主要特點在于依賴純電氣連接,適用于短距離數據傳輸,比如數據中心內部的機架間連接。優點包括成本低廉、部署簡單,且無需光學轉換設備,功耗也較低。然而,缺點也非常顯著,包括銅線信號衰減嚴重,傳輸距離有限(通常僅幾米),功耗較高,無法滿足高密度和高速度的應用需求。這一階段代表了早期數據中心的低帶寬解決方案,隨著數據爆炸增長,已逐漸被光學技術取代。

可插拔光模塊

進入光通信時代,最廣泛應用的也是現階段常見的可插拔光模塊。交換芯片通過OSFP/QSFP-DD/COBO連接器連接到TRX(光收發器)模塊,再延伸到光纖,支持112G VSR(極短距離)/C2M(芯片到模塊)接口。

這種模式中,光模塊支持熱插拔,維護和升級都較為方便,優點就在于靈活性高,標準化的光模塊易于替換升級,可以擴展傳輸距離并提升帶寬。而缺點是交換芯片到板邊緣的電氣鏈路仍然較長,導致導致信號損失和功耗增加,同時TRX采用Retimer和均衡器實現信號處理,功耗也較高。目前主流的數據中心內,中距離連接普遍采用光模塊,但隨著AI算力的需求不斷增長,未來將逐漸難以應對AI負載的需求。

當然,目前針對成本和800G解決方案的需求,也演變出LPO(線性可插拔光學)和LRO(線性接收光學)兩種技術路徑。

LPO是一種低功耗的可插拔光學模塊技術,它通過直接驅動光學組件,而非依賴傳統的DSP進行信號重定時和補償。在傳統光學模塊中,DSP負責處理信號失真、時鐘恢復和均衡,但這會消耗大量功率,尤其對于800G及以上速率的光模塊中。LPO則將DSP功能移到主機側,比如交換機ASIC上,從而簡化模塊設計,實現更低的功耗、更低成本和更低延遲。

而為了進一步降低功耗,在LPO的基礎上也演變出LRO技術。LRO同樣是省去DSP,相比LPO更加強調接收端的信號線性化,結合硅光技術實現高集成度,相比LPO的功耗更低,并在未來可以與CPO結合提升系統的整體效率。

板載光模塊(OBO)

作為過渡階段,OBO將光學模塊移到電路板上。結構上,交換芯片通過COBO連接器連接到TRX,再經被動連接器到光纖,仍使用112G VSR/C2M接口。

特點在于縮短了電氣鏈路,提高了集成度。優點包括減少板邊緣連接,提升密度和效率;被動連接器簡化了光纖管理。缺點是模塊仍獨立于Switch,熱管理和功耗優化有限,無法實現更深層的集成。這一階段適合需要更高密度的系統,但尚未達到CPO的完整潛力。

2.5D共封裝光學

CPO技術的真正起點是2.5D CPO,這個階段的互連速率可以高達25Tb/s甚至50Tb/s,遠超傳統可插拔模塊。2.5D CPO中交換芯片ASIC直接與光學引擎封裝在同一基板上,核心結構基于硅中介層,將多個芯片并排放置,通過銅柱微凸點實現電氣連接,以支持高密度互連。相比3D堆疊,2.5D的側向布局簡化了制造工藝,但仍可以提供比2D封裝更高的集成度。

?

?來源:APNIC Blog

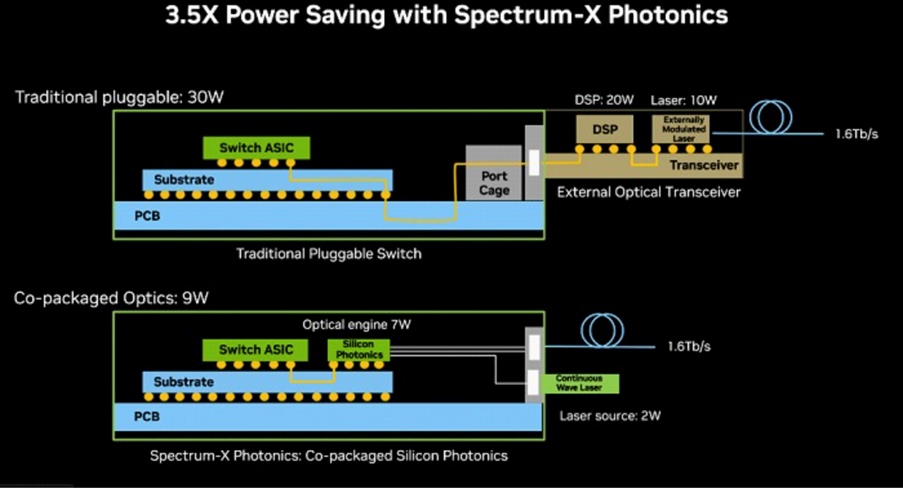

2.5D CPO特點在于引入模塊化芯片組設計,將Switch分解為可定制組件,進一步集成光學引擎。通過縮短電氣鏈路長度,減少信號損失和功率消耗。博通和英偉達的報告顯示,與傳統光模塊相比,2.5D CPO功率效率可提升3.5倍以上,每bit功耗降至<5 pJ/bit。

而缺點是芯片組集成增加了設計復雜度,中介層對準和鍵合要求高,需要先進封裝技術。這一階段針對未來超大規模數據中心,支持Tb/s級AI訓練應用,英偉達、博通已經有部分交換機產品應用了這項技術。

2.5D Chiplet CPO

2.5D Chiplet CPO是2.5D CPO的高級變體,將chiplet設計融入到2.5D封裝框架內,實現光學和電子組件的模塊化集成。其核心同樣是基于硅中介層,通過RDL和TVS連接多個Chiplet,支持高密度互連。其中,交換芯片被分解成多個小的Chiplet,比如將計算、I/O、內存等模塊分解,與PIC并排放置。

而光學組件包括激光器、調制器、探測器等與Chiplet異構集成,這種設計可以獨立優化每一個模塊,便于升級和定制。在制造層面上,Chiplet間的對準和互連要求高,可能增加制造難度。總體來看,2.5D Chiplet CPO是CPO邁向3D封裝的過渡階段。

3D CPO

通過3D封裝,CPO技術達到了最先進的階段。通過垂直堆疊光學和電子組件,實現更高的集成度和性能優化,并解決了2.5D CPO的面積限制和信號延遲問題,能夠支持超過100Tb/s的帶寬。

?

?來源:Alphawave semi

3D CPO的核心結構基于垂直堆疊和TSV技術,將光學和電子層疊加,實現無縫集成。硅光子芯片作為基底層,集成激光器、波導、光學切換和路由功能。上層堆疊電子集成電路如ASIC和PIC,通過TSV和微凸點實現層間互連,實現更短的跡線,減少信號損失。

計算芯片如ASIC,被多個硅光子IC收發器芯片組包圍,垂直堆疊在中介層上。光學引擎包括調制器、探測器和光纖陣列單元FAU,直接與電子層耦合。激光源則置于基底層,光信號通過波導垂直傳輸到上層。外部光纖通過FAU連接,支持高密度接口如USR/XSR。

相比2.5D的側向布局,3D堆疊減少了占用面積,實現更緊湊的設計。但與此同時,其面臨的制造和熱管理難度也非常大,制造中層間對準和TSV要求高,良率較低,成本較高;垂直堆疊增加熱密度,需要有更好的散熱方案。

總體來說,3DCPO通過垂直堆疊實現光學與電子的深度融合,提供超高性能、低功耗的解決方案。它在結構上強調層疊集成,在特點上突出密度和效率,是未來的CPO技術趨勢之一。

寫在最后:

從銅線DAC到3D CPO的六個發展階段背后,是數據中心互連需求不斷提高的需求,高速互連逐步從電氣依賴轉向光學主導,并在光學階段進一步出現多種技術路徑的演變。未來,隨著制造技術的成熟,光學技術將推動數據中心向更高算力、更高效的方向發展。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

光通信

+關注

關注

20文章

977瀏覽量

35202

發布評論請先 登錄

相關推薦

熱點推薦

數據中心布線的未來:光纖與銅纜的博弈與共存

隨著數據中心向高帶寬、高性能和高密度方向演進,布線系統正面臨前所未有的挑戰。光纖憑借速度與傳輸距離優勢,正在成為骨干網絡的主流選擇;然而,銅纜并未因此退出舞臺,憑借成本、兼容性及特定應用場景的獨特

睿海光電:400G光模塊技術創新與AI數據中心變革

睿海光電:400G光模塊技術創新與AI數據中心變革 一、400G光模塊:新一代數據中心的核心引擎 在AI大模型訓練、邊緣計算和云服務快速發展

睿海光電以高效交付與廣泛兼容助力AI數據中心800G光模塊升級

合作案例,成為AI數據中心升級的關鍵推動者。

一、技術實力:AI光模塊的研發與量產先鋒

睿海光電作為全球AI光模塊的領先品牌,專注于為數據中心

發表于 08-13 19:01

加速AI未來,睿海光電800G OSFP光模塊重構數據中心互聯標準

定義數據中心互聯的新范式。

一、技術實力:800G OSFP光模塊的卓越性能表現

睿海光電800G OSFP光模塊系列采用行業領先的PAM4調制技術

發表于 08-13 16:38

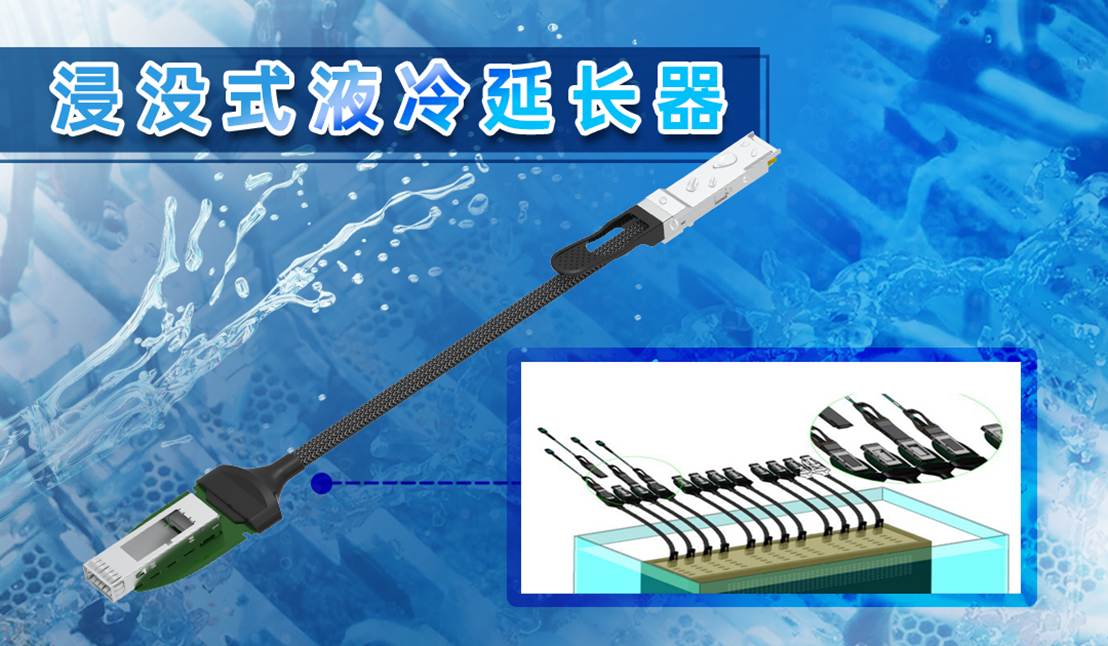

易飛揚浸沒液冷延長器與硅光液冷光模塊主題研究 ——液冷光互連技術的數據中心革命

1.02-1.05,適用于超高密度算力集群。

? 冷板式液冷:適用于部分液冷改造場景,但散熱效率低于浸沒式。

? 硅光技術+液冷:硅光子(SiPh)可降低光模塊功耗,結合液冷可進一步提升能效比。

易飛揚作為

中型數據中心中的差分晶體振蕩器應用與匹配方案

關鍵業務平臺,需高IO能力、低時延響應與高并發處理,具備容災與跨區域同步能力。

使用設備: 數據中心級交換機、光模塊、RAID控制器、企業級SSD陣列、PCIe HBA/NIC、高精度差分振蕩器、時間

發表于 07-01 16:33

小型數據中心晶振選型關鍵參數全解

相位抖動等技術指標,還需要根據實際應用的功耗、溫度穩定性和其他環境因素來做出最合適的選擇。

通過合理布置PCB線路和優化時鐘信號的傳輸路徑,可以進一步提升時鐘同步的精度和可靠性,確保數據中心的高效穩定

發表于 06-11 13:37

LPO與CPO:光互連技術的轉折與協同發展

光模塊、oDSP與交換機交換芯片是數據中心光互連的核心組件,而LPO(線性驅動可插拔光學)和CPO(共封裝光學)的出現正推動行業向更低功耗、更高密度演進。

數據中心液冷技術和風冷技術的比較

近年來,隨著數字經濟的蓬勃發展,數據中心建設規模不斷擴大,導致機房單位面積功耗居高不下,對數據中心散熱制冷技術提出了更高的要求。同時,根據國家對數據中心的節能要求,全國范圍內新建

適用于數據中心和AI時代的800G網絡

選擇無擁塞路徑,提高數據傳輸效率。

多租戶性能隔離:確保不同用戶任務之間帶寬分配合理。

飛速(FS)800G光模塊在AI數據中心中的作用

為滿足AI和大規模

發表于 03-25 17:35

優化800G數據中心:高速線纜、有源光纜和光纖跳線解決方案

隨著技術的飛速發展,數據中心正在從100G和400G演進到800G時代,對高速數據傳輸的需求與日俱增。因此,選擇高效且可靠的布線解決方案對于800G數據中心至關重要。本文將深入探討80

發表于 03-24 14:20

構建未來數據中心 發揮人工智能AI的力量

為了滿足性能需求,數據中心架構師必須擴展系統結構,通過 PAM4 調制方案支持 224 Gbps 數據傳輸速率。這給互連解決方案帶來了巨大的挑戰,推動新的技術的運用,同時充分利用路由、

數據中心互連技術演變:光進銅退的完整路徑

數據中心互連技術演變:光進銅退的完整路徑

評論