近年來,隨著數字經濟的蓬勃發展,數據中心建設規模不斷擴大,導致機房單位面積功耗居高不下,對數據中心散熱制冷技術提出了更高的要求。同時,根據國家對數據中心的節能要求,全國范圍內新建數據中心要求PUE(Power Usage Effectiveness,電源利用效率)<1.2,而傳統的風冷制冷方式已經無法滿足數據中心的散熱需求,更加高效的液冷方案應運而生。特別在人工智能領域,隨著智算需求的爆發,液冷方案已經成為數據中心的首選。

1液冷VS風冷

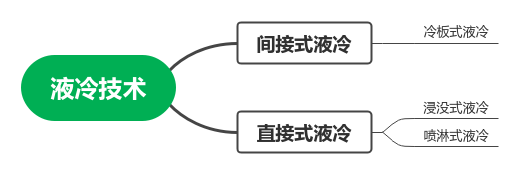

液冷,是利用液體介質冷卻發熱器件,達到制冷目的。風冷,是利用空氣與發熱器件換熱,達到制冷目的。 數據中心中液冷技術有直接式和間接式液冷兩種,其中直接式又分為浸沒式和噴淋式兩種。

冷板式液冷:好比睡涼席,通過冷板貼在發熱器件上為發熱器件散熱。

浸沒式液冷:好比泡冷水澡,發熱器件完全“泡”在冷卻液中并通過直接接觸熱交換。

噴淋式液冷:好比沖淋浴,通過噴淋冷卻液方式為發熱器件散熱。

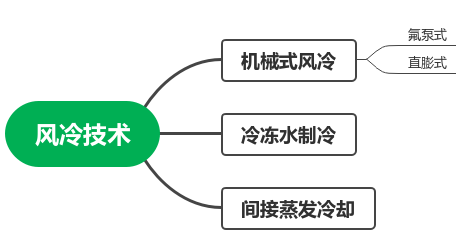

數據中心風冷技術有多年的技術演進過程,發展出了機械式風冷、冷凍水、間接蒸發等技術。

機械式風冷:通常用于機房精密空調,主要通過壓縮機機械做功改變制冷劑的狀態來制冷。

冷凍水制冷:在機械風冷式制冷基礎上,疊加了冷卻水循環和冷凍水循環實現制冷,提高了制冷量。

間接蒸發制冷:通過非直接接觸式換熱器,實現外部自然冷風與數據中心熱回風進行熱交換,利用了自然冷卻提高制冷效率。

由于液冷在制冷效率上的先天優勢,配置有液冷系統的數據中心相比傳統風冷數據中心,在PUE和WUE(Water Usage Effectiveness,水資源使用效率)關鍵能源效率指標上,都具有優勢。

PUE:PUE是衡量數據中心能源效率的核心指標,表示數據中心總能耗與其IT設備能耗之比。液冷系統中沒有風冷系統中的壓縮機、風機等高耗電器件,冷卻液體可以直接對設備高溫器件(GPU、CPU等)進行散熱,從而降低PUE。

WUE:WUE是衡量數據中心水資源效率的指標,如0.8 L/kWh表示為每消耗1度電同時消耗0.8升水。液冷系統通過冷卻水高效循環制冷,對比間接蒸發冷卻系統通過蒸發噴淋消耗大量水資源,液冷對水資源的依賴程度更低。

液冷與風冷指標對比:

| 指標 | 液冷 | 風冷 |

|---|---|---|

| PUE | 通常在1.1~1.2之間,部分高效液冷系統的PUE甚至可以降到1.05以下。 | 通常在1.4~2.0之間。 |

| WUE | 可達到0.8 L/kWh以下。 | 通常大于2 L/kWh,依賴環境干濕空氣條件。 |

2為什么選擇液冷

液冷作為數據中心高功率密度散熱場景的優先選項,主要有兩方面原因:一方面是由于液體的高導熱和高比熱容特性,液冷技術相對于傳統空氣制冷技術,具有更高的散熱效率;另一方面是液冷系統僅需要水泵等少量耗能元件,能夠顯著降低PUE。

高導熱性

導熱性指的是材料傳遞熱量的能力,液體通常比空氣具有更好的導熱性,能夠更快地從熱源吸收并傳導熱量。水的導熱性大約是0.6 W/m·K,空氣的導熱性只有0.025 W/m·K。當設備發熱時,液冷系統中的液體能夠迅速吸收熱量并將其帶走,而空氣制冷則需要更多時間來進行熱量交換。

高比熱容

比熱容是指物質吸收或釋放的熱量與其溫度變化之間的比值,熱容越大,物質就能存儲更多的熱量,而不容易升溫。水的比熱容大約是4.18 J/g·K,空氣的比熱容大約是1.00 J/g·K。設備在長時間內持續工作,液冷系統也能更穩定地調節溫度。

系統功耗低

在實際工程應用中,液冷系統中沒有壓縮機、風機等高耗電器件,僅需要水泵、傳感器等少量耗電器件,能夠顯著降低PUE。

各種制冷技術可以實現的PUE范圍參見下表。

| 制冷技術 | PUE范圍 |

|---|---|

| 風冷直膨技術 | 1.4~2.0 |

| 氟泵技術 | 1.2~1.5 |

| 帶自然冷的冷凍水技術 | 1.2~1.5 |

| 間接蒸發冷卻技術 | 1.1~1.3 |

| 冷板式液冷技術 | <1.2 |

| 浸沒式液冷技術 | <1.1 |

說明 實際PUE值可能會受到多種因素的影響,包括地理位置、氣候條件、數據中心設計等。

由上表可見,使用液冷技術進行制冷,是實現PUE<1.2節能要求的必須路徑。

3數據中心液冷方案

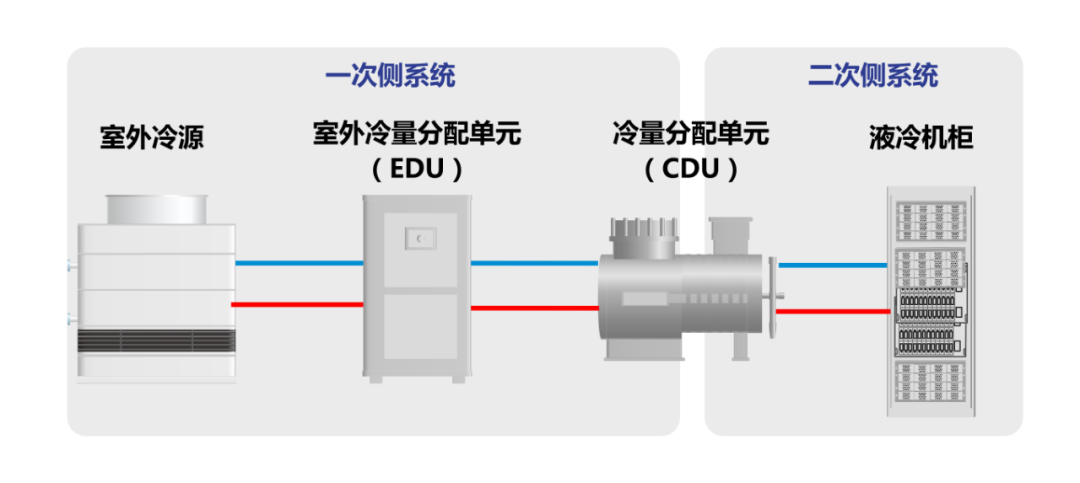

目前液冷技術在數據中心的實際應用中,以冷板式液冷最為廣泛。ZTE中興提供先進的數據中心冷板式液冷解決方案,集成室外冷源、EDU(External Distribution Unit,外部分配單元)、CDU(Cooling Distribution Unit,冷量分配單元)、液冷機柜等關鍵設備。具備以下優勢:

全鏈條:從服務器到基礎設施的端到端解決方案,覆蓋設計、交付、運維全過程。

全控制:對液冷和風冷設備統一管理,系統級調優,實現節能最優。

全場景:適配新建、改造數據中心場景,滿足不同建筑形式和不同機柜規模需求。

全地域:擺脫地域氣候條件限制,安全可靠。

ZTE中興冷板式液冷系統架構如下圖。

室外冷源:通常為閉式塔或干冷器,是液冷系統的外部冷量輸入來源。

EDU:EDU是液冷系統一次側的循環動力源,機組由水泵、過濾器、管路組件、傳感器、配電控制箱等主要部件以及穩壓裝置(選配)、自動補液裝置(選配)等輔助功能模塊組成。EDU主要功能是為一次側工質提供循環動力,同時可集成冷卻塔的配電與控制,實現對一次側系統溫度、壓力、流量的統一監控。

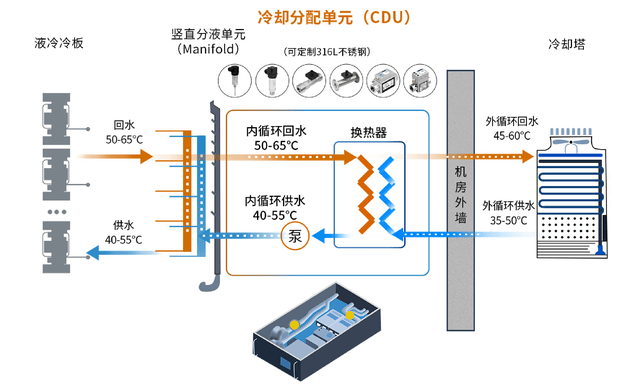

CDU:CDU是液冷系統中的核心設備,機組由液-液換熱器、水泵、管路組件、傳感器、配電控制箱等主要部件以及過濾器、穩壓裝置、自動補液裝置等輔助功能模塊組成。液冷CDU作為冷板式液冷系統二次側的循環換熱中心,其主要功能是為二次側工質提供再冷卻和循環動力,并對整個二次側系統進行集中控制。

液冷機柜:為液冷系統定制的服務器機柜,適配19英寸或21英寸IT設備(服務器、交換機)。機柜由機柜結構件、manifold(分集水器)、液冷軟管、流體連接器、供電單元及管理單元等組成。

一/二次側管路:包括管路和相應閥門,管路采用環網結構。一二次側管路連接起室外冷源、CDU、EDU和液冷機柜,將冷卻液輸送到需要熱交換的設備中。

近日,國際數據公司(IDC)發布了最新的《中國半年度液冷服務器市場(2024下半年)跟蹤》報告,數據顯示中國液冷服務器市場在2024年繼續保持快速增長,市場規模達到23.7億美元,與2023年相比增長67.0%。其中,冷板式解決方案市場占有率進一步提高。IDC預計,2024-2029年,中國液冷服務器市場年復合增長率將達到46.8%,2029年市場規模將達到162億美元。

在工信部發布的2024年第28號文件中,正式發布了由中興通訊股份有限公司參與編寫的YD/T 6049-2024《冷板式液冷整機柜服務器技術要求和測試方法》,該標準為首個液冷整機柜服務器領域的行業標準。規定了冷板式液冷整機柜服務器的機柜、供液組件、供配電組件、計算節點、交換節點、整機柜內組網、機柜管理模塊技術要求和測試方法,適用于數據中心冷板式液冷整機柜服務器的設計、生產及測試。

由此可見業界和市場對高效、低碳節能的液冷技術已形成共識,未來已來,您對當前數據中心液冷方案有什么看法?您認為液冷方案在未來會如何發展?歡迎在評論區分享您的觀點。

-

數據中心

+關注

關注

18文章

5689瀏覽量

75140 -

人工智能

+關注

關注

1819文章

50173瀏覽量

266085 -

液冷

+關注

關注

5文章

162瀏覽量

5782

原文標題:從風冷到液冷:數據中心如何走向節能高效的未來

文章出處:【微信號:ztedoc,微信公眾號:中興文檔】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

數據中心液冷監測解決方案:驅動高效冷卻,護航綠色算力

曙光數創液冷方案助力數據中心綠色發展

華為液冷熱管理控制器TMU榮獲“數據中心冷卻創新獎”

華為數字能源亮相2025開放數據中心大會

數據中心液冷服務器該配什么樣的 UPS 不間斷電源?

睿海光電以高效交付與廣泛兼容助力AI數據中心800G光模塊升級

易飛揚浸沒液冷延長器與硅光液冷光模塊主題研究 ——液冷光互連技術的數據中心革命

Gems全維度傳感器方案在液冷數據中心的應用

曙光數創推出液冷數據中心全生命周期定制新服務

海瑞思科技助力數據中心液冷分水器泄漏檢測

英特爾引領液冷革新,與殼牌共筑數據中心高效冷卻新范式

RAKsmart液冷技術如何實現PUE<1.2的綠色數據中心

流量與壓力傳感:數據中心液冷的″智慧之眼″

數據中心液冷技術和風冷技術的比較

數據中心液冷技術和風冷技術的比較

評論