數據庫慢查詢分析與SQL優化實戰技巧:從入門到精通的性能調優指南

引言:一個真實的生產事故

凌晨3點,你被一陣急促的電話鈴聲驚醒。值班同事焦急地說:"線上數據庫響應時間飆升到30秒,用戶大量投訴,訂單系統幾乎癱瘓!"

這是每個運維工程師的噩夢,也是我曾經真實經歷過的場景。那次事故的根本原因,僅僅是一條看似簡單的SQL查詢語句。經過優化后,查詢時間從30秒降到了0.3秒,性能提升100倍。

今天,我將分享我在處理數千次數據庫性能問題中積累的實戰經驗,幫助你系統掌握慢查詢分析與SQL優化的核心技巧。無論你是剛入門的運維新手,還是有一定經驗的工程師,這篇文章都將為你提供實用的解決方案。

一、慢查詢的本質:為什么你的數據庫會變慢?

1.1 慢查詢的定義與影響

在深入技術細節之前,我們需要明確什么是慢查詢。簡單來說,慢查詢就是執行時間超過預設閾值的SQL語句。在MySQL中,默認超過10秒的查詢會被記錄為慢查詢,但在實際生產環境中,我通常會將這個閾值設置為1秒甚至更低。

慢查詢的影響遠比表面看起來嚴重。一條慢查詢不僅會占用大量數據庫資源,還會引發連鎖反應:連接池耗盡、鎖等待增加、內存占用飆升,最終導致整個系統雪崩。我見過太多案例,一條未優化的SQL讓整個電商平臺在促銷高峰期徹底癱瘓。

1.2 慢查詢產生的根本原因

通過分析上萬條慢查詢日志,我總結出慢查詢產生的五大根本原因:

缺少合適的索引:這是最常見的原因,占到所有慢查詢問題的60%以上。沒有索引的全表掃描就像在沒有目錄的字典里查找一個詞,效率極其低下。

索引失效:即使建立了索引,不當的查詢寫法也會導致索引失效。比如在WHERE子句中對索引列使用函數、隱式類型轉換、使用NOT或!=操作符等。

數據量過大:隨著業務增長,單表數據量可能達到千萬甚至上億級別。即使有索引,掃描如此龐大的數據量也會導致性能問題。

鎖競爭:在高并發場景下,多個事務競爭同一資源會導致鎖等待,表現為查詢變慢。

硬件資源瓶頸:CPU、內存、磁盤I/O任何一個達到瓶頸都會影響數據庫性能。

1.3 慢查詢的識別標志

在日常運維中,如何快速識別慢查詢問題?以下是我常用的幾個關鍵指標:

? CPU使用率持續超過80%

? 數據庫連接數接近最大值

? 磁盤I/O等待時間明顯增加

? 應用響應時間突然延長

? 慢查詢日志文件快速增長

當出現這些征兆時,就需要立即進行慢查詢分析了。

二、慢查詢分析工具與方法論

2.1 開啟和配置慢查詢日志

首先,我們需要正確配置慢查詢日志。在MySQL中,可以通過以下參數進行配置:

-- 查看當前慢查詢配置 SHOWVARIABLESLIKE'slow_query%'; SHOWVARIABLESLIKE'long_query_time'; -- 動態開啟慢查詢日志 SETGLOBALslow_query_log='ON'; SETGLOBALslow_query_log_file='/var/log/mysql/slow.log'; SETGLOBALlong_query_time=1; -- 設置為1秒 SETGLOBALlog_queries_not_using_indexes='ON'; -- 記錄未使用索引的查詢

在生產環境中,我建議在my.cnf配置文件中永久設置:

[mysqld] slow_query_log=1 slow_query_log_file= /var/log/mysql/slow.log long_query_time=1 log_queries_not_using_indexes=1 log_throttle_queries_not_using_indexes=10 -- 限制每分鐘記錄的未使用索引查詢數量

2.2 使用pt-query-digest分析慢查詢

pt-query-digest是Percona Toolkit中的強大工具,能夠對慢查詢日志進行深度分析。這是我日常使用頻率最高的工具之一。

安裝方法:

# CentOS/RHEL yum install percona-toolkit # Ubuntu/Debian apt-get install percona-toolkit

基礎用法:

# 分析慢查詢日志 pt-query-digest /var/log/mysql/slow.log > slow_analysis.txt # 只分析最近1小時的慢查詢 pt-query-digest --since'1h'/var/log/mysql/slow.log # 分析并輸出top 10最慢的查詢 pt-query-digest --limit=10 /var/log/mysql/slow.log

pt-query-digest的輸出報告包含了豐富的信息:查詢執行次數、總執行時間、平均執行時間、鎖等待時間等。通過這些數據,我們可以快速定位需要優化的SQL語句。

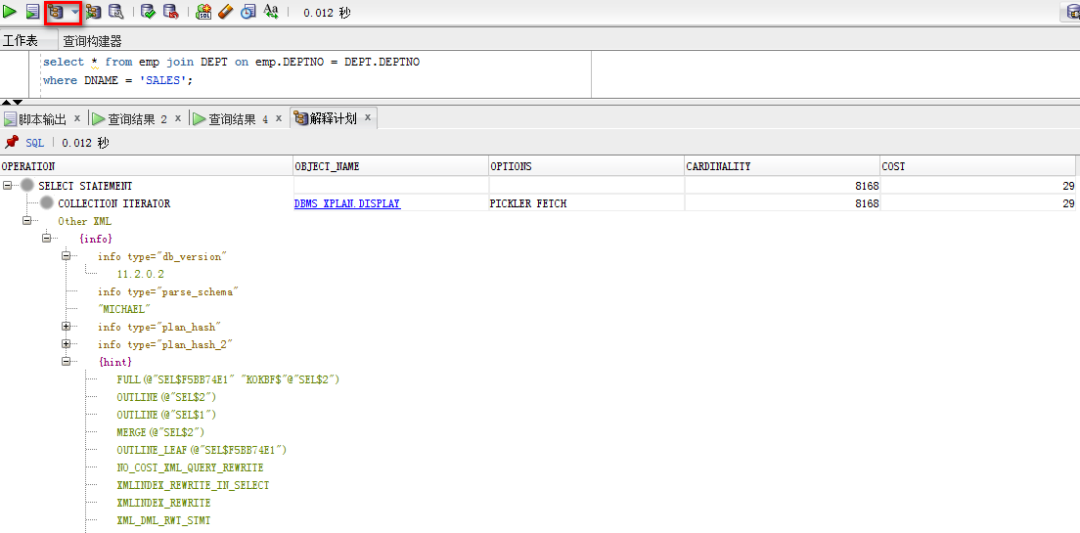

2.3 使用EXPLAIN分析執行計劃

EXPLAIN是SQL優化的核心工具,它能展示MySQL如何執行SQL語句。掌握EXPLAIN的輸出是每個運維工程師的必備技能。

EXPLAINSELECTu.name, o.order_no, o.amount FROMusers u JOINorders oONu.id=o.user_id WHEREo.created_at>'2024-01-01' ANDu.status='active';

EXPLAIN輸出的關鍵字段解析:

type字段(連接類型,性能從好到差):

? system:表只有一行記錄,這是const類型的特例

? const:通過主鍵或唯一索引一次就找到了

? eq_ref:唯一性索引掃描,對于每個索引鍵,表中只有一條記錄與之匹配

? ref:非唯一性索引掃描

? range:索引范圍掃描

? index:全索引掃描

? ALL:全表掃描(最差)

key字段:實際使用的索引。如果為NULL,說明沒有使用索引,這通常是優化的重點。

rows字段:預估需要掃描的行數。這個數字越大,查詢越慢。

Extra字段:包含重要的額外信息

? Using index:覆蓋索引,非常好

? Using where:使用WHERE過濾

? Using temporary:使用臨時表,需要優化

? Using filesort:文件排序,需要優化

2.4 使用Performance Schema進行實時監控

Performance Schema是MySQL 5.5之后引入的強大性能監控工具。它能提供實時的性能數據,是生產環境監控的利器。

啟用Performance Schema:

-- 檢查是否啟用 SHOWVARIABLESLIKE'performance_schema'; -- 查看當前執行的SQL SELECT*FROMperformance_schema.events_statements_currentG -- 查看執行時間最長的10條SQL SELECT DIGEST_TEXT, COUNT_STARasexec_count, SUM_TIMER_WAIT/1000000000000astotal_latency_sec, AVG_TIMER_WAIT/1000000000000asavg_latency_sec FROMperformance_schema.events_statements_summary_by_digest ORDERBYAVG_TIMER_WAITDESC LIMIT10;

三、SQL優化實戰技巧

3.1 索引優化策略

索引優化是SQL調優的核心。正確的索引策略可以讓查詢性能提升數百倍。

創建合適的索引

最基本的原則是為WHERE、JOIN、ORDER BY、GROUP BY涉及的列創建索引:

-- 單列索引 CREATEINDEX idx_created_atONorders(created_at); -- 復合索引(注意順序很重要) CREATEINDEX idx_user_status_createdONorders(user_id, status, created_at); -- 覆蓋索引(包含查詢所需的所有列) CREATEINDEX idx_coveringONorders(user_id, status, amount, created_at);

索引設計的最佳實踐

基于我的經驗,以下是索引設計的黃金法則:

1. 選擇性原則:優先為選擇性高的列創建索引。選擇性 = 不重復的值 / 總行數

2. 最左前綴原則:復合索引要考慮查詢條件的順序

3. 避免冗余索引:如果已有(a,b)的索引,通常不需要再創建(a)的索引

4. 限制索引數量:單表索引數量建議不超過5個,過多索引會影響寫入性能

識別和處理無效索引

定期清理無效索引是運維的重要工作:

-- 查找未使用的索引

SELECT

s.table_schema,

s.table_name,

s.index_name

FROMinformation_schema.statistics s

LEFTJOINperformance_schema.table_io_waits_summary_by_index_usage t

ONs.table_schema=t.object_schema

ANDs.table_name=t.object_name

ANDs.index_name=t.index_name

WHEREt.count_starISNULL

ANDs.table_schemaNOTIN('mysql','performance_schema','information_schema')

ANDs.index_name!='PRIMARY';

3.2 查詢重寫技巧

很多時候,通過重寫SQL語句就能獲得巨大的性能提升。

**避免SELECT ***

永遠不要在生產環境使用SELECT *,原因包括:

? 傳輸不必要的數據增加網絡開銷

? 無法利用覆蓋索引

? 表結構變更可能導致程序錯誤

-- 錯誤示例 SELECT*FROMusersWHEREstatus='active'; -- 正確示例 SELECTid, name, emailFROMusersWHEREstatus='active';

合理使用JOIN替代子查詢

在MySQL中,JOIN通常比子查詢性能更好:

-- 低效的子查詢 SELECTnameFROMusers WHEREidIN(SELECTuser_idFROMordersWHEREamount>1000); -- 高效的JOIN SELECTDISTINCTu.name FROMusers u INNERJOINorders oONu.id=o.user_id WHEREo.amount>1000;

使用EXISTS替代IN

當子查詢結果集較大時,EXISTS比IN更高效:

-- 使用IN(當orders表很大時效率低) SELECT*FROMusers WHEREidIN(SELECTuser_idFROMordersWHEREstatus='completed'); -- 使用EXISTS(更高效) SELECT*FROMusers u WHEREEXISTS( SELECT1FROMorders o WHEREo.user_id=u.idANDo.status='completed' );

分頁查詢優化

大偏移量的分頁查詢是性能殺手。使用延遲關聯可以顯著提升性能:

-- 低效的分頁(offset很大時非常慢) SELECT*FROMordersORDERBYid LIMIT1000000,20; -- 延遲關聯優化 SELECTo.*FROMorders o INNERJOIN( SELECTidFROMordersORDERBYid LIMIT1000000,20 )AStONo.id=t.id; -- 使用游標分頁(推薦) SELECT*FROMordersWHEREid>1000000ORDERBYid LIMIT20;

3.3 事務和鎖優化

在高并發場景下,事務和鎖的優化至關重要。

縮短事務時間

長事務是系統性能的大敵。我的原則是:事務越短越好。

# 錯誤示例:在事務中進行耗時操作

defprocess_order(order_id):

withtransaction():

order = get_order(order_id)

# 耗時的外部API調用不應該在事務中

payment_result = call_payment_api(order)

update_order_status(order_id, payment_result)

# 正確示例:將耗時操作移出事務

defprocess_order(order_id):

order = get_order(order_id)

payment_result = call_payment_api(order) # 移到事務外

withtransaction():

update_order_status(order_id, payment_result)

避免鎖升級

合理的索引可以避免鎖升級,減少鎖沖突:

-- 為UPDATE語句的WHERE條件創建索引,避免表鎖 CREATEINDEX idx_statusONorders(status); -- 這樣UPDATE時只會鎖定符合條件的行 UPDATEordersSETprocessed=1WHEREstatus='pending';

使用樂觀鎖處理并發

對于更新沖突不頻繁的場景,樂觀鎖是很好的選擇:

-- 添加版本號字段 ALTER TABLEproductsADDCOLUMNversionINTDEFAULT0; -- 更新時檢查版本號 UPDATEproducts SETstock=stock-1, version=version+1 WHEREid=100ANDversion=5; -- 檢查影響行數,如果為0說明版本已變更,需要重試

四、性能監控與預警體系構建

4.1 構建完整的監控指標體系

一個完善的數據庫監控體系應該包含以下核心指標:

系統級指標

? CPU使用率和Load Average

? 內存使用率和Swap使用情況

? 磁盤I/O(IOPS、吞吐量、延遲)

? 網絡流量和連接數

MySQL特定指標

? QPS(每秒查詢數)和TPS(每秒事務數)

? 慢查詢數量和比例

? 連接數和線程數

? InnoDB Buffer Pool命中率

? 鎖等待和死鎖次數

? 主從延遲(如果有主從架構)

4.2 使用Prometheus和Grafana構建監控平臺

Prometheus配合Grafana是目前最流行的開源監控方案。以下是快速搭建步驟:

安裝mysqld_exporter采集MySQL指標:

# 下載mysqld_exporter wget https://github.com/prometheus/mysqld_exporter/releases/download/v0.14.0/mysqld_exporter-0.14.0.linux-amd64.tar.gz # 創建MySQL監控用戶 CREATE USER'exporter'@'localhost'IDENTIFIED BY'password'; GRANT PROCESS, REPLICATION CLIENT, SELECT ON *.* TO'exporter'@'localhost'; # 啟動exporter ./mysqld_exporter --config.my-cnf=".my.cnf"

配置Prometheus采集數據:

# prometheus.yml

scrape_configs:

-job_name:'mysql'

static_configs:

-targets:['localhost:9104']

labels:

instance:'prod-mysql-01'

在Grafana中,我通常使用以下幾個核心Dashboard:

? MySQL Overview(Dashboard ID: 7362)

? MySQL Query Response Time(Dashboard ID: 11226)

? MySQL InnoDB Metrics(Dashboard ID: 7365)

4.3 設置合理的告警規則

告警規則的設置要遵循"不漏報、少誤報"的原則。以下是我常用的告警規則:

# Prometheus告警規則示例 groups: -name:mysql_alerts rules: -alert:MySQLDown expr:mysql_up==0 for:5m annotations: summary:"MySQL服務宕機" -alert:SlowQueries expr:rate(mysql_global_status_slow_queries[5m])>10 for:5m annotations: summary:"慢查詢數量過多" -alert:HighConnections expr:mysql_global_status_threads_connected/mysql_global_variables_max_connections>0.8 for:5m annotations: summary:"連接數接近上限" -alert:InnoDBBufferPoolHitRate expr:rate(mysql_global_status_innodb_buffer_pool_reads[5m])/rate(mysql_global_status_innodb_buffer_pool_read_requests[5m])>0.1 for:10m annotations: summary:"InnoDB緩沖池命中率過低"

五、真實案例分析

案例一:電商訂單查詢優化

問題描述:某電商平臺的訂單查詢接口響應時間達到15秒,嚴重影響用戶體驗。

問題SQL:

SELECT

o.*,

u.nameasuser_name,

p.nameasproduct_name

FROMorders o

LEFTJOINusers uONo.user_id=u.id

LEFTJOINorder_items oiONo.id=oi.order_id

LEFTJOINproducts pONoi.product_id=p.id

WHEREo.created_atBETWEEN'2024-01-01'AND'2024-12-31'

ANDo.statusIN('pending','processing','shipped')

ANDu.region='North'

ORDERBYo.created_atDESC

LIMIT20;

分析過程:

通過EXPLAIN發現:

1. orders表進行了全表掃描(type=ALL)

2. 沒有使用任何索引(key=NULL)

3. 預估掃描500萬行數據

優化方案:

1. 創建復合索引:

CREATEINDEX idx_orders_created_statusONorders(created_at, status); CREATEINDEX idx_users_regionONusers(region);

2. 改寫查詢,利用覆蓋索引:

SELECT

o.*,

u.nameasuser_name,

p.nameasproduct_name

FROM(

SELECTidFROMorders

WHEREcreated_atBETWEEN'2024-01-01'AND'2024-12-31'

ANDstatusIN('pending','processing','shipped')

ORDERBYcreated_atDESC

LIMIT20

)ASt

INNERJOINorders oONt.id=o.id

LEFTJOINusers uONo.user_id=u.idANDu.region='North'

LEFTJOINorder_items oiONo.id=oi.order_id

LEFTJOINproducts pONoi.product_id=p.id

ORDERBYo.created_atDESC;

優化結果:查詢時間從15秒降到0.2秒,性能提升75倍。

案例二:用戶積分統計優化

問題描述:用戶積分排行榜功能,每次查詢需要30秒以上。

問題SQL:

SELECT user_id, SUM(points)astotal_points, COUNT(*)astransaction_count FROMpoint_transactions WHEREcreated_at>=DATE_SUB(NOW(),INTERVAL30DAY) GROUPBYuser_id ORDERBYtotal_pointsDESC LIMIT100;

分析發現:

? point_transactions表有2億條記錄

? 每次查詢需要掃描3000萬條記錄進行聚合

優化方案:

1. 創建匯總表,使用定時任務維護:

CREATE TABLEuser_points_summary ( user_idINTPRIMARY KEY, total_pointsDECIMAL(10,2), transaction_countINT, last_30days_pointsDECIMAL(10,2), last_updatedTIMESTAMPDEFAULTCURRENT_TIMESTAMPONUPDATECURRENT_TIMESTAMP, INDEX idx_last30_points (last_30days_pointsDESC) ); -- 定時任務每小時更新一次 INSERT INTOuser_points_summary (user_id, last_30days_points, transaction_count) SELECT user_id, SUM(points), COUNT(*) FROMpoint_transactions WHEREcreated_at>=DATE_SUB(NOW(),INTERVAL30DAY) GROUPBYuser_id ONDUPLICATE KEYUPDATE last_30days_points=VALUES(last_30days_points), transaction_count=VALUES(transaction_count);

2. 查詢直接從匯總表獲取:

SELECT user_id, last_30days_pointsastotal_points, transaction_count FROMuser_points_summary ORDERBYlast_30days_pointsDESC LIMIT100;

優化結果:查詢時間從30秒降到0.01秒,性能提升3000倍。

六、性能優化的最佳實踐總結

6.1 建立性能基線

在進行任何優化之前,先建立性能基線非常重要。記錄以下關鍵指標的正常值:

? 平均QPS和峰值QPS

? 慢查詢比例(建議控制在0.1%以下)

? 平均響應時間和P95、P99響應時間

? Buffer Pool命中率(建議95%以上)

6.2 制定優化優先級

不是所有的慢查詢都需要立即優化。按照以下原則確定優先級:

1. 執行頻率 × 平均執行時間 = 總消耗時間,優先優化總消耗時間最大的

2. 影響核心業務流程的查詢優先級最高

3. 優化難度低但效果明顯的"速贏"項目優先處理

6.3 建立代碼審查機制

在代碼上線前進行SQL審查可以預防大部分性能問題:

? 所有新增SQL必須提供EXPLAIN輸出

? 禁止在生產環境使用SELECT *

? 大表的DDL操作必須使用pt-online-schema-change

? 批量操作必須分批進行,避免長時間鎖表

6.4 持續優化流程

性能優化不是一次性工作,需要建立持續優化的流程:

1. 每周分析慢查詢日志,識別新出現的慢查詢

2. 每月進行一次索引使用情況審計

3. 每季度評估是否需要分庫分表

4. 建立性能問題知識庫,避免重復踩坑

七、進階話題:應對超大規模數據

當單表數據量超過千萬級別時,傳統的優化方法可能不夠用了。這時需要考慮架構層面的優化。

7.1 分區表策略

對于歷史數據查詢不頻繁的場景,分區表是很好的選擇:

CREATE TABLEorders_partitioned ( idBIGINT, user_idINT, amountDECIMAL(10,2), created_at DATETIME, PRIMARY KEY(id, created_at) )PARTITIONBYRANGE(YEAR(created_at)) ( PARTITIONp2022VALUESLESS THAN (2023), PARTITIONp2023VALUESLESS THAN (2024), PARTITIONp2024VALUESLESS THAN (2025), PARTITIONp_futureVALUESLESS THAN MAXVALUE );

7.2 讀寫分離架構

通過主從復制實現讀寫分離,可以大幅提升系統的并發處理能力:

# 應用層讀寫分離示例

classDatabaseRouter:

def__init__(self):

self.master = connect_master()

self.slaves = [connect_slave1(), connect_slave2()]

defexecute_write(self, sql):

returnself.master.execute(sql)

defexecute_read(self, sql):

slave = random.choice(self.slaves)

returnslave.execute(sql)

7.3 分庫分表方案

當單庫容量達到瓶頸時,分庫分表是必然選擇。常見的分片策略包括:

? 按用戶ID取模分片

? 按時間范圍分片

? 按地理區域分片

? 一致性哈希分片

結語:持續學習與實踐

數據庫性能優化是一門需要不斷實踐和積累的技術。每個系統都有其特殊性,沒有放之四海而皆準的優化方案。作為運維工程師,我們需要:

1. 保持對新技術的敏感度,了解MySQL新版本的優化特性

2. 建立自己的問題案例庫,形成經驗積累

3. 與開發團隊緊密合作,從源頭預防性能問題

4. 定期參與技術交流,學習他人的優化經驗

記住,性能優化永無止境,但掌握了正確的方法論和工具,你就能夠從容應對各種挑戰。希望這篇文章能夠幫助你在數據庫優化的道路上走得更遠。

如果你覺得這篇文章對你有幫助,歡迎關注我的技術博客,我會定期分享更多運維實戰經驗和技術干貨。同時,也歡迎在評論區分享你遇到的數據庫性能問題,讓我們一起探討解決方案。

關于作者:資深運維工程師,10年數據庫運維經驗,曾負責多個千萬級用戶系統的數據庫架構設計與優化。擅長MySQL性能調優、高可用架構設計、自動化運維體系建設。

-

SQL

+關注

關注

1文章

803瀏覽量

46821 -

磁盤

+關注

關注

1文章

398瀏覽量

26544 -

數據庫

+關注

關注

7文章

4061瀏覽量

68445

原文標題:數據庫慢查詢分析與SQL優化實戰技巧:從入門到精通的性能調優指南

文章出處:【微信號:magedu-Linux,微信公眾號:馬哥Linux運維】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

SQL語言實現數據庫記錄的查詢

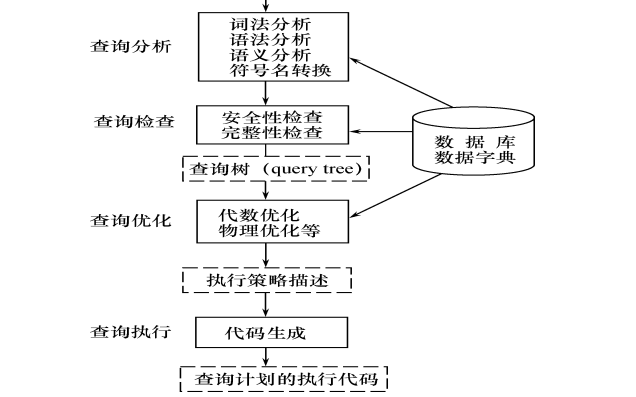

基于數據庫查詢過程優化設計

數據庫系統概論之如何進行關系查詢處理和查詢優化

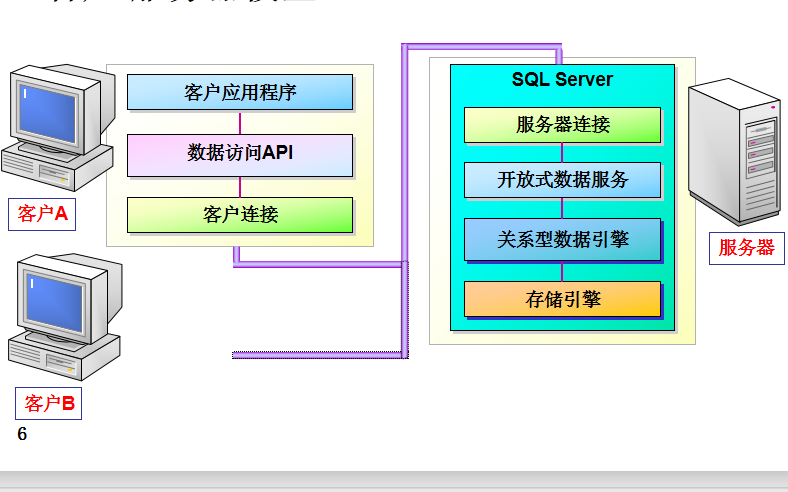

數據庫教程之SQL Server數據庫管理的詳細資料說明

數據庫:為什么SQL使用了索引,卻還是慢查詢?

數據庫慢查詢分析與SQL優化實戰技巧

數據庫慢查詢分析與SQL優化實戰技巧

評論