本文轉自:Coggle數據科學

Attention Is All You Need (2017)

由Google Brain的團隊撰寫,它徹底改變了自然語言處理(NLP)領域。論文的核心是提出了一種名為Transformer的全新模型架構,它完全舍棄了以往序列模型(如循環神經網絡 RNNs 和卷積神經網絡 CNNs)中常用的循環和卷積結構,而是完全依賴于“注意力機制”來處理序列數據。

以往的RNN模型必須按順序逐個處理序列中的詞語,這使得訓練過程難以并行化,尤其是在處理長序列時效率很低。Transformer通過引入注意力機制,允許模型一次性處理整個序列,極大地提高了訓練效率,使得處理超大規模的數據成為可能。

為了Transformer讓模型能從不同角度和層面捕捉詞語之間的關系,作者提出了多頭注意力。它相當于并行運行多個注意力機制,每個“頭”都專注于不同的表示子空間,最后將這些結果拼接起來,使模型能夠更全面地理解復雜的關系。

BERT: Bidirectional Encoder Representations (2018)

BERT(Bidirectional Encoder Representations from Transformers)是由Google在2018年推出的一個強大的語言表示模型。與之前的模型(如OpenAI GPT)不同,BERT的核心思想是通過雙向的上下文來學習語言表示。這意味著,在預訓練過程中,模型可以同時利用一個詞語的左側和右側的上下文信息,從而獲得更深層次、更全面的語言理解能力。

掩碼語言模型 (Masked Language Model, MLM) 為了實現雙向學習,BERT不像傳統的語言模型那樣從左到右或從右到左預測下一個詞。它從輸入文本中隨機遮蓋 (mask) 掉一部分詞(通常為15%),然后讓模型去預測這些被遮蓋的詞是什么。這個任務迫使模型必須同時理解一個詞的左側和右側的上下文,才能正確地推斷出被遮蓋的詞語。這解決了之前單向模型無法同時利用雙向信息的弊端。

下一句預測 (Next Sentence Prediction, NSP) 許多重要的下游任務(如問答和自然語言推斷)需要模型理解句子之間的關系。 為了解決這個問題,BERT被設計了一個下一句預測任務。在預訓練時,它輸入一對句子A和B,其中50%的B確實是A的下一句,而另外50%的B是從語料庫中隨機選取的。模型需要判斷B是否是A的真實下一句。這個任務幫助BERT學習到了句子層面的關系,使其在處理多個句子組成的任務時表現更佳。

BERT的架構基于Transformer的編碼器部分。它的雙向性使其能夠生成對上下文敏感的詞嵌入,這些嵌入在應用于下游任務時效果顯著。

- 統一的微調方法:BERT的另一個重要貢獻是其簡單的微調 (fine-tuning)范式。預訓練好的BERT模型可以通過在其頂層添加一個簡單的輸出層,然后用特定任務的少量標注數據進行端到端的微調,就能在廣泛的NLP任務(如問答、命名實體識別、文本分類等)上取得當時最先進的(state-of-the-art)表現。

- 深遠影響:BERT的出現為預訓練-微調的范式設定了新的標準,證明了雙向表示的強大能力。它被認為是NLP領域的一大里程碑,啟發了此后無數基于Transformer編碼器的大型模型,極大地推動了NLP技術的發展。

T5: Text-to-Text Transfer Transformer (2019)

T5(Text-to-Text Transfer Transformer)是Google于2019年提出的一個開創性模型。這篇論文的核心思想非常簡潔而強大:將所有的自然語言處理(NLP)任務都統一為一個“文本到文本”(text-to-text)問題。這意味著,無論是機器翻譯、文本摘要、問答,還是文本分類,所有任務都被重新表述為輸入一段文本,輸出另一段文本。

例如:

- 翻譯:輸入 “translate English to German: That is good.”,輸出 “Das ist gut.”。

- 文本分類:輸入 “cola sentence: The course is jumping well.”,輸出 “not acceptable”。

- 摘要:輸入 “summarize: [原文]”,輸出 “ [摘要]”。

T5將不同類型的NLP任務(如生成、分類、理解)轉換為統一的文本輸入和文本輸出格式是可行且有效的。這使得模型可以利用大規模無監督數據進行預訓練,并無縫地遷移到各種有監督的下游任務中,而無需對模型架構進行任何修改。

Retrieval-Augmented Generation (RAG) (2020)

RAG是一種結合了參數化記憶(parametric memory)和非參數化記憶(non-parametric memory)**的生成模型。它旨在解決傳統大型語言模型(LLMs)在處理知識密集型任務時存在的局限性,例如:

- 知識更新困難:模型參數中的知識是固定的,無法輕松更新。

- 容易“幻覺”:模型可能生成聽起來合理但實際上是錯誤的事實。

- 無法提供來源:模型無法解釋其生成內容的知識來源。

RAG模型由兩個主要組件組成,并且可以進行端到端的聯合訓練:

- 檢索器(Retriever):

- 這是一個基于BERT的雙編碼器模型,用于將輸入查詢(例如問題)和外部文檔(例如維基百科段落)都編碼成向量。

- 通過計算向量相似度,它能從一個大型的外部知識庫(非參數化記憶,如包含2100萬個文檔的維基百科向量索引)中快速檢索出與輸入最相關的K個文檔。

- 生成器(Generator):

- RAG-Sequence:為整個生成序列使用同一個檢索到的文檔。

- RAG-Token:在生成每個詞語時,都可以基于不同的檢索到的文檔。這種方法允許模型從多個來源拼湊信息,生成更復雜的答案。

- 這是一個基于BART的預訓練序列到序列(seq2seq)模型(即參數化記憶)。

- 它以輸入查詢和檢索到的文檔作為上下文,生成最終的答案或文本。

- 論文提出了兩種生成方式:

GPT-1: Generative Pre-Training (2018)

GPT-1由OpenAI于2018年發布,其核心思想是提出了一種半監督學習方法,用于解決自然語言處理(NLP)中有標簽數據稀缺的問題。該方法的核心是“預訓練-微調”(pre-training and fine-tuning)范式,即:

- 無監督預訓練:在一個大規模、未標注的文本語料庫上,用生成式語言模型任務來預訓練一個強大的通用語言模型。

- 有監督微調:將預訓練好的模型參數作為初始化,然后用少量有標簽的目標任務數據對其進行微調。

在預訓練階段,模型的目標是根據前面所有詞語來預測下一個詞語,這是一種生成式的、從左到右的建模方式。這種方法使得模型能夠學習到廣泛的語言知識和長距離依賴關系。

Transformer的自注意力機制使其能夠更有效地捕捉長距離的依賴關系,這對于理解復雜的文本至關重要,并為模型帶來了更強的泛化能力。

GPT-1通過在輸入端對不同任務(如自然語言推斷、問答等)進行統一的格式化,使得所有任務都可以使用相同的模型架構進行微調,無需對模型本身進行結構上的改變。這大大簡化了模型適配不同任務的復雜性。

GPT-2: Scaling Up (2019)

GPT-2的核心主張是:語言模型在進行大規模無監督預訓練后,能夠無需任何顯式監督或架構修改,就能執行多種多樣的下游任務。作者們認為,如果一個語言模型擁有足夠大的參數規模,并在一個足夠多樣化的高質量文本數據集上進行訓練,它會“自發地”學習如何執行這些任務,因為這些任務的示例(比如問答、翻譯等)自然存在于其訓練數據中。

語言模型本質上是無監督的多任務學習者。在預訓練過程中,模型為了更好地預測下一個詞,會隱式地學習到文本中存在的各種任務模式,例如:“翻譯法語:[英文]”后面跟著的往往是對應的法文翻譯。

GPT-3: Few-Shot Learning (2020)

GPT-3的核心觀點是:通過大幅增加語言模型的規模,可以使其在無需任何梯度更新或微調的情況下,僅憑少量示例(或甚至沒有示例)就能學會執行新任務。

論文提出,傳統的“預訓練-微調”范式雖然有效,但需要為每個新任務收集成千上萬的標注數據。GPT-3則展示了,當模型擁有1750億參數的巨大規模時,它能夠通過“上下文學習”(in-context learning),即在輸入的文本提示中直接給出任務指令和少量演示,就表現出強大的零樣本(zero-shot)、單樣本(one-shot)和少樣本(few-shot)學習能力,有時甚至能與經過微調的SOTA模型相媲美。

- 零樣本學習(Zero-shot):只給模型一個自然語言指令,不提供任何示例。例如:“將以下英文翻譯成法文:[英文]”。

- 單樣本學習(One-shot):提供一個任務示例和自然語言指令。例如:“將英文‘Hello’翻譯成法文‘Bonjour’。現在請翻譯‘Goodbye’。”

- 少樣本學習(Few-shot):提供多個任務示例和自然語言指令。

ChatGPT: Conversational Interface (2022)

ChatGPT 是 OpenAI 訓練的一款大型語言模型,專門設計用于通過對話進行交互。這種對話形式使其能夠:

- 回答后續問題。

- 承認并糾正自己的錯誤。

- 質疑不正確的前提。

- 拒絕不當或有害的請求。

ChatGPT 的訓練方法結合了監督學習和強化學習,這一過程被稱為人類反饋強化學習(RLHF):

- 監督微調:

- 首先,OpenAI 雇傭了人類 AI 訓練員。

- 這些訓練員扮演“用戶”和“AI 助手”的角色,編寫對話,并提供模型生成的建議作為參考,以創建高質量的對話數據集。

- 這個新的對話數據集與現有的 InstructGPT 數據集混合,用于訓練一個初始的 ChatGPT 模型。

- 強化學習:

- 為了訓練一個獎勵模型(Reward Model),OpenAI 收集了對比數據。

- AI 訓練員會評估模型為同一條提示生成的多個備選回復,并根據質量對其進行排序。

- 利用這些排序數據,訓練出了一個獎勵模型,該模型可以根據回復的質量給予分數。

- 最后,使用近端策略優化(PPO)算法,根據獎勵模型的分數對初始模型進行微調,以鼓勵其生成更高質量的回復。

GPT-4: Multimodal Capabilities (2023)

GPT-4是一個大規模、多模態的模型,能夠同時接受圖像和文本輸入,并生成文本輸出。盡管它在許多現實場景中仍不如人類,但在各種專業和學術基準測試中,GPT-4展現出了接近人類水平的性能。

GPT-4是OpenAI首個支持圖像輸入的模型。報告展示了GPT-4能夠理解圖像中的文本、圖表和幽默,并進行描述和回答相關問題。

GPT-4項目的一個核心挑戰是確保深度學習基礎設施能可預測地擴展。通過開發新的方法,OpenAI能夠使用比GPT-4訓練計算量少1000倍甚至10000倍的小型模型。

OpenAI Sora: World Simulation (2024)

- Diffusion-based video generation

- Physical world modeling from text descriptions

- Temporal consistency across long sequences

- Camera movement simulation

GPT-4o: Omni Model (2024)

- Real-time responsiveness

- Native audio input/output

- Improved vision capabilities

- Cost-efficient multimodal processing

Google's PaLM (2022)

PaLM(Pathways Language Model),一個擁有 5400億參數的巨型語言模型。PaLM 的訓練采用了谷歌的新型機器學習系統 Pathways,這使得在數千個加速器芯片上進行高效訓練成為可能。

結合“鏈式思考”提示技術(即模型先生成逐步推理過程,再給出最終答案),PaLM 在多步推理任務上的表現超越了許多經過微調的SOTA模型,展示了其強大的推理能力。

Switch Transformer (MoE) (2021)

Switch Transformer基于“專家混合”(Mixture-of-Experts, MoE)架構的Transformer模型。與傳統模型為所有輸入重用相同參數不同,MoE模型會為每個輸入動態選擇不同的參數子集。

- 巨大的參數規模(最高可達萬億參數)。

- 恒定的計算成本:由于每次只激活部分參數,計算量與一個更小的“密集”模型相當。

- 顯著的訓練加速:能夠比相同計算成本的密集模型(如T5-Base)快7倍以上。

Meta's OPT: First Major Open Model (2022)

Open Pre-trained Transformers (OPT)是一個由 Meta AI 訓練和發布的一系列語言模型,參數量從1.25億到1750億不等。該項目的目標是開放和負責任地與研究社區共享這些模型,以促進對大型語言模型(LLMs)的深入研究,特別是在魯棒性、偏見和毒性等關鍵挑戰上。

由于使用了最新的NVIDIA A100 GPU以及高效的訓練策略,OPT-175B 的開發所耗費的碳足跡僅為 GPT-3 的七分之一。

LLaMA 1: Meta's Open Research LLM (2023)

LLaMA是一個由 Meta AI 訓練和發布的系列基礎語言模型,參數量從70億到650億不等。該研究的核心論點是,通過在更多的數據上訓練更小的模型,可以在相同的計算預算下實現與更大模型(如PaLM-540B或GPT-3)相當甚至更優的性能。

與之前的大型模型(如GPT-3、PaLM)不同,LLaMA系列模型完全使用公開可用的數據集進行訓練,這使其可以完全開放給研究社區,從而推動該領域的民主化。

Stanford Alpaca (2023)

Alpaca 7B是一個在LLaMA 7B模型基礎上,通過在5.2萬條指令遵循數據上進行微調而得到的模型。其主要貢獻在于,Alpaca 在指令遵循能力上定性地類似于當時最先進的閉源模型OpenAI 的text-davinci-003,但它的模型規模非常小,且訓練成本極低(不到600美元),使其可以被學術界輕松復現。

訓練 Alpaca 7B 的總成本低于600美元,其中數據生成成本不到500美元(通過調用OpenAI API),模型微調成本不到100美元。

LLaMA 2: Commercial Open-Source (2023)

Llama 2,一個由 Meta AI 開發和發布的新一代大型語言模型系列。該系列包括了預訓練模型 Llama 2和經過微調的聊天模型 Llama 2-Chat,參數規模從70億到700億不等。該論文的核心貢獻在于:

發布強大的、可商用的模型:Llama 2-Chat 在大多數基準測試中表現優于其他開源聊天模型,并且通過人類評估,其能力足以與一些閉源模型(如 ChatGPT)相媲美。

詳細公開其微調和安全對齊方法:論文詳細闡述了如何通過監督式微調(SFT)和人類反饋強化學習(RLHF)來將基礎模型轉化為一個有用的、安全的聊天助手。這種開放性旨在讓研究社區能夠在此基礎上繼續研究和改進大型語言模型。

LLaMA 3: Continued Scaling (2024)

Meta Llama 3 是 Meta 推出的新一代開源大型語言模型。此次發布的初始版本包含兩個模型:8B 和 70B 參數,旨在支持廣泛的應用場景。Meta 宣稱,這些模型是同類中能力最強的開源模型,足以與領先的閉源模型(如 Claude Sonnet 和 GPT-3.5)競爭。一個更大的 400B 參數模型目前仍在訓練中,未來計劃增加多模態、多語言支持等新功能。

LLaMA 4: Mixture-of-Experts (2025)

與前代不同,Llama 4 是 Meta 首個采用專家混合架構(Mixture-of-Experts, MoE)**并原生支持**多模態功能的模型。

此次發布了兩個高效模型:

- Llama 4 Scout: 擁有170億活躍參數和16個專家,能適配單張 NVIDIA H100 GPU,并擁有業內領先的1000萬tokens超長上下文窗口。它在長文檔分析、代碼庫推理等任務上表現出色。

- Llama 4 Maverick: 擁有170億活躍參數和128個專家,盡管總參數達4000億,但其高效率帶來了卓越的性能成本比。它在圖像和文本理解方面表現突出,在通用助理和聊天場景中堪稱“主力”。

-

人工智能

+關注

關注

1817文章

50093瀏覽量

265251 -

自然語言處理

+關注

關注

1文章

630瀏覽量

14665 -

大模型

+關注

關注

2文章

3647瀏覽量

5176

發布評論請先 登錄

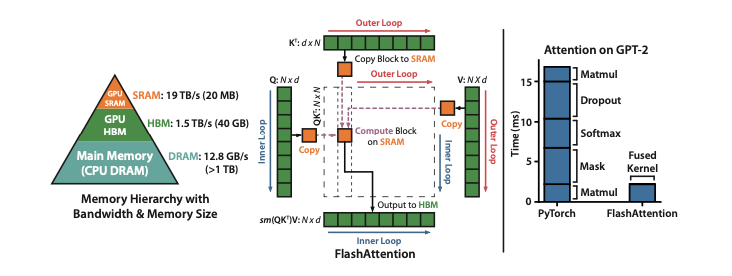

小白學大模型:大模型加速的秘密 FlashAttention 1/2/3

大模型在半導體行業的應用可行性分析

FA模型卡片和Stage模型卡片切換

FA模型和Stage模型API切換概述

從FA模型切換到Stage模型時:module的切換說明

FA模型綁定Stage模型ServiceExtensionAbility介紹

FA模型訪問Stage模型DataShareExtensionAbility說明

Stage模型啟動FA模型PageAbility方法

如何將一個FA模型開發的聲明式范式應用切換到Stage模型

小白學大模型:從零實現 LLM語言模型

小白學大模型:國外主流大模型匯總

小白學大模型:國外主流大模型匯總

評論