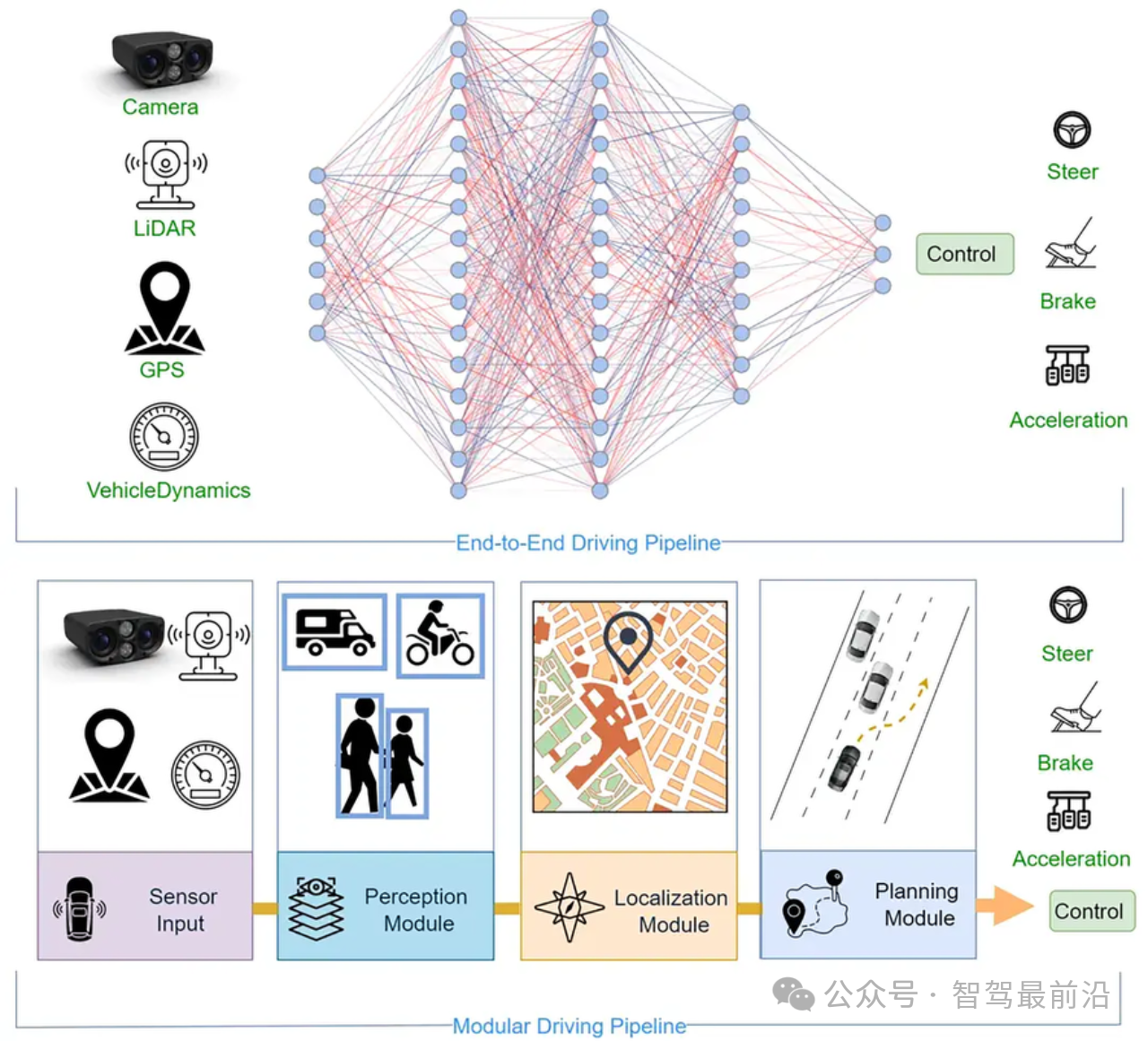

[首發于智駕最前沿微信公眾號]端到端(end-to-end)自動駕駛聽起來很厲害,把車載攝像頭、雷達、激光雷達等傳感器的原始數據直接喂給一個大網絡,網絡輸出方向盤轉角、加速度、剎車力度,省去了“感知—定位—預測—規劃—控制”那一長串模塊化步驟。從概念上來看,這是把整條決策鏈用一個函數逼近了,讓機器“直接學會開車”。但正因為把所有東西都塞進一個大模型里,端到端系統很容易表現出所謂的“黑盒”特性,即我們知道輸入和輸出,但不知道中間發生了什么,無法用傳統工程手段去解釋、驗證和控制其內部決策過程。

黑盒效應的影響及來源

先說為什么端到端“黑盒”是個問題。汽車是高風險系統,任何錯誤都有可能導致財產損失甚至人員傷亡。傳統自動駕駛把功能拆成一系列明確接口的模塊,每個模塊都有可測的性能指標(比如目標檢測的精度、定位的可用性、軌跡規劃的最小安全距離)。當出問題時,工程師可以定位到哪個模塊、哪個環節失效,進而修補或替換。而端到端模型把這些環節融在一張大網絡里,內部表示是高維的、分布式的向量,單看這些向量我們幾乎不能直接理解“它代表什么”。這將帶來幾個直接風險,第一,難以做形式化驗證或證明其滿足某些安全邊界;第二,難以解釋在特定場景下為什么會產生某個危險決策,影響責任追責和事故分析;第三,因為模型不是用規則表達安全約束,而是用統計學規律“記住”如何做,因此對未見過的場景和分布外數據更加脆弱;第四,調試困難,無法定位到某個輸入特征、某個子任務或某組數據導致錯誤,從而延長問題修復時間與迭代成本。

那黑盒從哪來?黑盒效應源于幾個核心要素的疊加。深度神經網絡本質上是高度非線性的函數逼近器,它會在參數空間中學習對訓練數據的復雜映射。網絡的中間層往往會形成抽象的、高維的語義或統計表示,這些表示沒有默認的、可解釋的語義標注。再加上端到端訓練常用的監督學習或基于回報的優化(行為克隆、逆強化學習、強化學習等),模型學習目標往往是直接最小化某個端到端損失(比如軌跡誤差或駕駛行為的分布差異),而不是學習明確的物理、因果規律。數據也是導致黑盒的關鍵因素,訓練數據的分布決定了模型行為,長尾事件稀少、標注噪聲或偏差都會在模型內部產生脆弱點。此外,模型訓練過程中的過擬合、欠擬合、以及優化器的局部極值也可能把錯誤策略“寫入”網絡。黑盒在工程實踐中也會被強化,在實際車隊迭代中,為了性能和上線速度,工程師常常會用更大網絡、更復雜的輸入變換,卻沒有同步提升可解釋性和監測能力,從而埋下問題。

如何緩解黑盒效應?

既然明白了問題,接下來最核心的問題是,如何避免或至少大幅緩解端到端自動駕駛的黑盒效應?這里的答案不是一句話能講完,而是需要一套工程和研究結合的防護線,即把風險分層、用不同策略逐層抵御。總體上可以把策略分為三類,架構與產品設計層面的選擇、訓練與數據層面的約束、以及運行時的監控與冗余保障。

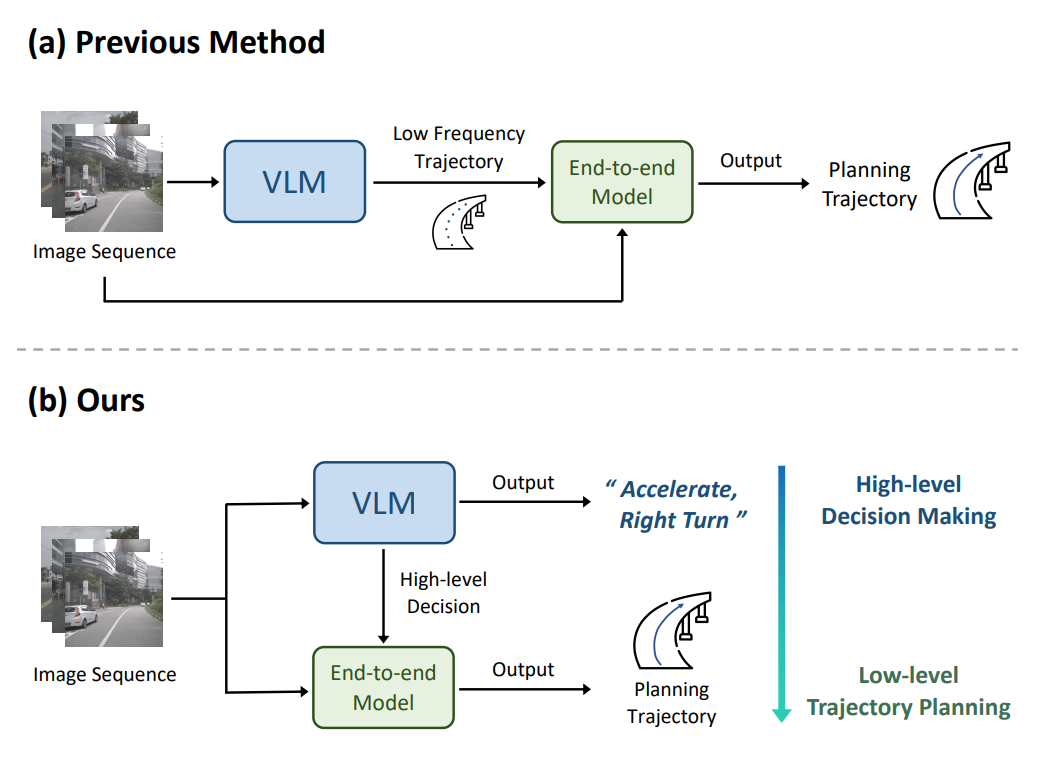

在架構層面,最實用的思路是“不過度單一化”,也就是說把端到端變成“可解釋的端到端”或“混合架構”。一種常見做法是引入可解釋的中間瓶頸(concept bottleneck),網絡在內部顯式預測一些比如車道線、行人位置、交通信號狀態、預測的其他車輛意圖、道路幾何等可讀的語義量,然后把這些語義特征作為后續決策網絡的輸入。這樣做一方面保留了端到端學習的優勢(從原始感知到決策的聯合優化),另一方面還保留了模塊化的可觀測接口,便于驗證與調試。另外一種做法是“分層端到端”或“模塊化增強的端到端”,即把系統按功能切分,感知采用傳統或可解釋的模型輸出高可信的環境表示,規劃或策略部分用學習方法來優化舒適性與效率,同時保留獨立的安全濾波器或規則化控制器來保證基本碰撞與邊界條件不被觸犯。換句話說,關鍵決策的最后一道防線最好是確定性的或可驗證的,而不是把關鍵安全約束完全交給單一黑盒網絡。

訓練與數據層面則有一整套可操作措施。訓練數據必須有針對性的長尾覆蓋,不能只靠大量城市高速的“常見場景”來訓練。要有系統的稀有事件采集和增強策略,這其中就包括利用仿真環境合成緊急制動、復雜交叉口、異常車輛行為等場景,并通過domain randomization降低模型對數據表面統計的依賴。此外,數據標注也要細致且一致,必要時引入多層級標簽(既有低層像素級或目標級標注,也有高層語義意圖標注)以支持可解釋性技術。在訓練方法上,除了純行為克隆,還要混合使用帶有安全約束的強化學習、逆向強化學習與逆向工程學派的方法,從而確保策略在優化效率的同時對安全損失有明確懲罰。另一個關鍵點是對抗性訓練和應變訓練,可以故意讓模型見到被擾動或異常的輸入(如傳感器噪聲、局部遮擋、惡劣天氣),提升魯棒性。同時應當使用模型校準技術,確保輸出概率與真實不確定性一致,為后續的運行時決策提供可靠的置信度信息。

可解釋性(explainability)工具并非只是學術玩具,它們在工程實踐中能帶來直接價值。常見的技術包括梯度或激活圖分析(如Integrated Gradients、Grad-CAM等),概念激活向量(TCAV)把內部表示與語義概念關聯,局部可解釋模型(LIME/SHAP)可以在單個決策上生成近似可解釋的局部規則。這些工具能夠在事故復盤或在線監控時指出模型“可能關注到了什么”或“忽略了什么”。當然這些方法不是萬靈藥,它們也有局限性,但結合中間可觀測變量與單案例的可解釋工具,可以顯著提升工程師對問題的可追溯性。此外,開發團隊應當把可解釋性結果標準化納入回歸測試,每次模型迭代,不只是看性能提升,還要看解釋圖譜是否出現異常或偏移。

不確定性估計和異常檢測是緩解黑盒最實用的手段之一。神經網絡可以輸出一條動作,但也應當伴隨一個置信度指標。常見方法包括貝葉斯近似(例如MC Dropout)、深度集成(deep ensembles)、溫度縮放后的概率校準、以及基于模型外檢測(OOD detectors)的方案。基于輸入分布的檢測器可以在識別到分布外樣本時觸發安全策略,例如降級到保守策略、請求遠程人工干預或者按預設做最小風險動作(如緩慢停車并開啟危險燈)。實現這些方法還需要維護輸入特征分布的在線統計,并設定合理的閾值與報警策略。需要強調的是,不確定性估計并非完美,它可能在某些不可預見的敵對場景下失敗,因此應與其他冗余機制配合使用。

運行時的冗余與監控策略直接決定了端到端系統能否安全落地。冗余體現在傳感方面(攝像頭+雷達+激光雷達+慣導的多傳感器融合),也體現在算法層面(不同架構、不同訓練數據和不同損失函數的模型并行運行形成仲裁機制)。當主模型和備份模型產生顯著分歧時,系統應及時警報并切換到安全模式。監控不僅是對模型輸出的監測,也應當包含對中間表示的分布監測、對輸入數據完整性的檢測與對車輛執行狀態的反饋閉環。良好的日志系統是調試黑盒不可或缺的工具,每次決策應記錄傳感器原始數據、內部表示摘要、置信度、候選動作以及最終執行結果,這樣在事故調查與回歸測試時才有可追溯的數據鏈。

在驗證與測試方面,端到端帶來的挑戰是傳統證明方法難以直接套用,但這并不意味著無法驗證。我們需要構建“場景驅動”的驗證體系,把驗證目標映射到大量合成與現實的場景覆蓋指標上。場景可以按危險程度、罕見程度或復雜性分層,并通過組合生成法放大長尾。閉環仿真(在仿真中把車當做閉環被控對象,而非只做感知評估)是關鍵,因為端到端系統的錯誤往往是閉環交互導致的連鎖反應。結合現實世界的shadow mode(影子模式)運行,即在真實車輛上實時運行模型但不影響控制,僅記錄模型輸出與真實司機行為差別,這樣就可以在不承擔風險的情況下大規模驗證模型對現實復雜性的適應度。除此之外,還應采用更系統的攻擊性測試(fuzzing、對抗擾動、合成錯誤標注等)來找出模型的薄弱點。

當然,也可以給端到端系統建立一個“安全外殼”,在模型輸出與車輛控制之間放置一層輕量級的傳統控制器或規則引擎,專門負責執行硬約束(例如最大橫向加速度、最小跟車間距、碰撞預警和緊急制動觸發),且該控制器應當是無需大量學習即可通過理論或經驗保證其穩定性的。這種做法可以讓學習系統負責“性能優化與舒適性決策”,而把“安全邊界”留給可證明或可測的組件。類似的概念在航空、核電等高安全行業也常見,叫作運行時保證(runtime assurance)或安全監護(safety cage)。

其實不要低估人機交互與ODD(Operational Design Domain,運行設計域)界定的重要性。端到端技術目前在受限、結構化的環境(比如限定道路、限定速度、白天車輛)上比在開放、復雜的城市街道上成熟得多。明確ODD并嚴格遵守,是規避黑盒風險的有效手段。如果把端到端模型僅用于ODD內部,且設計清晰的退化策略(例如在光照差、雨雪或復雜交叉口外切換到人工或保守規則),系統整體風險會大大降低。對人機交互也要有明確策略:當系統需要人工接管時,必須保證接管通知明確、響應時間合理,并有駕駛員狀態監控(DMS)作為保障。

最后的話

端到端自動駕駛的黑盒效應是技術挑戰也是工程挑戰,但并非不可克服。關鍵在于不要把“端到端”當作把所有東西一次性扔給網絡的借口,而要把它作為工具,用在合適的環節并配以必要的可解釋性、中間約束、冗余檢測與運行時保證。技術發展不會停,方法也在進步。未來可解釋性的研究、基于因果推斷的學習、可證明的神經網絡子結構,都會繼續縮小黑盒與可驗證性之間的差距。但在技術足夠成熟之前,謹慎的架構設計、周到的數據策略、嚴格的運行保障與透明的治理體系,才是把端到端自動駕駛安全落地的現實路徑。

審核編輯 黃宇

-

端到端

+關注

關注

0文章

49瀏覽量

10833 -

自動駕駛

+關注

關注

793文章

14879瀏覽量

179775

發布評論請先 登錄

端到端自動駕駛到底是什么?

理想汽車加速自動駕駛布局,成立“端到端”實體組織

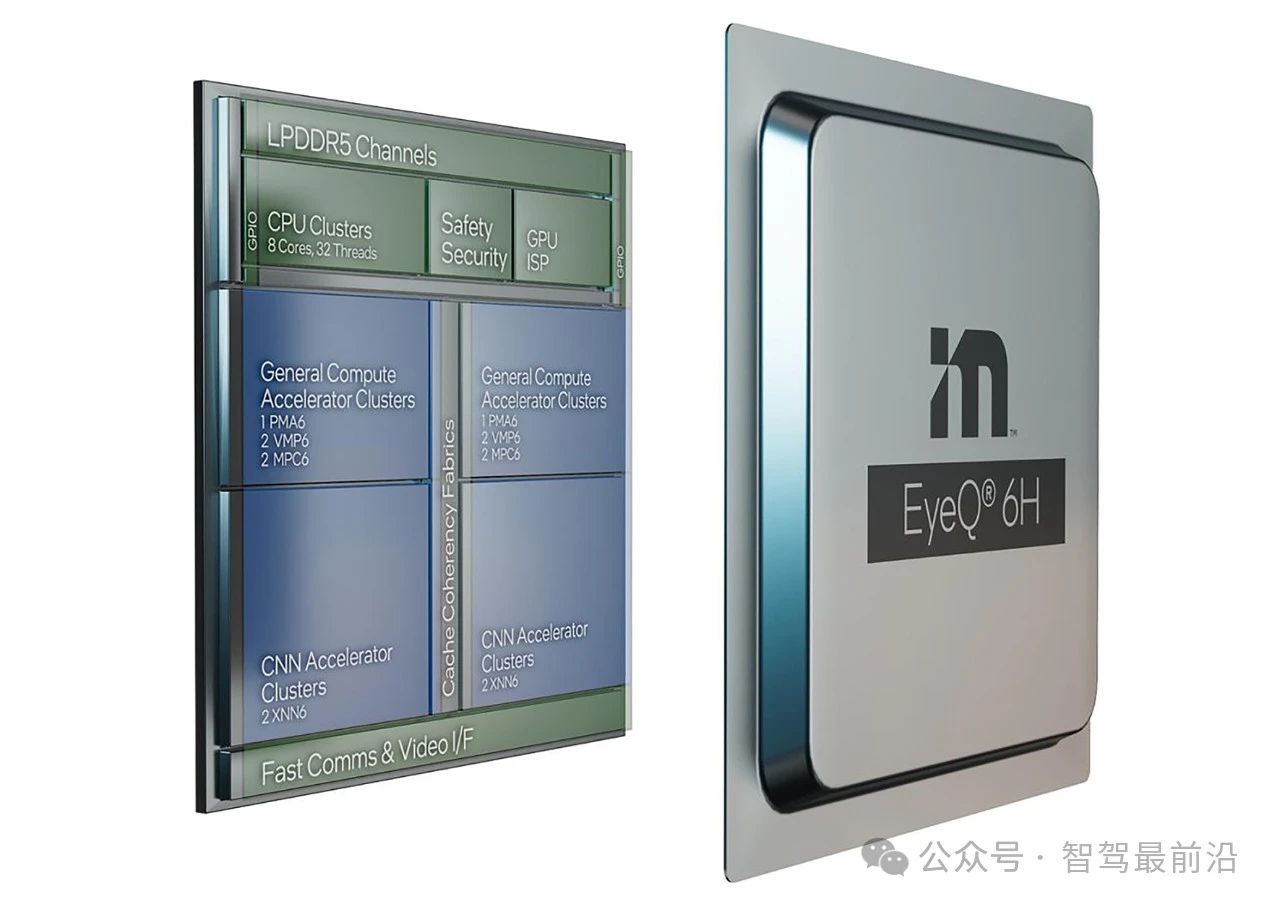

Mobileye端到端自動駕駛解決方案的深度解析

端到端自動駕駛技術研究與分析

Nullmax端到端自動駕駛最新研究成果入選ICCV 2025

端到端自動駕駛相較傳統自動駕駛到底有何提升?

自動駕駛端到端為什么會有黑盒特性?

自動駕駛端到端為什么會有黑盒特性?

評論