強(qiáng)化學(xué)習(xí)在當(dāng)今世界可謂是日漸流行,讓我們來(lái)看一看關(guān)于強(qiáng)化學(xué)習(xí)你不得不知道的5件事。

強(qiáng)化學(xué)習(xí)是當(dāng)今社會(huì)最熱門(mén)的研究課題之一,而且其熱度正與日俱增。讓我們一起來(lái)學(xué)習(xí)下關(guān)于強(qiáng)化學(xué)習(xí)的5個(gè)有用知識(shí)點(diǎn)。

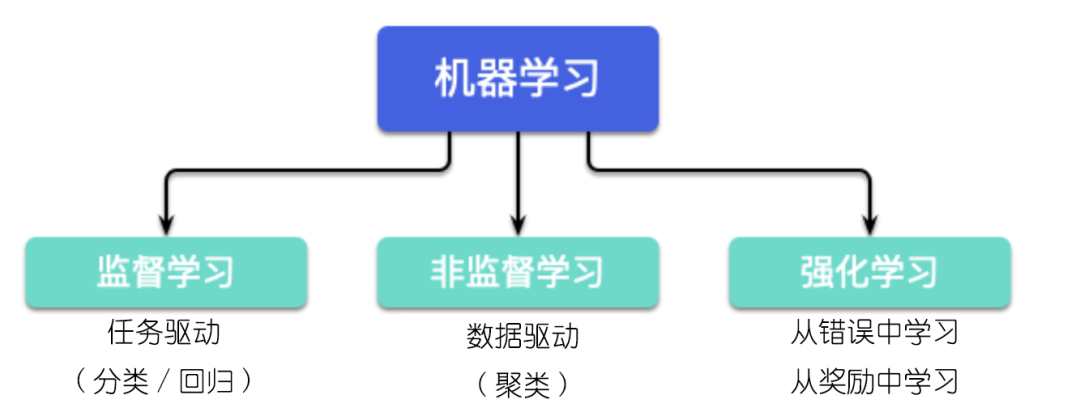

▌1.強(qiáng)化學(xué)習(xí)究竟是什么?它與機(jī)器學(xué)習(xí)技術(shù)有什么聯(lián)系?

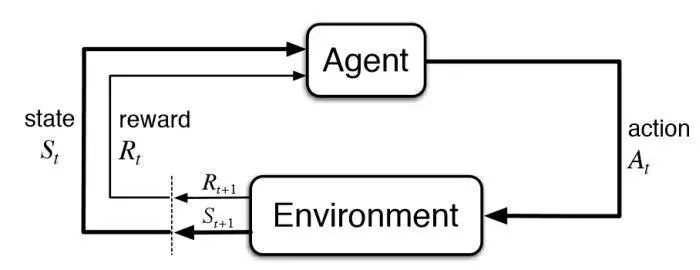

強(qiáng)化學(xué)習(xí)(Reinforcement Learning)是機(jī)器學(xué)習(xí)的一個(gè)分支,它的原理是:在交互環(huán)境中,智能體利用自身的經(jīng)驗(yàn)和反饋,通過(guò)試驗(yàn)和錯(cuò)誤經(jīng)驗(yàn)來(lái)進(jìn)行學(xué)習(xí)。

有監(jiān)督學(xué)習(xí)和強(qiáng)化學(xué)習(xí)都會(huì)明確指出輸入和輸出之間的映射關(guān)系,但不同點(diǎn)在于,有監(jiān)督學(xué)習(xí)給智能體的反饋是執(zhí)行正確任務(wù)的行為集合,而強(qiáng)化學(xué)習(xí)反饋的則將獎(jiǎng)勵(lì)和懲罰轉(zhuǎn)為積極和消極行為的信號(hào)進(jìn)行反饋。

對(duì)于無(wú)監(jiān)督學(xué)習(xí),強(qiáng)化學(xué)習(xí)的目標(biāo)顯得更加難以實(shí)現(xiàn)。無(wú)監(jiān)督學(xué)習(xí)的目標(biāo)僅僅是找到數(shù)據(jù)之間的相似和不同,而強(qiáng)化學(xué)習(xí)的目標(biāo)卻是找到一個(gè)能最大化智能體總累計(jì)獎(jiǎng)勵(lì)的模型。

強(qiáng)化學(xué)習(xí)模型中涉及的基本思想和元素見(jiàn)下圖:

▌2.如何確定一個(gè)基本的強(qiáng)化學(xué)習(xí)問(wèn)題?

描述強(qiáng)化學(xué)習(xí)問(wèn)題的幾個(gè)關(guān)鍵元素是:

環(huán)境:智能體所處的物理世界;

狀態(tài):智能體目前的狀態(tài);

獎(jiǎng)勵(lì):從環(huán)境中得到的反饋;

方案:將智能體狀態(tài)映射到行動(dòng)的方法;

價(jià)值:智能體在特定狀態(tài)下執(zhí)行某項(xiàng)行動(dòng)獲取未來(lái)的獎(jiǎng)勵(lì)。

一些游戲可以幫助我們很好的理解強(qiáng)化學(xué)習(xí)問(wèn)題。以PacMan游戲?yàn)槔涸谶@個(gè)游戲中,智能體(PacMan)的目標(biāo)就是在避免與鬼相遇的情況下,盡量在網(wǎng)格中吃到更多的豆子。網(wǎng)格世界就是智能體的交互環(huán)境,如果PacMan吃到了豆子就接受獎(jiǎng)勵(lì),如果被鬼殺死了(游戲結(jié)束)就接受懲罰。在該游戲中,“狀態(tài)”就是PacMan在網(wǎng)格中的各個(gè)位置,而總累計(jì)獎(jiǎng)勵(lì)就是贏得比賽的勝利。

為了得到最優(yōu)的方案,智能體既需要探索新的狀態(tài),又要同時(shí)盡量取得最多的獎(jiǎng)勵(lì)。這就是所謂的“探測(cè)與開(kāi)采的權(quán)衡”問(wèn)題。

馬爾可夫決策過(guò)程(MDP)是所有強(qiáng)化學(xué)習(xí)環(huán)境的數(shù)學(xué)框架,幾乎所有強(qiáng)化學(xué)習(xí)問(wèn)題都可以使用MDP來(lái)搭建模型。一個(gè)MDP過(guò)程包含一個(gè)環(huán)境集合(S),每個(gè)狀態(tài)中包含一個(gè)可能的行動(dòng)集合(A),還包含一個(gè)實(shí)值獎(jiǎng)勵(lì)函數(shù)R(s)和一個(gè)轉(zhuǎn)移矩陣P(s',s | a)。不過(guò),現(xiàn)實(shí)世界的環(huán)境中,環(huán)境動(dòng)態(tài)的先驗(yàn)信息可能是未知的,在這種情況下,運(yùn)用“不理解環(huán)境強(qiáng)化學(xué)習(xí)”算法(model-free RL)去進(jìn)行預(yù)測(cè)會(huì)更加方便、好用。

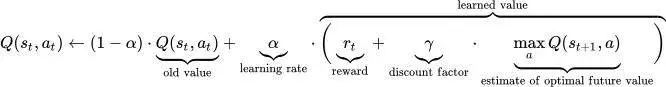

Q-learning模型就是一種應(yīng)用廣泛的不理解環(huán)境強(qiáng)化學(xué)習(xí)模型,因此可以用它來(lái)模擬PacMan智能體。Q-learning模型的規(guī)則是,在狀態(tài)S下執(zhí)行行動(dòng)a,不停更新Q值,而迭代更新變量值算法就是該算法的核心。

Figure 2: Reinforcement Learning Update Rule

這是利用一個(gè)深度強(qiáng)化學(xué)習(xí)實(shí)現(xiàn)PacMan游戲的視頻:

https://www.youtube.com/watch?v=QilHGSYbjDQ

▌3.最常用的深度學(xué)習(xí)算法原理是什么?

Q-learning和SARSA是兩種最常見(jiàn)的不理解環(huán)境強(qiáng)化學(xué)習(xí)算法,這兩者的探索原理不同,但是開(kāi)發(fā)原理是相似的。Q-learning是一種離線(xiàn)學(xué)習(xí)算法,智能體需要從另一項(xiàng)方案中學(xué)習(xí)到行為a*的價(jià)值;SARSA則是一種在線(xiàn)學(xué)習(xí)算法,智能體可從現(xiàn)有方案指定的當(dāng)前行為來(lái)學(xué)習(xí)價(jià)值。這兩種方法都很容易實(shí)現(xiàn),但缺乏一般性,因?yàn)樗鼈儫o(wú)法預(yù)估未知狀態(tài)的值。

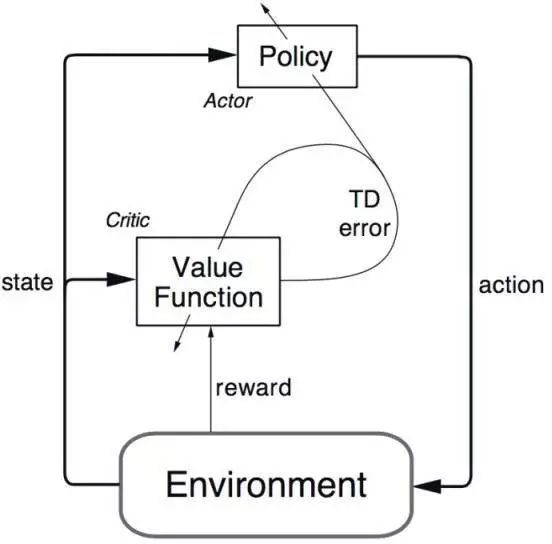

一些更加高級(jí)的算法可以克服這個(gè)問(wèn)題,如:Deep Q-Networks(其原理為利用神經(jīng)網(wǎng)絡(luò)來(lái)估計(jì)Q值)算法,但DQN算法只能應(yīng)用在離散的低維動(dòng)作空間中;DDPG(深度確定性策略梯度算法)則是一個(gè)理解環(huán)境的、在線(xiàn)的算法,它基于行動(dòng)者-評(píng)論家(Actor-Critic,AC)框架,可用于解決連續(xù)動(dòng)作空間上的深度強(qiáng)化學(xué)習(xí)問(wèn)題。

▌4.強(qiáng)化學(xué)習(xí)有哪些實(shí)際應(yīng)用?

由于強(qiáng)化學(xué)習(xí)需要大量的數(shù)據(jù),因此它最適用于模擬數(shù)據(jù)領(lǐng)域,如游戲、機(jī)器人等。

強(qiáng)化學(xué)習(xí)廣泛應(yīng)用于設(shè)計(jì)游戲中的AI玩家。AlphaGo Zero在傳統(tǒng)中國(guó)游戲圍棋中打敗了世界冠軍,這是AI第一次擊敗現(xiàn)實(shí)中的世界冠軍。AI還在ATARI游戲、西洋雙陸棋等游戲中有出色的表現(xiàn)。

機(jī)器人和工業(yè)自動(dòng)化領(lǐng)域中,深度學(xué)習(xí)也被廣泛應(yīng)用,機(jī)器人能夠?yàn)樽约捍罱ㄒ粋€(gè)高效的自適應(yīng)控制系統(tǒng),從而學(xué)習(xí)自己的經(jīng)驗(yàn)和行為。DeepMind關(guān)于“帶有異步策略更新的機(jī)器人操縱的深度強(qiáng)化學(xué)習(xí)”就是一個(gè)很好的例子。

觀看這個(gè)有趣的演示視頻video(https://www.youtube.com/watch?v=ZhsEKTo7V04&t=48s)

強(qiáng)化學(xué)習(xí)的其他應(yīng)用包括:文本摘要引擎、從用戶(hù)交互中學(xué)習(xí)并隨時(shí)間改進(jìn)的(文本、語(yǔ)音)對(duì)話(huà)代理、醫(yī)療保健領(lǐng)域的最優(yōu)治療政策、基于強(qiáng)化學(xué)習(xí)的在線(xiàn)股票交易代理。

▌5.我該如何開(kāi)始強(qiáng)化學(xué)習(xí)?

讀者可以從以下鏈接中了解更多關(guān)于強(qiáng)化學(xué)習(xí)的基本概念:

《Reinforcement Learning-An Introduction》——本書(shū)由強(qiáng)化學(xué)習(xí)之父Richard Sutton和他的博士生導(dǎo)師Andrew Barto共同撰寫(xiě)。該書(shū)的電子版以在http://incompleteideas.net/book/the-book-2nd.html找到。

由David Silver提供的Teaching material視頻課程可供讀者很好的了解強(qiáng)化學(xué)習(xí)的基礎(chǔ)課程:http://www0.cs.ucl.ac.uk/staff/d.silver/web/Teaching.html

Pieter Abbeel和John Schulman的視頻technical tutoria也是不錯(cuò)的學(xué)習(xí)資料:http://people.eecs.berkeley.edu/~pabbeel/nips-tutorial-policy-optimization-Schulman-Abbeel.pdf

開(kāi)始構(gòu)建和測(cè)試RL代理

若想要開(kāi)始學(xué)習(xí)搭建和測(cè)試強(qiáng)化學(xué)習(xí)的智能體,Andrej Karpathy的博客This blog中詳細(xì)講述了如何用原始像素的策略梯度來(lái)訓(xùn)練神經(jīng)網(wǎng)絡(luò)ATARI Pong智能體,并提供了130行Python代碼來(lái)幫助你建立你的第一個(gè)強(qiáng)化學(xué)習(xí)智能體:http://karpathy.github.io/2016/05/31/rl/

DeepMind Lab是一個(gè)開(kāi)源的3D游戲式平臺(tái),它為機(jī)遇智能體可以的人工智能研究提供豐富的模擬環(huán)境。

Project Malmo是另一個(gè)提供基礎(chǔ)AI研究的在線(xiàn)平臺(tái):https://www.microsoft.com/en-us/research/project/project-malmo/

OpenAI gym則是一個(gè)用于構(gòu)建和比較強(qiáng)化學(xué)習(xí)算法的工具包:https://gym.openai.com/

-

機(jī)器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8553瀏覽量

136954 -

強(qiáng)化學(xué)習(xí)

+關(guān)注

關(guān)注

4文章

270瀏覽量

11970

原文標(biāo)題:關(guān)于強(qiáng)化學(xué)習(xí)你不得不知道的5件事

文章出處:【微信號(hào):AI_Thinker,微信公眾號(hào):人工智能頭條】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

深度強(qiáng)化學(xué)習(xí)實(shí)戰(zhàn)

那uMCP究竟是什么?它與eMCP有什么聯(lián)系?

將深度學(xué)習(xí)和強(qiáng)化學(xué)習(xí)相結(jié)合的深度強(qiáng)化學(xué)習(xí)DRL

強(qiáng)化學(xué)習(xí)新方法,機(jī)器人究竟是怎么學(xué)習(xí)新動(dòng)作的呢?

人工智能機(jī)器學(xué)習(xí)之強(qiáng)化學(xué)習(xí)

什么是強(qiáng)化學(xué)習(xí)?純強(qiáng)化學(xué)習(xí)有意義嗎?強(qiáng)化學(xué)習(xí)有什么的致命缺陷?

一文詳談機(jī)器學(xué)習(xí)的強(qiáng)化學(xué)習(xí)

機(jī)器學(xué)習(xí)中的無(wú)模型強(qiáng)化學(xué)習(xí)算法及研究綜述

什么是強(qiáng)化學(xué)習(xí)

如何使用 PyTorch 進(jìn)行強(qiáng)化學(xué)習(xí)

強(qiáng)化學(xué)習(xí)會(huì)讓自動(dòng)駕駛模型學(xué)習(xí)更快嗎?

強(qiáng)化學(xué)習(xí)究竟是什么?它與機(jī)器學(xué)習(xí)技術(shù)有什么聯(lián)系?

強(qiáng)化學(xué)習(xí)究竟是什么?它與機(jī)器學(xué)習(xí)技術(shù)有什么聯(lián)系?

評(píng)論