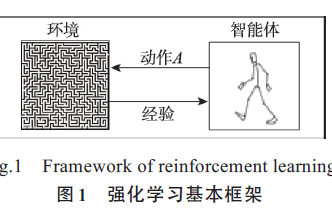

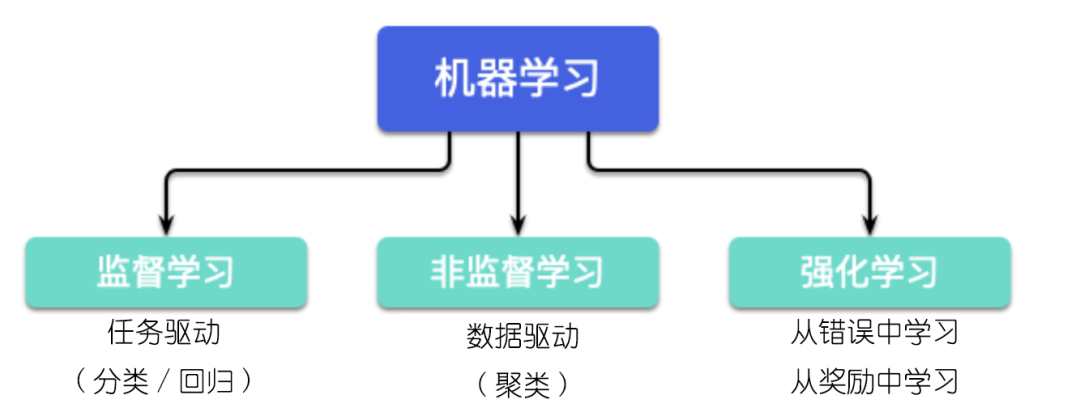

強化學習(Reinforcement Learning, RL)是一種機器學習方法,它通過與環境的交互來學習如何做出決策,以最大化累積獎勵。PyTorch 是一個流行的開源機器學習庫,它提供了靈活的計算圖和自動微分功能,非常適合實現復雜的強化學習算法。

1. 環境(Environment)

在強化學習中,環境是一個抽象的概念,它定義了智能體(agent)可以執行的動作(actions)、觀察到的狀態(states)以及獲得的獎勵(rewards)。PyTorch 本身不提供環境,但可以使用 OpenAI 的 Gym 庫來創建和管理環境。

import gym

# 創建一個環境

env = gym.make('CartPole-v1')

2. 策略(Policy)

策略是智能體用來選擇動作的函數。在強化學習中,策略可以是確定性的或隨機的。使用 PyTorch,我們可以通過神經網絡來近似策略。

import torch

import torch.nn as nn

import torch.optim as optim

# 定義一個簡單的策略網絡

class PolicyNetwork(nn.Module):

def __init__(self, state_size, action_size):

super(PolicyNetwork, self).__init__()

self.fc1 = nn.Linear(state_size, 128)

self.fc2 = nn.Linear(128, action_size)

def forward(self, state):

x = torch.relu(self.fc1(state))

x = self.fc2(x)

return torch.softmax(x, dim=1)

# 初始化網絡和優化器

policy_net = PolicyNetwork(env.observation_space.shape[0], env.action_space.n)

optimizer = optim.Adam(policy_net.parameters(), lr=0.01)

3. 價值函數(Value Function)

價值函數估計從給定狀態開始,遵循特定策略所能獲得的期望回報。在 PyTorch 中,我們可以使用另一個神經網絡來近似價值函數。

# 定義價值網絡

class ValueNetwork(nn.Module):

def __init__(self, state_size):

super(ValueNetwork, self).__init__()

self.fc1 = nn.Linear(state_size, 128)

self.fc2 = nn.Linear(128, 1)

def forward(self, state):

x = torch.relu(self.fc1(state))

x = self.fc2(x)

return x

# 初始化價值網絡和優化器

value_net = ValueNetwork(env.observation_space.shape[0])

value_optimizer = optim.Adam(value_net.parameters(), lr=0.01)

4. 訓練循環(Training Loop)

在訓練循環中,智能體會與環境交互,收集經驗,并使用這些經驗來更新策略和價值函數。

def train():

num_episodes = 1000

for episode in range(num_episodes):

state = env.reset()

done = False

rewards = 0

while not done:

# 選擇動作

state_tensor = torch.from_numpy(state).float().unsqueeze(0)

action_probs = policy_net(state_tensor)

action = torch.argmax(action_probs).item()

# 執行動作

next_state, reward, done, _ = env.step(action)

rewards += reward

# 更新價值函數

next_state_tensor = torch.from_numpy(next_state).float().unsqueeze(0)

next_value = value_net(next_state_tensor)

current_value = value_net(state_tensor)

value_optimizer.zero_grad()

value_loss = (current_value - next_value).pow(2).mean()

value_loss.backward()

value_optimizer.step()

# 更新策略

policy_optimizer.zero_grad()

policy_loss = -torch.log(action_probs[action]) * (next_value - rewards)

policy_loss.backward()

policy_optimizer.step()

state = next_state

print(f'Episode {episode+1}, Reward: {rewards}')

train()

5. 探索與利用(Exploration and Exploitation)

在強化學習中,智能體需要在探索(嘗試新的動作)和利用(使用已知的最佳策略)之間找到平衡。ε-貪心策略是一種常用的方法。

epsilon = 0.1 # 探索率

def choose_action(state, policy_net):

if np.random.rand() < epsilon:

return env.action_space.sample() # 探索

else:

state_tensor = torch.from_numpy(state).float().unsqueeze(0)

action_probs = policy_net(state_tensor)

return torch.argmax(action_probs).item() # 利用

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

機器學習

+關注

關注

66文章

8559瀏覽量

137143 -

強化學習

+關注

關注

4文章

272瀏覽量

11994 -

pytorch

+關注

關注

2文章

813瀏覽量

14902

發布評論請先 登錄

相關推薦

熱點推薦

什么是深度強化學習?深度強化學習算法應用分析

什么是深度強化學習? 眾所周知,人類擅長解決各種挑戰性的問題,從低級的運動控制(如:步行、跑步、打網球)到高級的認知任務。

發表于 07-01 10:29

?2241次閱讀

深度強化學習實戰

一:深度學習DeepLearning實戰時間地點:1 月 15日— 1 月18 日二:深度強化學習核心技術實戰時間地點: 1 月 27 日— 1 月30 日(第一天報到 授課三天;提前環境部署 電腦

發表于 01-10 13:42

將深度學習和強化學習相結合的深度強化學習DRL

深度強化學習DRL自提出以來, 已在理論和應用方面均取得了顯著的成果。尤其是谷歌DeepMind團隊基于深度強化學習DRL研發的AlphaGo,將深度強化學習DRL成推上新的熱點和高度,成為人工智能歷史上一個新的里程碑。因此,深

發表于 06-29 18:36

?2.9w次閱讀

薩頓科普了強化學習、深度強化學習,并談到了這項技術的潛力和發展方向

薩頓在專訪中(再次)科普了強化學習、深度強化學習,并談到了這項技術的潛力,以及接下來的發展方向:預測學習

如何深度強化學習 人工智能和深度學習的進階

傳統上,強化學習在人工智能領域占據著一個合適的地位。但強化學習在過去幾年已開始在很多人工智能計劃中發揮更大的作用。

什么是強化學習?純強化學習有意義嗎?強化學習有什么的致命缺陷?

強化學習是人工智能基本的子領域之一,在強化學習的框架中,智能體通過與環境互動,來學習采取何種動作能使其在給定環境中的長期獎勵最大化,就像在上述的棋盤游戲寓言中,你通過與棋盤的互動來學習

對NAS任務中強化學習的效率進行深入思考

在一些情況下,我們會用策略函數(policy, 總得分,也就是搭建的網絡在測試集上的精度(accuracy),通過強化學習(Reinforcement Learning)這種通用黑盒算法來優化。然而,因為強化學習本身具有數據利用率低的特點,這個優化的過程往往需要大量的計算

DeepMind發布強化學習庫RLax

RLax(發音為“ relax”)是建立在JAX之上的庫,它公開了用于實施強化學習智能體的有用構建塊。。報道:深度強化學習實驗室作者:DeepRL ...

機器學習中的無模型強化學習算法及研究綜述

強化學習( Reinforcement learning,RL)作為機器學習領域中與監督學習、無監督學習并列的第三種學習范式,通過與環境

發表于 04-08 11:41

?11次下載

模型化深度強化學習應用研究綜述

深度強化學習(DRL)作為機器學習的重要分攴,在 Alphago擊敗人類后受到了廣泛關注。DRL以種試錯機制與環境進行交互,并通過最大化累積獎賞最終得到最優策略。強化學習可分為無模型

發表于 04-12 11:01

?9次下載

什么是強化學習

的AlphaStar,他們都是強化學習模型。諸如此類的模型還有 AlphaGo Zero 等。 強化學習的原理非常簡單,它非常像心理學中新行為主義派的斯金納發現的操作性條件反射。 操作性條件反射是什么?當年斯金納做了一個箱子,進行

如何使用 PyTorch 進行強化學習

如何使用 PyTorch 進行強化學習

評論