ABSTRACT摘要

本文介紹如何搭建算力,并介紹A100、H100、H200和B200這些GPU的特性。

JAEALOT

2025年4月23日

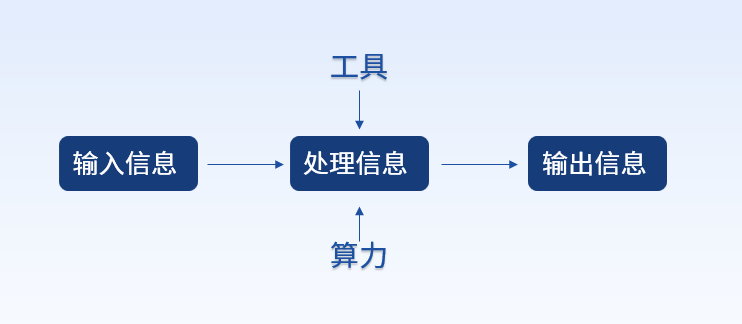

隨著人工智能、大數據和高性能計算(HPC)的快速發展,市場上對算力的需求也在不斷攀升。無論是企業進行數據分析、模型訓練,還是科研機構開展復雜的科學計算,都需要強大的算力支持。因此,搭建一個高效、穩定且具有成本效益的算力中心,成為眾多企業和科研院校關注的焦點。

今天,小助手就來介紹如何搭建算力中心,并為大家介紹A100、H100、H200和B200這些英偉達算力GPU及其特性。

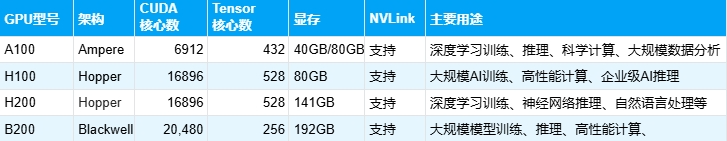

在搭建算力中心前,我們先來了解一下這些GPU:

一、了解英偉達算力GPU的特性

1.A100A100是英偉達2020年發布的旗艦級數據中心GPU,其主要特性包括:

架構:AmpereCUDA核心數:6912 Tensor核心:432顯存:40GB/80GB HBM2eNVLink支持:可連接多個GPU以擴展算力應用場景:深度學習訓練、推理、科學計算、大規模數據分析

2.H100H100是A100的升級版,采用更先進的Hopper架構,相比A100提升了數倍的計算性能,主要特性包括:

架構:HopperCUDA核心數:16896Tensor核心:528顯存:80GB NVLink支持:支持高帶寬互聯應用場景:大規模AI訓練、高性能計算、企業級AI推理

3.H200

H200是英偉達首款提供 HBM3e 的 GPU,HBM3e 是更快、更大的內存,可加速生成式 AI 和大型語言模型,同時推進 HPC 工作負載的科學計算。相比H100性能大大提升。主要特性包括:

架構:Hopper

CUDA核心數:16896

Tensor核心:528

顯存:141GBHBM3

NVLink支持:支持高帶寬互聯

應用場景:大規模AI訓練、高性能計算、企業級AI推理

4.B200

B200采用是 Blackwell 架構,第五代 NV-Link 芯片,雙向帶寬達 1.8TB/s,是 Hopper GPU 使用的第四代 NV-Link 的2倍,最大支持 576 個GPU 的連接。主要特性包括:

架構:BlackwellCUDA核心數:20480Tensor核心:256顯存:192GB HBM3NVLink支持:支持高帶寬互聯應用場景:大規模AI訓練、高性能計算二、明確算力需求

在搭建算力中心之前,首先要明確自身的算力需求。不同的應用場景對算力的要求差異較大:

- AI 訓練 :大規模深度學習訓練任務,如訓練 GPT、Transformer 等大型語言模型,需要極高的計算能力和顯存帶寬,以處理海量的參數和數據,通常需要選擇頂級性能的 GPU。

- AI 推理 :主要關注低延遲和高吞吐量,以便快速響應用戶的請求,準確地對新數據進行預測和分析。一般來說,中高端 GPU 即可滿足一定的推理需求。

- 科學計算與高性能計算:如物理模擬、氣象預測、生物信息學等領域的科學計算,以及高性能計算集群中的任務,對計算精度和處理速度要求極高,需要具備強大 FP64 與 FP32 處理性能的 GPU。

- 中小規模計算 :對于一些中小企業的日常數據分析、小型機器學習模型訓練等,可選擇性價比相對較高、性能適中的 GPU。

三、選擇合適的 GPU 服務器

根據算力需求和預算,可以選擇不同配置的 GPU 服務器:

- 單機 GPU 服務器 :適合中小企業或個人開發者。如 DGX Station A100/H100,單機最多可搭載 4-8 張 GPU,能夠滿足一定規模的計算需求,且具有較高的靈活性和可擴展性。

- GPU 集群 :對于企業級部署,尤其是需要大規模計算資源的場景,可使用 DGX A100/H100 服務器,支持多臺 GPU 互聯,通過 InfiniBand 和 NVLink 構建大規模集群,以提供強大的算力支持,滿足復雜計算任務和大規模模型訓練的需求。

四、搭配高性能計算環境

除了 GPU,還需要搭配高性能的計算環境,以充分發揮 GPU 的算力優勢:

CPU :推薦使用 AMD EPYC 或 Intel Xeon 服務器級 CPU,以提供足夠的計算能力和數據處理能力,與 GPU 協同工作。

內存 :建議最低配備 256GB 內存,對于 AI 訓練等計算密集型任務,內存容量應更大,以滿足模型訓練和數據存儲的需求。

存儲 :采用 SSD + 高速 NVMe 存儲,如配備 1PB 級別的存儲容量,以確保數據的快速讀寫和大容量存儲。

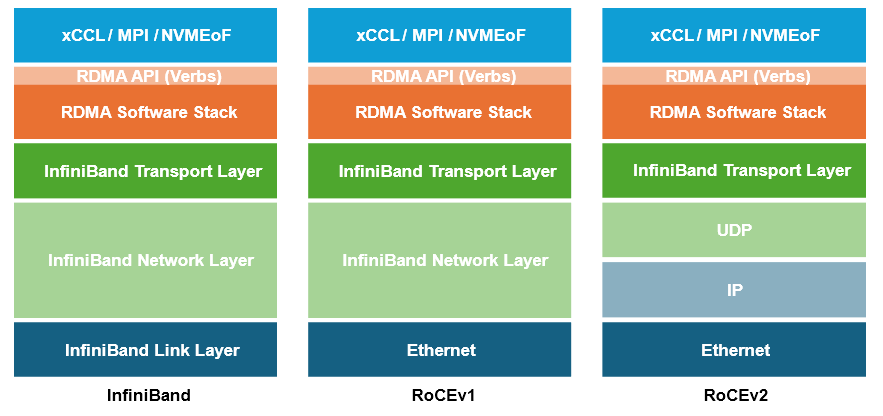

網絡 :支持 InfiniBand 和 100GbE 以上高速網絡,以實現 GPU 服務器之間的高效通信和數據傳輸,減少網絡延遲對計算性能的影響。

五、軟件環境搭建

在硬件配置完善的基礎上,搭建合適的軟件環境至關重要:

- 操作系統 :可選擇 Ubuntu 20.04/22.04 LTS,或基于 Linux 的服務器環境,這些操作系統具有良好的穩定性和兼容性,能夠支持各種 AI 框架和計算工具。

- 驅動與 CUDA :安裝最新的 NVIDIA 驅動,并配備 CUDA 11+(H100 支持 CUDA 12),以確保 GPU 的正常運行和性能優化,CUDA 是 NVIDIA 提供的并行計算平臺和編程模型,能夠充分發揮 GPU 的計算能力。

- AI 框架 :根據具體的應用需求,安裝 PyTorch、TensorFlow 等主流 AI 框架,以及 NVIDIA Triton 推理服務器、cuDNN、TensorRT 等工具,以支持模型訓練、推理和部署等任務。

總 結

總之,搭建算力中心需要綜合考慮算力需求、GPU 特性、硬件配置以及軟件環境等多方面因素。A100、H100、H200 和 B200 服務器 GPU 各具特點,適用于不同的應用場景和預算需求:

預算有限 ——可選擇 A100、A800、H800 等性能相對適中、性價比高的 GPU,能夠滿足中小規模計算和部分 AI 訓練、推理任務的需求。追求頂級算力 ——H100 或 H800 是理想之選,它們在大規模 AI 訓練和高性能計算領域表現出色,能夠為大型模型訓練和復雜科學計算提供強大的算力支持。

值得一提的是,我們有A100、H100、H200 和 B200這些型號的 GPU。如果您對搭建算力中心感興趣,或者有相關購買需求,歡迎隨時聯系我們,我們將竭誠為您提供優質的產品和服務,助力您的算力中心建設順利開展!

*聲明:文中建議僅供參考,具體方案請結合實際情況綜合判斷。

-

gpu

+關注

關注

28文章

5229瀏覽量

135866 -

算力

+關注

關注

2文章

1586瀏覽量

16811

發布評論請先 登錄

名單公布!【書籍評測活動NO.43】 算力芯片 | 高性能 CPU/GPU/NPU 微架構分析

【「算力芯片 | 高性能 CPU/GPU/NPU 微架構分析」閱讀體驗】--全書概覽

【「算力芯片 | 高性能 CPU/GPU/NPU 微架構分析」閱讀體驗】--了解算力芯片GPU

【「算力芯片 | 高性能 CPU/GPU/NPU 微架構分析」閱讀體驗】+NVlink技術從應用到原理

IBM全新AI芯片設計登上Nature,解決GPU的算力瓶頸

GPU算力租用平臺是什么

算力基礎篇:從零開始了解算力

搭建算力中心,從了解的GPU 特性開始

搭建算力中心,從了解的GPU 特性開始

評論