為了應(yīng)對(duì)大模型(LLM)、AIGC等智能化浪潮的挑戰(zhàn),進(jìn)迭時(shí)空通過AI指令擴(kuò)展,在RISC-V CPU中注入了原生AI算力。這種具有原生AI能力的CPU,我們稱之為AI CPU。K1作為進(jìn)迭時(shí)空第一顆AI CPU芯片,已于今年4月份發(fā)布。

下面我們以K1為例,結(jié)合llama.cpp來展示AI CPU在大模型領(lǐng)域的優(yōu)勢(shì)。

llama.cpp是一個(gè)開源的高性能CPU/GPU大語言模型推理框架,適用于消費(fèi)級(jí)設(shè)備及邊緣設(shè)備。開發(fā)者可以通過工具將各類開源大語言模型轉(zhuǎn)換并量化成gguf格式的文件,然后通過llama.cpp實(shí)現(xiàn)本地推理。

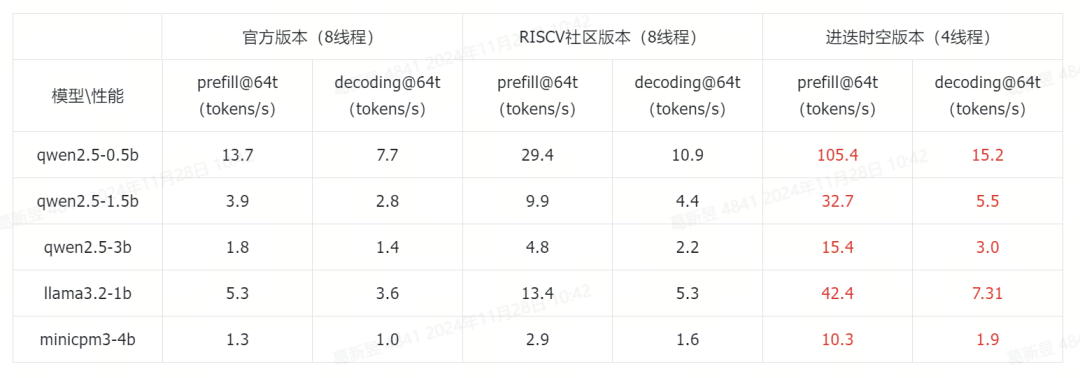

得益于RISC-V社區(qū)的貢獻(xiàn),已有l(wèi)lama.cpp在K1上高效運(yùn)行的案例,但大語言模型的CPU資源使用過高,使其很難負(fù)載其他的上層應(yīng)用。為此進(jìn)迭時(shí)空在llama.cpp社區(qū)版本的基礎(chǔ)上,基于IME矩陣加速拓展指令,對(duì)大模型相關(guān)算子進(jìn)行了優(yōu)化,在僅使用4核CPU的情況下,達(dá)到目前社區(qū)最好版本8核性能的2-3倍,充分釋放了CPU Loading,給開發(fā)者更多空間實(shí)現(xiàn)AI應(yīng)用。

Ollama是一個(gè)開源的大型語言模型服務(wù)工具,它幫助用戶快速在本地運(yùn)行大模型。通過簡(jiǎn)單的安裝指令,用戶可以執(zhí)行一條命令就在本地運(yùn)行開源大型語言模型,如Llama、Qwen、Gemma等。

部署實(shí)踐

工具與模型準(zhǔn)備

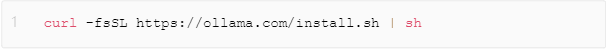

#在K1上拉取ollama與llama.cpp預(yù)編譯包apt updateapt install spacemit-ollama-toolkit

#k開啟ollama服務(wù)ollama serve

#下載模型wget -P /home/llm/ https://archive.spacemit.com/spacemit-ai/ModelZoo/gguf/qwen2.5-0.5b-q4_0_16_8.gguf

#導(dǎo)入模型,例為qwen2.5-0.5b#modelfile地址:https://archive.spacemit.com/spacemit-ai/ollama/modelfile/qwen2.5-0.5b.modelfileollama create qwen2 -f qwen2.5-0.5b.modelfile

#運(yùn)行模型ollama run qwen2

Ollama效果展示

性能與資源展示

我們選取了端側(cè)具有代表性的0.5B-4B尺寸的大語言模型,展示K1的AI擴(kuò)展指令的加速效果。

參考性能分別為llama.cpp的master分支(下稱官方版本),以及RISC-V社區(qū)的優(yōu)化版本(下稱RISC-V社區(qū)版本,GitHub地址為:

https://github.com/xctan/llama.cpp/tree/rvv_q4_0_8x8)

所有模型均采用4bit量化。其中RISC-V社區(qū)版本以及官方版本模型為最優(yōu)實(shí)現(xiàn)的加速效果,模型量化時(shí)將token-embedding-type設(shè)置為q8_0。

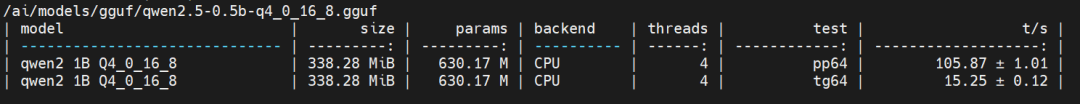

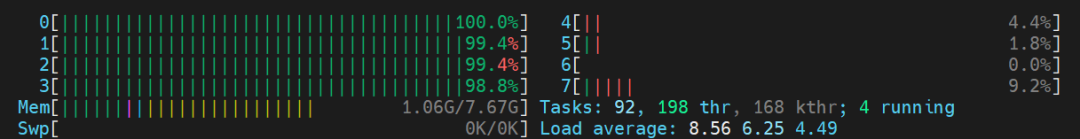

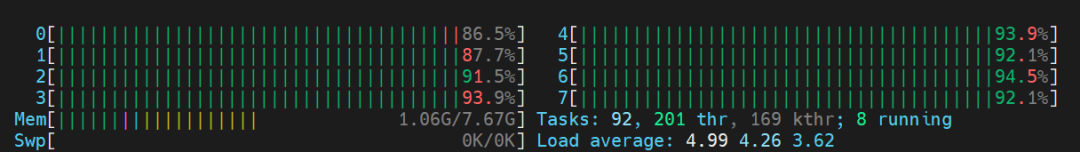

llama.cpp的進(jìn)迭時(shí)空版本CPU占用情況:

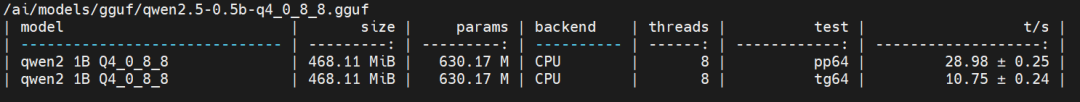

llama.cpp的RISC-V社區(qū)版本CPU占用情況:

參考文檔

https://github.com/ggerganov/llama.cpp

https://github.com/ollama/ollama

https://github.com/QwenLM/Qwen2.5

Qwen2 Technical Report

https://ollama.com

結(jié)語

進(jìn)迭時(shí)空在K1平臺(tái)上大模型部署方面取得了初步進(jìn)展,其卓越的性能與高度的開放性令人矚目。這為開發(fā)者們提供了一個(gè)極為友好的環(huán)境,使他們能夠輕松依托社區(qū)資源,進(jìn)一步拓展和創(chuàng)新,開發(fā)出更多豐富的應(yīng)用。

我們滿懷期待地憧憬著K1平臺(tái)上未來可能出現(xiàn)的更多大語言模型應(yīng)用的創(chuàng)新設(shè)想。在此過程中,我們將持續(xù)保持關(guān)注并不斷推進(jìn)相關(guān)工作。此外,本文所提及的預(yù)發(fā)布軟件包,將在年底以源代碼的形式開源,以供廣大開發(fā)者共同學(xué)習(xí)與探索。

-

芯片

+關(guān)注

關(guān)注

462文章

53623瀏覽量

460253 -

cpu

+關(guān)注

關(guān)注

68文章

11229瀏覽量

223220 -

大模型

+關(guān)注

關(guān)注

2文章

3496瀏覽量

5031

發(fā)布評(píng)論請(qǐng)先 登錄

【CIE全國RISC-V創(chuàng)新應(yīng)用大賽】基于 K1 AI CPU 的大模型部署落地

十萬元獎(jiǎng)金池!首屆全國RISC-V高水平創(chuàng)新及應(yīng)用大賽火熱進(jìn)行中

本地部署openWebUI + ollama+DeepSeek 打造智能知識(shí)庫并實(shí)現(xiàn)遠(yuǎn)程訪問

RISC-V CPU 上 3 倍推理加速!V-SEEK:在 SOPHON SG2042 上加速 14B LLM

利用Arm i8mm指令優(yōu)化llama.cpp

【VisionFive 2單板計(jì)算機(jī)試用體驗(yàn)】3、開源大語言模型部署

Arm Neoverse N2平臺(tái)實(shí)現(xiàn)DeepSeek-R1滿血版部署

【幸狐Omni3576邊緣計(jì)算套件試用體驗(yàn)】CPU部署DeekSeek-R1模型(1B和7B)

如何在Ollama中使用OpenVINO后端

將Deepseek移植到i.MX 8MP|93 EVK的步驟

在MAC mini4上安裝Ollama、Chatbox及模型交互指南

K1 AI CPU基于llama.cpp與Ollama的大模型部署實(shí)踐

K1 AI CPU基于llama.cpp與Ollama的大模型部署實(shí)踐

評(píng)論