在AI模型的訓練過程中,大量的計算工作集中在矩陣乘法、向量加法和激活函數等運算上。這些運算正是GPU所擅長的。接下來,AI部落小編帶您了解GPU是如何訓練AI大模型的。

GPU在AI大模型訓練中的應用

在AI大模型的訓練過程中,GPU能夠顯著縮短訓練時間。通過并行計算技術,GPU將訓練任務分解為多個子任務,并在多個處理單元上并行執行。此外,GPU還支持分布式訓練,可以將訓練任務分配到多臺機器上,進一步加快訓練速度。

GPU的并行計算能力不僅可以提高訓練速度,還可以優化模型的性能。在訓練過程中,GPU可以更快地迭代調整模型參數,使損失函數逐步收斂到最小值。同時,GPU還支持多種深度學習框架和算法,這些框架提供了豐富的API和工具,使得模型的構建、訓練和部署變得更加簡單和高效。

除了訓練階段,GPU在模型推理階段也發揮著重要作用。對于實時應用(如自動駕駛、實時翻譯等),GPU的加速作用尤為關鍵。它可以減少推理時間,提高系統的響應速度和用戶體驗。在模型推理過程中,GPU同樣利用并行計算技術,快速處理輸入數據并輸出預測結果。

GPU在AI大模型訓練中的具體實現

在訓練AI大模型之前,需要進行數據準備與預處理工作。這包括收集數據、清洗數據、去除噪聲數據、數據標準化以及數據劃分等步驟。GPU可以加速這些預處理步驟,特別是在處理大規模數據集時,GPU的并行計算能力能夠顯著提高數據處理的效率。

根據目標變量的類型和數據集的特點,確定問題類型,并選擇合適的算法和模型結構。對于神經網絡模型,需要確定網絡的層數、節點數、激活函數等參數。

在訓練過程中,需要設置一系列超參數,如學習率、批量大小、迭代次數等。選擇合適的訓練框架和GPU加速庫,可以進一步提高訓練效率。

對于超大規模的AI模型,單個GPU可能無法滿足計算需求。此時,可以采用分布式訓練策略,將訓練任務劃分為多個子任務,并在多臺機器上的多個GPU上并行處理。同時,還可以利用模型優化技術(如模型剪枝、量化等)來減小模型的規模和計算成本,提高模型的運行效率。

AI部落小編溫馨提示:以上就是小編為您整理的《GPU是如何訓練ai大模型的》相關內容,更多關于AI模型訓練GPU的專業科普及petacloud.ai優惠活動可關注我們。

-

gpu

+關注

關注

28文章

5194瀏覽量

135427 -

AI

+關注

關注

91文章

39755瀏覽量

301356 -

大模型

+關注

關注

2文章

3648瀏覽量

5179

發布評論請先 登錄

AI硬件全景解析:CPU、GPU、NPU、TPU的差異化之路,一文看懂!?

一文看懂AI大模型的并行訓練方式(DP、PP、TP、EP)

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+第二章 實現深度學習AI芯片的創新方法與架構

ai_cube訓練模型最后部署失敗是什么原因?

摩爾線程“AI工廠”:五大核心技術支撐,打造大模型訓練超級工廠

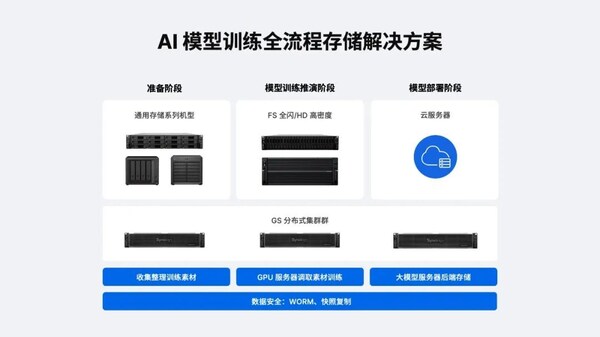

群暉發布AI模型全流程存儲解決方案,破局訓練效率與數據孤島難題

提升AI訓練性能:GPU資源優化的12個實戰技巧

GPU是如何訓練AI大模型的

GPU是如何訓練AI大模型的

評論