優化輸入提示(prompt engineering)是提高人工智能模型輸出質量的關鍵步驟。對于Llama 3這樣的模型,優化輸入提示可以幫助模型更準確地理解用戶的意圖,從而生成更相關和高質量的內容。

- 明確和具體的指令 :

- 確保你的指令清晰、具體,避免模糊不清的表達。例如,而不是說“寫一篇關于AI的文章”,你可以說“寫一篇2000字的文章,探討人工智能在醫療領域的應用”。

- 使用關鍵詞 :

- 包含關鍵詞可以幫助模型更快地定位到相關的信息和上下文。例如,“人工智能”、“醫療領域”、“應用案例”等。

- 上下文信息 :

- 提供足夠的背景信息,幫助模型理解文章的背景和目的。例如,如果你的文章是為了一個特定的讀者群體,比如醫療行業的專業人士,確保在提示中提及這一點。

- 結構化提示 :

- 將文章分成幾個部分,并為每個部分提供具體的指令。例如,“引言部分介紹人工智能的基本概念;主體部分分為三個小節,分別討論AI在診斷、治療和患者監護中的應用;結論部分總結AI在醫療領域的潛力和挑戰”。

- 避免歧義 :

- 使用精確的語言來避免歧義。例如,避免使用“可能”、“或許”等模糊詞匯,而是使用“將”、“能夠”等確定性詞匯。

- 使用例子 :

- 提供具體的例子可以幫助模型生成更具體和詳細的內容。例如,“在討論AI在診斷中的應用時,可以提到IBM的Watson如何幫助醫生分析醫學影像”。

- 風格和語調 :

- 指定文章的風格和語調,比如正式、非正式、幽默或嚴肅,這可以幫助模型生成符合預期的文本。

- 長度限制 :

- 明確指出文章的長度要求,比如“2000字”,這樣模型可以更好地控制輸出的長度。

- 避免過度復雜 :

- 避免在提示中使用過于復雜或技術性的語言,這可能會導致模型輸出難以理解的內容。

- 反饋和迭代 :

- 如果可能,對模型的輸出進行評估,并根據反饋調整你的輸入提示。這有助于不斷優化提示,以獲得更好的結果。

- 使用模板 :

- 如果你經常需要撰寫類似的文章,可以創建一個或多個模板,這些模板可以快速調整以適應不同的主題。

- 避免偏見 :

- 確保你的提示中不包含任何偏見或歧視性語言,這有助于生成公正和包容的內容。

- 創造性元素 :

- 如果適用,可以在提示中加入一些創造性元素,比如故事講述或案例研究,以增加文章的吸引力。

- 明確截止日期 :

- 如果有特定的截止日期,確保在提示中提及,這樣模型可以更快地生成內容。

- 使用引用和數據 :

- 如果需要,可以在提示中要求模型引用特定的研究或數據,以增強文章的可信度。

通過這些策略,你可以更有效地優化Llama 3的輸入提示,從而生成更高質量的2000字文章。記住,優化輸入提示是一個迭代的過程,可能需要多次嘗試和調整才能達到最佳效果。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

人工智能

+關注

關注

1817文章

50094瀏覽量

265302 -

模型

+關注

關注

1文章

3752瀏覽量

52099

發布評論請先 登錄

相關推薦

熱點推薦

如何在Arm Neoverse N2平臺上提升llama.cpp擴展性能

跨 NUMA 內存訪問可能會限制 llama.cpp 在 Arm Neoverse 平臺上的擴展能力。本文將為你詳細分析這一問題,并通過引入原型驗證補丁來加以解決。測試結果表明,在基于 Neoverse N2 平臺的系統上運行 llama3_Q4_0 模型時,該補丁可使文

如何單獨限制某函數的優化級別?

在一個源文件中如何對某一函數進行優化的限制,看資料上說是用#pragma [no_]Onum可以,但是當我使用#pragma no_Onum時候總是通不過,提示有錯誤。

比如

#pragma

發表于 01-06 06:42

idf.py --version` 提示“不是內部或外部命令”(ESP32S3小智調試中遇到)

idf.py --version` 提示“不是內部或外部命令”(ESP32S3小智調試中遇到)

【CIE全國RISC-V創新應用大賽】基于 K1 AI CPU 的大模型部署落地

://archive.spacemit.com/spacemit-ai/llama.cpp/spacemit-llama.cpp.riscv64.0.0.4.tar.gz

# 3. 解壓

tar -xzvf

發表于 11-27 14:43

請問Keil的優化等級到底該如何選擇?

內聯(對小型函數)。

循環優化(如循環展開的有限形式)。

更積極的寄存器分配(變量可能不再駐留在內存中)。

公共子表達式消除。

強度削弱等。

-O3 (最高速度優化 / Optimization

發表于 11-20 07:51

Coremark測試集分析與性能優化思路

將是偽隨機的,基于在編譯時無法確定的輸入。

b. 矩陣操作

【代碼見core_matrix.c】

準備三個NxN矩陣:矩陣A將初始化為小值(upper 3/4 of the bits all

發表于 10-24 08:21

利用Arm i8mm指令優化llama.cpp

本文將為你介紹如何利用 Arm i8mm 指令,具體來說,是通過帶符號 8 位整數矩陣乘加指令 smmla,來優化 llama.cpp 中 Q6_K 和 Q4_K 量化模型推理。

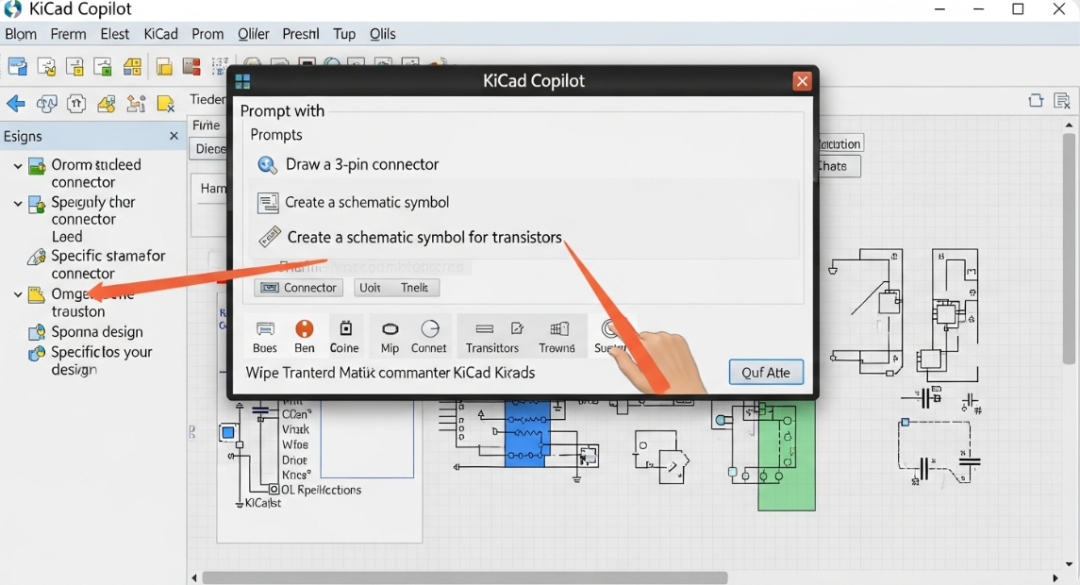

Copilot操作指南(二):使用預置提示詞管理您自己的“工具”

“ ?新版本的 Copilot 支持 Prompt 提示詞的保存、導入及導出。您可以直接調用常用的提示詞,結合與圖紙的交互功能,快速實現一些非常酷的功能。? ” 預置 Prompt 提示詞

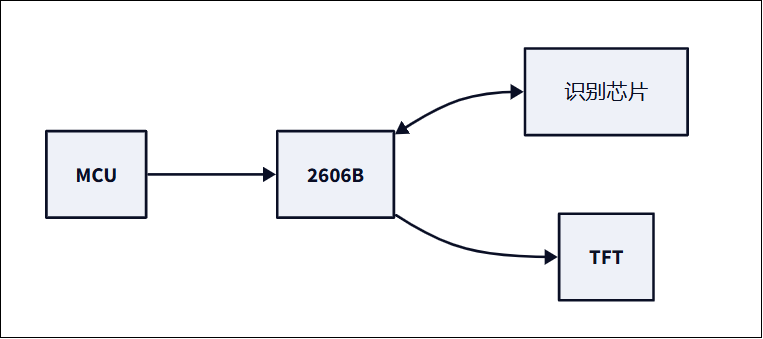

快速開發汽車充電樁的屏幕驅動與語音提示方案

新能源汽車的市場占比份額近幾年逐年升高,而充電樁的需求也隨著新能源汽車的銷售量在逐年升高,而目前市面上的汽車充電樁幾乎都帶有屏幕和語音提示,傳統的電路設計是搞一個成熟的屏幕模塊,然后在安裝一顆語音

使用 NPU 插件對量化的 Llama 3.1 8b 模型進行推理時出現“從 __Int64 轉換為無符號 int 的錯誤”,怎么解決?

安裝了 OpenVINO? GenAI 2024.4。

使用以下命令量化 Llama 3.1 8B 模型:

optimum-cli export openvino -m meta-llama

發表于 06-25 07:20

鴻蒙5開發寶藏案例分享---性能優化案例解析

)

}

})

}

}

Code Linter警告 :

?? AvoidDeepNestLayout :檢測到3層嵌套布局,可能導致渲染卡頓!

優化方案 :用<span class

發表于 06-12 16:36

今日看點丨臺積電、Intel合資運營代工業務;韓國計劃向當地汽車行業注入3萬億韓元援助

1. Meta 發布人工智能新模型系列 Llama 4 ,首次采用“混合專家”架構 ? 當地時間周六(4月5日),美國科技巨頭Meta推出了其最強大的開源人工智能(AI)模型Llama 4

發表于 04-07 11:26

?623次閱讀

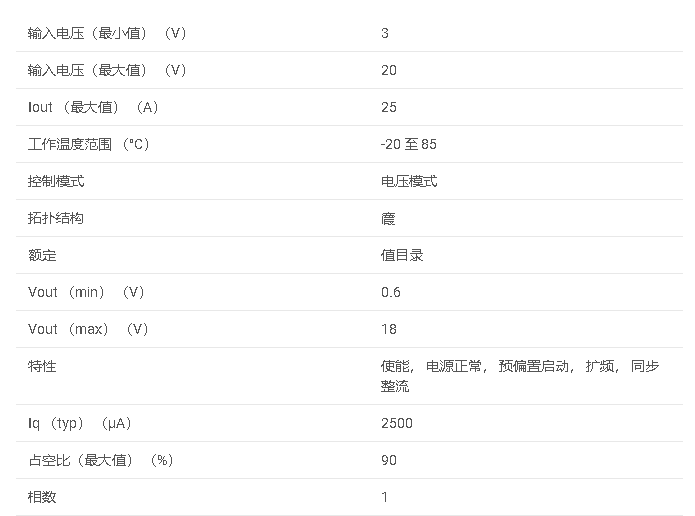

TPS40345 3V 至 20V、25A、同步降壓控制器,適用于成本優化型應用技術資料

TPS40345 是一款同步降壓控制器,可在 3V 至 20V 輸入下工作,可用于成本優化型應用。該控制器實現了一種電壓模式控制架構,具有輸入電壓前饋補償功能,可立即響應

開關電源輸入濾波電路的優化設計研究

濾波電路相比,該濾波電路去掉了差模電感,濾波器的輸入輸出也不需再加共模電容。

圖1.優化的輸入濾波電路 上圖中:R1為放電電阻;L1、L3為低頻共模電感;L2為高頻共模電感;CX

發表于 03-12 15:00

《AI Agent 應用與項目實戰》閱讀心得3——RAG架構與部署本地知識庫

實踐RAG技術的開發者來說是非常有價值的參考。

本人由于時間關系暫時騰不出太多時間投入實際部署本地知識庫,并且考慮到這本書成書是在去年,書中提到的例子是利用Llama3,而當下可以考慮

發表于 03-07 19:49

如何優化 Llama 3 的輸入提示

如何優化 Llama 3 的輸入提示

評論