隨著人工智能技術的飛速發(fā)展,我們見證了一代又一代的AI模型不斷突破界限,為各行各業(yè)帶來革命性的變化。在這場技術競賽中,Llama 3和GPT-4作為兩個備受矚目的模型,它們代表了當前AI領域的最前沿。

一、技術架構

Llama 3和GPT-4都是基于深度學習的自然語言處理(NLP)模型,但它們的設計理念和技術細節(jié)有所不同。

Llama 3采用了一種創(chuàng)新的混合架構,結合了傳統(tǒng)的Transformer模型和最新的神經(jīng)網(wǎng)絡技術。這種架構使得Llama 3在處理復雜的語言任務時表現(xiàn)出色,尤其是在理解上下文和長文本方面。Llama 3的另一個特點是其模塊化設計,允許開發(fā)者根據(jù)特定需求定制模型的不同部分。

GPT-4則延續(xù)了其前身GPT-3的自回歸架構,但在模型規(guī)模和訓練數(shù)據(jù)上進行了顯著擴展。GPT-4通過使用更大規(guī)模的數(shù)據(jù)集和更復雜的預訓練任務,進一步提升了其在語言生成和理解方面的能力。此外,GPT-4還引入了一些新的技術,如知識蒸餾和多任務學習,以提高模型的泛化能力和效率。

二、應用場景

Llama 3和GPT-4在應用場景上也有所不同,這反映了它們在設計時的不同側重點。

Llama 3由于其在理解上下文和長文本方面的優(yōu)勢,特別適合于需要深入分析和理解大量信息的應用,如法律文檔分析、醫(yī)療記錄審查和長篇文學作品的創(chuàng)作。Llama 3的模塊化設計也使其能夠輕松集成到各種不同的系統(tǒng)中,為用戶提供定制化的解決方案。

GPT-4則更側重于生成任務,如自動寫作、對話系統(tǒng)和內容創(chuàng)作。GPT-4的大規(guī)模數(shù)據(jù)訓練使其在生成連貫、有創(chuàng)意的文本方面具有顯著優(yōu)勢。此外,GPT-4在多語言支持和跨領域應用方面也表現(xiàn)出色,使其成為全球化企業(yè)和多領域研究的理想選擇。

三、性能指標

在性能指標方面,Llama 3和GPT-4各有千秋。

Llama 3在處理復雜邏輯和長文本理解方面表現(xiàn)出色,其在一些特定的NLP任務上,如問答系統(tǒng)和文本摘要,已經(jīng)達到了或超過了人類水平。Llama 3的模塊化設計也使其在定制化任務中具有更高的靈活性和效率。

GPT-4在生成任務上的優(yōu)勢更為明顯,其生成的文本不僅連貫,而且具有很高的創(chuàng)造性和多樣性。GPT-4在一些基準測試中,如GLUE和SQuAD,已經(jīng)超越了現(xiàn)有的最先進模型。此外,GPT-4在多任務學習和知識蒸餾方面的技術進步,也使其在處理復雜任務時更加高效。

四、潛在的優(yōu)缺點

盡管Llama 3和GPT-4在技術上都取得了顯著的進步,但它們也面臨著一些潛在的挑戰(zhàn)。

Llama 3的一個主要挑戰(zhàn)是其對計算資源的需求。由于其復雜的混合架構,Llama 3在訓練和推理時需要大量的計算資源。這可能會限制其在資源受限的環(huán)境中的應用。此外,Llama 3的模塊化設計雖然提供了靈活性,但也增加了模型的復雜性和維護難度。

GPT-4的主要挑戰(zhàn)在于其對數(shù)據(jù)的依賴。GPT-4的性能在很大程度上取決于其訓練數(shù)據(jù)的質量和多樣性。如果訓練數(shù)據(jù)存在偏差或不全面,GPT-4可能會產(chǎn)生有偏見或不準確的輸出。此外,GPT-4的大規(guī)模數(shù)據(jù)訓練也引發(fā)了一些關于數(shù)據(jù)隱私和倫理的擔憂。

五、未來發(fā)展

展望未來,Llama 3和GPT-4都有很大的發(fā)展?jié)摿Α?/p>

Llama 3可能會繼續(xù)在理解復雜文本和上下文方面進行優(yōu)化,同時通過技術創(chuàng)新降低對計算資源的需求。Llama 3的模塊化設計也為其未來的擴展和集成提供了廣闊的空間。

GPT-4則可能會進一步擴展其在生成任務上的能力,同時通過引入新的技術來提高其在復雜任務中的性能。GPT-4的多語言和跨領域應用也為其未來的全球化和多元化發(fā)展提供了可能。

-

人工智能

+關注

關注

1817文章

50094瀏覽量

265273 -

GPT

+關注

關注

0文章

368瀏覽量

16869 -

自然語言

+關注

關注

1文章

292瀏覽量

13986

發(fā)布評論請先 登錄

如何在Arm Neoverse N2平臺上提升llama.cpp擴展性能

GPT-5.1發(fā)布 OpenAI開始拼情商

【RA-Eco-RA6M4開發(fā)板評測】PWM輸出

【RA4E2開發(fā)板評測】PWM 驅動舵機

【RA4M2-SENSOR】+PWM與舵機控制

【RA4M2-SENSOR】+PWM與調節(jié)控制

【RA4M2-SENSOR】3、使用GPT定時器-PWM輸出

【RA-Eco-RA6M4開發(fā)板評測】PWM 驅動舵機

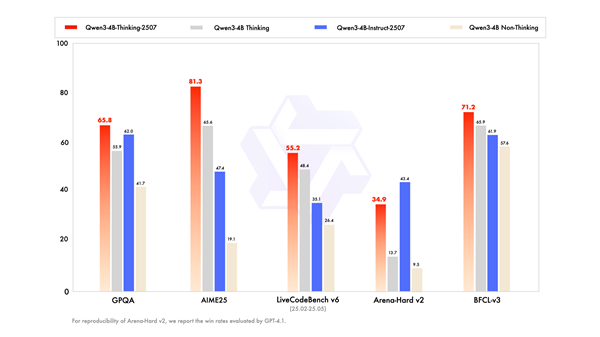

阿里通義千問發(fā)布小尺寸模型Qwen3-4B,手機也能跑

OpenAI或在周五凌晨發(fā)布GPT-5 OpenAI以低價向美國政府提供ChatGPT

利用Arm i8mm指令優(yōu)化llama.cpp

使用 NPU 插件對量化的 Llama 3.1 8b 模型進行推理時出現(xiàn)“從 __Int64 轉換為無符號 int 的錯誤”,怎么解決?

Llama 3 與 GPT-4 比較

Llama 3 與 GPT-4 比較

評論