在人工智能(AI)領域,模型訓練決定了AI系統(tǒng)的性能與效果。以下,petacloud.ai小編為您整理為什么ai模型訓練要用gpu。

一、GPU的工作原理與架構(gòu)

GPU,即圖形處理單元,最初設計用于加速計算機圖形渲染任務,如游戲和視頻處理。與中央處理器(CPU)相比,GPU的架構(gòu)更適合執(zhí)行高度并行化的計算任務。CPU通常擁有少量的高性能核心,擅長處理復雜的邏輯控制和順序執(zhí)行的任務;而GPU則擁有成百上千個相對簡單的核心,這些核心可以同時工作,非常適合執(zhí)行大量簡單但重復的運算,如矩陣乘法和向量加法,這是深度學習算法中的基本操作。

GPU的核心架構(gòu)包括控制單元、算術邏輯單元(ALU)、緩存和內(nèi)存接口等組件,但最重要的是其高度并行化的設計。每個GPU核心可以獨立處理數(shù)據(jù),這使得在處理大規(guī)模數(shù)據(jù)集時,GPU能顯著快于CPU。此外,GPU還配備了專門的內(nèi)存(如GDDR),其帶寬遠高于CPU的DRAM,進一步提升了數(shù)據(jù)訪問速度。

二、GPU在AI模型訓練中的性能優(yōu)勢

加速計算密集型任務:深度學習模型,特別是深度神經(jīng)網(wǎng)絡(DNN),包含大量的矩陣乘法和向量運算。GPU通過高度并行化的執(zhí)行方式,可以極大地縮短這些計算密集型任務的時間。相比CPU,GPU在訓練相同模型時,通常能提供數(shù)十倍甚至更高的加速比。

內(nèi)存帶寬優(yōu)勢:深度學習模型訓練需要頻繁訪問大量數(shù)據(jù),包括模型參數(shù)、輸入數(shù)據(jù)和梯度信息。GPU的高帶寬內(nèi)存系統(tǒng)能夠有效減少內(nèi)存訪問延遲,提高整體訓練效率。

框架支持:主流深度學習框架都對GPU進行了深度優(yōu)化。這些框架提供了易于使用的API,使得開發(fā)者能夠輕松地將模型部署到GPU上,享受硬件加速帶來的性能提升。

能效比:雖然GPU在功耗上高于CPU,但在處理相同計算任務時,由于其高效的并行處理能力,每瓦特的計算能力(能效比)通常更高。這意味著在相同的能耗下,GPU能完成更多的計算工作。

總之,GPU憑借其強大的并行處理能力和高效的內(nèi)存系統(tǒng),已成為AI模型訓練不可或缺的重要工具。

petacloud.ai小編溫馨提示:以上就是小編為您整理的《為什么ai模型訓練要用gpu》相關內(nèi)容,更多關于AI模型訓練GPU的專業(yè)科普和優(yōu)惠活動可關注我們。

審核編輯 黃宇

-

gpu

+關注

關注

28文章

5194瀏覽量

135427 -

AI

+關注

關注

91文章

39755瀏覽量

301354 -

模型訓練

+關注

關注

0文章

21瀏覽量

1546

發(fā)布評論請先 登錄

AI硬件全景解析:CPU、GPU、NPU、TPU的差異化之路,一文看懂!?

一文看懂AI大模型的并行訓練方式(DP、PP、TP、EP)

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+第二章 實現(xiàn)深度學習AI芯片的創(chuàng)新方法與架構(gòu)

ai_cube訓練模型最后部署失敗是什么原因?

摩爾線程“AI工廠”:五大核心技術支撐,打造大模型訓練超級工廠

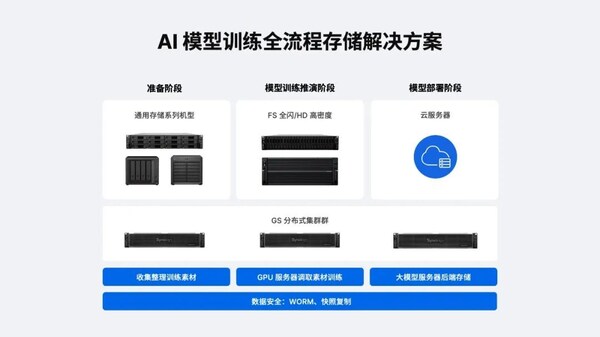

群暉發(fā)布AI模型全流程存儲解決方案,破局訓練效率與數(shù)據(jù)孤島難題

提升AI訓練性能:GPU資源優(yōu)化的12個實戰(zhàn)技巧

Deepseek海思SD3403邊緣計算AI產(chǎn)品系統(tǒng)

首創(chuàng)開源架構(gòu),天璣AI開發(fā)套件讓端側(cè)AI模型接入得心應手

適用于數(shù)據(jù)中心和AI時代的800G網(wǎng)絡

利用RAKsmart服務器托管AI模型訓練的優(yōu)勢

摩爾線程GPU原生FP8計算助力AI訓練

為什么ai模型訓練要用gpu

為什么ai模型訓練要用gpu

評論