當提到CPU(Central Processing Unit,中央處理器)時,就是機器的“大腦”,是計算機系統(tǒng)的核心部件,也是布局謀略、發(fā)號施令、控制行動的“總司令”。CPU的結構主要包括運算器(ALU, Arithmetic and Logic Unit)、控制單元(CU, Control Unit)、寄存器(Register)、高速緩存器(Cache)和它們之間通訊的數(shù)據(jù)、控制及狀態(tài)的總線。簡單來說,CPU就是處理所有運算的核心部件,也叫芯片。所有的計算機中都有CPU,CPU不僅僅能計算數(shù)字,它還可以做很多邏輯運算。可以說,計算機能完成的所有事情,都是靠CPU協(xié)調(diào)計算機的其他部分來完成的。一些CPU還集成了圖形處理器(GPU),以便在不需要獨立GPU的情況下進行基本的圖形處理任務。這種集成圖形處理器(IGP)通常用于輕量級游戲、視頻編輯和日常任務。如下圖(內(nèi)存條上有黑色的內(nèi)存顆粒,它們是用來存儲數(shù)據(jù)的,而綠色PCB板上密密麻麻的布線以及金黃色的引腳感覺科技感十足,其中引腳一般稱為金手指。) 圖片來自網(wǎng)絡,侵刪CPU使用二進制系統(tǒng)來進行數(shù)據(jù)處理和運算。在二進制系統(tǒng)中,數(shù)字由0和1表示,因此CPU需要能夠理解和處理二進制數(shù)據(jù)。CPU 最重要的能力:計算,以加法為例。由于CPU只認知 0 和 1,也就是二進制,那么二進制的加法有哪些組合呢:

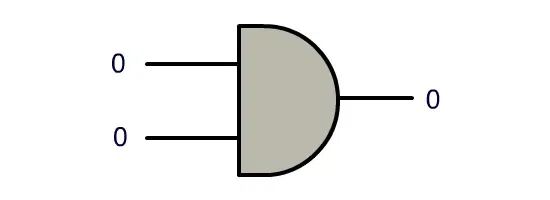

圖片來自網(wǎng)絡,侵刪CPU使用二進制系統(tǒng)來進行數(shù)據(jù)處理和運算。在二進制系統(tǒng)中,數(shù)字由0和1表示,因此CPU需要能夠理解和處理二進制數(shù)據(jù)。CPU 最重要的能力:計算,以加法為例。由于CPU只認知 0 和 1,也就是二進制,那么二進制的加法有哪些組合呢:

二進制組合

0 + 0,結果為0,進位為00 + 1,結果為1,進位為01 + 0,結果為1,進位為01 + 1,結果為0,進位為1

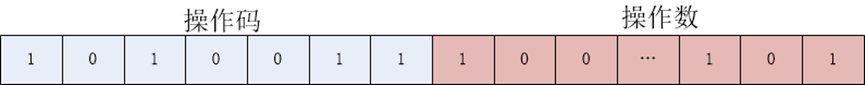

其實CPU里面有一個關鍵的部件,叫做譯碼單元,這是CPU執(zhí)行指令的基礎。你輸入一個二進制數(shù),就像開關一樣激活CPU里面若干個指定的模塊以及改變這些模塊的連同方式,最終得出結果。CPU還包括運算單元(ALU)、控制單元(CU)、寄存器(Registers)和總線(Bus)等。這些組件協(xié)同工作,確保CPU能夠高效地執(zhí)行各種指令。

工作原理:

- 提取(Fetch):CPU從主存儲器(RAM)或高速緩沖存儲器(Cache)中取出指令,并將其放入指令寄存器(IR)。

- 解碼(Decode):CPU對指令寄存器中的指令進行譯碼,確定需要執(zhí)行的操作。

- 執(zhí)行(Execute):CPU根據(jù)解碼后的指令,通過控制單元發(fā)出相應的控制信號,指揮運算單元(ALU)和其他功能部件(如寄存器)進行數(shù)據(jù)的運算和傳輸。

- 寫回(Writeback):運算單元將運算結果寫回寄存器或主存儲器中,完成指令的執(zhí)行

以上這個過程會不斷重復,直到程序執(zhí)行完成。因此,CPU的計算原理實質(zhì)上是不斷重復的指令執(zhí)行過程,通過指令獲取、解碼、數(shù)據(jù)獲取、運算、控制和數(shù)據(jù)存儲等步驟,實現(xiàn)程序的執(zhí)行和計算任務的完成。至于為什么CPU可以計算,這主要得益于其內(nèi)部復雜的電路設計和處理能力。CPU是計算機的大腦,它接收并執(zhí)行存儲在內(nèi)存中的指令,這些指令告訴CPU應該執(zhí)行哪些操作。通過讀取、解碼和執(zhí)行這些指令,CPU能夠完成各種復雜的計算任務。同時,CPU還具備高速的數(shù)據(jù)處理能力,能夠快速地處理大量的數(shù)據(jù),并輸出計算結果。我們今天的信息世界是由0和1定義的,毫無疑問,這種模式已經(jīng)讓我們走了很遠。但是未來似乎擁有無限的可能性:發(fā)生改變的不僅僅是計算這個范疇,新技術將會推動一個嶄新的創(chuàng)新時代,而我們才剛剛開始看到它的輪廓。本文來源:技術飯 - 小fan

以上這個過程會不斷重復,直到程序執(zhí)行完成。因此,CPU的計算原理實質(zhì)上是不斷重復的指令執(zhí)行過程,通過指令獲取、解碼、數(shù)據(jù)獲取、運算、控制和數(shù)據(jù)存儲等步驟,實現(xiàn)程序的執(zhí)行和計算任務的完成。至于為什么CPU可以計算,這主要得益于其內(nèi)部復雜的電路設計和處理能力。CPU是計算機的大腦,它接收并執(zhí)行存儲在內(nèi)存中的指令,這些指令告訴CPU應該執(zhí)行哪些操作。通過讀取、解碼和執(zhí)行這些指令,CPU能夠完成各種復雜的計算任務。同時,CPU還具備高速的數(shù)據(jù)處理能力,能夠快速地處理大量的數(shù)據(jù),并輸出計算結果。我們今天的信息世界是由0和1定義的,毫無疑問,這種模式已經(jīng)讓我們走了很遠。但是未來似乎擁有無限的可能性:發(fā)生改變的不僅僅是計算這個范疇,新技術將會推動一個嶄新的創(chuàng)新時代,而我們才剛剛開始看到它的輪廓。本文來源:技術飯 - 小fan

-

cpu

+關注

關注

68文章

11279瀏覽量

224995 -

存儲數(shù)據(jù)

+關注

關注

0文章

90瀏覽量

14471 -

中央處理器

+關注

關注

1文章

126瀏覽量

17098 -

深度學習

+關注

關注

73文章

5599瀏覽量

124398

發(fā)布評論請先 登錄

相比GPU和GPP,F(xiàn)PGA是深度學習的未來?

FPGA在深度學習應用中或將取代GPU

深度學習框架TensorFlow&TensorFlow-GPU詳解

深度學習推理和計算-通用AI核心

Mali GPU支持tensorflow或者caffe等深度學習模型嗎

什么是深度學習?使用FPGA進行深度學習的好處?

深度學習方案ASIC、FPGA、GPU比較 哪種更有潛力

GPU和GPP相比誰才是深度學習的未來

如何使用FPGA加速深度學習計算?

GPU在深度學習中的應用與優(yōu)勢

作為深度學習的代表,GPU是如何計算的?

作為深度學習的代表,GPU是如何計算的?

評論