據了解,1997年,兩位科學家Sepp Hochreiter和Jürgen Schmidhuber共同創建了長短期記憶(LSTM)神經網絡結構,用于改善循環神經網絡(RNN)的長期記憶功能。

近期,Hochreiter在arXiv平臺發表論文,推出了一款新型的XLSTM(擴展LSTM)架構,有效克服了傳統LSTM互聯網結構“僅能按時間順序處理信息”的局限性,有望挑戰當前熱門的Transformer架構。

該論文指出,Hochreiter在新的XLSTM架構中運用了指數型門控循環網絡,并引入了“sLSTM”和“mLSTM”兩種記憶規則,使神經網絡能夠更高效地利用RAM,實現類似于Transformer的并行化處理。

研究團隊通過對基于XLSTM和Transformer架構的兩款模型進行150億個Token的訓練和測試,結果顯示,XLSTM表現更為出色,特別是在“語言能力”方面表現尤為突出。因此,研究人員預測,未來XLSTM有可能與Transformer展開競爭。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

神經網絡

+關注

關注

42文章

4838瀏覽量

107844 -

RAM

+關注

關注

8文章

1399瀏覽量

120605 -

架構

+關注

關注

1文章

532瀏覽量

26595

發布評論請先 登錄

相關推薦

熱點推薦

Transformer 入門:從零理解 AI 大模型的核心原理

分:Transformer 架構詳解

現在你已經了解了數學基礎和語言模型概念,讓我們來看 Transformer 是如何工作的!

Transform

發表于 02-10 16:33

在AI基礎設施中部署大語言模型的三大舉措

文:Gartner研究副總裁周玲中國企業機構已逐步在生產環境中運行或者計劃運行大語言模型,但在AI基礎設施的生產部署與高效運營方面仍面臨諸多挑戰。目前,中國正加速提升其生成式AI能力,覆蓋大語

Transformer如何讓自動駕駛大模型獲得思考能力?

在談及自動駕駛時,Transformer一直是非常關鍵的技術,為何Transformer在自動駕駛行業一直被提及?

基于NVIDIA Alpamayo構建具備推理能力的輔助駕駛汽車

輔助駕駛研究領域正經歷一場快速變革。視覺-語言-動作推理模型(Reasoning VLA) 的出現正重塑該領域,這些模型為輔助駕駛決策賦予了類人的思維能力。這類

自動駕駛大模型中常提的泛化能力是指啥?

[首發于智駕最前沿微信公眾號]在討論自動駕駛大模型時,常會有幾個評價維度,如感知是否準確、決策是否穩定、系統是否足夠魯棒,以及模型有沒有“泛化能力”。相比準確率、延遲這些容易量化的指標

Transformer如何讓自動駕駛變得更聰明?

]自動駕駛中常提的Transformer本質上是一種神經網絡結構,最早在自然語言處理里火起來。與卷積神經網絡(CNN)或循環神經網絡(RNN)不同,Transformer能夠自動審視所有輸入信息,并動態判斷哪些部分更為關鍵,同時

如何評估電能質量在線監測裝置的硬件能力?

對測量精度、長期運行的支撐能力。以下是具體評估維度與實操方法: 一、核心部件性能:硬件能力的 “基礎門檻” 核心部件(傳感器接口、ADC、電源)直接決定測量下限,需重點核查關鍵參數與實測表現

小白學大模型:國外主流大模型匯總

)領域。論文的核心是提出了一種名為Transformer的全新模型架構,它完全舍棄了以往序列模型(如循環神經網絡RNNs和卷積神經網絡CNNs)中常用的循環和卷積結構

自動駕駛中Transformer大模型會取代深度學習嗎?

[首發于智駕最前沿微信公眾號]近年來,隨著ChatGPT、Claude、文心一言等大語言模型在生成文本、對話交互等領域的驚艷表現,“Transformer架構是否正在取代傳統深度學習”

Transformer在端到端自動駕駛架構中是何定位?

典型的Transformer架構已被用于構建“感知-規劃-控制統一建模”的方案。如Waymo和小馬智行正在研發的多模態大模型(MultimodalLargeModels,MLLMs),將來自攝像頭

【VisionFive 2單板計算機試用體驗】3、開源大語言模型部署

,對算力的要求越高,模型表現越好。

我這里就使用最小的Qwen0.5b來試一下:

拉取完畢之后,就可以在命令行輸入你想問的問題:

我讓它幫我寫一首詩,指定了主題和要表現的內容:

發表于 07-19 15:45

Transformer架構概述

由于Transformer模型的出現和快速發展,深度學習領域正在經歷一場翻天覆地的變化。這些突破性的架構不僅重新定義了自然語言處理(NLP)的標準,而且拓寬了視野,徹底改變了AI的許多方面。

DeepSeek 引領邊緣 AI 芯片向更高性能、更低功耗、更強泛化能力的方向演進

量從十億量級到數百億甚至千億級不等。例如,DeepSeek LLM 67B 在多項評測中已超過同級別開源模型。這些模型通常采用 Transformer 架構及如多頭潛在注意力(MLA)

小白學大模型:從零實現 LLM語言模型

在當今人工智能領域,大型語言模型(LLM)的開發已經成為一個熱門話題。這些模型通過學習大量的文本數據,能夠生成自然語言文本,完成各種復雜的任務,如寫作、翻譯、問答等。https

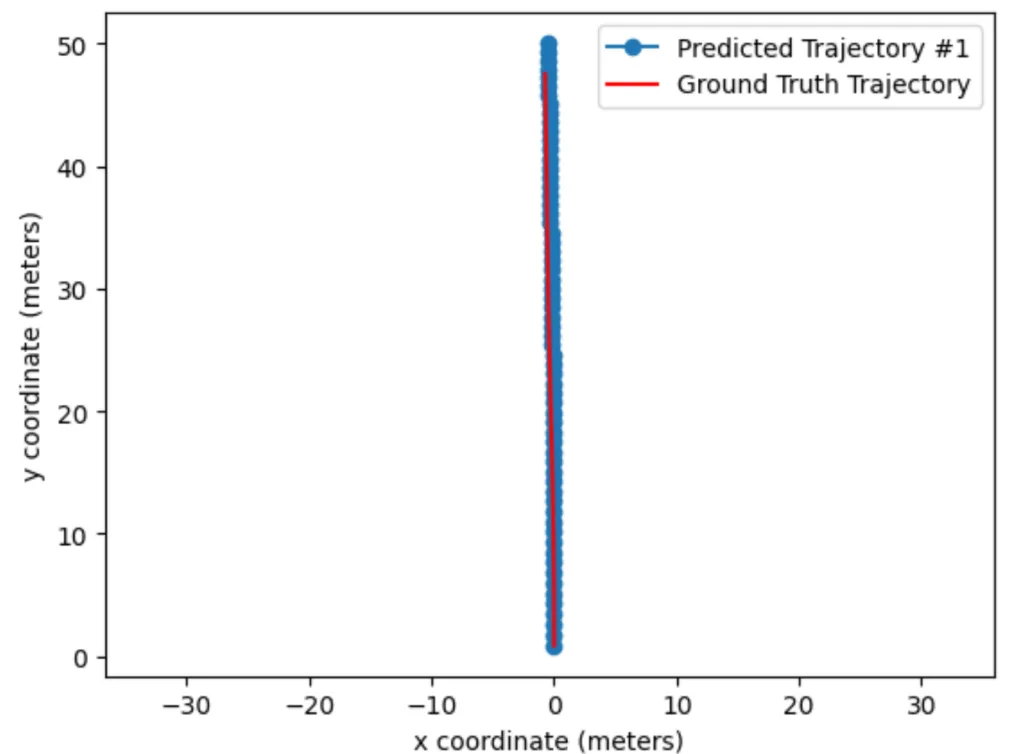

基于xLSTM和Transformer的模型評估:xLSTM在“語言能力”的表現

基于xLSTM和Transformer的模型評估:xLSTM在“語言能力”的表現

評論