英偉達(dá)在3月18日GTC 2024年盛會上推出了搭載自家創(chuàng)新結(jié)構(gòu)Blackwell的B200 GPU芯片,選用了臺積電最先進的N4P制程工藝,性能較之前翻番。然而,Meta公司在次日披露稱,預(yù)計今年無法獲得這款最新的AI芯片,至少在2025年后才能用上。

英偉達(dá)宣稱,B200在性能上比以往最好的GPU快30倍不止。由它構(gòu)成的服務(wù)器集群相比上一代,運算能力飛躍性提升,甚至能使大語言模型的訓(xùn)練速度翻番。

財務(wù)長科萊特?克雷斯于同日向財經(jīng)分析人士保證,“我們確信新款GPU產(chǎn)品將在今年內(nèi)面世。”新款GPU的規(guī)模生產(chǎn)預(yù)計需等到2025年。

臉書(即Meta)作為英偉達(dá)的主要買家之一,已經(jīng)購買了數(shù)十萬塊英偉達(dá)AI芯片,用以訓(xùn)練生成式AI和強化內(nèi)容推薦功能。首席執(zhí)行官馬克?扎克伯格曾在年初表示,今年底將擁有約35萬個H100芯片。這些芯片與其他型號GPU結(jié)合使用,總共將提供60萬個H100所代表的運算力。

在英偉達(dá)發(fā)布B200后不久,Meta宣布將利用該芯片訓(xùn)練公司的LIama大型模型。據(jù)悉,Meta正在動用兩個包含約2.4萬個H100GPU的GPU集群來訓(xùn)練第三代LIama模型。Meta公司發(fā)言人表示,他們打算繼續(xù)使用這兩座集群訓(xùn)練LIama 3,并期待未來用Blackwell硬件訓(xùn)練更多世代的大型模型。

-

服務(wù)器

+關(guān)注

關(guān)注

14文章

10253瀏覽量

91490 -

語言模型

+關(guān)注

關(guān)注

0文章

571瀏覽量

11314 -

英偉達(dá)

+關(guān)注

關(guān)注

23文章

4087瀏覽量

99192

發(fā)布評論請先 登錄

豪言自家芯片比英偉達(dá)GPU強10倍,這家AI公司再獲融資

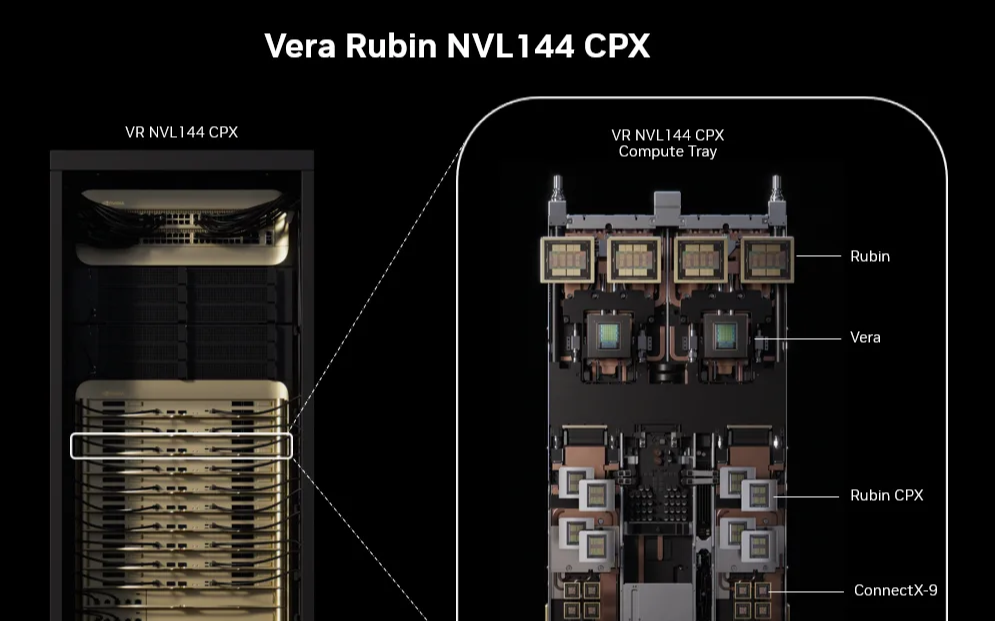

堪稱史上最強推理芯片!英偉達(dá)發(fā)布 Rubin CPX,實現(xiàn)50倍ROI

從英偉達(dá)電話會看Agentic AI推理與FPGA價值

每塊GPU對應(yīng)16TB SSD,英偉達(dá)KV緩存虹吸高性能TLC SSD

美對華芯片出口“松綁”:英偉達(dá)H200獲準(zhǔn)進入中國市場#AI芯片#英偉達(dá)#H200芯片

亞馬遜發(fā)布新一代AI芯片Trainium3,性能提升4倍

英偉達(dá) Q3 狂攬 308 億

英偉達(dá)發(fā)布 NVQLink 開放系統(tǒng)架構(gòu);國內(nèi)首個汽車芯片標(biāo)準(zhǔn)驗證平臺投入使用

錦富技術(shù)斬獲液冷板訂單

英偉達(dá)最新B30A芯片曝光:算力角逐中的新變數(shù)

傳英偉達(dá)自研HBM基礎(chǔ)裸片

外媒:英偉達(dá)正開發(fā)新款中國特供芯片B30A 或為旗艦AI芯品B300的閹割版

AI服務(wù)器電源技術(shù)研討會部分演講嘉賓確認(rèn)

GPU 維修干貨 | 英偉達(dá) GPU H100 常見故障有哪些?

英偉達(dá)發(fā)布性能大幅提升的新款B200 AI GPU

英偉達(dá)發(fā)布性能大幅提升的新款B200 AI GPU

評論