電子發燒友網報道(文 / 吳子鵬)在 AI 算力需求呈指數級增長的今天,英偉達憑借其 GPU 和 CUDA 生態構筑的 “護城河” 似乎堅不可摧。然而,一股由前谷歌 TPU 核心工程師組成的 “復仇者聯盟” 正在硅谷悄然集結,他們創立的 MatX 公司剛剛完成 5 億美元 B 輪融資,豪言要打造性能 10 倍于英偉達 GPU 的專用 AI 芯片,試圖在通用芯片與專用芯片的夾縫中開辟新賽道。

MatX 創始人兼 CEO Reiner Pope 在 LinkedIn 上宣布了這一消息,領投方為 Jane Street 和由前 OpenAI 研究員 Leopold Aschenbrenner 成立的投資基金 Situational Awareness。雖然 Reiner Pope 并未透露公司估值,不過有投資人士推斷其估值已達 50 億美元。這家成立僅三年的初創企業,能否真正撼動英偉達的統治地位?

公開信息顯示,作為 MatX 的 CEO,Reiner Pope 此前負責谷歌 TPU 的 AI 軟件開發工作,深度理解 AI 模型與硬件的協同優化;作為 MatX 的 CTO,Mike Gunter 則是谷歌 TPU 核心研發人員之一,擁有豐富的芯片架構設計經驗。這種 “軟硬結合” 的創始團隊背景,為 MatX 后續的技術路線奠定了堅實基礎。

Reiner Pope 與 Mike Gunter 在谷歌期間,見證了 TPU 如何以專用架構在特定場景下實現遠超通用 GPU 的能效比。但在當時,TPU 始終只是谷歌的 “內供武器”,僅用于自家數據中心,并不對外銷售。手握世界級 AI 芯片設計能力的兩人,看著全球 AI 開發者被英偉達的 CUDA 生態牢牢綁定,被高昂的算力成本壓得喘不過氣,最終決定出走創業。

值得注意的是,MatX 本輪 B 輪融資的投資方構成極具戰略意義。Jane Street 是全球頂級量化交易公司,對算力需求的理解深入骨髓;而 Situational Awareness 由前 OpenAI 研究員 Leopold Aschenbrenner 創立,管理資產超 15 億美元,專注于 AGI(通用人工智能)方向投資,認為 AGI 將在 “幾年內” 實現。其他投資者包括芯片制造商 Marvell Technology、NFDG、Spark Capital,以及 Stripe 聯合創始人 Patrick Collison 和 John Collison 兄弟。

此外,前特斯拉 AI 總監、OpenAI 聯合創始人 Andrej Karpathy 也參與了本輪投資。他在社交平臺上表示:“隨著對 token 需求的激增,為大語言模型底層內存和計算資源的合理配置提供了絕佳機會。”

根據 MatX 官網介紹,MatX One 可提供比目前已發布產品更高的吞吐量,同時延遲水平也能對標行業最優。對于訓練和預填充,它在 FLOPS 方面表現突出;對于解碼和強化學習(RL),它在延遲、FLOPS 和長上下文支持方面優勢明顯。同時,MatX One 能夠支持數十萬個芯片的集群擴展。

MatX One 之所以能夠實現上述性能,在于其獨特的技術路線,實現了 SRAM 與 HBM 的 “魚與熊掌兼得”。當前 AI 芯片市場主要分為兩大路線:以英偉達、谷歌為代表的 “重押 HBM 高帶寬內存” 路線,優先解決大規模訓練的吞吐問題;以 Cerebras 為代表的 “片上 SRAM 優先” 路線,主打推理場景的低延遲。而 MatX 的創新之處在于,將兩種路線的優勢融合,打造了 “專一化架構 + 混合存儲” 的獨特方案,無需在 “速度與容量” 之間做取舍。

首先,MatX 采用了更激進的架構設計,基于可分割的脈動陣列(splittable systolic array),這種設計兼具大型脈動陣列突出的能效和面積效率,同時在處理形狀靈活的小型矩陣時也能保持高利用率。傳統脈動陣列在處理短序列或混合專家模型(MoE)的稀疏計算時,部分計算單元會閑置,而 MatX 的可分割設計能讓芯片每一寸硅片都參與有效計算,最大化每平方毫米的算力輸出,這也是其算力密度領先的關鍵。

其次,MatX 在存儲配置上實現了 SRAM 與 HBM 的智能融合。針對 LLM 運行中的內存瓶頸,MatX 采用了 “分工明確” 的混合存儲策略:高速低延遲的 SRAM 用于存儲模型權重等核心參數,確保計算單元能快速獲取數據,實現低延遲響應;高帶寬、大容量的 HBM 則專門存儲模型的鍵值緩存(KV Cache)—— 這是 LLM 推理中隨對話長度線性增長的核心數據,直接決定了長上下文處理能力。這種設計既解決了純 SRAM 容量不足的問題,又彌補了純 HBM 延遲較高的短板,讓芯片同時具備 GPU 級別的高吞吐量和 SRAM 架構的低延遲。據悉,對于高達 100 層的超大 MoE(混合專家)模型,MatX One 能實現驚人的每秒生成超過 2000 個輸出 token。

Reiner Pope 對此解釋道:“我們的立場是,實際上可以在同一個產品中同時實現這兩點,而且這樣會得到一個更好的產品。” 他進一步補充:“與其他 HBM 方案不同,我們擁有足夠的 SRAM 和互連帶寬,足以支持將權重存儲在 SRAM 中。HBM 中的鍵值對不會增加延遲,因為密集讀取可以預取,而稀疏讀取的數據量很小。”

此外,MatX 還推出了專屬數值計算方案。其針對 Transformer 架構的特性優化了數值計算邏輯,無需依賴通用芯片的兼容設計,進一步提升了 LLM 處理效率,尤其在長上下文、Agent 循環等復雜工作流中,優勢更為明顯。

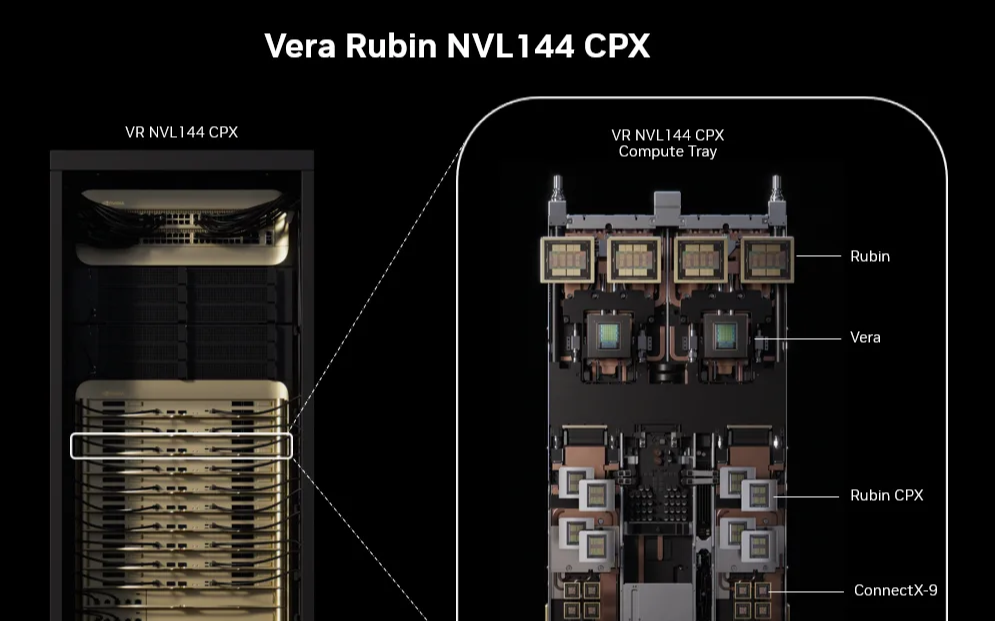

MatX 公開宣稱,其芯片目標是在大語言模型訓練和推理性能上,達到英偉達 GPU 的 10 倍。該公司內部測試顯示,按每平方毫米計算性能指標衡量,其規劃中的芯片性能可以超越英偉達即將推出的 Rubin Ultra。不過需要注意的是,目前 MatX One 仍處于研發階段,尚未實現量產,其性能宣稱仍需后續實際出貨后驗證。但從技術邏輯來看,其專一化設計確實針對性解決了 LLM 運行中的核心痛點,具備較強的理論競爭力。

在技術路線上,當前霸主英偉達主打 “通用全能”,兼顧 AI 訓練、推理、圖形渲染、科學計算等多種場景,核心依賴 HBM3e 高帶寬內存和 CUDA 軟件生態,屬于 “全面覆蓋” 路線。AMD 同樣是通用 GPU 路線,通過 Infinity Fabric 互聯技術整合多個芯粒,主打 “性價比”。谷歌和 MatX 則均走專用路線,但谷歌目前基本仍是自研自用,生態相對封閉。

但 AI 芯片的競爭力,不僅在于硬件性能,更在于軟件生態和落地能力,這也是 MatX 與行業巨頭差距最明顯的領域。目前,英偉達擁有成熟的 CUDA 平臺,與 PyTorch、TensorFlow 等主流框架深度集成,形成了 “硬件 + 軟件 + 生態” 的完整護城河,開發者群體龐大,客戶遷移成本極高。AMD 依托 ROCm 軟件生態試圖對標 CUDA,但生態成熟度和開發者群體遠不及英偉達,主要客戶集中在對成本敏感、無需深度依賴 CUDA 生態的企業。谷歌的封閉生態前文已提及。

作為挑戰者,MatX 目前尚未搭建成熟的軟件生態,仍處于軟件棧研發階段,需要從零開始構建編譯器、調度工具等,說服習慣了 CUDA 的開發者和企業遷移,難度極大。此外,MatX One 計劃 2027 年出貨,尚未經過量產驗證,產能爬坡、性能兌現等均存在不確定性,落地進度遠落后于三大巨頭。

從行業影響來看,無論 MatX 最終能否撼動英偉達的壟斷地位,其技術創新都為 AI 芯片行業提供了新的思路 —— 專一化設計或許是后發企業突破巨頭壁壘的有效路徑。未來,隨著 MatX 等專用芯片企業的崛起,AI 芯片市場將形成 “通用芯片覆蓋大眾場景、專用芯片聚焦細分需求” 的格局,最終推動整個 AI 算力生態向更高效、更具性價比的方向發展。

2027 年將是 MatX 的關鍵一年,其首款產品 MatX One 的量產情況、性能兌現程度,以及軟件生態的搭建進度,將直接決定其未來的市場地位。對于 AI 芯片行業而言,MatX 的探索不僅為后發企業提供了借鑒,也將推動算力技術的持續革新 —— 在這場算力角逐中,沒有永遠的霸主,只有不斷適應需求、持續創新的強者。而 MatX 能否成為打破格局的 “黑馬”,值得整個行業持續關注。

MatX 創始人兼 CEO Reiner Pope 在 LinkedIn 上宣布了這一消息,領投方為 Jane Street 和由前 OpenAI 研究員 Leopold Aschenbrenner 成立的投資基金 Situational Awareness。雖然 Reiner Pope 并未透露公司估值,不過有投資人士推斷其估值已達 50 億美元。這家成立僅三年的初創企業,能否真正撼動英偉達的統治地位?

從谷歌 TPU 出走的 “技術起義者”

2022 年,兩位前谷歌 TPU 核心工程師 Reiner Pope 與 Mike Gunter 正式離職,兩人的目標是從零打造一款專為 LLM 設計的芯片,打破算力與延遲的權衡困境,讓芯片既能滿足大模型訓練的高吞吐需求,又能實現推理場景的低延遲響應。隨后,二人創立了 MatX。公開信息顯示,作為 MatX 的 CEO,Reiner Pope 此前負責谷歌 TPU 的 AI 軟件開發工作,深度理解 AI 模型與硬件的協同優化;作為 MatX 的 CTO,Mike Gunter 則是谷歌 TPU 核心研發人員之一,擁有豐富的芯片架構設計經驗。這種 “軟硬結合” 的創始團隊背景,為 MatX 后續的技術路線奠定了堅實基礎。

Reiner Pope 與 Mike Gunter 在谷歌期間,見證了 TPU 如何以專用架構在特定場景下實現遠超通用 GPU 的能效比。但在當時,TPU 始終只是谷歌的 “內供武器”,僅用于自家數據中心,并不對外銷售。手握世界級 AI 芯片設計能力的兩人,看著全球 AI 開發者被英偉達的 CUDA 生態牢牢綁定,被高昂的算力成本壓得喘不過氣,最終決定出走創業。

值得注意的是,MatX 本輪 B 輪融資的投資方構成極具戰略意義。Jane Street 是全球頂級量化交易公司,對算力需求的理解深入骨髓;而 Situational Awareness 由前 OpenAI 研究員 Leopold Aschenbrenner 創立,管理資產超 15 億美元,專注于 AGI(通用人工智能)方向投資,認為 AGI 將在 “幾年內” 實現。其他投資者包括芯片制造商 Marvell Technology、NFDG、Spark Capital,以及 Stripe 聯合創始人 Patrick Collison 和 John Collison 兄弟。

此外,前特斯拉 AI 總監、OpenAI 聯合創始人 Andrej Karpathy 也參與了本輪投資。他在社交平臺上表示:“隨著對 token 需求的激增,為大語言模型底層內存和計算資源的合理配置提供了絕佳機會。”

重構算力與存儲,直擊 LLM 核心痛點

MatX 之所以敢于挑戰行業巨頭,核心在于其走出了一條不同于主流的技術路線 —— 不追求 “通用全能”,而是以 LLM 的核心需求為導向,通過架構創新和存儲優化,實現 “高吞吐 + 低延遲” 的雙重突破。其首款產品 MatX One 的技術設計,堪稱對傳統 AI 芯片的一次重構。根據 MatX 官網介紹,MatX One 可提供比目前已發布產品更高的吞吐量,同時延遲水平也能對標行業最優。對于訓練和預填充,它在 FLOPS 方面表現突出;對于解碼和強化學習(RL),它在延遲、FLOPS 和長上下文支持方面優勢明顯。同時,MatX One 能夠支持數十萬個芯片的集群擴展。

MatX One 之所以能夠實現上述性能,在于其獨特的技術路線,實現了 SRAM 與 HBM 的 “魚與熊掌兼得”。當前 AI 芯片市場主要分為兩大路線:以英偉達、谷歌為代表的 “重押 HBM 高帶寬內存” 路線,優先解決大規模訓練的吞吐問題;以 Cerebras 為代表的 “片上 SRAM 優先” 路線,主打推理場景的低延遲。而 MatX 的創新之處在于,將兩種路線的優勢融合,打造了 “專一化架構 + 混合存儲” 的獨特方案,無需在 “速度與容量” 之間做取舍。

首先,MatX 采用了更激進的架構設計,基于可分割的脈動陣列(splittable systolic array),這種設計兼具大型脈動陣列突出的能效和面積效率,同時在處理形狀靈活的小型矩陣時也能保持高利用率。傳統脈動陣列在處理短序列或混合專家模型(MoE)的稀疏計算時,部分計算單元會閑置,而 MatX 的可分割設計能讓芯片每一寸硅片都參與有效計算,最大化每平方毫米的算力輸出,這也是其算力密度領先的關鍵。

其次,MatX 在存儲配置上實現了 SRAM 與 HBM 的智能融合。針對 LLM 運行中的內存瓶頸,MatX 采用了 “分工明確” 的混合存儲策略:高速低延遲的 SRAM 用于存儲模型權重等核心參數,確保計算單元能快速獲取數據,實現低延遲響應;高帶寬、大容量的 HBM 則專門存儲模型的鍵值緩存(KV Cache)—— 這是 LLM 推理中隨對話長度線性增長的核心數據,直接決定了長上下文處理能力。這種設計既解決了純 SRAM 容量不足的問題,又彌補了純 HBM 延遲較高的短板,讓芯片同時具備 GPU 級別的高吞吐量和 SRAM 架構的低延遲。據悉,對于高達 100 層的超大 MoE(混合專家)模型,MatX One 能實現驚人的每秒生成超過 2000 個輸出 token。

Reiner Pope 對此解釋道:“我們的立場是,實際上可以在同一個產品中同時實現這兩點,而且這樣會得到一個更好的產品。” 他進一步補充:“與其他 HBM 方案不同,我們擁有足夠的 SRAM 和互連帶寬,足以支持將權重存儲在 SRAM 中。HBM 中的鍵值對不會增加延遲,因為密集讀取可以預取,而稀疏讀取的數據量很小。”

此外,MatX 還推出了專屬數值計算方案。其針對 Transformer 架構的特性優化了數值計算邏輯,無需依賴通用芯片的兼容設計,進一步提升了 LLM 處理效率,尤其在長上下文、Agent 循環等復雜工作流中,優勢更為明顯。

MatX 公開宣稱,其芯片目標是在大語言模型訓練和推理性能上,達到英偉達 GPU 的 10 倍。該公司內部測試顯示,按每平方毫米計算性能指標衡量,其規劃中的芯片性能可以超越英偉達即將推出的 Rubin Ultra。不過需要注意的是,目前 MatX One 仍處于研發階段,尚未實現量產,其性能宣稱仍需后續實際出貨后驗證。但從技術邏輯來看,其專一化設計確實針對性解決了 LLM 運行中的核心痛點,具備較強的理論競爭力。

與巨頭的多維對比:MatX 的差異化優勢

當前 AI 芯片市場,英偉達占據約 90% 的份額,谷歌、AMD 等巨頭憑借各自優勢分食剩余市場。MatX 作為后起之秀,其核心競爭力需放在行業格局中對比,才能更清晰地看清優勢與短板。在技術路線上,當前霸主英偉達主打 “通用全能”,兼顧 AI 訓練、推理、圖形渲染、科學計算等多種場景,核心依賴 HBM3e 高帶寬內存和 CUDA 軟件生態,屬于 “全面覆蓋” 路線。AMD 同樣是通用 GPU 路線,通過 Infinity Fabric 互聯技術整合多個芯粒,主打 “性價比”。谷歌和 MatX 則均走專用路線,但谷歌目前基本仍是自研自用,生態相對封閉。

但 AI 芯片的競爭力,不僅在于硬件性能,更在于軟件生態和落地能力,這也是 MatX 與行業巨頭差距最明顯的領域。目前,英偉達擁有成熟的 CUDA 平臺,與 PyTorch、TensorFlow 等主流框架深度集成,形成了 “硬件 + 軟件 + 生態” 的完整護城河,開發者群體龐大,客戶遷移成本極高。AMD 依托 ROCm 軟件生態試圖對標 CUDA,但生態成熟度和開發者群體遠不及英偉達,主要客戶集中在對成本敏感、無需深度依賴 CUDA 生態的企業。谷歌的封閉生態前文已提及。

作為挑戰者,MatX 目前尚未搭建成熟的軟件生態,仍處于軟件棧研發階段,需要從零開始構建編譯器、調度工具等,說服習慣了 CUDA 的開發者和企業遷移,難度極大。此外,MatX One 計劃 2027 年出貨,尚未經過量產驗證,產能爬坡、性能兌現等均存在不確定性,落地進度遠落后于三大巨頭。

從行業影響來看,無論 MatX 最終能否撼動英偉達的壟斷地位,其技術創新都為 AI 芯片行業提供了新的思路 —— 專一化設計或許是后發企業突破巨頭壁壘的有效路徑。未來,隨著 MatX 等專用芯片企業的崛起,AI 芯片市場將形成 “通用芯片覆蓋大眾場景、專用芯片聚焦細分需求” 的格局,最終推動整個 AI 算力生態向更高效、更具性價比的方向發展。

結語

MatX 的出現,是 AI 芯片行業細分趨勢的必然產物,其背后是谷歌 TPU 基因的技術沉淀、資本的堅定加持,以及對 LLM 算力痛點的精準把握。與英偉達、谷歌、AMD 等巨頭相比,MatX 雖在生態、落地進度上存在明顯差距,但憑借獨特的技術路線和專項性能優勢,有望在 LLM 專用芯片賽道開辟新的增長空間。2027 年將是 MatX 的關鍵一年,其首款產品 MatX One 的量產情況、性能兌現程度,以及軟件生態的搭建進度,將直接決定其未來的市場地位。對于 AI 芯片行業而言,MatX 的探索不僅為后發企業提供了借鑒,也將推動算力技術的持續革新 —— 在這場算力角逐中,沒有永遠的霸主,只有不斷適應需求、持續創新的強者。而 MatX 能否成為打破格局的 “黑馬”,值得整個行業持續關注。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

gpu

+關注

關注

28文章

5239瀏覽量

135933

發布評論請先 登錄

相關推薦

熱點推薦

堪稱史上最強推理芯片!英偉達發布 Rubin CPX,實現50倍ROI

電子發燒友網報道(文/梁浩斌)近日,英偉達在AI infra峰會上發布了專為大規模上下文推理設計的全新GPU系列Rubin CPX,性能堪稱炸裂! ?

GPU不是AI的唯一解:英偉達用Groq LPU證明,推理賽道需要“另一條腿”

大會上,英偉達CEO黃仁勛正式發布了Vera Rubin AI超級計算機平臺。這一平臺的問世,不僅標志著英偉達戰略從單一的

英偉達Rubin GPU采用鉆石銅散熱,解決芯片散熱難題

電子發燒友網綜合報道 在AI算力狂飆的時代,芯片散熱問題成為制約技術發展的關鍵瓶頸。英偉達下一代Vera Rubin架構GPU,將全面采用“

融資超20億,這家“非GPU”芯片公司躋身國產AI算力第一梯隊

電子發燒友報道(文/黃晶晶)谷歌 TPU 對英偉達 GPU 的直接競爭,引發市場廣泛關注。而如今,中國 AI 芯片領域也正加速布局,發力非

今日看點:特朗普:英偉達Blackwell AI芯片不會廣泛對海外開放;閃迪 NAND 閃存11 月報價漲幅高達 50%

是否會允許向中國出口Blackwell芯片的疑問就一直不斷。當時,特朗普曾暗示可能會允許在中國銷售英偉達下一代先進GPU芯片閹割版。然而,特

發表于 11-10 10:28

?1309次閱讀

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+AI芯片的需求和挑戰

的我我們講解了這幾種芯片的應用場景,設計流程、結構等。

CPU:

還為我們講解了一種算法:哈希表算法

GPU:

介紹了英偉達H100GP

發表于 09-12 16:07

2天40%漲停!深圳傳感器公司豪恩汽電 與英偉達合作

近日,英偉達正式發售新一代人形機器人計算平臺Jetson Thor,售價3499 美元,該芯片被譽為機器人的“新大腦”。 ? 新平臺Jetson Thor有多厲害?它的出現,讓機器人的“智商”有了質

英偉達黃仁勛:將向中國市場銷售H20芯片 中國市場至關重要

,英偉達CEO黃仁勛在北京訪問期間發表聲明稱,將恢復在中國銷售其H20 GPU芯片,并根據美國出口限制為中國市場推出一款新的GPU。

英偉達擬再推中國特供GPU,今年6月量產!

電子發燒友網綜合報道 近年來,美國政府對華半導體出口管制政策不斷收緊,英偉達等半導體企業面臨嚴峻挑戰。為保持在中國市場的競爭力,英偉達推出了多款特供版

發表于 05-27 00:03

?4862次閱讀

豪言自家芯片比英偉達GPU強10倍,這家AI公司再獲融資

豪言自家芯片比英偉達GPU強10倍,這家AI公司再獲融資

評論