在人工智能領(lǐng)域,英偉達作為行業(yè)領(lǐng)軍者,推出了兩種主要的GPU版本供AI服務(wù)器選擇——NVLink版(實為SXM版)與PCIe版。這兩者有何本質(zhì)區(qū)別?又該如何根據(jù)應(yīng)用場景做出最佳選擇呢?讓我們深入探討一下。

** NVLink版的服務(wù)器**

SXM架構(gòu),全稱Socketed Multi-Chip Module,是英偉達專為實現(xiàn)GPU間超高速互連而研發(fā)的一種高帶寬插座式解決方案。這一獨特的設(shè)計使得GPU能夠無縫對接于英偉達自家的DGX和HGX系統(tǒng)。這些系統(tǒng)針對每一代英偉達GPU(包括最新款的H800、H100、A800、A100以及之前的P100、V100等型號)配備了特定的SXM插座,確保GPU與系統(tǒng)之間實現(xiàn)最高效率的連接。舉例來說,一張展示8塊A100 SXM卡在浪潮NF5488A5 HGX系統(tǒng)上并行工作的圖片,直觀展示了這種強大的整合能力。

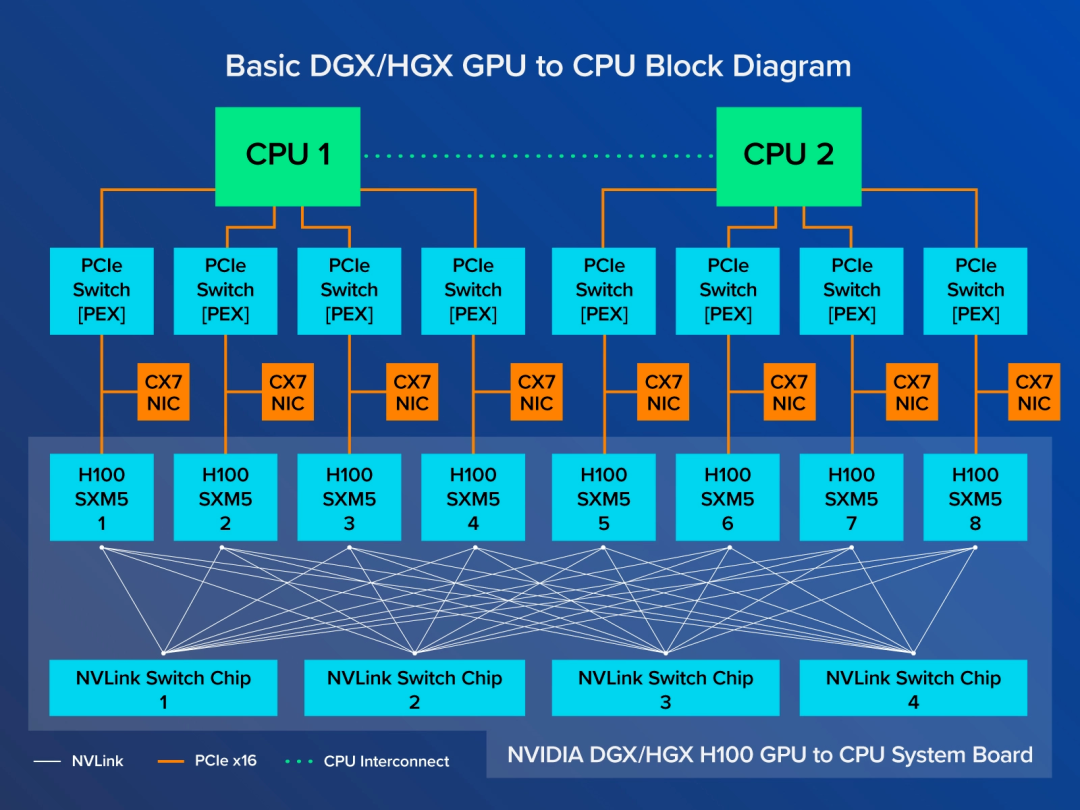

在HGX系統(tǒng)主板上,8個GPU通過NVLink技術(shù)進行了緊密耦合,構(gòu)建出前所未有的高帶寬互聯(lián)網(wǎng)絡(luò)。具體來說,每一個H100 GPU會連接至4個NVLink交換芯片,從而實現(xiàn)GPU之間的驚人傳輸速度——高達900 GB/s的NVLink帶寬。此外,每個H100 SXM GPU還通過PCIe接口與CPU相連,確保任意GPU產(chǎn)生的數(shù)據(jù)都能快速傳送到CPU進行處理。

進一步強化這種高性能互聯(lián)的是NVSwitch芯片,它把DGX和HGX系統(tǒng)板上的所有SXM版GPU串聯(lián)在一起,形成了一個高效的GPU數(shù)據(jù)交換網(wǎng)絡(luò)。未削減功能的A100 GPU可達到600GB/s的NVLink帶寬,而H100更是提升至900GB/s,即便是針對特定市場優(yōu)化過的A800、H800也能保持400GB/s的高速互連性能。

談及DGX和HGX的不同之處,NVIDIA DGX可視為出廠預(yù)裝且高度可擴展的完整服務(wù)器解決方案,其在同等體積內(nèi)的性能表現(xiàn)堪稱業(yè)界翹楚。多臺NVIDIA DGX H800可通過NVSwitch系統(tǒng)輕松組合,形成包含32個乃至64個節(jié)點的超級集群SuperPod,足以應(yīng)對超大規(guī)模模型訓(xùn)練的嚴苛需求。而HGX則屬于原始設(shè)備制造商(OEM)定制整機方案。

** PCIe版的服務(wù)器**

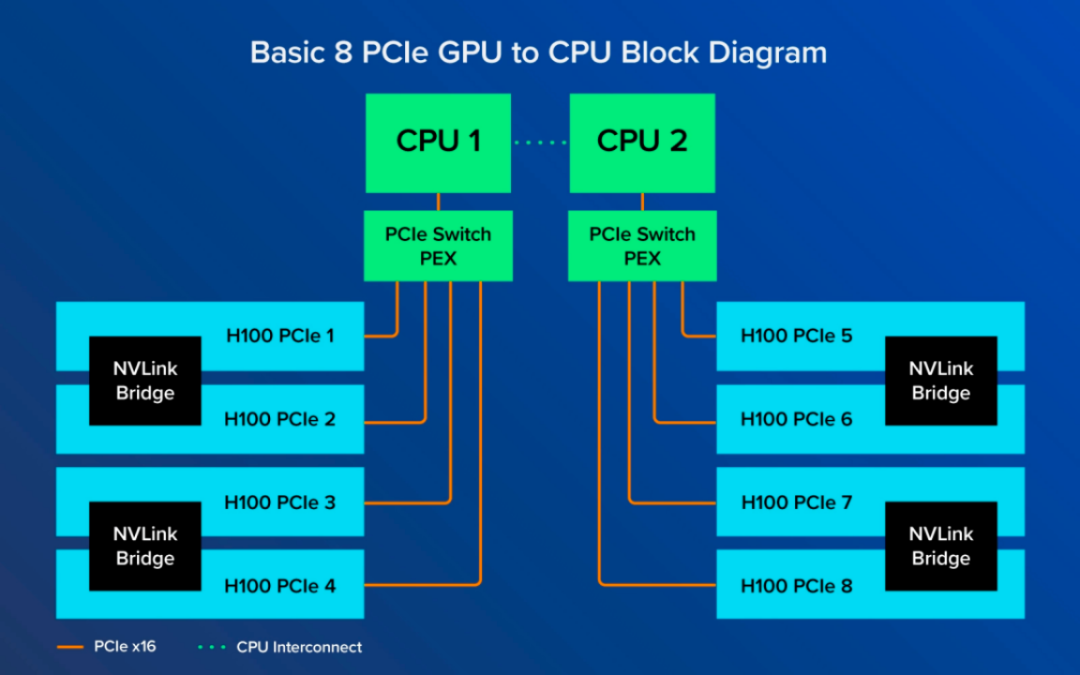

相比于SXM版GPU的全域互聯(lián),PCIe版GPU的互聯(lián)方式更為傳統(tǒng)和受限。在這種架構(gòu)下,GPU僅僅通過NVLink Bridge與相鄰的GPU實現(xiàn)直接連接,如圖所示,GPU 1僅能直接連接至GPU 2,而非直接相連的GPU(如GPU 1與GPU 8)間的通信則必須通過較慢的PCIe通道來實現(xiàn),這過程中還需要借助CPU的協(xié)助。目前最先進的PCIe標(biāo)準提供的最大帶寬僅為128GB/s,遠不及NVLink的超高帶寬。

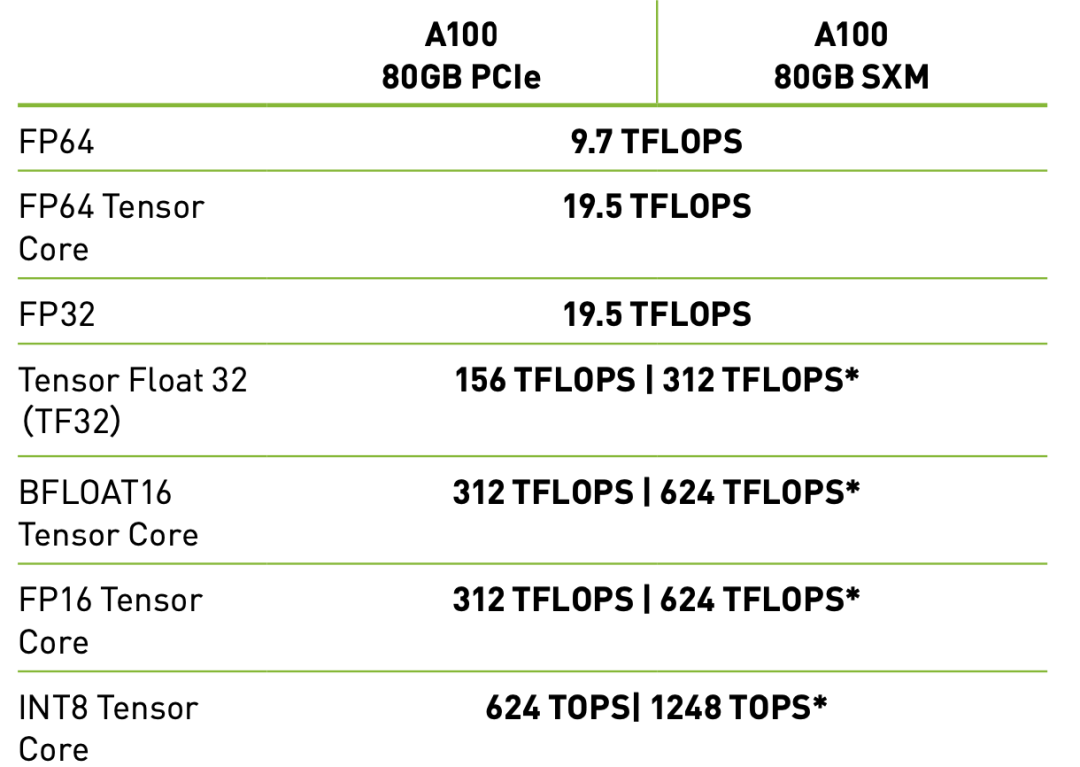

然而,盡管在GPU間互聯(lián)帶寬上PCIe版稍遜一籌,但單就GPU卡本身的計算性能而言,PCIe版與SXM版并無顯著差異。對于那些并不極端依賴于GPU間高速互連的應(yīng)用場景,如中小型模型訓(xùn)練、推理應(yīng)用部署等,GPU間互聯(lián)帶寬的高低并不會顯著影響整體性能。

對比A100 PCIe與A100 SXM各項參數(shù)的圖表顯示兩者的計算核心性能并無太大差別。

** 該如何選擇?**

PCIe版GPU的優(yōu)勢主要體現(xiàn)在其出色的靈活性和適應(yīng)性。對于工作負載較小、追求GPU數(shù)量配置靈活性的用戶,PCIe版GPU無疑是個絕佳選擇。例如,某些GPU服務(wù)器僅需配備4張或者更少的GPU卡,此時采用PCIe版即可方便地實現(xiàn)服務(wù)器的小型化,可輕松嵌入1U或2U服務(wù)器機箱,同時降低了對數(shù)據(jù)中心機架空間的要求。

此外,在推理應(yīng)用部署環(huán)境中,我們經(jīng)常通過虛擬化技術(shù)將資源拆分和細粒度分配,實現(xiàn)CPU與GPU的一對一匹配。在這個場景下,PCIe版GPU因其較低的能耗(約300W/GPU)和普遍兼容性而受到青睞。而相比之下,SXM版GPU在HGX架構(gòu)中的功率消耗可能達到500W/GPU,雖然犧牲了一些能效比,卻換取了頂級的互聯(lián)性能優(yōu)勢。

綜上所述,NVLink版(SXM版)GPU與PCIe版GPU各自服務(wù)于不同的市場需求。對于對GPU間互連帶寬有著極高需求的大規(guī)模AI模型訓(xùn)練任務(wù),SXM版GPU憑借其無可匹敵的NVLink帶寬和極致性能,成為了理想的計算平臺。而對于那些重視靈活性、節(jié)約成本、注重適度性能和廣泛兼容性的用戶,則可以選擇PCIe版GPU,它尤其適合輕量級工作負載、有限GPU資源分配以及各類推理應(yīng)用部署場景。

企業(yè)在選購英偉達AI服務(wù)器時,務(wù)必充分考慮當(dāng)前業(yè)務(wù)需求、未來發(fā)展規(guī)劃以及成本效益,合理評估兩種GPU 服務(wù)器版本的優(yōu)劣,以便找到最適合自身需求的解決方案。最終的目標(biāo)是在保證計算效能的同時,最大化投資回報率,并為未來的拓展留足空間。

審核編輯:劉清

-

NVIDIA

+關(guān)注

關(guān)注

14文章

5592瀏覽量

109722 -

PCIe

+關(guān)注

關(guān)注

16文章

1460瀏覽量

88404 -

交換芯片

+關(guān)注

關(guān)注

0文章

94瀏覽量

11631 -

英偉達

+關(guān)注

關(guān)注

23文章

4086瀏覽量

99173 -

GPU芯片

+關(guān)注

關(guān)注

1文章

307瀏覽量

6516

原文標(biāo)題:英偉達AI服務(wù)器NVLink版與PCIe版的差異與選擇

文章出處:【微信號:AI_Architect,微信公眾號:智能計算芯世界】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

市值近4萬億美元!英偉達GB300服務(wù)器正式出貨

GPU猛獸襲來!HBM4、AI服務(wù)器徹底引爆!

普通服務(wù)器電源與AI服務(wù)器電源的區(qū)別(上)

液冷重塑AI服務(wù)器電源?對材料器件有何要求

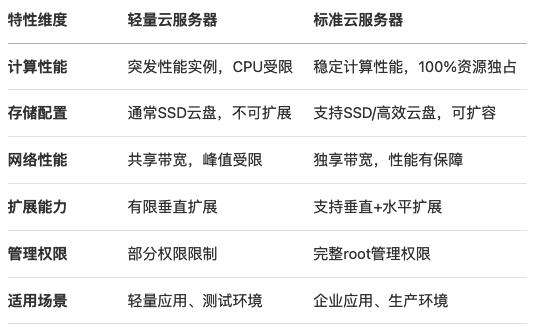

輕量云服務(wù)器和云服務(wù)器區(qū)別:2025年終極選擇指南

繼HBM之后,英偉達帶火又一AI內(nèi)存模組!顛覆AI服務(wù)器與PC

ai服務(wù)器是什么?與普通服務(wù)器有什么區(qū)別

【「算力芯片 | 高性能 CPU/GPU/NPU 微架構(gòu)分析」閱讀體驗】+NVlink技術(shù)從應(yīng)用到原理

總功率超198kW,AI服務(wù)器電源對元器件提出了哪些要求?

云服務(wù)器和獨立服務(wù)器的區(qū)別在哪?一文讀懂如何選擇

RAKsmart服務(wù)器如何賦能AI開發(fā)與部署

薩瑞微電子SiC 和 GaN賦能AI服務(wù)器電源系統(tǒng)

英偉達AI服務(wù)器NVLink版與PCIe版有何區(qū)別?又如何選擇呢?

英偉達AI服務(wù)器NVLink版與PCIe版有何區(qū)別?又如何選擇呢?

評論