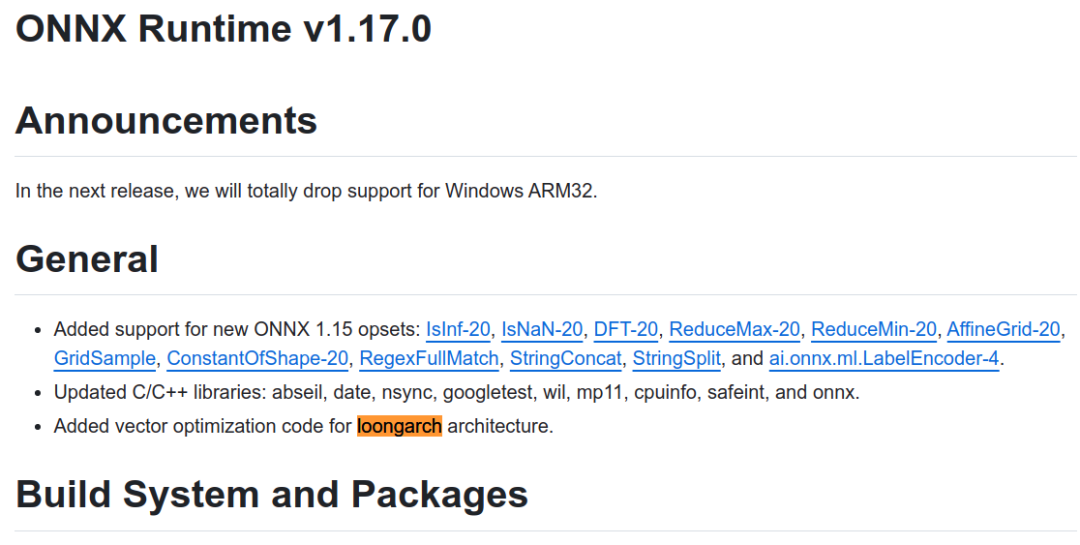

近日,知名AI推理框架開源社區ONNX Runtime正式發布支持龍架構的版本1.17.0。今后,用戶可以直接使用ONNX Runtime開源社區發布的版本在龍芯平臺完成AI推理類應用的開發和部署,標志著龍架構軟件生態得到進一步完善。

ONNX Runtime(ORT)是近年來興起的AI推理框架軟件,被大量AI應用作為基礎AI推理引擎。ORT可支持PyTorch、Tensorflow、TFLite等多種格式的模型輸入,以及CPU、GPU、IoT、NPU、FPGA等多樣化算力后端。

在ONNX Runtime 社區1.17.0版本的研制過程中,龍芯中科技術團隊與社區保持緊密合作,期間向ONNX Runtime社區代碼倉庫提交了7697行代碼,對矩陣乘法、卷積、轉置等核心算子進行深度向量優化。在社區支持下,龍架構優化代碼通過了檢視、測試驗證等質量保證流程,ONNX Runtime社區自1.17.0版本起正式實現對龍架構的原生支持。

未來,龍芯中科將繼續與AI領域的國際開源軟件社區攜手合作,助力AI領域的生態發展和技術創新,為用戶帶來更優產品,實現更大價值。

審核編輯:劉清

-

FPGA

+關注

關注

1660文章

22408瀏覽量

636227 -

龍芯中科

+關注

關注

0文章

366瀏覽量

8541 -

NPU

+關注

關注

2文章

373瀏覽量

21088

原文標題:AI推理框架軟件ONNX Runtime正式支持龍架構

文章出處:【微信號:gh_53fadbdbd4d4,微信公眾號:龍芯中科】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

OrangePi RV2 深度技術評測:RISC-V AI融合架構的先行者

使用NORDIC AI的好處

算力積木+3D堆疊!GPNPU架構創新,應對AI推理需求

Alif Semiconductor的Ensemble MCU新增對ExecuTorch Runtime的支持,助力其推動邊緣生成式AI發展

NVIDIA TensorRT LLM 1.0推理框架正式上線

onnx模型轉換rknn模型出現問題

請問如何在RK3588上使用npu,用onnx模型來推理

信而泰×DeepSeek:AI推理引擎驅動網絡智能診斷邁向 “自愈”時代

Nordic收購 Neuton.AI 關于產品技術的分析

潤和軟件StackRUNS異構分布式推理框架的應用案例

潤和軟件發布StackRUNS異構分布式推理框架

【米爾MYC-YM90X安路飛龍DR1開發板】安路科技 SALDRAGON開發板介紹

首創開源架構,天璣AI開發套件讓端側AI模型接入得心應手

邊緣AI新突破:MemryX AI加速卡與RK3588打造高效多路物體檢測方案

AI推理框架軟件ONNX Runtime正式支持龍架構

AI推理框架軟件ONNX Runtime正式支持龍架構

評論