以下內容均為個人經驗(臆測),不具有指導意義--快樂子涵醬。

關于continue

1.pre-train大模型的知識來自于pt階段,如果你想引入一些新的知識,那CPT是一個不錯的選擇。

2.但你首先要確保你有足夠大量的數據集,至少有幾B的token;

3.否則幾十條數據的情況我更推薦模型編輯更建議全量微調。

4.不確定lora是不是一個好的選擇,后面會展開講。

5.通常CPT開始的階段會出現一段時間的loss上升,隨后慢慢收斂,所以學習率是一個很重要的參數,這很容易理解:如果lr過大,那loss值收斂會更困難,舊能力損失的會更大;如果lr過小,那可能難以學到新知識。

6.當你數據集比較小(例如100B以下?),那建議使用較小的學習率。例如可以使用pre-train階段最大學習率的10%。通常7B模型pre-train階段的學習率大概是3e-4,所以我們可以選擇3e-5。

7.記得根據你的batch size做相應縮放。通常lr縮放倍數為batch size倍數的開方。例如batch size增大4倍,學習率對應擴大2倍即可。

8.warmup_ratio也很重要。通常LLM訓練的warmup_ratio是epoch * 1%左右。例如pre-train階段一般只訓一個epoch,則ratio是0.01;

9.SFT通常3個epoch,ratio對應為0.03但是如果做CPT,建議warmup_ratio調大一點。如果你的數據集很大,有幾百b,那warmup其實不影響最重的模型效果。但通常我們的數據集不會有那么大,所以更小的ratio可以讓模型“過渡”得更平滑。

10.我甚至試過3個epoch的訓練(SFT),第一個epoch全部用來warmup,結果是work的。這里參考了Qwen-7b的技術報告。

11.所以學習率和warmup_ratio是兩個相輔相成的概念,二者通常是成正比的關系。或者說如果你正在用一個較大的學習率,那你或許可以同時嘗試增加warmup來防止模型“爛掉”。

12.這幾點不只適用于CPT,對一些特殊情況下的SFT階段同樣適用。

13.這里吐槽一下Trainer,到現在都不支持最小lr參數。

關于SFT

1.請勿迷信3個epoch的訓練,實測1個epoch就能對話。當然,更多的epoch確實會讓模型的評測效果更佳。

2.但如果你資源嚴重受限,跑一輪也能用~尤其當你從一個SFT模型啟動(如chatGLM)時,嘗試小點的epoch,防止災難性遺忘。

3.如果數據量比較小,如只有1k,可以嘗試更多的epoch。無他,人為過擬合而已。

關于continue

1.pre-train+SFT首先提出一個問題,假設你想做一個領域模型,并且你的領域模型和通用chatBot的輸出內容、格式都區別很大;此外你還期望要通過CPT來注入一定的知識,那可用的技術路線有哪些呢?

從pre-train模型開始SFT訓練,先做CPT,SFT數據使用你的領域數據

會得到一個只能解領域問題的模型,丟失掉通用對話能力,如果完全不考慮通用對話能力可以,否則不推薦

從pre-train模型開始SFT訓練,先做CPT,SFT數據選用通用SFT數據+領域SFT數據

如果你的領域數據和通用能力很接近,如醫療問答,那這是一個非常不錯的技術路線,推薦

對于2,如果你的新任務和通用任務差別很大,甚至輸出格式都完全不一樣甚至沖突

雖然可行,但直覺上一些通用SFT數據的answer會對你的任務目標造成一定程度的負向影響

從pre-train模型開始SFT訓練,先做CPT,再做通用SFT,再做領域SFT

這會導致你的任務目標(最后階段)和你的知識注入階段(CPT階段)中間存在一個階段的gap,可能不是最佳路線

從sft模型開始訓練,先做CPT,再做領域SFT

與4同理,任務目標(最后階段)和通用對話能力階段隔了一個階段,仿佛也不夠優雅

2.思來想去,好像所有現有常見的技術路線都不太work~所以可能要試一些非常規的方法。

3.一個很有意思的問題是,過去我們都被GPT論文的三個階段束縛,老老實實串行跑三個階段:PT->SFT>RLHF

4.但是越來越多人嘗試SFT+DPO混合訓練,看上去也是work的。

5.同理,我相信很多國內大模型的大廠,或多或少可能都在PT模型里偷偷摻了一些SFT數據,這會讓模型的性能有一定程度的提升。

6.很久以前也有人在SFT階段摻雜一些PT數據,來防止災難性遺忘。

7.此外,不管是SFT還是PT,任務目標其實都一樣,都是基于teacher forcing的自回歸任務,next token predict而已,唯一的不同只是數據格式不一樣。

8.那么我們可不可以認為,其實這不同階段的區別其實沒有那么大?是不是可以CPT+SFT混合訓練,不再區分階段。

9.例如我們可以在CPT階段加入大量SFT對話數據(同樣mask掉question),這個SFT數據甚至可以是海量的、未經清洗的、低質量的數據,僅訓練1個epoch即可;接下來我們使用通用SFT數據(少而精的)+領域SFT數據,混合訓練1個epoch;最后1個epoch我們只用領域數據做微調。

10.可以根據數據集大小、重要程度,修改各階段epoch輪次,或在某個階段內擴大某數據集的倍數。

11.至此,CPT數據共訓練1個epoch,通用SFT數據2個,領域數據2個。

12.個人使用這種技術路線,感覺還是比較work的。由于CPT成本太大,未設置更多的消融實驗。那除此以外是否有其他技術路線呢?答案或許是Lora?

關于Lora

1.個人對lora使用得不多,之前僅僅是了解原理+會用,沒有深入探索過一些參數。最近嘗試理解一下。

2.lora真的沒省多少GPU也沒省多少訓練時長,所以我真的不太愛用它。(包大人備注:其實是很省顯存的,但不太省訓練時長)

3.lora更像是一個能力插件,可以幫助模型學到一些新的輸出格式/領域話題,但對新知識或新能力的注入可能不太擅長。

4.對于能力注入,當前的認知是:pre-train > full SFT > lora。

5.所以用lora來進行pretrain可能不是一個最優解,還是更推薦用全參數。

6.但是對于領域任務,lora好像天然適合?

7.第2、3點沒有經過實驗論證,近期會跑個實驗,有結論會做補充。

8.lora_rank是一個很重要的參數,它影響旁路矩陣的大小。

9.如果你的數據量比較小,那推薦用比較小的rank就可以了,我記得原論文里8和32區別不大(懶得翻論文了,全憑記憶,如果有錯誤請指正)

10.如果你數據量較大,那建議用更大的rank,來得到一個更大的旁路矩陣,它顯然可以記住更多的東西。

11.與此同時,除了q_proj,v_proj,強烈建議再試一下把所有的線性層都上lora,如k_proj, up_proj, down_proj這些。

12.此外lora_alpha也很重要,它通常和lora_rank是正比關系,表示一個縮放系數。alpha越大,表示新建的旁路矩陣影響力越大、新數據學得越“猛”;alpha越小,表示原始模型參數對結果的影響力越大。

13.很多人喜歡設置alpha是rank的2倍,其實可以二者1: 1跑個baseline看看效果。

網友補充:

1、SFT和pretrain的任務在有些大模型例如ChatGLM是不一樣的,對于把pretrain放到SFT來保持所謂的防止遺忘并沒有感覺到明顯差異。

2、對于小數據集,設置一個好的prefix,在很多epoch(大于100)的情況仍然保持不錯的提升。

3、lora對顯存的節約是很明顯的,只是很多代碼類似zero的思想并不契合lora(把模型切分放到最后,認為是最不占用顯存的,然而lora相反)。

4、lora的效果和全量在我做的實驗下是有明顯差距的(例如在某些指標上經常>4%絕對值的差距),和論文中的理想情況不同,并且lora比較吃分層學習率,程度和crf比較接近了

5、lora的秩的值設置在1-16上還是存在不小的區別,從16到128上經常只是一些收斂上的差異,例如128可能n個epoch收斂到x,16可能要2n,但并不絕對,而且r大時間久,一般16-32是比較推薦的

6、DPO和RLHF根據個人理解,對chosen-rejected數據的質量需求是不同的,選擇RLHF仍然是更好的選擇,對于顯存不夠的部分人來說,可以例如lora,將actor和ref共用一個,critic和reward共用一個,把顯存從4x降低為2x。寧可這樣也盡量把顯存盡可能用來提高critic模型的參數量

網友:暫時先寫這么多,可能過倆月再看又是一篇漏洞百出的想法,

但總是要在摸索中前進吧~

審核編輯:黃飛

-

SFT

+關注

關注

0文章

9瀏覽量

7050 -

DPO

+關注

關注

0文章

16瀏覽量

13853 -

大模型

+關注

關注

2文章

3650瀏覽量

5179

原文標題:大模型微調經驗和認知

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

信捷電氣與應杰科技深化戰略合作

華為與毛里求斯電信深化自智網絡戰略合作

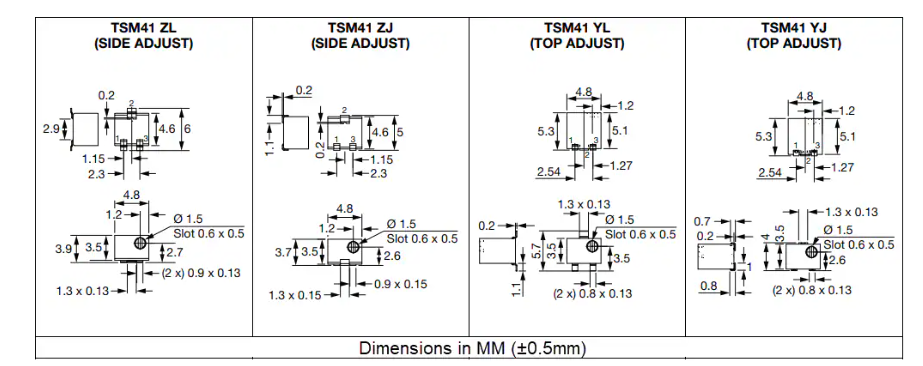

Vishay TSM3微調電阻器技術解析與應用指南

Vishay Sfernice M61系列金屬陶瓷微調電位器技術解析

?基于Vishay TSM41微調電位器的精密電路設計與應用解析

NVIDIA開源Audio2Face模型及SDK

大模型工具的 “京東答案”

世界模型:多模態融合+因果推理,解鎖AI認知邊界

生成式AI如何重塑設計思維與品牌創新?從工具到認知革命的躍遷

千方科技大模型技術在交通運輸領域的應用實踐

NVIDIA使用Qwen3系列模型的最佳實踐

芯馳科技與斑馬智行深化戰略合作

【「# ROS 2智能機器人開發實踐」閱讀體驗】視覺實現的基礎算法的應用

DeepSeek-R1:7B 在配備 Hailo-8L 和 M2-HAT+ 的樹莓派5上的部署實踐測試!

大模型微調實踐心得與認知深化

大模型微調實踐心得與認知深化

評論