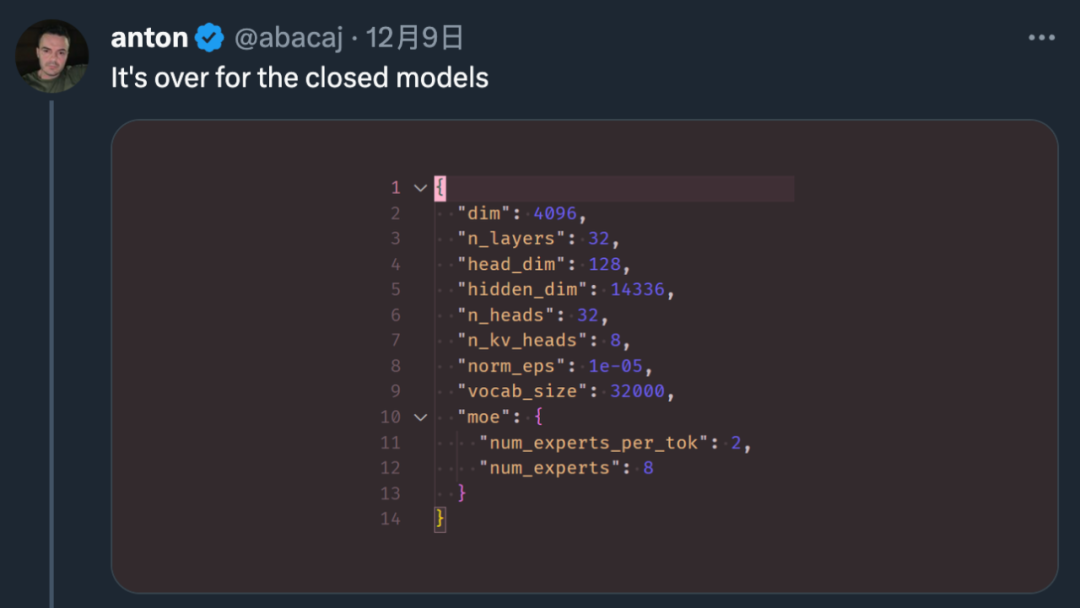

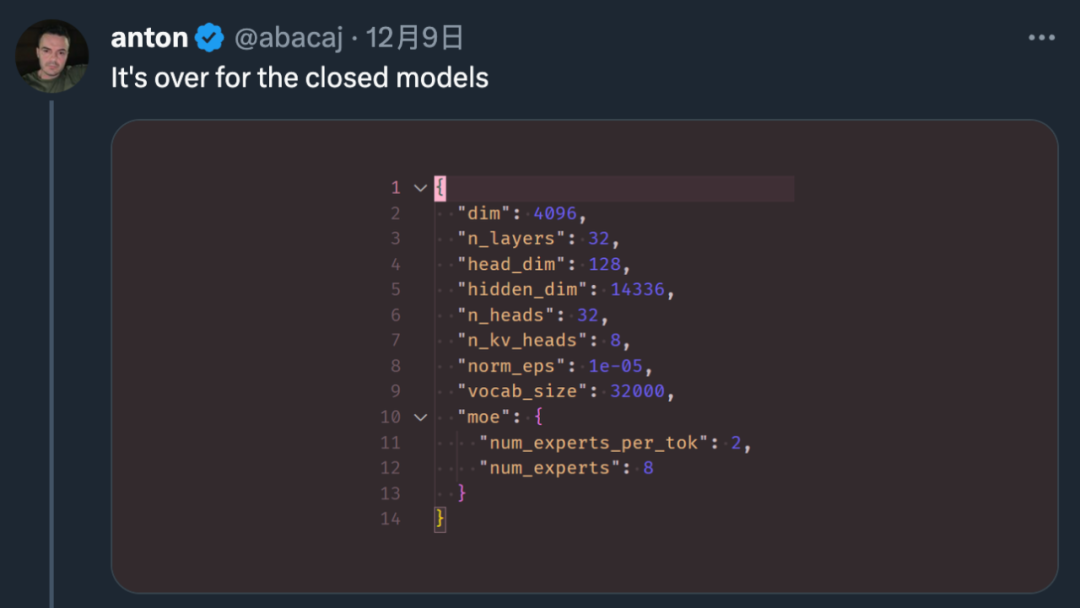

前段時間,Mistral AI 公布的 Mixtral 8x7B 模型爆火整個開源社區,其架構與 GPT-4 非常相似,很多人將其形容為 GPT-4 的「縮小版」。

▲圖源 https://mistral.ai/news/mixtral-of-experts/

▲圖源 https://mistral.ai/news/mixtral-of-experts/

▲圖源 https://twitter.com/reach_vb/status/1741175347821883502

▲圖源 https://twitter.com/reach_vb/status/1741175347821883502 ?第三步是初始化 TextStreamer:

?第三步是初始化 TextStreamer:

?第四步對輸入進行 Token 化:

?第四步對輸入進行 Token 化:

?第五步生成:

?第五步生成:

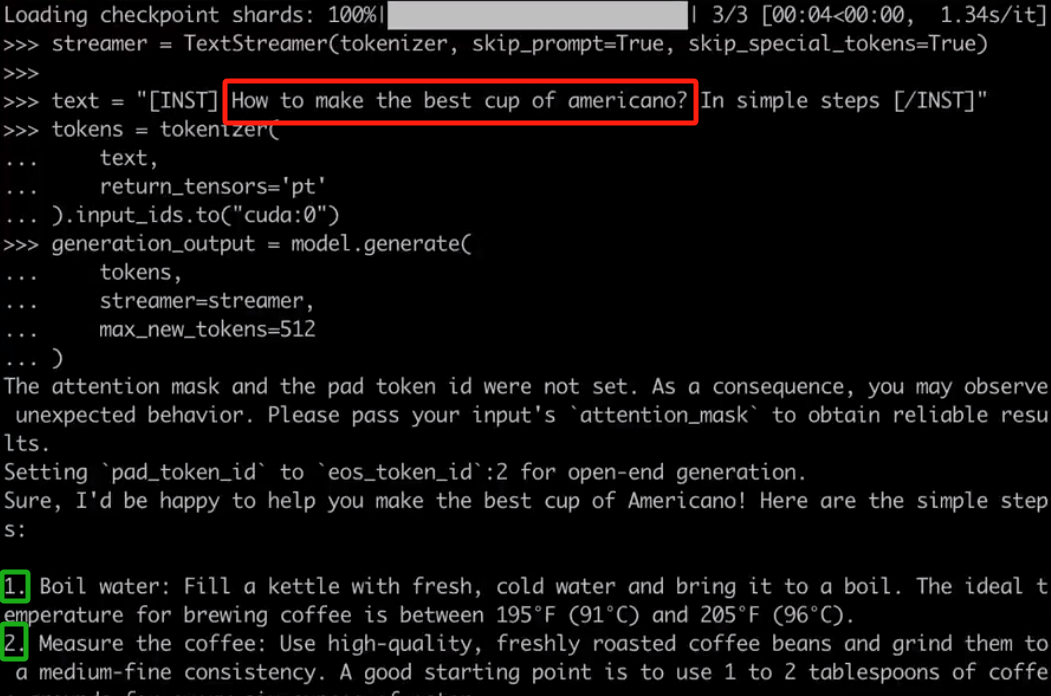

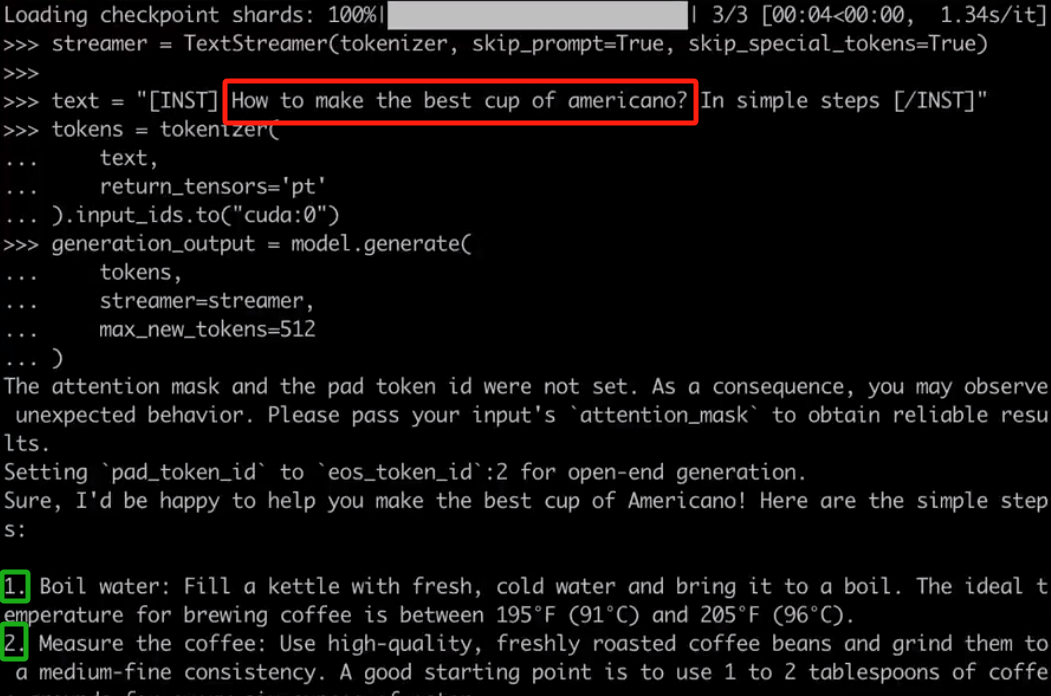

?當你配置好項目后,就可以與 Mixtral 進行對話,例如對于用戶要求「如何做出最好的美式咖啡?通過簡單的步驟完成」,Mixtral 會按照 1、2、3 等步驟進行回答。

?當你配置好項目后,就可以與 Mixtral 進行對話,例如對于用戶要求「如何做出最好的美式咖啡?通過簡單的步驟完成」,Mixtral 會按照 1、2、3 等步驟進行回答。

?

?

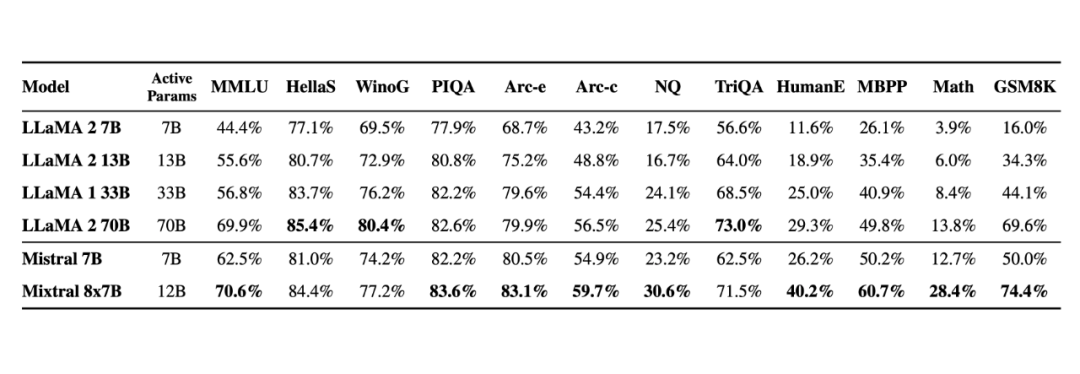

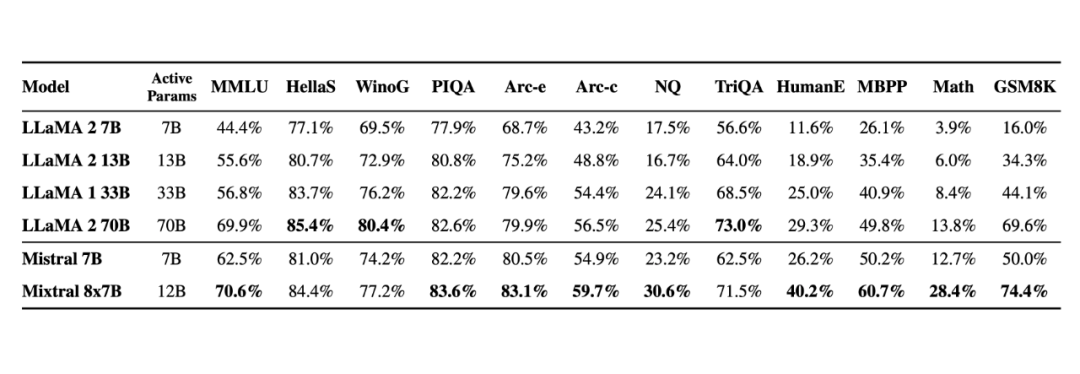

我們都知道,OpenAI 團隊一直對 GPT-4 的參數量和訓練細節守口如瓶。Mistral 8x7B 的放出,無疑給廣大開發者提供了一種「非常接近 GPT-4」的開源選項。

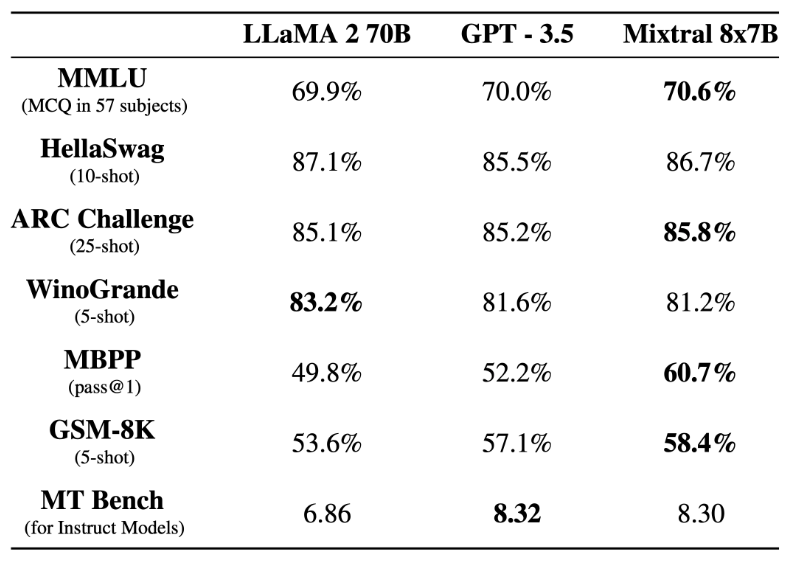

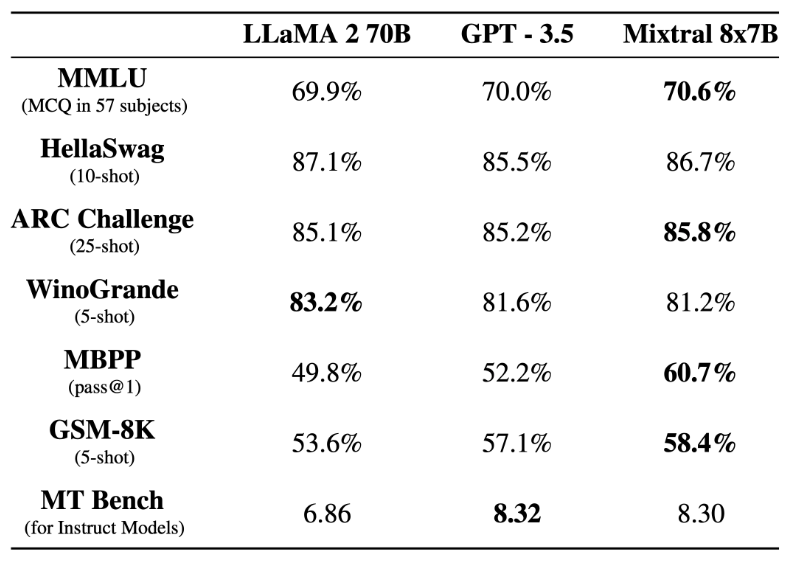

在基準測試中,Mistral 8x7B 的表現優于 Llama 2 70B,在大多數標準基準測試上與 GPT-3.5 不相上下,甚至略勝一籌。

▲圖源 https://mistral.ai/news/mixtral-of-experts/

▲圖源 https://mistral.ai/news/mixtral-of-experts/隨著這項研究的出現,很多人表示:「閉源大模型已經走到了結局。」

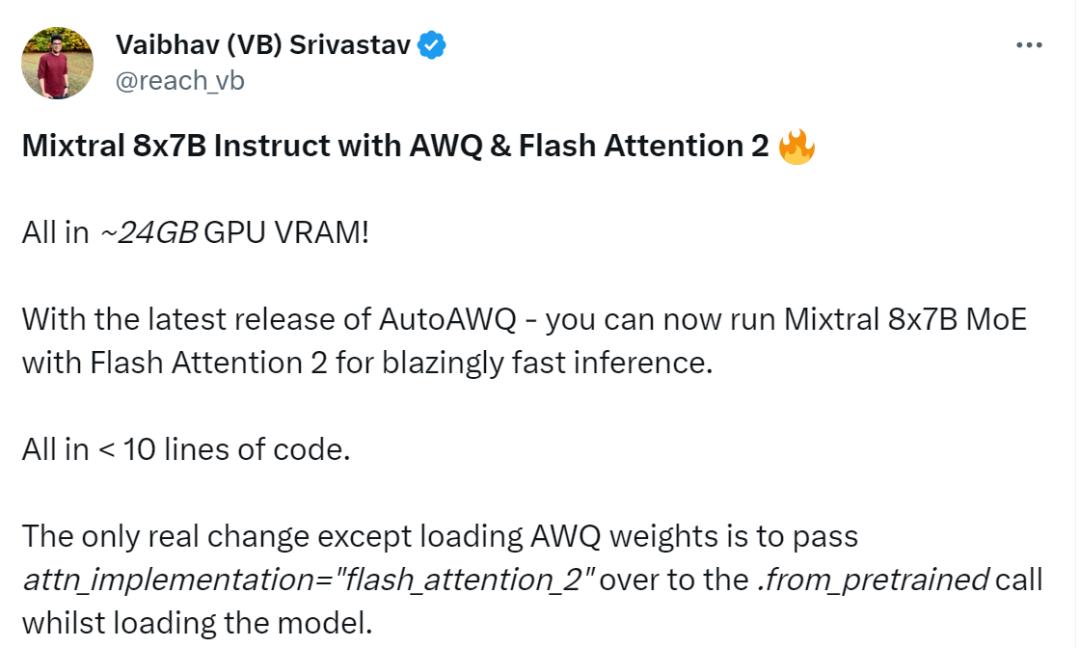

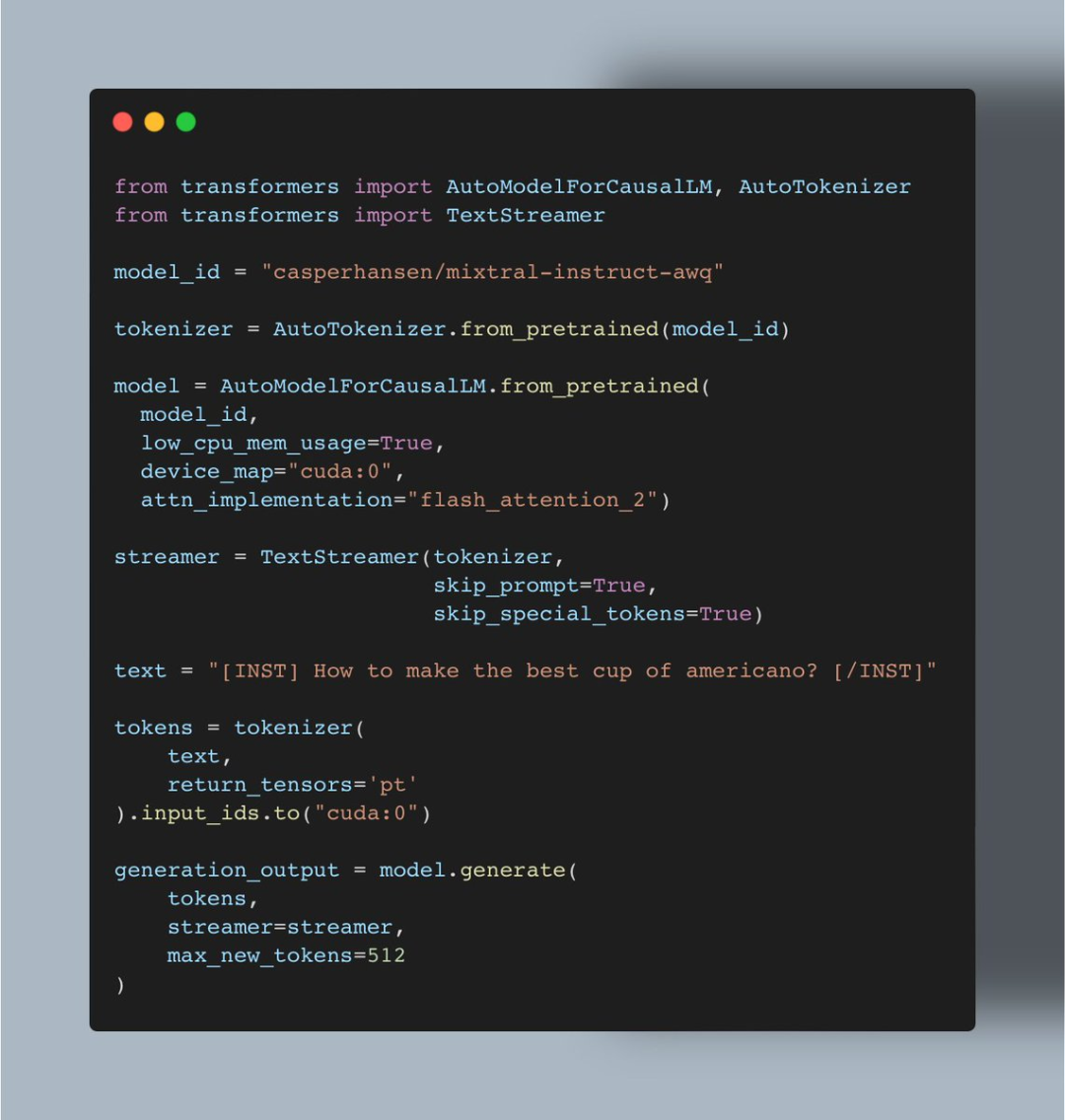

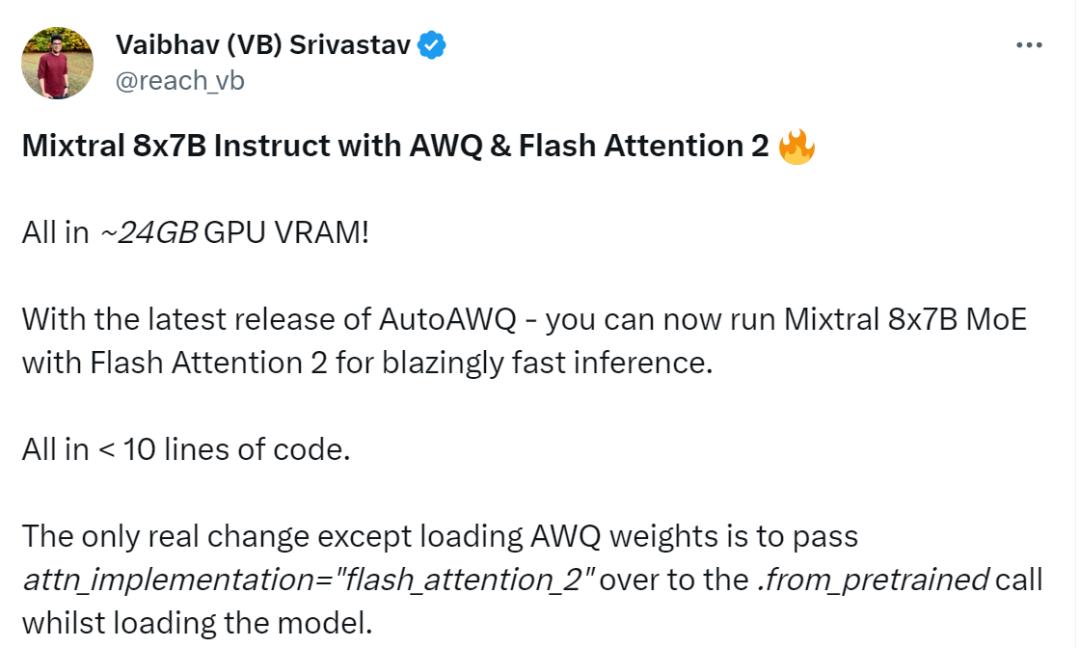

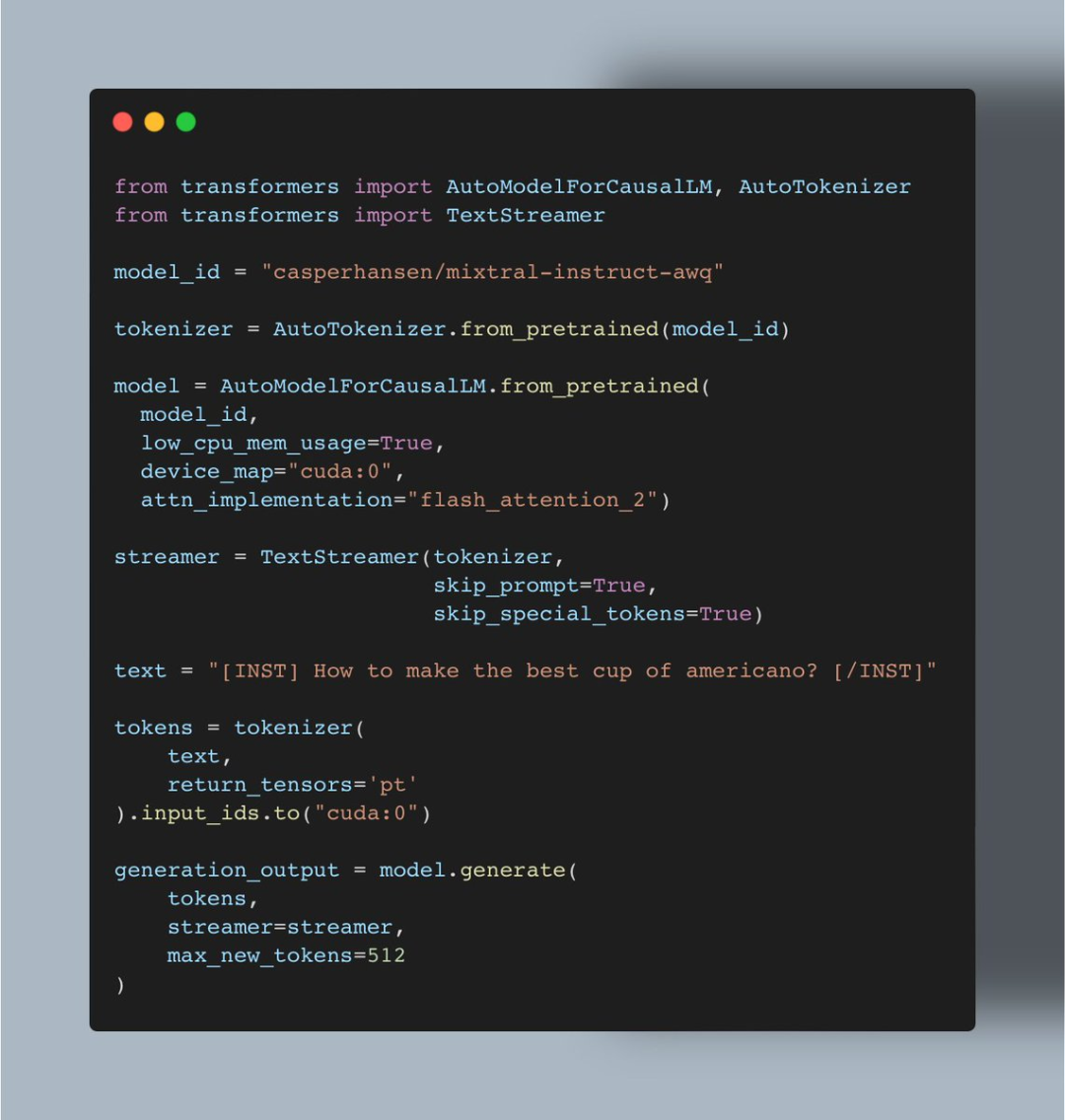

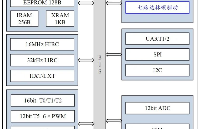

短短幾周的時間,機器學習愛好者 Vaibhav (VB) Srivastav 表示:隨著 AutoAWQ(支持 Mixtral、LLaVa 等模型的量化)最新版本的發布,現在用戶可以將 Mixtral 8x7B Instruct 與 Flash Attention 2 結合使用,達到快速推理的目的,實現這一功能大約只需 24GB GPU VRAM、不到十行代碼。

▲圖源 https://twitter.com/reach_vb/status/1741175347821883502

▲圖源 https://twitter.com/reach_vb/status/1741175347821883502

AutoAWQ地址:

https://github.com/casper-hansen/AutoAWQ 操作過程是這樣的: 首先是安裝 AutoAWQ 以及 transformers:

pipinstallautoawqgit+https://github.com/huggingface/transformers.git

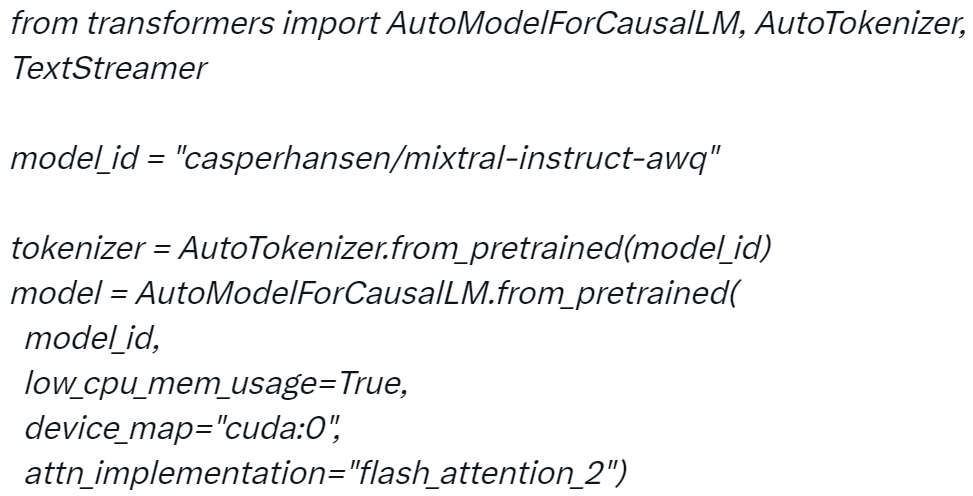

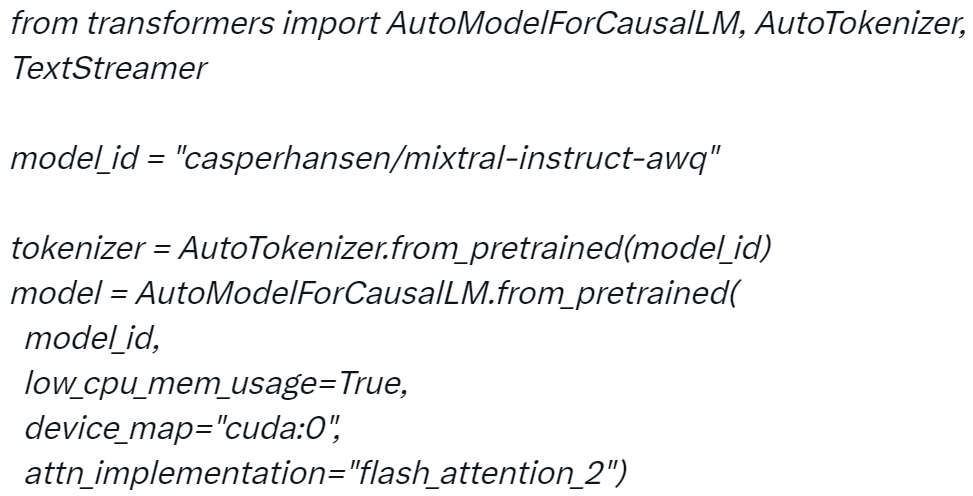

第二步是初始化 tokenizer 和模型:

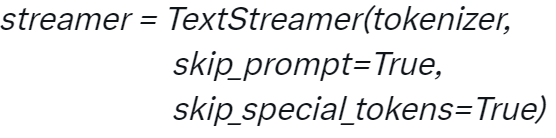

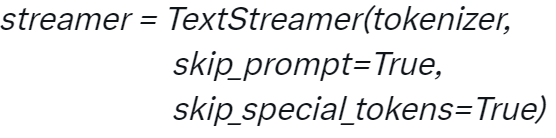

?第三步是初始化 TextStreamer:

?第三步是初始化 TextStreamer:

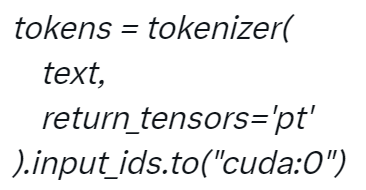

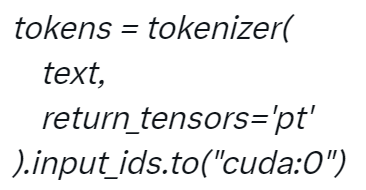

?第四步對輸入進行 Token 化:

?第四步對輸入進行 Token 化:

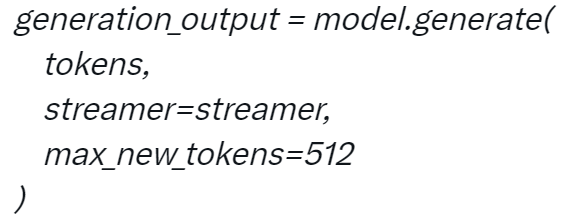

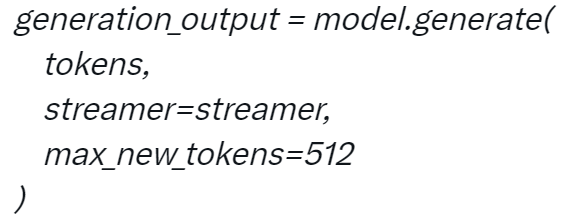

?第五步生成:

?第五步生成:

?當你配置好項目后,就可以與 Mixtral 進行對話,例如對于用戶要求「如何做出最好的美式咖啡?通過簡單的步驟完成」,Mixtral 會按照 1、2、3 等步驟進行回答。

?當你配置好項目后,就可以與 Mixtral 進行對話,例如對于用戶要求「如何做出最好的美式咖啡?通過簡單的步驟完成」,Mixtral 會按照 1、2、3 等步驟進行回答。

項目中使用的代碼:

Srivastav 表示上述實現也意味著用戶可以使用 AWQ 運行所有的 Mixtral 微調,并使用 Flash Attention 2 來提升它們。 看到這項研究后,網友不禁表示:真的很酷。

?

?

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

代碼

+關注

關注

30文章

4968瀏覽量

73970 -

GPT

+關注

關注

0文章

368瀏覽量

16873 -

OpenAI

+關注

關注

9文章

1245瀏覽量

10072

原文標題:8x7B MoE與Flash Attention 2結合,不到10行代碼實現快速推理

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

熱點推薦

階躍星辰開源Step 3.5 Flash,多家國產芯片廠商完成適配

。 ? Step 3.5 Flash模型聚焦于實時Agent工作流場景,采用稀疏MoE架構,總參數量高達1960億,不過每個token僅激活約110億參數。這種設計旨在兼顧推理速度與使用成本,為智能體(Agent)提供穩定可靠且

如何正確配置AG32 MCU,實現FLASH或者代碼加密?

的SDK資料:海振遠科技為客戶提供豐富的開發資料和多款開發板可以選擇,方便用戶快速上手設計。

2、開發板資源:

二、如何正確配置AG32 MCU,實現FLASH或者

發表于 01-22 15:01

今日看點:小米正式發布并開源新模型 MiMo-V2-Flash;磷酸鐵鋰開啟漲價潮

(激活15B)的 MoE 模型,通過引入 Hybrid 注意力架構創新 及 多層 MTP 推理加速,在多個 Agent 測評基準上進入全球開源模型 Top 2;

Qwen3-VL 4B/8B全面適配,BM1684X成邊緣最佳部署平臺!

算能BM1684X上完成Qwen3-VL4B/8B模型的適配,推理速度13.7/7.2tokens/s,使其成為邊緣部署多模態大模型的最佳選擇。近日,阿里千問正式開源Qwen3-VL系

【「DeepSeek 核心技術揭秘」閱讀體驗】基于MOE混合專家模型的學習和思考-2

= F.softmax(self.gate(x), dim=-1) # 這就是公式中的 p_i^c

# 2. 計算每個專家的輸出

expert_outputs = []

for expert

發表于 08-23 17:00

杭州靈汐類腦智算集群實現大模型快速推理

據悉,“杭州靈汐類腦智算集群”已于7月底實現了大模型快速推理API的企業服務試運行。該集群由杭州靈汐類腦科技有限公司牽頭搭建運營,中國電信、中國電子科技南湖研究院以及腦啟社區作為合作方

華為宣布開源盤古7B稠密和72B混合專家模型

關鍵一步,為全球開發者、企業及研究人員提供了強大的技術支撐。 ? 華為此次開源行動涵蓋三大核心板塊:盤古Pro MoE 72B模型權重與基礎推理代碼已率先上線開源平臺;基于昇騰的超大規

華為正式開源盤古7B稠密和72B混合專家模型

關鍵舉措,推動大模型技術的研究與創新發展,加速推進人工智能在千行百業的應用與價值創造。 盤古Pro MoE 72B模型權重、基礎推理代碼,已

帶增益的 RX 分集 FEM(B26、B8、B20、B1/4、B3 和 B7) skyworksinc

電子發燒友網為你提供()帶增益的 RX 分集 FEM(B26、B8、B20、B1/4、B3 和 B7

發表于 06-27 18:31

具有載波聚合的 RX 分集 FEM(B26、B8、B12/13、B2/25、B4 和 B7) skyworksinc

電子發燒友網為你提供()具有載波聚合的 RX 分集 FEM(B26、B8、B12/13、B2/25、B4 和

發表于 06-19 18:35

潤和軟件StackRUNS異構分布式推理框架的應用案例

江蘇潤和軟件股份有限公司(以下簡稱“潤和軟件”)自主研發的StackRUNS異構分布式推理框架已在實際場景中取得顯著成效,成功應用于大型園區多模態模型演練及高校滿血版DeepSeek-MoE 671B的運行,有效推動了大模型技術

代碼革命的先鋒:aiXcoder-7B模型介紹

? ? 國內開源代碼大模型 4月9日aiXcoder宣布正式開源其7B模型Base版,僅僅過去一個禮拜,aiXcoder-7B在軟件源代碼托管服務平臺GitHub上的Star數已超過

基于小凌派RK2206開發板:OpenHarmony如何使用IoT接口控制FLASH外設

] = a

[7] = a

[8] = a

[9] = a

[10] = a

[11] = a

[12] = a

[13] = a

[14] = a

[15] = a

Fla

發表于 04-22 15:02

基于1F1B的MoE A2A通信計算Overlap

在 MoE 模型的訓練過程中,EP rank 之間的 A2A 通信在端到端時間中占據了相當大比重,對訓練效率影響很大,特別是對于 Fine-grained MoE model,EP size 會比較大,跨機通信基本無法避免。那么

8x7B MoE與Flash Attention 2結合,不到10行代碼實現快速推理

8x7B MoE與Flash Attention 2結合,不到10行代碼實現快速推理

評論