雖然,從小型客車到多軸半掛卡車,自動駕駛汽車 (AV) 有各種尺寸和大小,但部署在這些車輛上的感知算法都要經過訓練,以處理諸如避障或行人檢測等類似場景。

用于開發和驗證這些算法的數據集通常從某一款車型中收集,例如配備攝像頭、雷達、激光雷達和超聲波傳感器的某款小轎車。

使用某類傳感器配置的車隊數據訓練的感知算法可以在同類傳感器配置的車型上穩定運行。但當相同的算法被部署到使用了不同傳感器配置的車輛上時,感知性能會降低,因為現在是從新的視角來感知的。

分析感知精度的損失,需要測量深度神經網絡 (DNN) 對新傳感器位置的敏感度。通過靈敏度分析,可以從多個角度重新訓練感知算法,從而有針對性地提高魯棒性。

但是,靈敏度分析和重新訓練感知都需要收集和標注各種傳感器配置的數據集。這個過程耗時且成本高昂。

本文展示了 NVIDIA DRIVE Sim 中的合成數據集以及 NVIDIA 在新視角合成 (NVS) 方面的最新研究如何填補數據缺口,并幫助在部署新傳感器配置時保持感知準確性。

測量 DNN 靈敏度

在為不同傳感器視角創建合成數據集之前,首先需要在 NVIDIA DRIVE Sim 中構建數字孿生的測試車隊車輛,并配備經過與真實世界的傳感器配置標定的攝像頭傳感器模型。

合成數據是通過在預定義場景中按照某個軌跡駕駛汽車,收集并保存仿真攝像頭數據。每次駕駛的場景各不相同,例如傳感器裝備高度、俯沖和安裝位置等方面,以模擬其他尺寸類型的車輛。

通過使用 NVIDIA Omniverse Replicator 在 Omniverse 中生成真值 (Ground Truth, GT) 標注(如 3D 邊界框)和評估感知算法所需的目標類別。整個工作流都是可重復的,并且能夠運行設計好的實驗,以便快速測量感知算法的靈敏度。

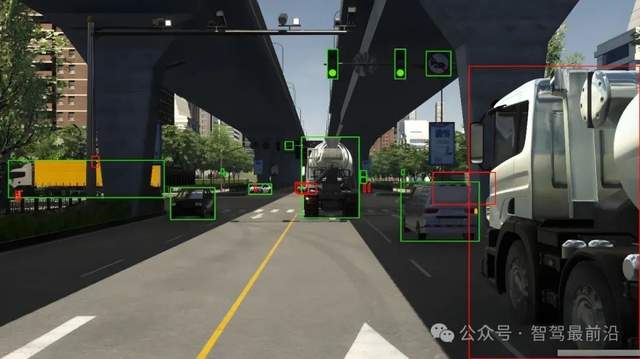

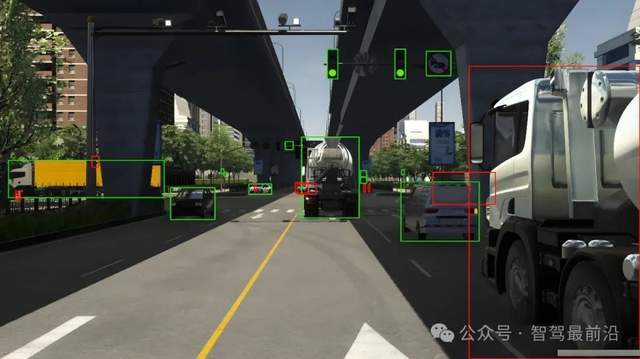

在生成的數據集做推理,將預測的輸出與 GT 標簽進行比較,用以測量在不同攝像頭高度配置下的模型精度,如圖 1 和 圖 2 所示。數據集的場景相同,但傳感器角度不同。在圖 1 中,藍色框代表 GT 標簽,而綠色框代表網絡的預測。在圖 2 中,藍色框代表 GT 標簽,而紅色框代表網絡的預測。

圖 1. 目標檢測模型

在四個不同的合成數據集上運行的示例,

重點關注車輛物體類別

圖 2. 目標檢測模型

在四個不同的合成數據集上運行的示例,

重點關注行人物體類

鑒于網絡是基于一類車輛采集數據進行訓練的,因此(與采集車)相似的攝像頭配置,檢測會更準確,隨著攝像頭位置的顯著變化而檢測性能降低。

要解決感知模型在新車型上部署的差距,需要視角不同于原始采集車的新車型的訓練數據集。雖然現有的車隊數據可通過數據增強來使用,但這種方法并不能完全滿足數據集收集新視角的需求。

新視角合成

NVS 是一種計算機視覺方法,用于從一組現有圖像中生成未見過的新場景視圖。這項功能可以從不同視角或角度創建場景圖像,而不是由車載相機捕獲。

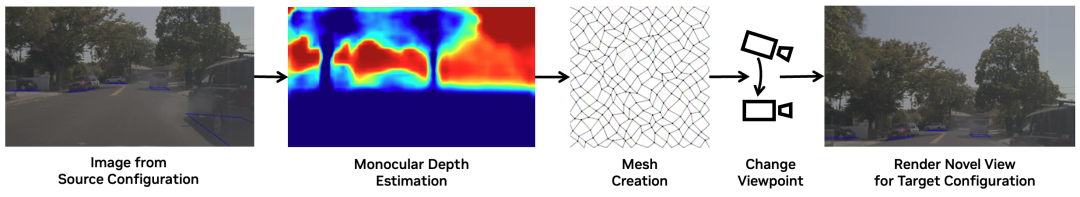

圖 3. 新視角合成的完整管線

NVIDIA 研究團隊最近提出了一種 NVS 方法,該方法能夠將動態駕駛數據從一個傳感器位置轉換到新視角,用于模擬不同的高度、俯仰角 (pitch) 和航向角 (yaw) 等傳感器的新視角。有關詳細信息,請參閱 Towards Viewpoint Robustness in Bird’s Eye View Segmentation。

(https://nvlabs.github.io/viewpoint-robustness/assets/tzofi2023view.pdf)

該方法基于 Worldsheet,一種結合深度估計和 3D 網格合成來生成靜態場景新視角的技術。首先,根據預測的深度值將Lattice網格變形以匹配場景,從而創建 3D 場景網格。然后,使用紋理采樣器將原始圖像中的 RGB 像素強度投射到 3D 網格的紋理圖上。相比之前的工作,進一步采用基于激光雷達的深度監督和自動掩碼來提高深度估計的準確性并處理遮擋問題。

NVS 模型現在可用于生成數據,就像是從不同類型的車輛中獲取的一樣。從而能幫助解鎖現有車隊數據,以便在未來的自動駕駛汽車開發中使用。

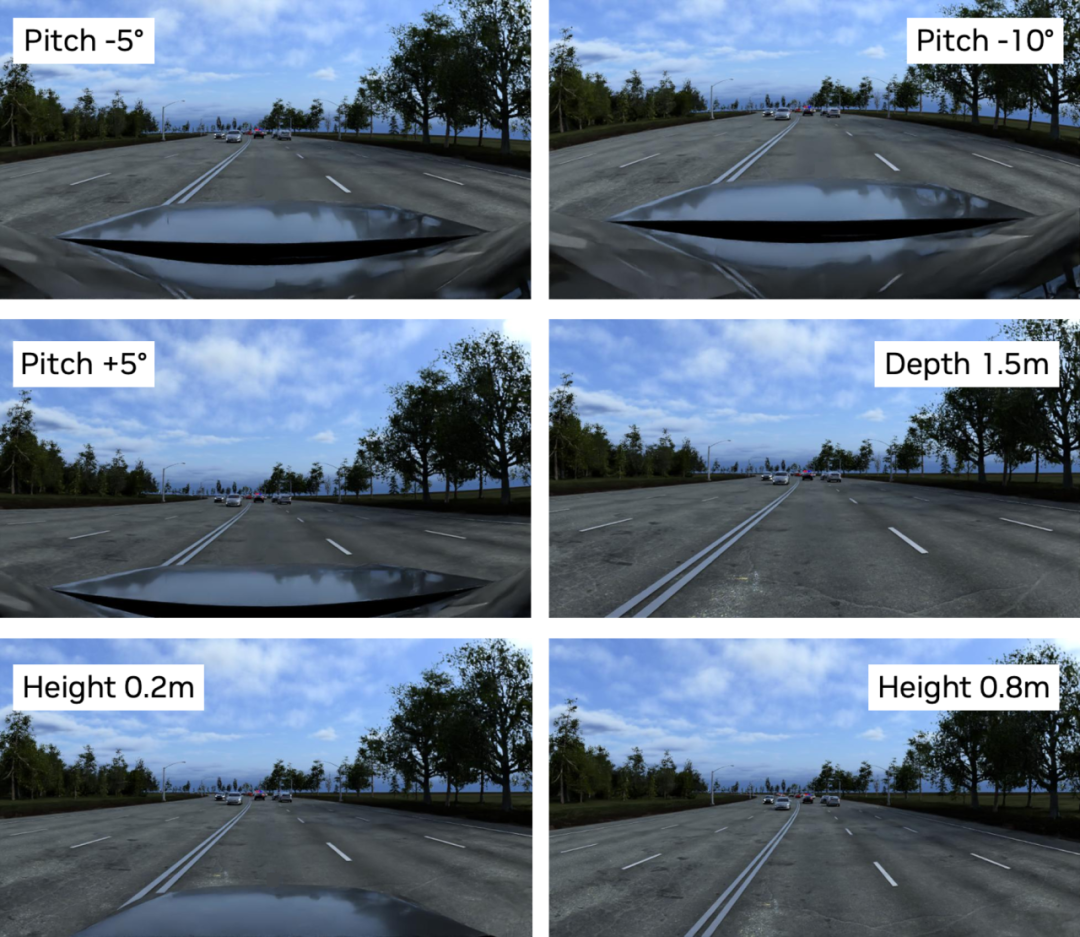

圖 4. NVS 變換后的圖像示例,這些圖像生成的視角會改變原始俯仰角、深度和高度

驗證 NVS 并提升感知性能

在將 NVS 生成的數據納入訓練數據集之前,首先要驗證其是否準確的反映了真實世界,并且是否對感知訓練有效。

為此,驗證 NVS 算法需要結合車隊數據和 NVS 轉換后的數據來訓練感知算法。如果沒有多視角的真實數據來測試模型的性能,可以在 DRIVE Sim 中生成合成數據和 GT 標注,與前面討論的靈敏度測試類似。

圖 5. 在 DRIVE Sim 中生成的一組用于感知驗證的具有不同俯仰角、深度和高度的攝像頭圖像

在這些合成數據集上做推理表明,使用 NVS 生成的數據進行訓練可以提高感知性能。具體而言:

-

NVS 生成的數據質量非常合適用于不同俯仰角場景,不適用于較大高度的場景。

-

用于訓練的 NVS 轉換數據能夠恢復感知性能,而這曾只有通過為每個新傳感器配置收集新數據才能實現。

這種方法開啟了一種 AV 開發新途徑,即只需一次數據采集,然后再將其重新用于多種車型,從而顯著降低部署成本和時間。

結語

開發能夠在不同類型車輛上魯棒的運行的感知堆棧是一項巨大的數據挑戰。而合成數據生成和用于新視角合成 (NVS) 的 AI 技術能夠實現感知靈敏度的系統測量。這大大提高了現有數據集的價值,并縮短了為其他車輛部署感知堆棧的時間。

我們邀請了廣大研究人員參與這項工作。因此,我們在 Towards Viewpoint Robustness in Bird’s Eye View Segmentation 中公布了來自 DRIVE Sim 的合成數據:

https://nvlabs.github.io/viewpoint-robustness/assets/tzofi2023view.pdf

歡迎探索這些數據并了解詳情:

https://nvlabs.github.io/viewpoint-robustness/

點擊“閱讀原文”,獲取更多資訊。

了解更多

-

NVIDIA 與其汽車行業合作伙伴共同開發的領先設計與技術:

https://developer.nvidia.cn/drive

-

適用于自動駕駛汽車的 NVIDIA 解決方案:

https://www.nvidia.cn/self-driving-cars/

GTC 2024 將于 2024 年 3 月 18 至 21 日在美國加州圣何塞會議中心舉行,線上大會也將同期開放。掃描下方海報二維碼,立即注冊 GTC 大會。

原文標題:使用合成數據處理自動駕駛新視角感知

文章出處:【微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

-

英偉達

+關注

關注

23文章

4087瀏覽量

99192

原文標題:使用合成數據處理自動駕駛新視角感知

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

自動駕駛如何確保數據處理的實時性?

FCB-EV9520L+CM2001U如何破解自動駕駛視覺難題?

自動駕駛BEV Camera數據采集系統:高精度時間同步解決方案

自動駕駛BEV Camera數據采集:時間同步技術解析與康謀解決方案

如何確保自動駕駛汽車感知的準確性?

什么是自動駕駛數據標注?如何好做數據標注?

SONY FCB-CR8530,如何重塑自動駕駛視覺感知格局?

淺析4D-bev標注技術在自動駕駛領域的重要性

新能源車軟件單元測試深度解析:自動駕駛系統視角

技術分享 | 高逼真合成數據助力智駕“看得更準、學得更快”

感知融合如何讓自動駕駛汽車“看”世界更清晰?

使用合成數據處理自動駕駛新視角感知

使用合成數據處理自動駕駛新視角感知

評論