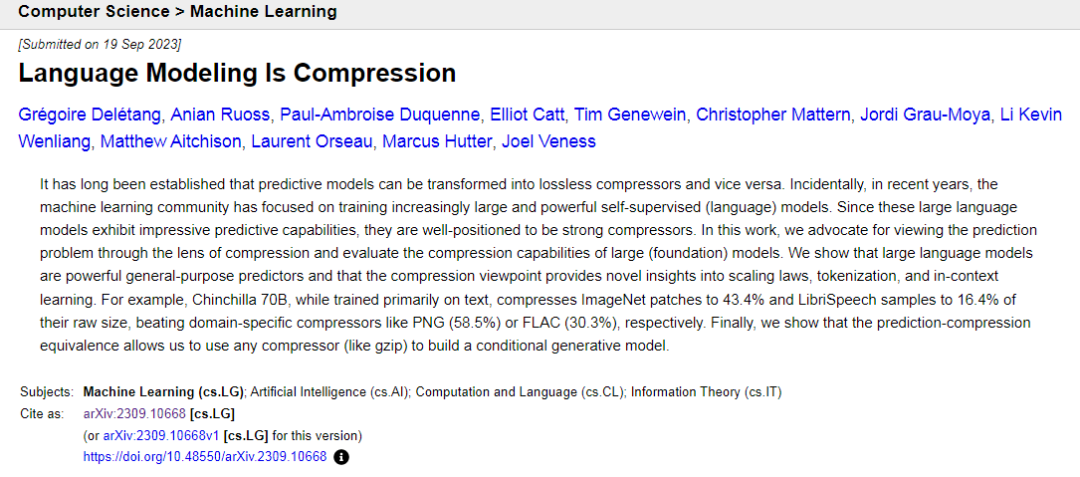

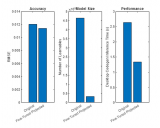

Google DeepMind 和 Meta 的研究人員發表論文《Language Modeling Is Compression》,他們發現 DeepMind 的大語言模型 Chinchilla 70B 在圖像和音頻的無損壓縮上超過了 PNG 和 FLAC。

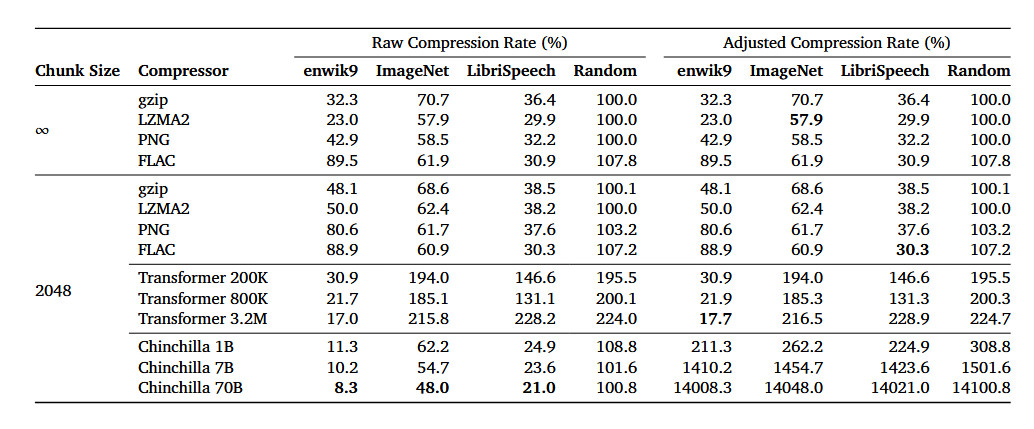

論文提到,Chinchilla 70B 能將 ImageNet 圖像數據庫中的圖像無損壓縮到原始大小 43.4%,超過了 PNG 算法的 58.5%。

Chinchilla 能將 LibriSpeech 音頻數據集中的樣本無損壓縮到原始大小 16.4%,超過 FLAC 算法的 30.3%。

據介紹,Chinchilla 70B 主要是訓練用于處理文本,但它在壓縮其它類型的數據集上的效果也表現優異,甚至優于專門的算法。

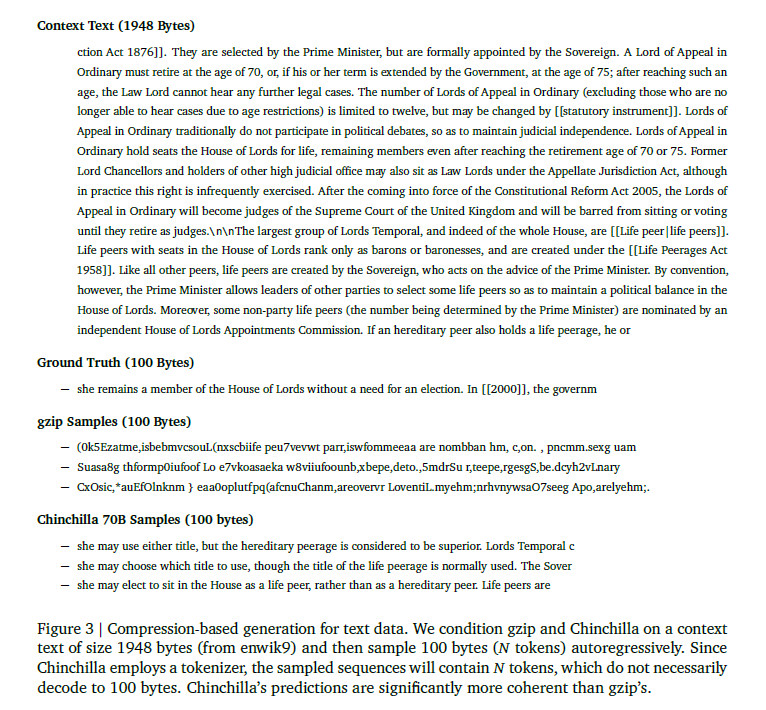

下面的例子比較了 gzip 和 Chinchilla 在示例文本上的壓縮效果。可以看到,gzip 的輸出沒有可讀性。

編輯:黃飛

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

無損壓縮

+關注

關注

0文章

12瀏覽量

8607 -

FLAC

+關注

關注

0文章

4瀏覽量

8767 -

png

+關注

關注

0文章

14瀏覽量

4713 -

大模型

+關注

關注

2文章

3726瀏覽量

5257

原文標題:大模型在無損壓縮方面超越PNG和FLAC

文章出處:【微信號:OSC開源社區,微信公眾號:OSC開源社區】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

熱點推薦

面向嵌入式部署的神經網絡優化:模型壓縮深度解析

1.為什么需要神經網絡模型壓縮? 神經網絡已經成為解決復雜機器學習問題的強大工具。然而,這種能力往往伴隨著模型規模和計算復雜度的增加。當輸入維度較大(例如長時序窗口、高分辨率特征空間)時,模型

在AI基礎設施中部署大語言模型的三大舉措

文:Gartner研究副總裁周玲中國企業機構已逐步在生產環境中運行或者計劃運行大語言模型,但在AI基礎設施的生產部署與高效運營方面仍面臨諸多挑戰。目前,中國正加速提升其生成式AI能力,覆蓋大語

什么是大模型,智能體...?大模型100問,快速全面了解!

一、概念篇1.什么是大模型?大模型是指參數規模巨大(通常達到數十億甚至萬億級別)、使用海量數據訓練而成的人工智能模型。2.什么是大語言模型(

linux的壓縮和解壓操作

進行壓縮,然后傳輸壓縮的文件,這樣可以減少文件傳輸所需要的帶寬和時間,在網絡接收到文件之后再解壓,就可以得到文件了。

文件的壓縮有兩種方式:有損壓縮和

發表于 12-23 06:56

電能質量在線監測裝置數據壓縮對裝置性能有哪些影響?

降至工業級可接受范圍, 不會影響核心監測功能(如采樣精度、故障響應) 。以下是分維度的專業解析: 一、核心性能影響維度(分裝置定位 + 壓縮類型) 1. CPU 占用:硬件加速是關鍵,無損壓縮影響極小 數據壓縮 / 解壓本質是計

電能質量在線監測裝置支持哪些數據壓縮算法?

電能質量在線監測裝置支持 無損壓縮 和 有損壓縮 兩大類算法,適配不同數據類型(實時數據、歷史數據、波形數據)與應用場景(存儲 / 傳輸 / 故障追溯),且在基礎型、增強型、電網級裝置中支持力度逐步

國慶出國游,時空壺新T1翻譯機,首個端側模型突破助力跨語言交流

的旗艦機型,最大亮點是搭載業內首個端側AI翻譯模型。這一模型將原本依賴云端算力的復雜AI翻譯模型,通過先進的模型剪枝、量化壓縮等技術,巧妙部

3萬字長文!深度解析大語言模型LLM原理

我們正在參加全球電子成就獎的評選,歡迎大家幫我們投票~~~謝謝支持本文轉自:騰訊技術工程作者:royceshao大語言模型LLM的精妙之處在于很好地利用數學解決了工業場景的問題,筆者基于過往工程經驗

利用自壓縮實現大型語言模型高效縮減

隨著語言模型規模日益龐大,設備端推理變得越來越緩慢且耗能巨大。一個直接且效果出人意料的解決方案是剪除那些對任務貢獻甚微的完整通道(channel)。我們早期的研究提出了一種訓練階段的方法——自壓縮

歐洲借助NVIDIA Nemotron優化主權大語言模型

NVIDIA 正攜手歐洲和中東的模型構建商與云提供商,共同優化主權大語言模型 (LLM),加速該地區各行業采用企業級 AI。

小白學大模型:從零實現 LLM語言模型

在當今人工智能領域,大型語言模型(LLM)的開發已經成為一個熱門話題。這些模型通過學習大量的文本數據,能夠生成自然語言文本,完成各種復雜的任務,如寫作、翻譯、問答等。https

如何借助大語言模型打造人工智能生態系統

大語言模型(LLMs)正以革命性的姿態重塑我們與科技的互動模式。然而,由于其龐大的規模,它們往往屬于資源密集型范疇,不僅大幅推高了成本,還造成了能源消耗的激增。本文深入剖析了大語言模型

大語言模型無損壓縮方面超越PNG和FLAC

大語言模型無損壓縮方面超越PNG和FLAC

評論