基礎模型和高性能數(shù)據(jù)層這兩個基本組件始終是創(chuàng)建高效、可擴展語言模型應用的關(guān)鍵,利用Redis搭建大語言模型,能夠?qū)崿F(xiàn)高效可擴展的語義搜索、檢索增強生成、LLM 緩存機制、LLM記憶和持久化。有Redis加持的大語言模型可應用于文檔檢索、虛擬購物助手、客戶服務助理等,為企業(yè)帶來益處。

一、語言模型構(gòu)件

應用程序生成、理解和使用人類語言的能力正變得越來越重要,從客服機器人到虛擬助手,再到內(nèi)容生成,人們對AI應用功能的需求橫跨眾多領域,而這一切的實現(xiàn),都要歸功于谷歌的 PaLM 2 等基礎模型,這些模型經(jīng)過精心調(diào)教,可以生成類似人類表達風格的內(nèi)容。

在這一動態(tài)環(huán)境中,基礎模型和高性能數(shù)據(jù)層這兩個基本組件始終是創(chuàng)建高效、可擴展語言模型應用的關(guān)鍵。

1.基礎模型

基礎模型是生成式人工智能應用的基石,大型語言模型(Large Language Model,LLM)是其中的一個子集。 LLM 通過大量的文本訓練,使其能夠為各種任務生成具有上下文相關(guān)性的類似人類表達風格的文本。改進這些模型,使其更加復雜,從而使應用可以更精煉、更有效地響應用戶輸入。所選擇的語言模型會顯著影響應用的性能、成本和服務質(zhì)量。

然而,PaLM 2 等模型雖然功能強大,但也有其局限性,例如當缺乏特定領域的數(shù)據(jù)時,模型可能不夠相關(guān),而且可能無法及時呈現(xiàn)新信息或準確信息。 LLM 在提示(prompts)中可以處理的上下文長度(即詞組數(shù)量)有硬性限制,此外,LLM 的訓練或微調(diào)需要大量的計算資源,這會使成本劇增。要在這些限制和優(yōu)勢之間取得平衡,需要進行謹慎的策略和強大基礎設施的支持。

2.高性能的數(shù)據(jù)層

高效的LLM 應用程序由可擴展的高性能數(shù)據(jù)層支撐,該組件可確保高速交易和低延遲,這對于保持用戶流暢交互至關(guān)重要。它在以下方面發(fā)揮關(guān)鍵作用:

·緩存預計算的請求響應或嵌入

·對過去的交互歷史進行持久化

·進行語義搜索以檢索相關(guān)的上下文或知識

向量數(shù)據(jù)庫已成為一種流行的數(shù)據(jù)層解決方案。Redis 在向量搜索方面的投入遠遠早于當下的向量數(shù)據(jù)庫熱潮,這反映了我們具有豐富的經(jīng)驗,尤其是在性能方面。Redis對于向量搜索的經(jīng)驗在剛剛發(fā)布的 Redis 7.2 版本中得到了體現(xiàn),該版本包括可擴展搜索功能預覽,與前一版本相比,每秒查詢次數(shù)提高了16倍。

基礎模型和向量數(shù)據(jù)庫在不同行業(yè)的LLM 應用中發(fā)揮著至關(guān)重要的作用,因此引發(fā)了業(yè)界的極大興趣和炒作。例如,一些較新的獨立向量數(shù)據(jù)庫解決方案(如 Pinecone)宣布獲得巨額融資,并投入大量精力以贏得開發(fā)人員的關(guān)注。然而,由于每周都有新的工具出現(xiàn),因此很難知道哪款工具真的能滿足企業(yè)需求。

GCP (Google’s Google Cloud Platform)的與眾不同之處在于其統(tǒng)一的產(chǎn)品,它將功能強大的基礎模型、可擴展的基礎設施,以及一套用于調(diào)整、部署和維護這些模型的工具結(jié)合在一起,從而能夠確保最高級別的數(shù)據(jù)安全和隱私安全。

但是,要真正發(fā)揮這些進展的潛力,一個高性能且可擴展的數(shù)據(jù)層是不可或缺的,這就是Redis的作用所在。

3.可擴展語言模型應用的推理架構(gòu)

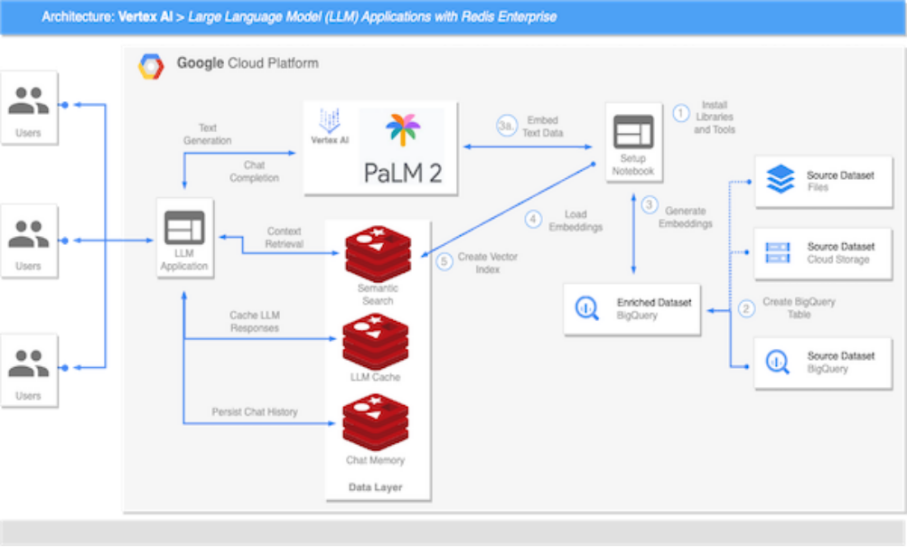

GCP 和 Redis Enterprise 用于語言模型應用的推理架構(gòu)

這里所呈現(xiàn)的推理架構(gòu)適用于通用語言模型用例。它結(jié)合使用了Vertex AI(PaLM 2 基礎模型)、BigQuery 和 Redis Enterprise。

GCP 和 Redis Enterprise 用于語言模型應用的推理架構(gòu)。

您可以按照開源 GitHub 倉庫中的Colab 筆記本逐步設置此 LLM 架構(gòu)。

1. 安裝庫和工具: 安裝所需的Python 庫,使用 Vertex AI 進行身份驗證,并創(chuàng)建一個 Redis 數(shù)據(jù)庫。

2. 創(chuàng)建 BigQuery 表格: 將數(shù)據(jù)集加載到您的GCP 項目中的 BigQuery 表格中。

3. 生成文本嵌入: 循環(huán)遍歷數(shù)據(jù)集中的記錄,使用PaLM 2 嵌入 API 創(chuàng)建文本嵌入。

4. 加載嵌入: 將文本嵌入和一些元數(shù)據(jù)加載到運行中的Redis 服務器。

5. 創(chuàng)建向量索引: 運行Redis 命令來創(chuàng)建一個模式和一個新的索引結(jié)構(gòu),以實現(xiàn)實時搜索。

完成必要的設置步驟后,這個架構(gòu)就可以支持多種LLM 應用,如聊天機器人和虛擬購物助手。

二.在語言模型(LLM)應用Redis

即使是經(jīng)驗豐富的軟件開發(fā)人員和應用架構(gòu)師也可能對這個新的知識領域不了解,這個簡短的總結(jié)應該能幫助你迅速掌握要點。

1.利用Redis實現(xiàn)高效可擴展的語義搜索

語義搜索從龐大的知識語料庫中提取語義相似的內(nèi)容。在這個過程中,知識被轉(zhuǎn)化為可以進行比較的數(shù)值嵌入向量,以找到與用戶查詢最相關(guān)的上下文信息。

Redis 作為高性能向量數(shù)據(jù)庫,擅長索引非結(jié)構(gòu)化數(shù)據(jù),從而實現(xiàn)高效可擴展的語義搜索。Redis 可以增強應用程序迅速理解和響應用戶查詢的能力,其強大的搜索索引能力有助于實現(xiàn)響應迅速和準確的用戶交互。

** 2.利用Redis實現(xiàn)檢索增強生成**

檢索增強生成(Retrieval-Augmented Generation,RAG)方法利用語義搜索等方法,在將提示發(fā)送到 LLM 之前動態(tài)地注入事實知識。這種技術(shù)最大程度上減少了在專有或頻繁變動的數(shù)據(jù)上對 LLM 進行微調(diào)的需求。RAG 允許對 LLM 進行上下文增強,使其能夠更好地處理當前的任務,例如回答具體問題、總結(jié)檢索內(nèi)容或生成新內(nèi)容。

作為向量數(shù)據(jù)庫和全文搜索引擎,Redis 有助于 RAG 工作流的順暢運行。由于其低延遲的數(shù)據(jù)檢索能力,Redis 常常是執(zhí)行此任務的首選工具。它確保語言模型迅速而準確地獲得所需的上下文,促進了人工智能應用高效的執(zhí)行任務。 檢索增強生成(RAG)架構(gòu)示例

檢索增強生成(RAG)架構(gòu)示例

3.利用Redis實現(xiàn)LLM 的緩存機制

緩存是增強LLM 響應能力和計算效率的強大技術(shù)手段。

標準緩存提供了一種機制,用于存儲并快速檢索預生成的常見查詢響應,從而降低計算負載和響應時間。然而,在動態(tài)對話背景中使用人類語言時,完全匹配的查詢很少,這就是語義緩存發(fā)揮作用的地方。

語義緩存可以理解并利用查詢的潛在語義。語義緩存識別并檢索與輸入查詢在語義上足夠相似的緩存響應。這種能力極大地增加了緩存命中率,進一步改善了響應時間和資源利用率。

例如,在客戶服務場景中,多個用戶可能會使用不同的措辭詢問類似的常見問題。語義緩存使得LLM 能夠在不進行冗余計算的情況下迅速而準確地回應這些問題。 LLM緩存機制

LLM緩存機制

Redis 非常適用于在 LLM 中實現(xiàn)緩存,其強大的功能集包括支持生存時間(TTL)和逐出策略,用于管理臨時數(shù)據(jù)。結(jié)合其向量數(shù)據(jù)庫的語義搜索能力,Redis 能夠高效快速地檢索緩存響應,從而顯著提升 LLM 的響應速度和系統(tǒng)整體性能,即使在負載較重的情況下也能如此。

4.利用Redis實現(xiàn)內(nèi)存和持久化

保留過去的互動和會話元數(shù)據(jù)對于確保上下文連貫和個性化對話至關(guān)重要,然而LLM 并沒有自適應記憶,因此依賴一個可靠的系統(tǒng)進行快速的對話數(shù)據(jù)存儲變得至關(guān)重要。

Redis 提供了一個強大的解決方案,用于管理 LLM 的記憶。它可以在大量需求下高效地訪問聊天歷史和會話元數(shù)據(jù)。Redis使用其數(shù)據(jù)結(jié)構(gòu)存儲來處理傳統(tǒng)的內(nèi)存管理,同時其向量數(shù)據(jù)庫功能有助于提取語義相關(guān)的互動內(nèi)容。

三、LLM 的應用場景

1.文檔檢索

一些企業(yè)需要處理大量的文檔,而LLM 應用可以成為文檔發(fā)現(xiàn)和檢索的強大工具,語義搜索有助于從廣泛的知識語料庫中精確定位相關(guān)信息。

2.虛擬購物助手

LLM 可以支持復雜的電子商務虛擬購物助手,通過上下文理解和語義搜索,它可以理解客戶的問題,提供個性化的產(chǎn)品推薦,甚至實時模擬對話互動。

3.客戶服務助理

將LLM 部署為客戶服務代理可以徹底改變客戶互動方式,除了回答常見問題外,系統(tǒng)還可以進行復雜的對話,為客戶提供定制化的幫助,并從過去的客戶互動中進行學習。

四.Redis 和 Google Cloud:強強聯(lián)合

1.基于知識

GCP 和 Redis 讓 LLM 應用不僅僅是先進的文本生成器,通過在運行時迅速注入來自您自己領域的特定知識,它們確保您的應用可以提供基于知識、準確和有價值的交互,特別適應于您的組織知識庫。

2.簡化架構(gòu)

Redis 不僅僅是一個鍵值數(shù)據(jù)庫,它是實時數(shù)據(jù)的多功能工具,通過消除為不同用例管理多個服務的需求,它極大地簡化了您的體系架構(gòu)。作為許多組織已經(jīng)信任的緩存和其他需求的工具,Redis 在 LLM 應用中的集成起到了無縫擴展的效果。

3.優(yōu)化性能

Redis 是低延遲和高吞吐量數(shù)據(jù)結(jié)構(gòu)的代名詞。當與具有超強計算能力的GCP結(jié)合時 ,您將擁有一個不僅智能而且響應迅速的 LLM 應用,即使在負載較重的情況下也能如此。

4.企業(yè)級能力

Redis是經(jīng)過時間驗證的開源數(shù)據(jù)庫核心,可為全球財富100強公司提供可靠服務。在Redis Enterprise提供的五個九(99.999%)可用性的支持下,并由 GCP 強大的基礎架構(gòu)提供支持,您可以完全信任其可以完全滿足企業(yè)需求。

5.加速上市進程

利用Redis Enterprise,您可以更專注于創(chuàng)建 LLM 應用,而不必費心進行數(shù)據(jù)庫設置。這種集成的便利性加速了上市進程,為您的組織提供了競爭優(yōu)勢。

盡管新的向量數(shù)據(jù)庫和生成式AI 產(chǎn)品可能在市場上引起了很大的關(guān)注,但是 GCP 和 Redis 的可靠組合更加值得信任。這些經(jīng)過時間驗證的解決方案不會很快消失,它們已經(jīng)準備好為您的 LLM 應用提供動力,無論是今天還是未來的數(shù)年。

虹科是Redis原廠的中國區(qū)戰(zhàn)略合作伙伴。我們持續(xù)關(guān)注各行業(yè)當下急切需求,專注于為企業(yè)解答疑問,制定專屬服務,提供一站式數(shù)據(jù)庫和商業(yè)智能解決方案。了解更多【企業(yè)級數(shù)據(jù)庫解決方案】及【企業(yè)緩存指南】,歡迎前往虹科云科技官網(wǎng)!

虹科云科技 ,主要分享企業(yè)級云解決方案,包括云計算、數(shù)據(jù)庫、商業(yè)智能、數(shù)據(jù)可視化、高性能計算、數(shù)據(jù)管理、人工智能等相關(guān)知識、產(chǎn)品信息、應用案例及行業(yè)信息,如Redis Enterprise、Weka、Domo、Visokio、Nimibix等,為學習者傳輸前沿知識、為技術(shù)工程師解答專業(yè)問題、為企業(yè)找到最適合的云解決方案!

審核編輯 黃宇

-

AI

+關(guān)注

關(guān)注

91文章

39755瀏覽量

301349 -

語言模型

+關(guān)注

關(guān)注

0文章

571瀏覽量

11310 -

LLM

+關(guān)注

關(guān)注

1文章

346瀏覽量

1329

發(fā)布評論請先 登錄

虹科動態(tài) | 2026年1月精彩回顧

虹科動態(tài) | 2025年12月精彩回顧

泰凌微:布局端側(cè)AI,產(chǎn)品支持谷歌LiteRT、TVM開源模型

軟通動力榮膺螞蟻數(shù)科“領航AI Agent合作伙伴”

虹科動態(tài) | 虹科×長城汽車技術(shù)交流日圓滿落幕!

谷歌AlphaEarth和維智時空AI大模型的核心差異

谷歌AlphaEarth和維智時空AI大模型的技術(shù)路徑

虹科動態(tài) | 2025年8月精彩回顧

虹科分享 | 谷歌Vertex AI平臺使用Redis搭建大語言模型

虹科分享 | 谷歌Vertex AI平臺使用Redis搭建大語言模型

評論