華為盤(pán)古大模型

華為盤(pán)古代模型的技術(shù)優(yōu)勢(shì)主要體現(xiàn)在以下幾個(gè)方面:

(1)大規(guī)模預(yù)訓(xùn)練:華為盤(pán)古大模型采用了大規(guī)模預(yù)訓(xùn)練的方法,通過(guò)對(duì)大量的中文語(yǔ)料進(jìn)行預(yù)訓(xùn)練,使模型具有更強(qiáng)的泛化能力和適應(yīng)能力。

(2)多任務(wù)學(xué)習(xí):華為盤(pán)古大模型采用多任務(wù)學(xué)習(xí)方法,多任務(wù)同時(shí)訓(xùn)練,在多種工作中表現(xiàn)出更好的性能。

(3)知識(shí)蒸餾:華為盤(pán)古大模型采用知識(shí)蒸餾的方法,將訓(xùn)練過(guò)的小型模型知識(shí)轉(zhuǎn)移到大型模型中,提高大型模型的性能。

ChatGPT

chatgpt的技術(shù)優(yōu)勢(shì)主要體現(xiàn)在以下幾個(gè)方面:

(1)自回歸語(yǔ)言模型:chatgpt是一種自回歸語(yǔ)言模型,可以生成文本的連續(xù)順序。

(2)非監(jiān)督學(xué)習(xí):chatgpt采用非監(jiān)督學(xué)習(xí)的方法進(jìn)行訓(xùn)練,不需要標(biāo)記數(shù)據(jù),可以用大量未標(biāo)記的數(shù)據(jù)進(jìn)行事前訓(xùn)練。

(3) fine-tuning:chatgpt采用fine-tuning方法進(jìn)行微調(diào),可適應(yīng)多種工作。

從技術(shù)優(yōu)勢(shì)來(lái)看,華為盤(pán)古大模型和chatgpt都采用大規(guī)模的事前教育和多任務(wù)學(xué)習(xí)方法,而華為盤(pán)古大模型則采用知識(shí)蒸餾方法。另外,chatgpt作為自回歸語(yǔ)言模型,可以生成連續(xù)文本序列,華為盤(pán)古大模型的應(yīng)用場(chǎng)景更廣。

-

華為

+關(guān)注

關(guān)注

218文章

36005瀏覽量

262105 -

ChatGPT

+關(guān)注

關(guān)注

31文章

1598瀏覽量

10268 -

盤(pán)古大模型

+關(guān)注

關(guān)注

1文章

112瀏覽量

1041

發(fā)布評(píng)論請(qǐng)先 登錄

電容隔離技術(shù)優(yōu)勢(shì)解析與乾鴻微全系列數(shù)字隔離器產(chǎn)品指南

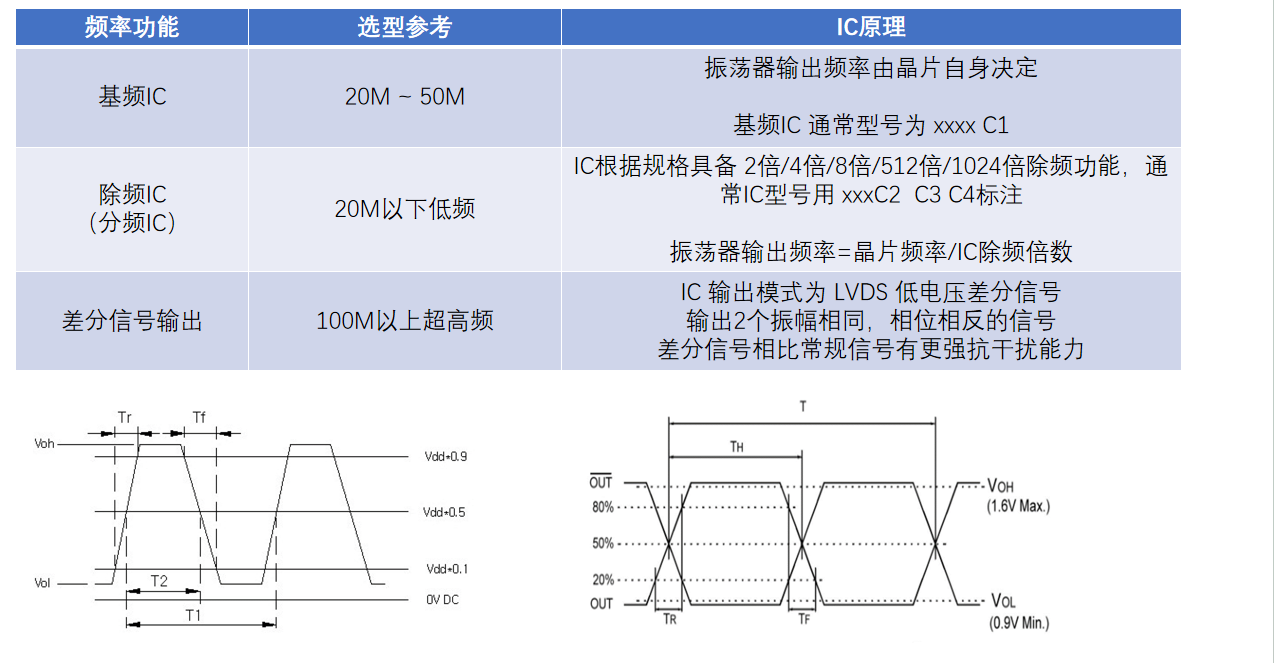

有源晶振的核心技術(shù)優(yōu)勢(shì)與應(yīng)用價(jià)值?

探索源儀電子數(shù)字功率計(jì)的技術(shù)優(yōu)勢(shì)

數(shù)字化轉(zhuǎn)型必看:盤(pán)古信息領(lǐng)銜,五大機(jī)加裝備MES系統(tǒng)深度解析

輸電線(xiàn)路振動(dòng)除冰裝置工作原理及技術(shù)優(yōu)勢(shì)

君耀壓敏電阻14H系列有哪些技術(shù)優(yōu)勢(shì)?

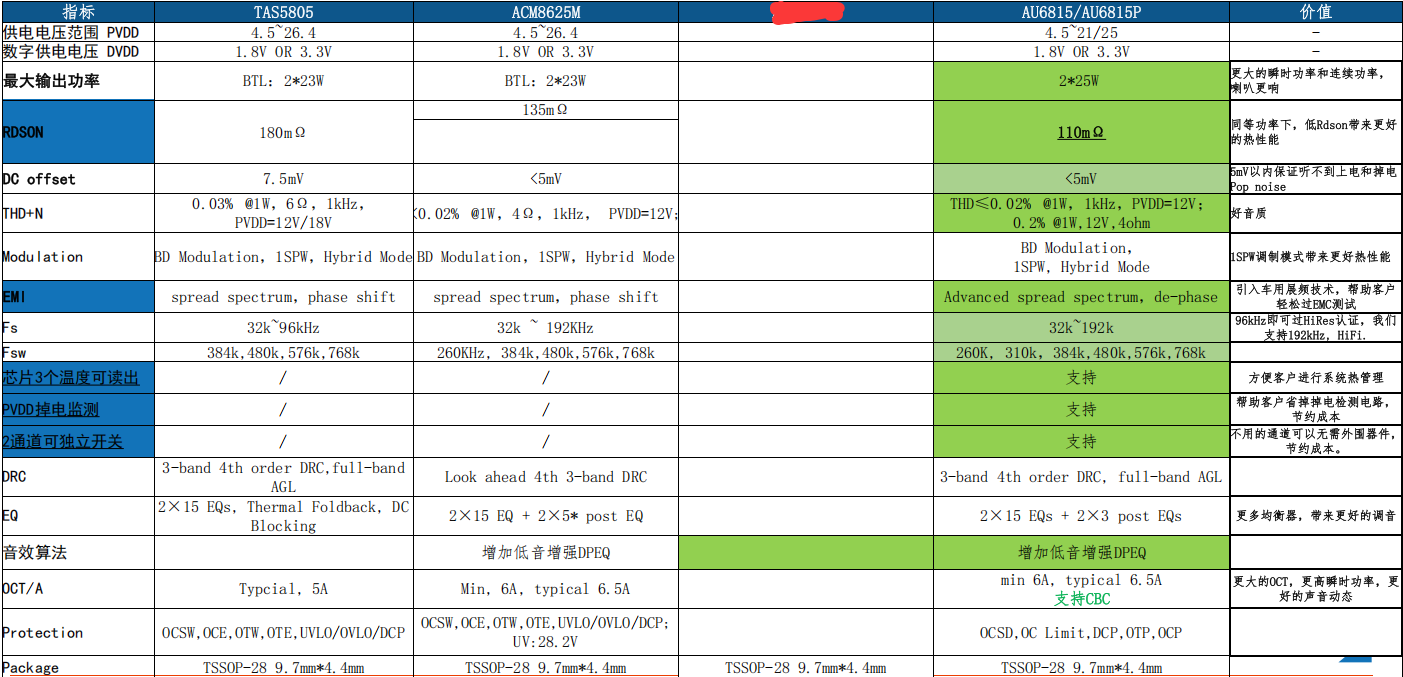

數(shù)字功放的崛起;技術(shù)優(yōu)勢(shì)與產(chǎn)品對(duì)比解析

華為宣布開(kāi)源盤(pán)古7B稠密和72B混合專(zhuān)家模型

華為正式開(kāi)源盤(pán)古7B稠密和72B混合專(zhuān)家模型

華為云聯(lián)合中國(guó)農(nóng)科院打造農(nóng)業(yè)科學(xué)發(fā)現(xiàn)大模型

華為開(kāi)發(fā)者大會(huì)2025(HDC 2025)亮點(diǎn):華為云發(fā)布盤(pán)古大模型5.5 宣布新一代昇騰AI云服務(wù)上線(xiàn)

銘芯微電子-國(guó)產(chǎn)RS485通信接口IC芯片的技術(shù)優(yōu)勢(shì)

如何賦能醫(yī)療AI大模型應(yīng)用?

淺談華為通信大模型的關(guān)鍵技術(shù)

國(guó)產(chǎn)SiC碳化硅功率PIM模塊取代英飛凌PIM模塊的技術(shù)優(yōu)勢(shì)

華為盤(pán)古大模型與ChatGPT的技術(shù)優(yōu)勢(shì)

華為盤(pán)古大模型與ChatGPT的技術(shù)優(yōu)勢(shì)

評(píng)論