正在流行的視覺AI大模型SAM究竟是一種什么樣的技術,會形成什么樣的產業影響?經濟觀察報就此采訪三位IEEE(電氣電子工程師學會)專家,解讀了視覺大模型SAM技術、應用路線以及對原有產業的影響。

今年4月,Meta公布了一款名為SAM(Segment Anything Model)的技術,這是一款用于圖像分割的AI大模型,會對圖像進行觀察、感知、思考、邏輯推理、得出結果,且操作極其簡單,類似于ChatGPT用人類語言對話的方式給機器下命令。

IEEE高級會員、天津理工大學教授、AR/VR技術專家羅訓對記者表示,SAM是視覺領域的通用大模型,很多報道中把它比喻成視覺領域的ChatG-PT,SAM和ChatGPT的支撐技術和應用場景都是不同的,但是在通用性這一點上,它們都是當前技術發展趨勢的代表者。

“SAM技術、應用路線和顛覆性

作為AI的一個重要分支,機器視覺的目標是讓計算機模仿人類視覺系統,實現圖像和視頻的理解和處理。

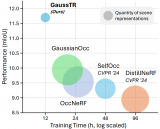

IEEE數字化轉型聯合會策略與架構主席汪齊齊對記者表示,高效準確的圖像分割結果,對于日常生活和商業場景,甚至科研領域都具有重大意義。正因為如此,其在計算機視覺領域一直是個重要的課題。SAM的圖像分割功能,是機器視覺的核心任務之一。過去,機器視覺分割圖像的過程需要大量圖像標注、堆疊算法,消耗大量算力。如今,SAM更容易地實現了機器視覺的目標。

Meta將SAM大模型和背后數據集一并開源,相關的研究手稿也于今年4月5日發布在arXiv上(用于學術交流的預印本平臺),作者有Alexander Kirillov,Eric Mintun等12人。

此后,SAM在開源社區Github上獲得大量關注,一些華人學者又照此原理提出了相關的大模型GroundingDI-NO,用于物體檢測,不久GitHub上有人再創新,將GroundingDINO和SAM結合,達到了對圖像識別、檢測、分割的效果。

汪齊齊表示,該模型在準確程度、效率上,達到了驚人的提升。尤其是SAM開源的SA-1B數據庫,用巨量的圖像以及更加巨量的Mask(這里譯為圖層遮罩),將有助于許多科研項目和商業化項目在高起點上快速更新迭代,產生更好的模型和更優化的數據。

Meta從AR、VR、內容創建等領域,介紹了SAM的應用場景。中國的專家看到了更廣泛的應用場景。

羅訓對記者表示,鑒于計算機視覺的廣泛應用場景,SAM的發布對產業的影響也會是巨大的,會賦能更多的長尾創新者進入產業,并進一步豐富應用場景和商業模式。

汪齊齊表示,早前人工智能技術就能實現回答用戶問題的功能,而Chat-GPT第一次讓很多人產生了“生成的回復可以在接受的比例下用于日常、商用和科研”,并因此達到了在這個垂直領域前所未有的高度。目前SAM的分割結果,以及其公開的大量供公眾使用的資源來看,SAM在其擅長的垂直領域也達到了相當可觀的高度,并會從技術、數據以及對于這個領域的關注度等多方面幫助計算機視覺在短時間內產生大量突破,而計算機視覺,是一個非常重要的“廣義AI生態”中的基礎設施,該方面的突破將實現對數字化世界的理解和升級,帶來質變的效率和價值提升。

IEEE會士、河海大學信息科學與工程學院院長韓光潔對記者表示,SAM將會在自動駕駛、安防控制、醫學影像處理等應用領域改變業態布局,甚至引發技術革命。SAM作為一個基礎模型,可為這些應用領域快速孵化出適用性更強的專用網絡模型。

SAM的變革性可能會顛覆一批原有的AI技術優勢。汪齊齊表示,視覺大模型會在相當多的領域抵消技術壁壘,這在任何一次產業技術升級中都多次出現,也是無法避免的。

羅訓表示,通用大模型就相當于AI的能力開放平臺,之前頭部企業的AI能力優勢,會因為通用大模型的興起而被一定程度削弱。但是這些企業是否本身會變弱,取決于它們的轉型。

羅訓舉例稱,回顧移動計算在本世紀前十年的變化,iOS和安卓的能力開放平臺在賦能長尾創新者方面起到了非常重要的作用,極大增加了移動計算產業規模。在移動計算領域,WindowsMobile和塞班的封閉平臺最終因為缺乏競爭力而退出了市場。

汪齊齊表示,作為有核心技術儲備和深入理解的企業,首先是需要擁抱大模型,尤其是應該感謝相對公開的大模型,將自己對于產業的理解和領先部分,在大模型的加持下快速升級,演化出更新的形態。同時,計算機視覺領域也一定會有大模型目前還不擅長的領域,仍然可以作為技術壁壘,并在這些方面繼續深挖獨有優勢。

“AIGC帶來知識和技術的平權?

此前有科技企業表示,AIGC的本質是技術平權和知識平權,這在很大程度上將大廠與小廠拉到了同一起跑線上。

羅訓就該觀點對記者表示,技術和知識平權的說法并不是很準確,因為之前并沒有系統性的歧視。AIGC帶來的是“易得”,本質上是市場規模急劇擴大后的成本降低。AIGC會促進整個社會對算力和計算模式使用的轉型升級,大規模提高AI使用者的生產效率,同時利好AI軟硬件設施生態企業。過程中,巨頭和大廠是技術進步的先期投入者,它們在其周期內獲取回報也是合理的,因為它們付出了更高的成本,也承擔了更大的風險。

汪齊齊認為,AIGC確實帶來了一定的技術平權,但技術本身是有一個價值屬性的。例如,曾經做網頁可以帶來不菲的收入,隨著工具升級和模板的完善,一個漂亮網頁制作難度數量級地下降,但是他帶來的價值也產生數量級地下降。

同樣,AIGC將一個需要大量技術和知識儲備才能產生優質內容的時代,帶入輕易產生的優質內容的時代,這會讓原有定義的“優質內容”的平均價值急速下降。

汪齊齊表示,AIGC是否帶來了知識平權仍然有待商榷。長期來看,AIGC可能會使人們更容易獲取到真實有用的知識。但是今天,人們還處于“技術帶來了前所未有的體量的知識,也同時讓篩選這些知識的可用度達到了前所未有的高成本”。

汪齊齊表示,盡管AIGC可以產生大量的知識和內容,但其準確性和可信度是個挑戰,相當部分AIGC是基于老的訓練數據,“一本正經供應錯誤知識”的案例已經有很多。目前在大量、無法辨別真偽的數據和內容的情況下,是否真正達到了知識平權,是要打問號的。

-

SAM

+關注

關注

0文章

118瀏覽量

34394 -

ChatGPT

+關注

關注

31文章

1598瀏覽量

10264 -

AIGC

+關注

關注

1文章

391瀏覽量

3226 -

大模型

+關注

關注

2文章

3650瀏覽量

5183

原文標題:對話三位IEEE專家:如何理解SAM視覺大模型

文章出處:【微信號:IEEE_China,微信公眾號:IEEE電氣電子工程師】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

Atmel SAM3S系列32位Flash微控制器深度剖析

SAM(通用圖像分割基礎模型)丨基于BM1684X模型部署指南

云知聲推出醫療領域專家大模型“山海·知醫大模型5.0”

AI、量子通信與JCAP:6G時代的“三位一體“革命

廣和通發布端側情感對話大模型FiboEmo-LLM

大規模專家并行模型在TensorRT-LLM的設計

米爾RK3576部署端側多模態多輪對話,6TOPS算力驅動30億參數LLM

【「DeepSeek 核心技術揭秘」閱讀體驗】基于MOE混合專家模型的學習和思考-2

【「DeepSeek 核心技術揭秘」閱讀體驗】+混合專家

基于MindSpeed MM玩轉Qwen2.5VL多模態理解模型

蔡司CIMT2025 | 新品天團第三位成員ZEISS ScanPort亮相 – 一鍵掃描,效率倍增!

一種基于基礎模型對齊的自監督三維空間理解方法

對話三位IEEE專家:如何理解SAM視覺大模型

對話三位IEEE專家:如何理解SAM視覺大模型

評論