來源:DeepHub IMBA

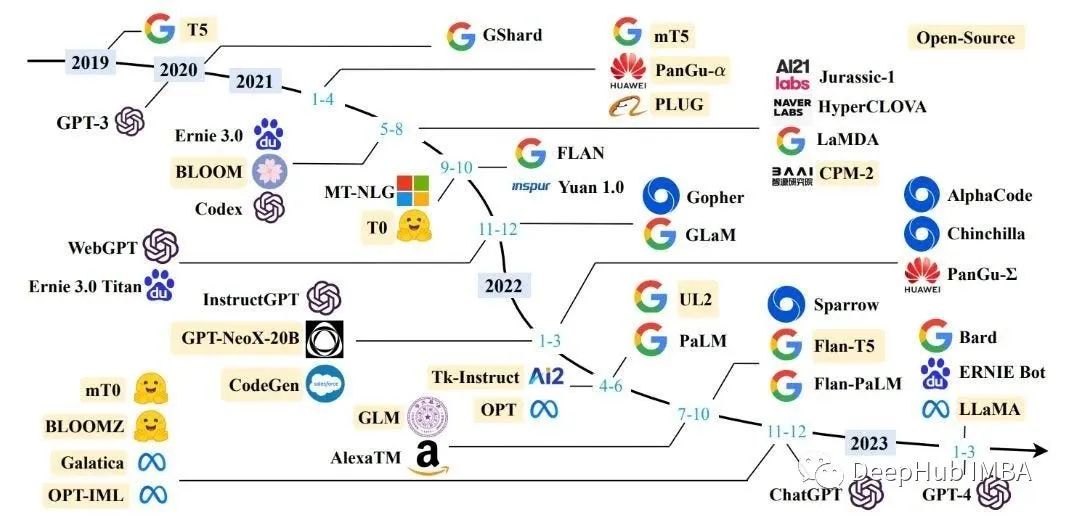

大型語言模型(llm)是一種人工智能(AI),在大量文本和代碼數據集上進行訓練。它們可以用于各種任務,包括生成文本、翻譯語言和編寫不同類型的創意內容。

今年開始,人們對開源LLM越來越感興趣。這些模型是在開源許可下發布的,這意味著任何人都可以使用、修改和分發它們。這使得研究人員、開發人員和企業都可以嘗試LLM,并為它們開發新的應用程序。使用開源llm有很多好處。首先它們通常比專業的LLM更價便宜。并且它們更加透明,這意味著研究人員可以研究它們是如何工作的以及它們是如何做出決定的。最主要的是它們更加靈活,可以針對不同的任務進行定制。 本文總結了當前可用的開源llm的全部(幾乎全部)列表,以及有關其許可選項和源代碼存儲庫的信息,希望對你有所幫助。▎SAIL 7B

本文總結了當前可用的開源llm的全部(幾乎全部)列表,以及有關其許可選項和源代碼存儲庫的信息,希望對你有所幫助。▎SAIL 7B基于LLaMa的搜索增強

參數:7B

許可類型:GPL-3.0

發布日期:2023年5月

論文:SAIL — Search Augmented Instruction Learning

▎Guanaco

采用高效微調方法QLoRA發布的LLM模型

參數:65B

許可類型:MIT

發布日期:2023年5月

論文:QLoRA — Efficient Finetuning of Quantized LLMs

▎RMKV

與transformer的LLM性能相當的RNN模型

參數:100M–14B

許可類型:Apache 2.0

發布日期:2023年5月

論文:Scaling RNN to 1.5B and Reach Transformer LM Performance

▎MPT-7B

MosaicML的基礎系列模型

參數:7B

許可類型:Apache 2.0

發布日期:2023年5月

論文:MPT-7B — A New Standard for Open-Source, Commercially Usable LLMs

▎OpenLLaMa

在RedPajama數據集上訓練的Meta AI的LLaMA 7B的另一個開源復制。

參數:3,7B

許可類型:Apache 2.0

發布日期:2023年5月

論文:Meet OpenLLaMA — An Open-Source Reproduction of Meta AI’s LLaMA Large Language Model

▎RedPajama-INCITE

基于RedPajama數據集上訓練的指令調整和聊天Pythia模型。

參數:3B, 7B

許可類型:Apache 2.0

發布日期:2023年5月

論文:RedPajama-INCITE family of models including base, instruction-tuned & chat models

▎h2oGPT

H2O的微調框架和文檔問答功能的聊天機器人UI

參數:12B,30B

許可類型:Apache 2.0

發布日期:2023年5月

論文:Building the World’s Best Open-Source Large Language Model:H2O.ai’s Journey

▎FastChat-T5

通過微調Flan-t5-xl對從ShareGPT收集的用戶共享對話進行訓練的聊天機器人

參數:3B

許可類型:Apache 2.0

發布日期:2023年4月

論文:FastChat-T5 — our compact and commercial-friendly chatbot!

▎GPT4All

用于訓練和部署強大的定制llm的完整工具系統

參數:7–13B

許可類型:MIT

發布日期:2023年4月

論文:GPT4All:An ecosystem of open-source on-edge large language models.

▎MiniGPT-4

基于BLIP-2和Vicuna LLM的Visual LLM模型

參數:13B

許可類型:BSD-3-Clause

發布日期:2023年4月

論文:MiniGPT-4 — Enhancing Vision-Language Understanding withAdvanced Large Language Models

▎StableLM

StableLM的LLM模型系列

參數:7B

許可類型:CC BY-NC-SA-4.0

發布日期:2023年4月

論文:Stability AI Launches the First of its StableLM Suite of Language Models

▎BloomZ

通過多任務微調實現跨語言泛化

參數:176B

許可類型:Apache 2.0

發布日期:2023年4月

論文:Cross-lingual Generalization through Multitask Finetuning

▎Dolly

Pythia 12B LLM在Databricks ML平臺上訓練的模型

參數:12B

許可類型:Apache 2.0

發布日期:2023年4月

論文:Free Dolly — Introducing the World’s First Truly Open Instruction-Tuned LLM

▎Baize Chatbot

基于LLaMa的開源聊天模型

參數:30B

許可類型:GPL-3.0 license

發布日期:2023年4月

論文:Baize — An Open-Source Chat Model with Parameter-Efficient Tuning on Self-Chat Data

▎ColossalChat

由ColossalAI開源發布的一個完整的RLHF流程訓練的模型

參數:N/A

許可類型:Apache 2.0

發布日期:2023年4月

論文:ColossalChat — An Open-Source Solution for Cloning ChatGPT With a Complete RLHF Pipeline

▎Lit LLaMa

來自Lightning AI的LLaMA的開源實現

參數:13B

許可類型:Apache 2.0

發布日期:2023年4月

論文:Why We’re Building Lit-LLaMA

▎Cerebras-GPT

開放的,計算效率高的,大型語言模型

參數:111M-13B

許可類型:Apache 2.0

發布日期:2023年3月

論文:Cerebras-GPT — Open Compute-Optimal Language ModelsTrained on the Cerebras Wafer-Scale Cluster

▎Open Flamingo

Deepmind的Flamingo模型的開源實現

參數:9B

許可類型:MIT License

發布日期:2023年3月

論文:Openflamingo — An Open-source Framework For Training Vision-language Models With In-context Learning

▎Chat GLM

使用開放式雙語(中英文)雙向密集預訓練模型

參數:6B-130B

許可類型:Apache 2.0

發布日期:2023年3月

論文:GLM-130B:An Open Bilingual Pre-trained Model

▎DLite

通過微調Alpaca數據集上最小的GPT-2模型

參數:124M

許可類型:Apache 2.0

發布日期:2023年3月

論文:Introducing DLite, a Lightweight ChatGPT-Like Model Based on Dolly

▎Alpaca 7B

描述:斯坦福大學發布的指令遵循LLaMA模型

參數:7B

許可類型:Apache 2.0

發布日期:2023年3月

論文:Alpaca — A Strong, Replicable Instruction-Following Model

▎Flan UL2

在預訓練的UL2檢查點上訓練Flan 20B模型。

參數:20B

許可類型:MIT License

發布日期:2023年3月

論文:A New Open Source Flan 20B with UL2

▎Flan-T5

T5在各種數據集上的指令微調,提高預訓練語言模型的可用性

參數:60M–11B

許可類型:Apache 2.0

發布日期:2023年2月

論文:Scaling Instruction-Finetuned Language Models

總結最后再補充2個剛剛發布的模型,一個是llama-2,這個我們文章也在前幾天介紹了微調和使用的方法。另外一個就是昨天剛看到的新聞,stabilityai發布的 FreeWilly2,它是在 Llama2 70B 上微調的結果,目前在open_llm_leaderboard上排第一。開源大型語言模型正在迅速發展,開源社區發布了許多模型。這些模型為開發人員、研究人員和愛好者提供了一個非常大機會,可以在沒有專有系統的情況下試驗尖端的語言技術。隨著越來越多的組織和個人為這些模型的發展做出貢獻,我們可以期待看到更強大、更容易使用和更創新的語言模型,它們將塑造自然語言處理的未來。作者:Manikanth

END

歡迎加入Imagination GPU與人工智能交流2群

(添加請備注公司名和職稱)

推薦閱讀 對話Imagination中國區董事長:以GPU為支點加強軟硬件協同,助力數字化轉型 下載白皮書 | 通過Photon架構創建身臨其境的圖形體驗

Imagination Technologies是一家總部位于英國的公司,致力于研發芯片和軟件知識產權(IP),基于Imagination IP的產品已在全球數十億人的電話、汽車、家庭和工作 場所中使用。獲取更多物聯網、智能穿戴、通信、汽車電子、圖形圖像開發等前沿技術信息,歡迎關注 Imagination Tech!

原文標題:2023年發布的25個開源大型語言模型總結

文章出處:【微信公眾號:Imagination Tech】歡迎添加關注!文章轉載請注明出處。

-

imagination

+關注

關注

1文章

620瀏覽量

63372

原文標題:2023年發布的25個開源大型語言模型總結

文章出處:【微信號:Imgtec,微信公眾號:Imagination Tech】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

云知聲山海醫療大模型問鼎MedBench4.0三項榜首

NVIDIA推動面向數字與物理AI的開源模型發展

今日看點:象帝先推出首款量產Imagination DXD GPU顯卡;小米汽車累計交付突破 50 萬臺

openDACS 2025 開源EDA與芯片賽項 賽題七:基于大模型的生成式原理圖設計

開源鴻蒙技術大會2025丨以智能化為主旋律,擘畫開源鴻蒙下一個五年發展技術藍圖

NVIDIA ACE現已支持開源Qwen3-8B小語言模型

OpenAI發布2款開源模型

利用自壓縮實現大型語言模型高效縮減

【VisionFive 2單板計算機試用體驗】3、開源大語言模型部署

面壁小鋼炮模型MiniCPM4.0發布,端側智能更進一步

開源本身可以替代大型科技公司嗎?

詳解 LLM 推理模型的現狀

2023年發布的25個開源大型語言模型總結

2023年發布的25個開源大型語言模型總結

評論