電子發燒友網報道(文/李彎彎)日前,在2023世界半導體大會暨南京國際半導體博覽會上,高通全球副總裁孫剛發表演講時談到,目前高通能夠支持參數超過10億的模型在終端上運行,未來幾個月內超過100億參數的模型將有望在終端側運行。

大模型在終端側運行的重要性

生成式AI正在快速發展,數據顯示,2020年至2022年,生成式AI相關的投資增長425%,初步預估生成式AI市場規模將達到1萬億美元。

然而孫剛指出,云經濟難以支持生成式AI規模化拓展,為實現規模化拓展,AI處理的中心正在向邊緣轉移。比如XR、汽車、手機、PC、物聯網,生成式AI將影響各類終端上的應用。

高通在這方面展示出了領先的優勢,高通AI引擎由多個硬件和軟件組件組成,用于在驍龍移動平臺上為終端側AI推理加速。它采用異構計算架構,包括高通Hexagon處理器、Adreno GPU、Kryo CPU和傳感器中樞,共同支持在終端上運行AI應用程序。

在7月初的2023年世界人工智能大會上,高通就已經展示了全球首個在終端側運行生成式AI(AIGC)模型Stable Diffusion的技術演示,和全球最快的終端側語言-視覺模型(LVM)ControlNet運行演示。這兩款模型的參數量已經達到10億-15億,僅在十幾秒內就能夠完成一系列推理,根據輸入的文字或圖片生成全新的AI圖像。

今年7月18日,Meta官宣將發布其開源大模型LLaMA的商用版本,為初創企業和其他企業提供了一個強大的免費選擇,以取代OpenAI和谷歌出售的昂貴的專有模型。隨后,高通發布公告稱,從2024年起,Llama 2將能在旗艦智能手機和PC上運行。

高通技術公司高級副總裁兼邊緣云計算解決方案業務總經理Durga Malladi表示,為了有效地將生成式人工智能推廣到主流市場,人工智能將需要同時在云端和邊緣終端(如智能手機、筆記本電腦、汽車和物聯網終端)上運行。

在高通看來,和基于云端的大語言模型相比,在智能手機等設備上運行Llama 2 等大型語言模型的邊緣云計算具有許多優勢,不僅成本更低、性能更好,還可以在斷網的情況下工作,而且可以提供更個性化、更安全的AI服務。

如何讓大模型在終端規模化擴展

生成式AI進入未來生活的趨勢已經不可阻擋,為了讓生成式AI規模化擴展到更多終端設備中,高通提出了混合AI架構的運行方式,即在云端和設備終端的邊緣側之間分配算力,協同處理AI工作負載。

所謂混合AI,是指充分利用邊緣側終端算力支持生成式AI應用的方式,相比僅在云端運行的AI,前者能夠帶來高性能、個性化且更安全的體驗。

比如,如果模型、提示或生成內容的長度小于某個限定值,且精度足夠,推理就可以完全在終端側進行;如果任務相對復雜,則可以部分依靠云端模型;如果需要更多實時內容,模型也可以接入互聯網獲取信息。

在未來,不同的生成式AI用不同分流方式的混合AI架構,AI也能在此基礎上持續演進:

?大量生成式AI的應用,比如圖像生成或文本創作,需求AI能夠進行實時響應。在這種任務上,終端可通過運行不太復雜的推理完成大部分任務。

在AI計算的實現上,軟件和硬件同樣重要,因為必須在端側做到運算更快,效率更高,并推動AI應用在廣泛終端上的部署和普及。

高通在2022年6月推出AI軟件棧(Qualcomm AI Stack),其支持包括TensorFlow、Pytorch和ONNX在內的所有主流開發框架,所有runtimes(運行時,即某門編程語言的運行環境)和操作系統。借助高通AI軟件棧,開發者在智能手機領域開發的軟件可以快速擴展至汽車、XR、可穿戴設備等其他產品線進行使用。

高通技術公司產品管理高級副總裁兼AI負責人Ziad Asghar表示,未來公司需要加大終端側技術上的研發,尤其是進一步提升量化的算法。例如服務器上訓練的模型一般采用32位浮點運算(FP32),而我們在手機端現在能夠支持INT4計算,這能大大提高端側的處理能力。

小結

不僅僅是大模型的訓練需要極大的算力和功耗,部署也同樣如此。如果要讓大模型在更多的領域實現落地應用,除了在云端部署之后,在終端側部署也很關鍵。目前已經有諸多廠商在該領域進行探索,包括高通,期待未來大模型能夠走進人們生活的方方面面。

-

高通

+關注

關注

78文章

7731瀏覽量

199784

發布評論請先 登錄

深入剖析LM9061與LM9061 - Q1高側保護控制器

如何在NVIDIA Jetson AGX Thor上部署1200億參數大模型

TSC101 高側電流檢測放大器:特性、參數與應用全解析

廣和通發布端側情感對話大模型FiboEmo-LLM

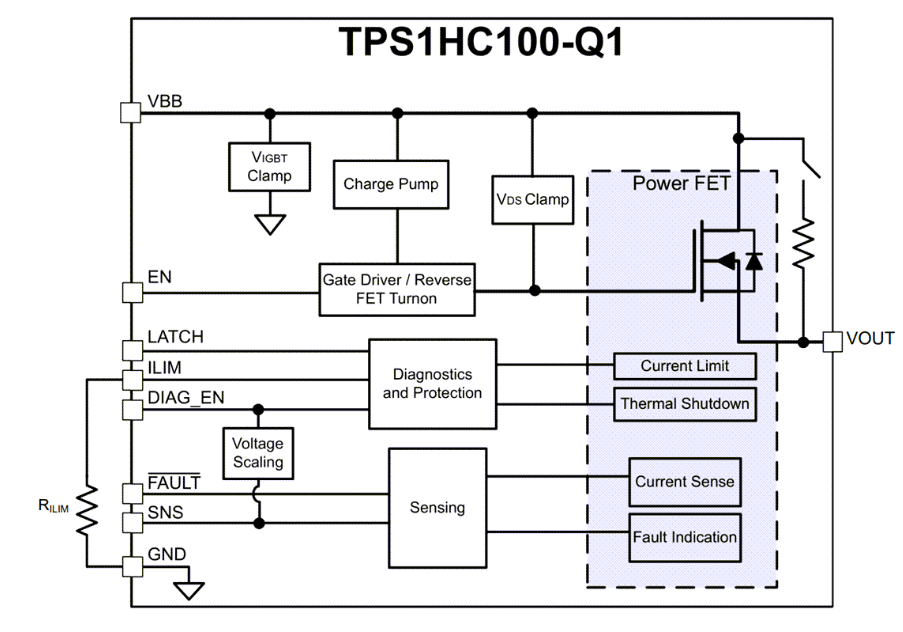

TPS1HC100-Q1智能高側開關技術解析與應用指南

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+AI的未來:提升算力還是智力

谷歌推出AI模型Gemma 3 270M

米爾RK3576部署端側多模態多輪對話,6TOPS算力驅動30億參數LLM

ALINX VD100低功耗端側大模型部署方案,運行3B模型功耗僅5W?!

高通:未來幾個月有望在終端側運行超100億參數的模型

高通:未來幾個月有望在終端側運行超100億參數的模型

評論