如果論文中的圖表不用繪制,對于研究者來說是不是一種便利呢?有人在這方面進(jìn)行了探索,利用文本描述生成論文圖表,結(jié)果還挺有模有樣的呢!

生成式 AI 已經(jīng)風(fēng)靡了人工智能社區(qū),無論是個人還是企業(yè),都開始熱衷于創(chuàng)建相關(guān)的模態(tài)轉(zhuǎn)換應(yīng)用,比如文生圖、文生視頻、文生音樂等等。

最近呢,來自 ServiceNow Research、LIVIA 等科研機(jī)構(gòu)的幾位研究者嘗試基于文本描述生成論文中的圖表。為此,他們提出了一種 FigGen 的新方法,相關(guān)論文還被 ICLR 2023 收錄為了 Tiny Paper。

論文地址:https://arxiv.org/abs/2306.00800

也許有人會問了,生成論文中的圖表有什么難的呢?這樣做對于科研又有哪些幫助呢?

科研圖表生成有助于以簡潔易懂的方式傳播研究結(jié)果,而自動生成圖表可以為研究者帶來很多優(yōu)勢,比如節(jié)省時間和精力,不用花大力氣從頭開始設(shè)計(jì)圖表。此外設(shè)計(jì)出具有視覺吸引力且易理解的圖表能使更多的人訪問論文。

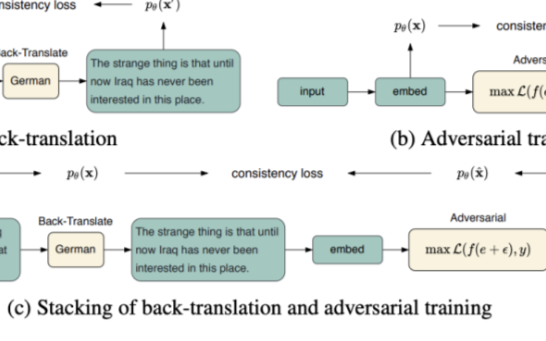

然而生成圖表也面臨一些挑戰(zhàn),它需要表示框、箭頭、文本等離散組件之間的復(fù)雜關(guān)系。與生成自然圖像不同,論文圖表中的概念可能有不同的表示形式,需要細(xì)粒度的理解,例如生成一個神經(jīng)網(wǎng)絡(luò)圖會涉及到高方差的不適定問題。

因此,本文研究者在一個論文圖表對數(shù)據(jù)集上訓(xùn)練了一個生成式模型,捕獲圖表組件與論文中對應(yīng)文本之間的關(guān)系。這就需要處理不同長度和高技術(shù)性文本描述、不同圖表樣式、圖像長寬比以及文本渲染字體、大小和方向問題。

在具體實(shí)現(xiàn)過程中,研究者受到了最近文本到圖像成果的啟發(fā),利用擴(kuò)散模型來生成圖表,提出了一種從文本描述生成科研圖表的潛在擴(kuò)散模型 ——FigGen。

這個擴(kuò)散模型有哪些獨(dú)到之處呢?我們接著往下看細(xì)節(jié)。

模型與方法

研究者從頭開始訓(xùn)練了一個潛在擴(kuò)散模型。

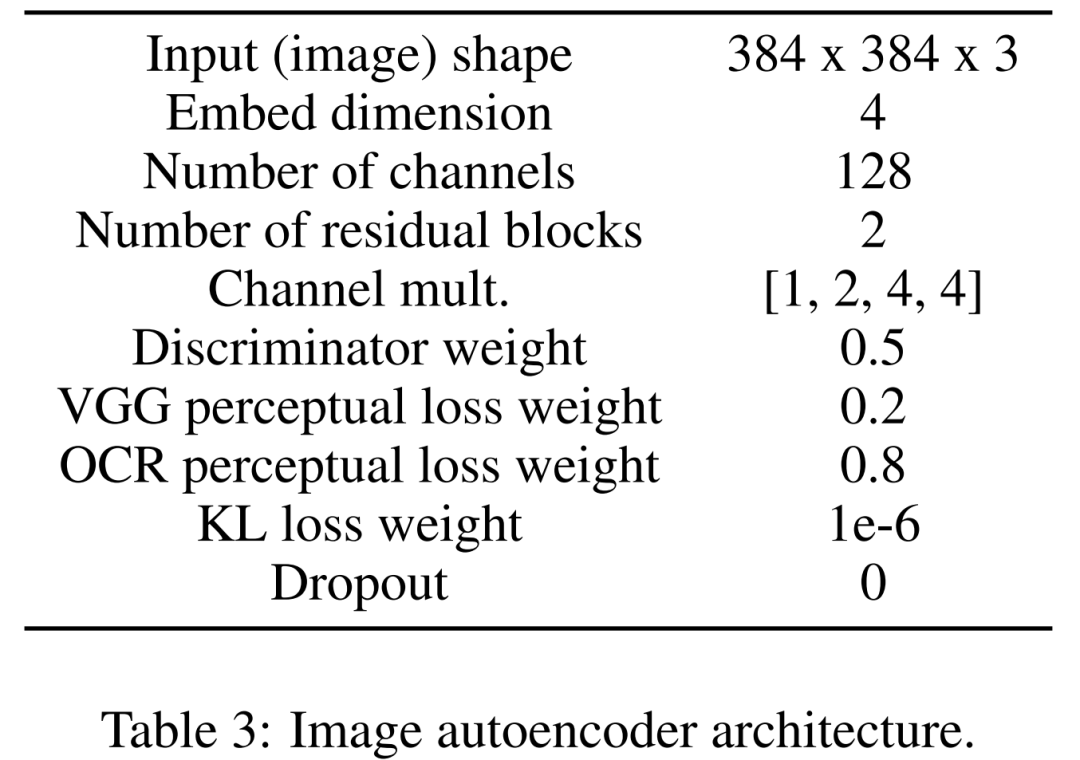

首先學(xué)習(xí)一個圖像自動編碼器,用來將圖像映射為壓縮的潛在表示。圖像編碼器使用 KL 損失和 OCR 感知損失。調(diào)節(jié)所用的文本編碼器在該擴(kuò)散模型的訓(xùn)練中端到端進(jìn)行學(xué)習(xí)。下表 3 為圖像自動編碼器架構(gòu)的詳細(xì)參數(shù)。

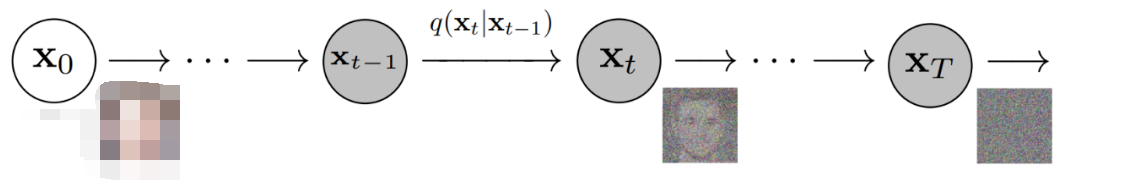

然后,該擴(kuò)散模型直接在潛在空間中進(jìn)行交互,執(zhí)行數(shù)據(jù)損壞的前向調(diào)度,同時學(xué)習(xí)利用時間和文本條件去噪 U-Net 來恢復(fù)該過程。

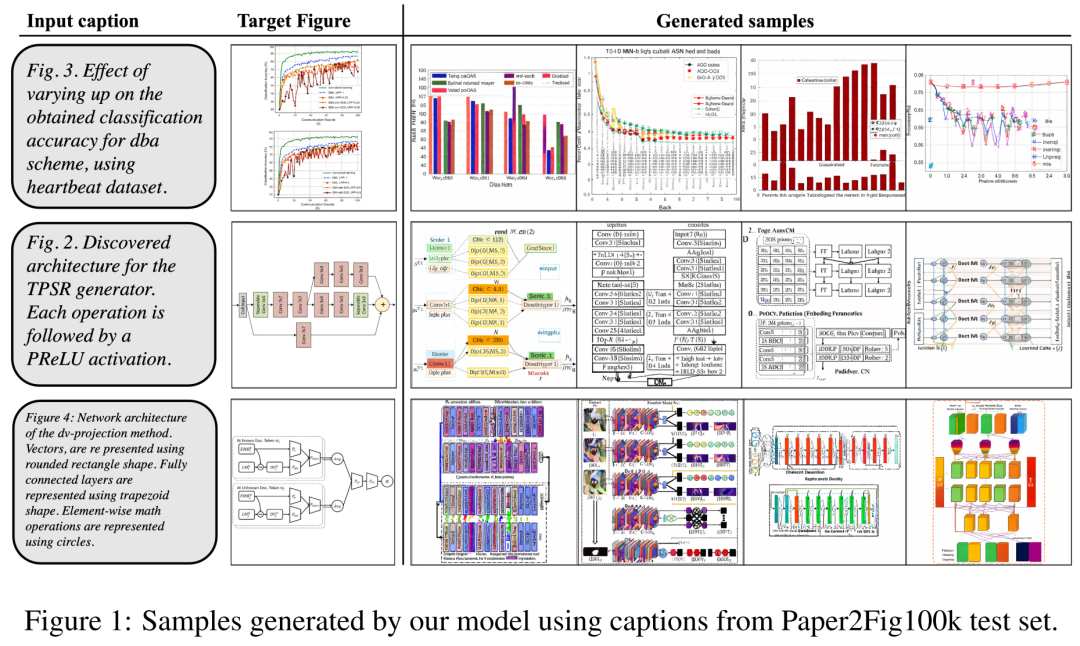

至于數(shù)據(jù)集,研究者使用了 Paper2Fig100k,它由論文中的圖表文本對組成,包含了 81,194 個訓(xùn)練樣本和 21,259 個驗(yàn)證樣本。下圖 1 為 Paper2Fig100k 測試集中使用文本描述生成的圖表示例。

模型細(xì)節(jié)

首先是圖像編碼器。第一階段,圖像自動編碼器學(xué)習(xí)一個從像素空間到壓縮潛在表示的映射,使擴(kuò)散模型訓(xùn)練更快。圖像編碼器還需要學(xué)習(xí)將潛在圖像映射回像素空間,同時不丟失圖表重要細(xì)節(jié)(如文本渲染質(zhì)量)。

為此,研究者定義了一個具有瓶頸的卷積編解碼器,在因子 f=8 時對圖像進(jìn)行下采樣。編碼器經(jīng)過訓(xùn)練可以最小化具有高斯分布的 KL 損失、VGG 感知損失和 OCR 感知損失。

其次是文本編碼器。研究者發(fā)現(xiàn)通用文本編碼器不太適合生成圖表任務(wù)。因此他們定義了一個在擴(kuò)散過程中從頭開始訓(xùn)練的 Bert transformer,其中使用大小為 512 的嵌入通道,這也是調(diào)節(jié) U-Net 的跨注意力層的嵌入大小。研究者還探索了不同設(shè)置下(8、32 和 128)的 transformer 層數(shù)量的變化。

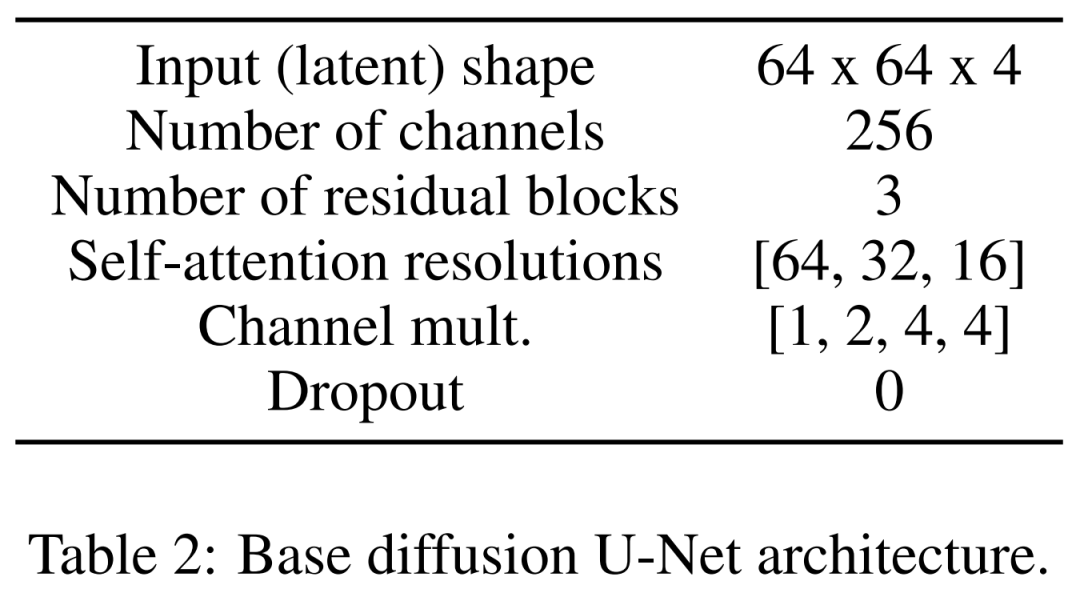

最后是潛在擴(kuò)散模型。下表 2 展示了 U-Net 的網(wǎng)絡(luò)架構(gòu)。研究者在感知上等效的圖像潛在表示中執(zhí)行擴(kuò)散過程,其中該圖像的輸入大小被壓縮到了 64x64x4,使擴(kuò)散模型更快。他們定義了 1,000 個擴(kuò)散步驟和線性噪聲調(diào)度。

訓(xùn)練細(xì)節(jié)

為了訓(xùn)練圖像自動編碼器,研究者使用了一個 Adam 優(yōu)化器,它的有效批大小為 4 個樣本、學(xué)習(xí)率為 4.5e?6,期間使用了 4 個 12GB 的英偉達(dá) V100 顯卡。為了實(shí)現(xiàn)訓(xùn)練穩(wěn)定性,他們在 50k 次迭代中 warmup 模型,而不使用判別器。

對于訓(xùn)練潛在擴(kuò)散模型,研究者也使用 Adam 優(yōu)化器,它的有效批大小為 32,學(xué)習(xí)率為 1e?4。在 Paper2Fig100k 數(shù)據(jù)集上訓(xùn)練該模型時,他們用到了 8 塊 80GB 的英偉達(dá) A100 顯卡。

實(shí)驗(yàn)結(jié)果

在生成過程中,研究者采用了具有 200 步的 DDIM 采樣器,并且為每個模型生成了 12,000 個樣本來計(jì)算 FID, IS, KID 以及 OCR-SIM1。穩(wěn)重使用無分類器指導(dǎo)(CFG)來測試超調(diào)節(jié)。

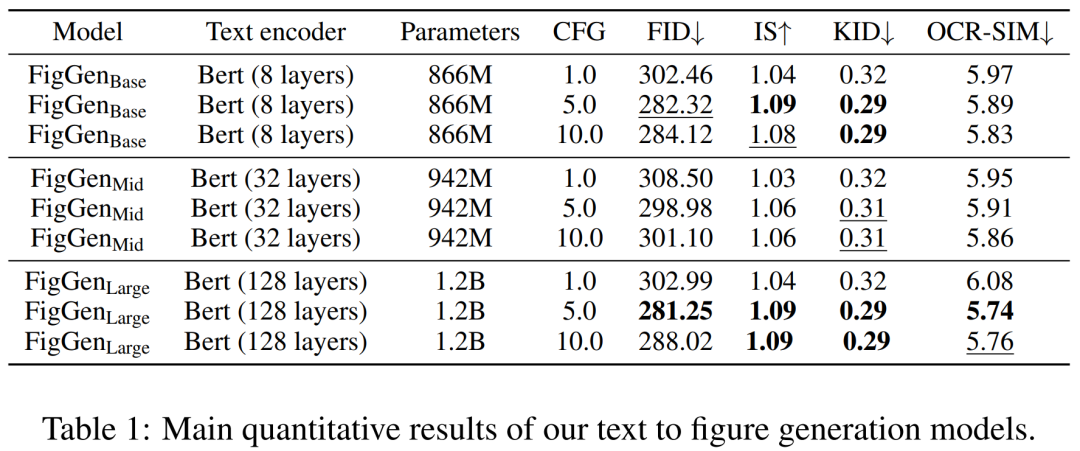

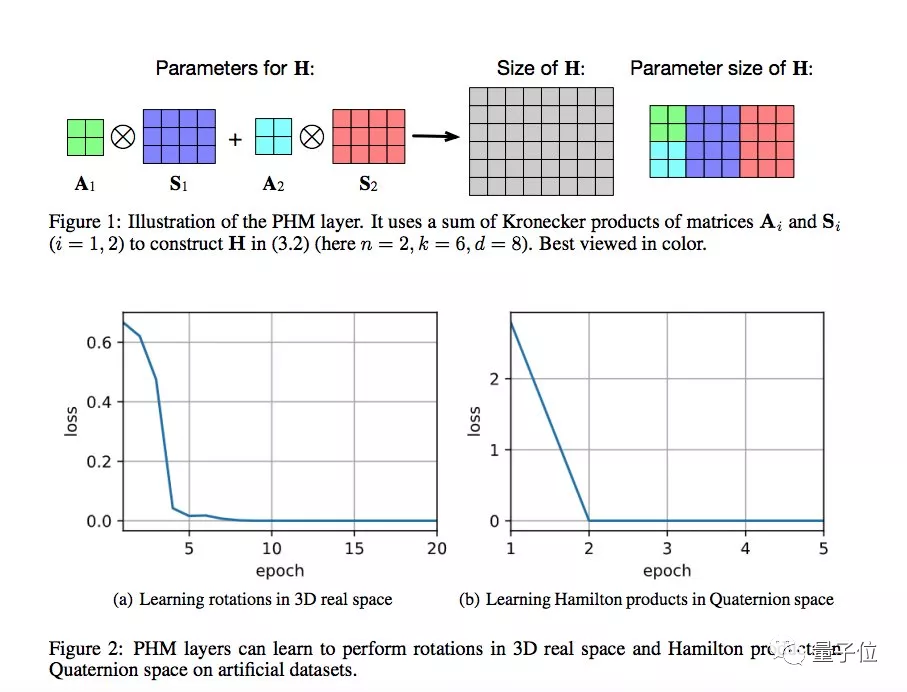

下表 1 展示了不同文本編碼器的結(jié)果。可見,大型文本編碼器產(chǎn)生了最好的定性結(jié)果,并且可以通過增加 CFG 的規(guī)模來改進(jìn)條件生成。雖然定性樣本沒有足夠的質(zhì)量來解決問題,但 FigGen 已經(jīng)掌握了文本和圖像之間的關(guān)系。

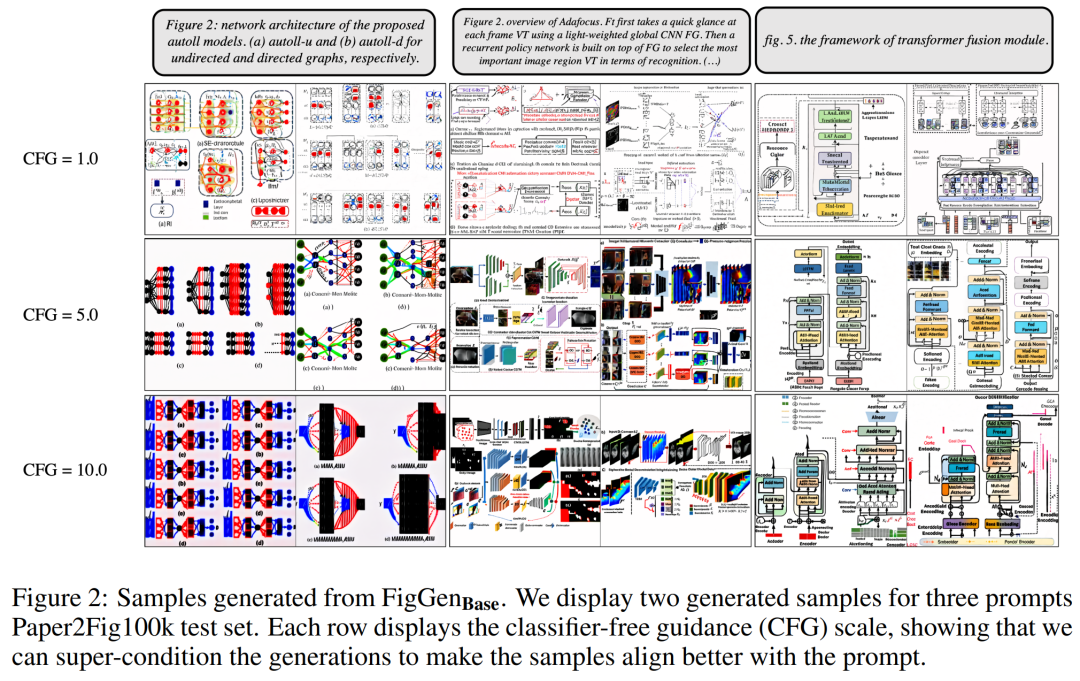

下圖 2 展示了調(diào)整無分類器指導(dǎo)(CFG)參數(shù)時生成的額外 FigGen 樣本。研究者觀察到增加 CFG 的規(guī)模(這在定量上也得到了體現(xiàn))可以帶來圖像質(zhì)量的改善。

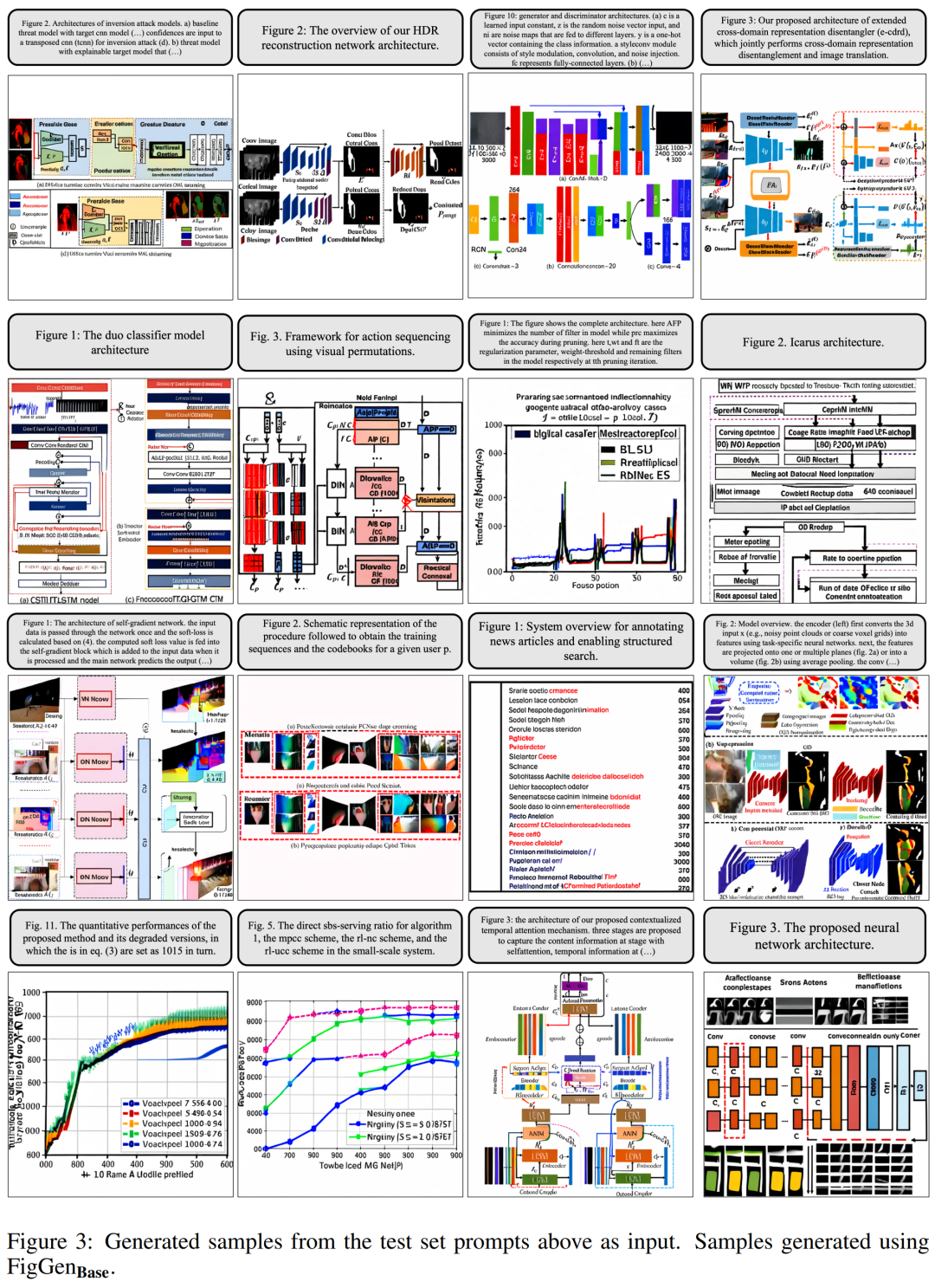

下圖 3 展示了 FigGen 的更多生成示例。要注意樣本之間長度的變化,以及文本描述的技術(shù)水平,這會密切影響到模型正確生成可理解圖像的難度。

?

不過研究者也承認(rèn),盡管現(xiàn)在這些生成的圖表不能為論文作者提供實(shí)際幫助,但仍不失為一個有前景的探索方向。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4838瀏覽量

107753 -

人工智能

+關(guān)注

關(guān)注

1817文章

50094瀏覽量

265302 -

模型

+關(guān)注

關(guān)注

1文章

3751瀏覽量

52099

原文標(biāo)題:論文插圖也能自動生成了!用到了擴(kuò)散模型,還被ICLR 2023接收!

文章出處:【微信號:CVer,微信公眾號:CVer】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

基于擴(kuò)散模型的圖像生成過程

如何在PyTorch中使用擴(kuò)散模型生成圖像

AD8275 spice模型“AD8275.cir”自動生成了一個LTspice模型用來仿真,仿真時彈出圖片所示窗口如何處理?

基于模型設(shè)計(jì)的HDL代碼自動生成技術(shù)綜述

ICLR 2019在官網(wǎng)公布了最佳論文獎!

近期必讀的6篇ICLR 2021相關(guān)論文

ICLR 2021杰出論文獎出爐 讓我們看看前八位優(yōu)秀論文有哪些

擴(kuò)散模型在視頻領(lǐng)域表現(xiàn)如何?

蒸餾無分類器指導(dǎo)擴(kuò)散模型的方法

頂刊TPAMI 2023!生成式AI與圖像合成綜述發(fā)布!

ICCV 2023 | 重塑人體動作生成,融合擴(kuò)散模型與檢索策略的新范式ReMoDiffuse來了

谷歌新作UFOGen:通過擴(kuò)散GAN實(shí)現(xiàn)大規(guī)模文本到圖像生成

ICLR 2024高分投稿:用于一般時間序列分析的現(xiàn)代純卷積結(jié)構(gòu)

基于DiAD擴(kuò)散模型的多類異常檢測工作

論文插圖也能自動生成了!用到了擴(kuò)散模型,還被ICLR 2023接收!

論文插圖也能自動生成了!用到了擴(kuò)散模型,還被ICLR 2023接收!

評論