人工智能和AI技術(shù)的應(yīng)用,是目前很大領(lǐng)域比較重視的部分,而至這個領(lǐng)域的谷歌也擁有不小的實力,就在近日,谷歌最新發(fā)布的語言模型PaLM2就具備很強的競爭力。

據(jù)悉,令牌是指訓(xùn)練大語言模型所使用的單詞串,它們對于教導(dǎo)模型如何預(yù)測字符串中可能出現(xiàn)的下一個單詞至關(guān)重要。

而在去年發(fā)布的上一代模型PaLM僅使用了7800億個令牌,而PaLM2則提升到了3.6萬億個令牌。同時PaLM2在編程、數(shù)學(xué)和創(chuàng)意寫作方面表現(xiàn)更為優(yōu)秀,得益于其龐大的訓(xùn)練數(shù)據(jù)。而這些也將有效提升用戶的工作效率,減輕工作量。

另據(jù)報道,PaLM2是基于3400億個參數(shù)進行訓(xùn)練的,而初始版本的PaLM則基于5400億個參數(shù),而這也造就PaLM2比現(xiàn)有的任何模型都更加強大。

該模型采用了一種名為“計算機優(yōu)化擴張”的新技術(shù),使得大語言模型具備更高的效率和整體性能,包括加快推理速度、減少參數(shù)調(diào)用和降低服務(wù)成本。

相信隨著社會科技的進步,Ai技術(shù)的應(yīng)用也將給我們的生活帶來諸多的變化。

以上源自互聯(lián)網(wǎng),版權(quán)歸原作所有

-

谷歌

+關(guān)注

關(guān)注

27文章

6254瀏覽量

111377 -

人工智能

+關(guān)注

關(guān)注

1817文章

50096瀏覽量

265313

發(fā)布評論請先 登錄

從訓(xùn)練到推理:大模型算力需求的新拐點已至

什么是大模型,智能體...?大模型100問,快速全面了解!

谷歌正式發(fā)布Gemma Scope 2模型

摩爾線程新一代大語言模型對齊框架URPO入選AAAI 2026

谷歌與耶魯大學(xué)合作發(fā)布最新C2S-Scale 27B模型

在Ubuntu20.04系統(tǒng)中訓(xùn)練神經(jīng)網(wǎng)絡(luò)模型的一些經(jīng)驗

借助NVIDIA Megatron-Core大模型訓(xùn)練框架提高顯存使用效率

摩爾線程發(fā)布大模型訓(xùn)練仿真工具SimuMax v1.0

Vicor電源模塊突破數(shù)據(jù)中心AI電力困境

萬億參數(shù)!元腦企智一體機率先支持Kimi K2大模型

NVIDIA GTC巴黎亮點:全新Cosmos Predict-2世界基礎(chǔ)模型與CARLA集成加速智能汽車訓(xùn)練

RAKsmart智能算力架構(gòu):異構(gòu)計算+低時延網(wǎng)絡(luò)驅(qū)動企業(yè)AI訓(xùn)練范式升級

用PaddleNLP為GPT-2模型制作FineWeb二進制預(yù)訓(xùn)練數(shù)據(jù)集

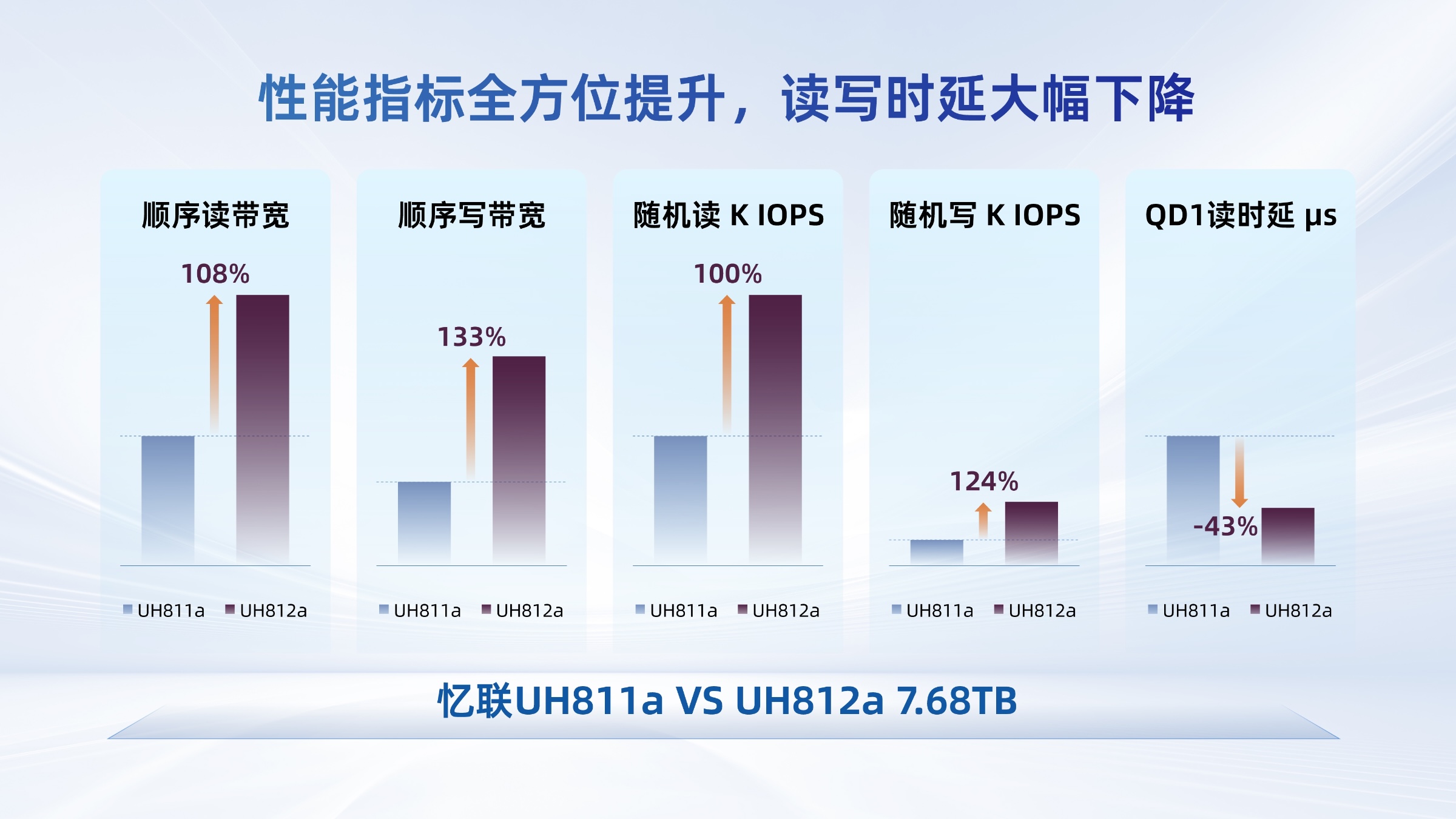

憶聯(lián)PCIe 5.0 SSD支撐大模型全流程訓(xùn)練

谷歌發(fā)布語言模型PaLM2,突破3.6萬億個令牌的訓(xùn)練數(shù)量

谷歌發(fā)布語言模型PaLM2,突破3.6萬億個令牌的訓(xùn)練數(shù)量

評論