來源|Case Studies in Thermal Engineering

原文 |https://doi.org/10.1016/j.csite.2023.102925

01背景介紹

大型數據中心和其他大型計算基礎設施由數千個機架組成,支持數萬臺服務器和其他電子設備。這些電子設備消耗大量的電力,產生大量的熱量。2019年,數據中心消耗了約3%的全球電力。由于對數據中心的需求巨大,預計這一數字將以每年12%的速度增長。

在一個典型的直流系統中,冷卻系統占總能量的40%。產生的熱量可能會導致服務器過熱,威脅到服務器的安全運行,如果不及時有效地散熱,可能會導致服務器故障。此外,CPU的溫度對功率有直接的影響。因此,適宜的CPU溫度可以提供顯著的節能效果。

風冷是最常用的冷卻系統。風冷需要使用強大的風扇,并在電子設備之間提供空間,以放置笨重的散熱器,并允許足夠的氣流。用于計算的電子設備不僅性能越來越好,還具有更大的功率,即最大理論負載下的功耗。因此,迫切需要改進目前的冷卻解決方案。

02成果掠影

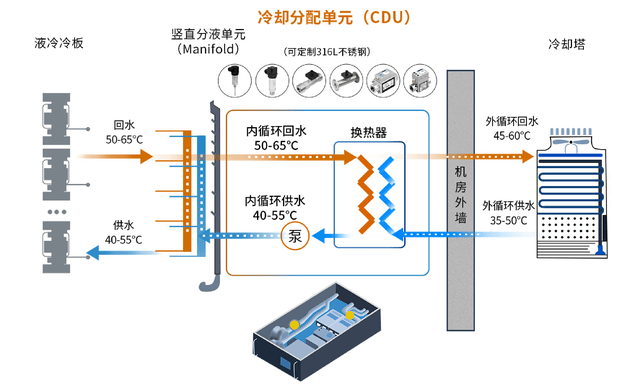

近年來,液冷作為傳統風機強制風冷的補充或替代方法被引入電子設備機架。液冷直流系統最近成為重要的和流行的散熱設備,并且液冷系統具有更好的傳輸特性,具有更優異的經濟性。近期,

法國的Mohamad Hnayno教授,Ali Chehade教授和Chadi Maalouf教授介紹了在OVHcloud實驗室

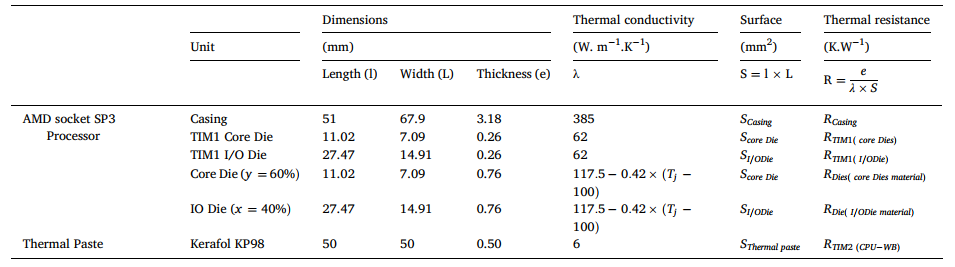

開發的一種新的單相浸入/液冷技術的實驗研究,將直接到芯片的水冷系統與被動的單浸入冷卻技術相結合。實驗裝置測試了三種介質流體(S5X, SmartCoolant和ThermaSafe R)的影響,水回路配置的影響,以及服務器的功率/配置。結果表明,該系統冷卻需求取決于流體的粘度。當黏度從4.6 mPa s增加到9.8 mPa s時,冷卻性能下降了約6%。此外,所有的IT服務器配置都在不同的進水溫度和流速下進行了驗證。在一個600千瓦的數據中心(DC)比較了本文的技術和OVHcloud之前使用的液冷系統的能源性能。與液冷系統相比,所提出的技術減少了至少20.7%的直流電力消耗。最后,在服務器層面對空氣和液冷系統的冷卻性能和所提出的解決方案進行了計算比較。使用該解決方案時,與風冷系統相比節能至少20%,與液冷系統相比節能至少7%。

研究成果以“Experimental investigation of a data-centre cooling system using a new single-phase immersion/liquid technique”為題發表于《Case Studies in Thermal Engineering》。

03圖文導讀

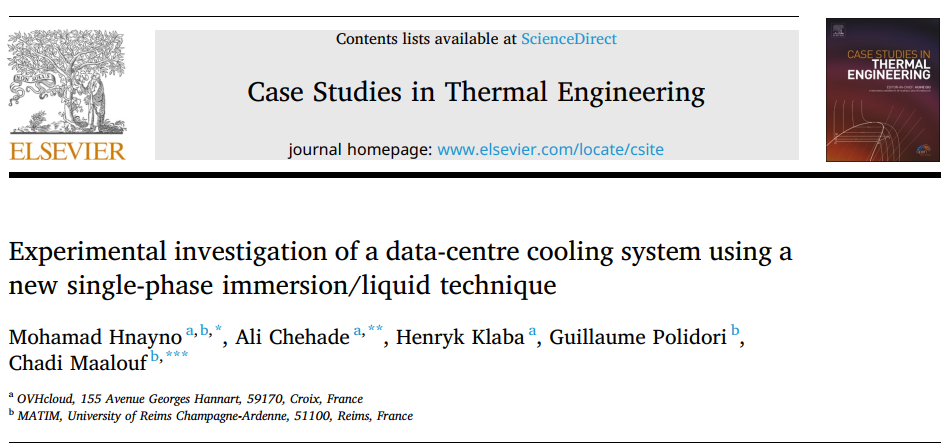

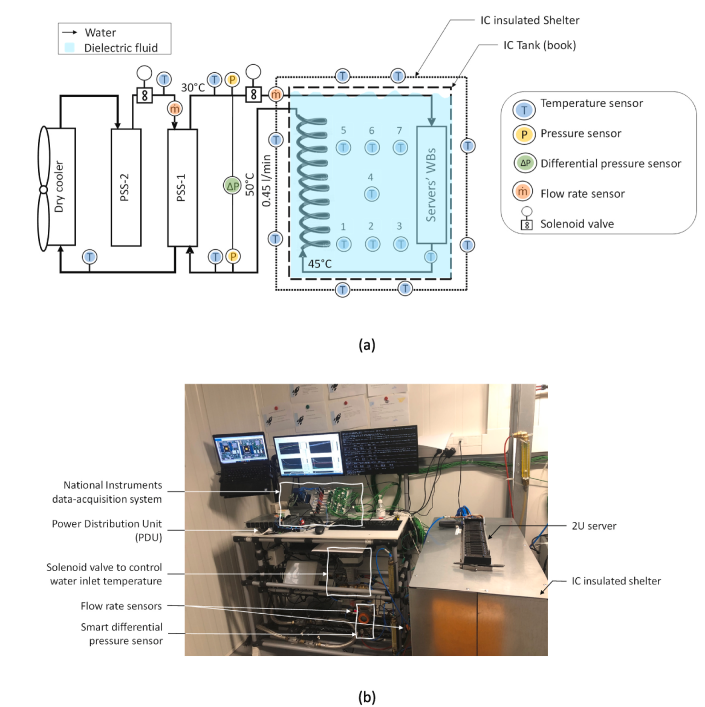

圖1.IC系統示意圖。

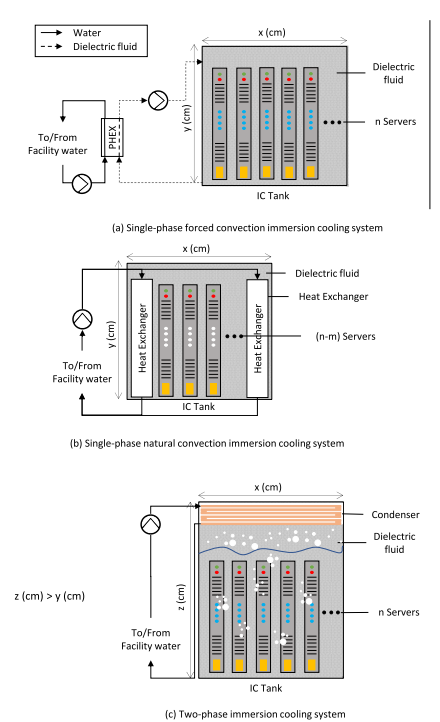

圖2.單相浸沒/液冷技術架構。

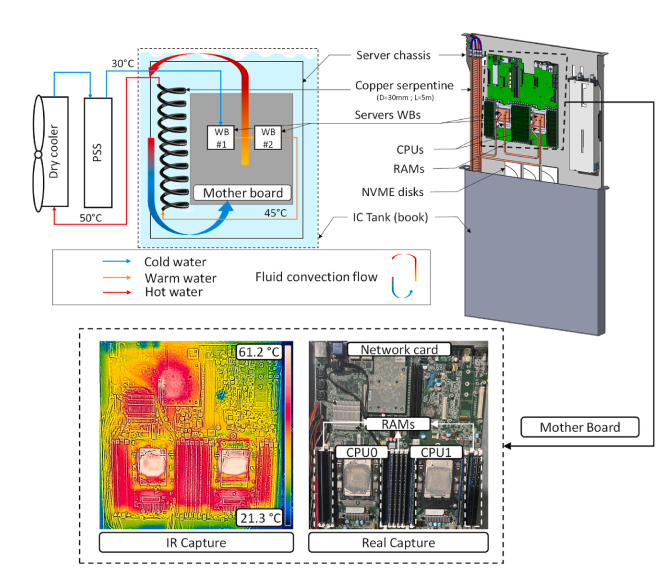

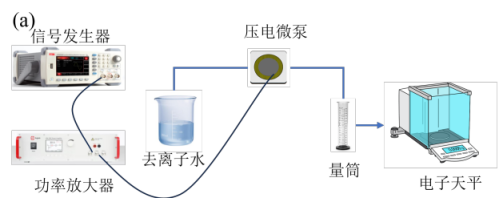

圖3.(a) IC IT機架(48臺服務器),(b) 600kw IC集裝箱。

圖4.(a) IC實驗室實驗裝置方案,(b) IC實驗裝置照片。

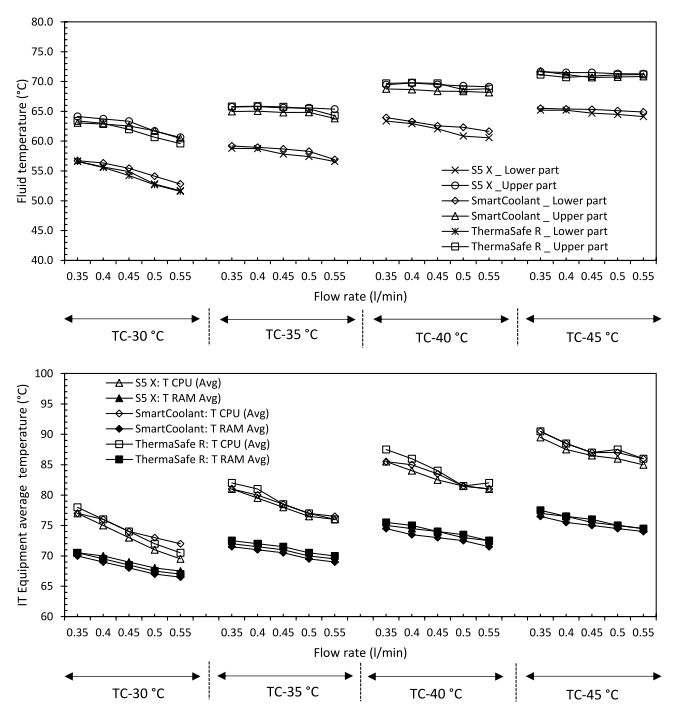

圖5.在使用S5 X、SmartCoolant和ThermaSafe R流體時,(a) IC流體溫度和(b) IT 溫度在不同tc和流速下的變化。

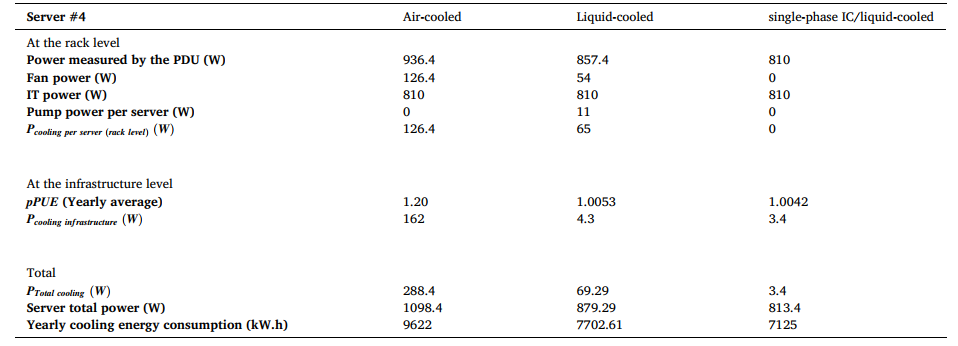

表1.比較在OVHcloud實驗DC中使用的風冷、液冷和浸泡/液冷服務器(服務器#4)。

審核編輯:湯梓紅

-

服務器

+關注

關注

14文章

10251瀏覽量

91480 -

數據中心

+關注

關注

18文章

5647瀏覽量

75009 -

液冷

+關注

關注

5文章

160瀏覽量

5773

發布評論請先 登錄

數據中心液冷監測解決方案:驅動高效冷卻,護航綠色算力

曙光數創液冷方案助力數據中心綠色發展

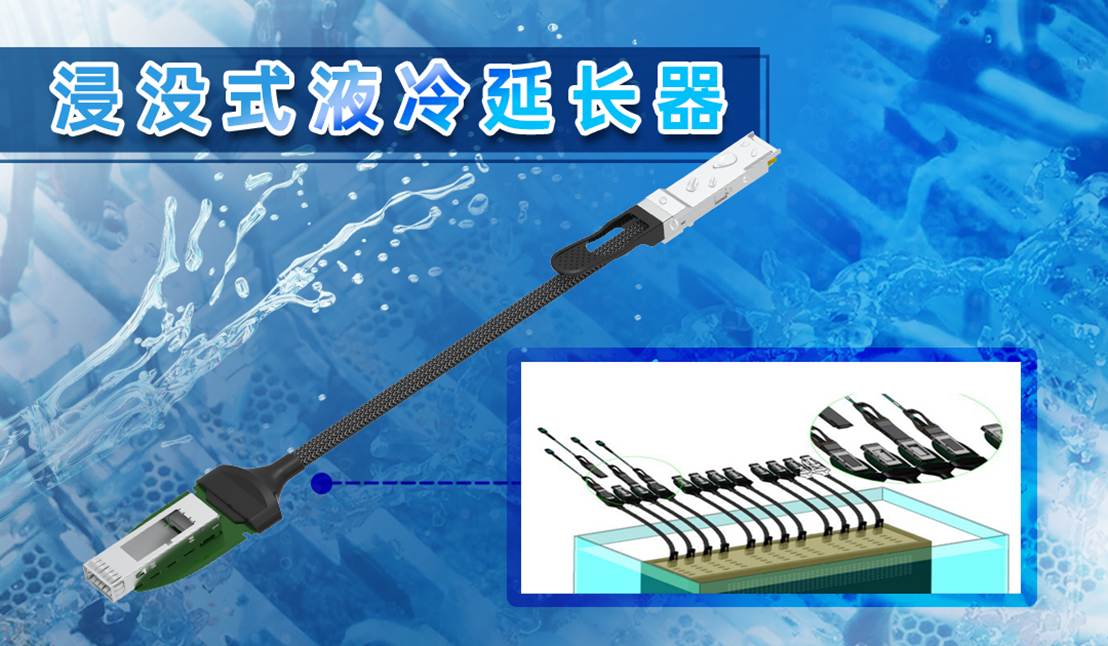

易飛揚浸沒液冷延長器與硅光液冷光模塊主題研究 ——液冷光互連技術的數據中心革命

曙光數創推出液冷數據中心全生命周期定制新服務

海瑞思科技助力數據中心液冷分水器泄漏檢測

英特爾引領液冷革新,與殼牌共筑數據中心高效冷卻新范式

RAKsmart液冷技術如何實現PUE<1.2的綠色數據中心

流量與壓力傳感:數據中心液冷的″智慧之眼″

數據中心液冷技術和風冷技術的比較

一種新型數據中心液冷系統的實驗研究

一種新型數據中心液冷系統的實驗研究

評論