NVIDIA 四大主題論壇

全棧式解決方案

為您啟動 AI 引擎

12 月 8 日-10 日,CNCC 邀您共赴 “計算之約”。以算力、數(shù)據(jù)、生態(tài)為主題,本屆 CNCC 首次全面改為線上舉辦,但規(guī)模可說是史上之 “最” :邀請嘉賓包括 ACM 圖靈獎獲得者、田納西大學(xué)教授 Jack Dongarra,以及多位院士及專家,還有七百余位國內(nèi)外名校學(xué)者、名企領(lǐng)軍人物、各領(lǐng)域極具影響力的業(yè)內(nèi)專家。

今年,NVIDIA會在CNCC帶來涵蓋DPU、元宇宙、超大模型的推理和部署實踐三大主題的演講論壇和面向開發(fā)者的CUDA Python線上編程培訓(xùn)實驗論壇,內(nèi)容豐富、干貨滿滿、場場精彩!(* NVIDIA 將免費放送四大論壇,線上票價值 1080 元,千萬別錯過)

NVIDIA 在 CNCC 主題論壇概覽

|

時間 |

主題 |

|

12 月 8 日(星期四)1330 |

探索 DPU 應(yīng)用場景 加速云原生基礎(chǔ)設(shè)施創(chuàng)新 |

|

12 月 8 日(星期四)1900 |

如何利用元宇宙相關(guān)技術(shù) 實現(xiàn)虛擬世界和現(xiàn)實世界的連接 |

|

12 月 9 日(星期五)1330 |

超大模型的推理和部署實踐 |

|

12 月 10 日(星期六)1330 |

基于 Python 的 CUDA 編程入門 培訓(xùn)及線上編程體驗 |

在 8 號的“為數(shù)據(jù)中心不斷“減負(fù)” :探索 DPU 應(yīng)用場景,加速云原生基礎(chǔ)設(shè)施創(chuàng)新”、穿梭虛實之間,元宇宙技術(shù)是如何做到的?兩期主題論壇之后。

這一程,NVIDIA 將攜手百度、騰訊、小冰,于 12 月 9 日下午共同解讀《超大模型的推理和部署實踐》。論壇云集技術(shù)大牛,您將了解:

-

飛槳超大模型的壓縮和推理優(yōu)化;

-

基于精調(diào)、蒸餾和壓縮的大模型落地應(yīng)用;

-

通往高參數(shù)效用比的自然語言處理;

-

“小冰”如何利用 FasterTransformer 實現(xiàn)大規(guī)模語言模型的產(chǎn)品級部署等內(nèi)容。

對超大模型推理及其具體應(yīng)用感興趣的小伙伴們,

下方查看會議詳情!

超大模型的推理和部署實踐

12 月 9 日,星期五,1330

線上會議室 6

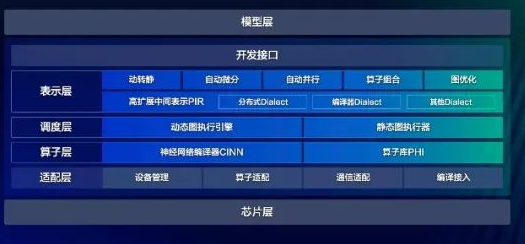

隨著 AI 的發(fā)展,創(chuàng)新和數(shù)據(jù)復(fù)雜性不斷提升,超大規(guī)模成為必然趨勢。通過本次分論壇,您將了解飛槳超大模型的壓縮和推理優(yōu)化;基于精調(diào)、蒸餾和壓縮的大模型落地應(yīng)用;通往高參數(shù)效用比的自然語言處理;如何利用 FasterTransformer 實現(xiàn)大規(guī)模語言模型的產(chǎn)品級部署,以及 Transformer 模型在 TensorRT 上的推理性能優(yōu)化等內(nèi)容。

具體議程

飛槳超大模型的壓縮和推理優(yōu)化

超大模型在各類任務(wù)上取得卓越的效果,然而由于超大模型體積大、速度慢,推理部署面臨巨大的挑戰(zhàn),大模型的高效推理是實現(xiàn)大模型產(chǎn)業(yè)應(yīng)用落地的關(guān)鍵所在。飛槳推出了針對大模型的壓縮、推理、服務(wù)化全流程部署方案。該方案通過面向大模型的精度無損模型壓縮技術(shù)、自適應(yīng)分布式推理技術(shù),可自動感知硬件特性,完成模型壓縮、自動切分和混合并行推理計算,實現(xiàn)領(lǐng)先性能。

黨青青 | 百度資深研發(fā)工程師

黨青青,百度資深研發(fā)工程師,目前主要從事深度學(xué)習(xí)模型推理、壓縮、視覺算法的研究。負(fù)責(zé)飛槳推理性能優(yōu)化,以及模型壓縮工具、視覺套件建設(shè)。有豐富的深度學(xué)習(xí)框架系統(tǒng)研發(fā)、高性能優(yōu)化、算法調(diào)優(yōu)經(jīng)驗。

通往高參數(shù)效用比的自然語言處理-預(yù)訓(xùn)練、

下游任務(wù)、與前沿展望

如今自然語言處理領(lǐng)域正在進(jìn)行 “訓(xùn)練->推理” 到 “預(yù)訓(xùn)練->下游任務(wù)微調(diào)”的范式轉(zhuǎn)換,其中模型神經(jīng)元數(shù)量和預(yù)訓(xùn)練所用數(shù)據(jù)規(guī)模已經(jīng)遠(yuǎn)超人類大腦的神經(jīng)元數(shù)量和人類人均閱讀總量,同時在 GLUE 等通用大模型評估榜單中獲得的收益是非常微弱的。對此,我們開展了一系列高參數(shù)效用比的自然語言處理預(yù)訓(xùn)練、和下游任務(wù)的探索,來幫助大模型更加智能、高效的從海量數(shù)據(jù)中挖掘知識,并魯棒、準(zhǔn)確的遷移到下游任務(wù)中。

丁亮 | 京東探索研究院算法科學(xué)家

丁亮,京東探索研究院算法科學(xué)家,自然語言處理方向負(fù)責(zé)人。博士畢業(yè)于悉尼大學(xué),師從 IEEE/ACM Fellow 陶大程教授。他致力于基于深度學(xué)習(xí)的自然語言處理,包括大規(guī)模語言模型預(yù)訓(xùn)練、語言理解、生成和翻譯。他帶領(lǐng)團(tuán)隊在 2021 年 12 月在兩個 GLUE 基準(zhǔn)評測任務(wù)上實現(xiàn)首次超越人類的表現(xiàn),隨后在 2022 年 1 月以均分 91.3 獲得總榜單第一。

基于精調(diào)、蒸餾和壓縮的大模型落地應(yīng)用

大模型歷經(jīng)過去幾年探索已經(jīng)相對成熟。目前如何能夠在真實場景快速落地成為急需解決的問題。為解決大模型落地方面的各種問題,我們開發(fā)提供精調(diào)、蒸餾、壓縮、推理、服務(wù)化全流程部署方案,助力大模型快速有效落地。

劉凱 | 騰訊軟件工程師

從事 NLP 訓(xùn)練推理一體化服務(wù)開發(fā)。

小冰如何利用 FasterTransformer

實現(xiàn)大規(guī)模語言模型的產(chǎn)品級部署

小冰在部署 GPT 1B/6B 模型中遇到的困難;Faster Transformer (FT) 如何解決上述困難;在上述模型配置下,F(xiàn)T+Triton 與 baseline (Huggingface Transformers 和 Deepspeed) 在 a. latency, b. throughput, c. 可部署的最低配置GPU環(huán)境 上的差異;小冰如何利用 FT 對 soft prompt/prefix 的支持,在只使用同一個 backbone model 的情況下實現(xiàn)對不同用戶的高度自定義化。

趙天雨 | 小冰高級研究員

2015 年本科畢業(yè)于北京大學(xué)計算機(jī)系,2020 年博士畢業(yè)于京都大學(xué)智能信息學(xué)系,同年就職于小冰日本團(tuán)隊。研究方向為自然語言處理,主要關(guān)注對話系統(tǒng)、大模型的訓(xùn)練與部署。

鄭鵬 | NVIDIA GPU 計算專家

畢業(yè)于佐治亞理工計算科學(xué)與工程專業(yè),2021 年加入 NVIDIA 主要參與 FasterTransformer Multi-GPU Multi-Node 相關(guān)的優(yōu)化工作。

基于 FasterTransformer

和 Triton大模型的預(yù)估

自 2020 年 OpenAI 推出 GPT 模型之後,越來越多研究證明超大模型在自然語言處理上的能力與重要性。NVIDIA 在 2021 年時基于 FasterTransformer 開發(fā)多機(jī)多卡并行推理的功能,提出第一個多機(jī)多卡大模型推理的解決方案。FasterTransformer 本身不具有收集、整理請求的能力,這在實際應(yīng)用上是非常重要的功能。為了填補(bǔ)不足,我們將 FasterTransformer 與推理框架 Triton 進(jìn)行結(jié)合,讓 FasterTransformer 能夠更好的支持實際的推理場景。在這次的演講中,我們會詳細(xì)的講解我們?nèi)绾螌崿F(xiàn)以上的功能,讓用戶能透過 FasterTransformer 將大模型推理實際落地。

薛博陽 | NVIDIA GPU 技術(shù)專家

2019 年加入 NVIDIA,目前主要負(fù)責(zé) FasterTransformer 的開發(fā)與優(yōu)化。FasterTransformer 提供 Transformer 模型推理上靈活與高效的調(diào)用,對比一般的框架能提供數(shù)倍到十倍以上的加速效果。除此之外,是第一個支持 GPT-3 的推理庫。FasterTransformer 針對 GPT-3 這種超大規(guī)模(1750 億模型參數(shù))的模型提供了模型并行、優(yōu)化通信開銷、顯存使用,讓使用者能以最少的 GPU、透過多 GPU、多節(jié)點在 GPT-3 的服務(wù)上得到最好的速度。

Transformer 模型

在 TensorRT 上的推理性能優(yōu)化

Transformer 在 NLP 和 CV 領(lǐng)域大放異彩,在眾多深度學(xué)習(xí)模型中顯現(xiàn)了突出的效果。同時,它相比于卷積網(wǎng)絡(luò)需要更高的計算量,其推理優(yōu)化值得關(guān)注。TensorRT 是 NVIDIA 專門針對推理場景推出的性能優(yōu)化工具;NVIDIA DevTech 團(tuán)隊將若干常用的 Transformer 模型移植到 TensorRT,獲得了良好的加速效果。

王猛 | NVIDIA GPU 技術(shù)專家

2019 年加入 NVIDIA,目前主要從事 GPU 上模型部署與優(yōu)化,在 TensorRT,ONNX 和 CUDA 并行計算等領(lǐng)域有較多的研究和應(yīng)用經(jīng)驗,目前主要負(fù)責(zé) TensorRT workflow。

小組座談

參與嘉賓:

王猛 | NVIDIA GPU 技術(shù)專家

劉凱 | 騰訊軟件工程師

怎樣報名參會

掃描下方二維碼或點擊閱讀原文,添加微信小助手

并備注“CNCC”加入本次活動微信交流群

分論壇觀看入口將在直播開始前在微信群內(nèi)發(fā)布

與行業(yè)先鋒一同,探尋超大模型的推理和部署實踐

原文標(biāo)題:CNCC 論壇 | NVIDIA 攜手百度、京東、騰訊、小冰,共同解讀超大模型的推理和部署實踐

文章出處:【微信公眾號:NVIDIA英偉達(dá)】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

-

英偉達(dá)

+關(guān)注

關(guān)注

23文章

4087瀏覽量

99199 -

大模型

+關(guān)注

關(guān)注

2文章

3650瀏覽量

5189

原文標(biāo)題:CNCC 論壇 | NVIDIA 攜手百度、京東、騰訊、小冰,共同解讀超大模型的推理和部署實踐

文章出處:【微信號:NVIDIA_China,微信公眾號:NVIDIA英偉達(dá)】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

有方科技攜手百度智能云重塑AI賦能新生態(tài)

百度世界2025進(jìn)行中 百度昆侖芯超節(jié)點亮相 性能巨幅提升

光庭信息成為百度智能云大模型行業(yè)合伙人

珠海泰芯半導(dǎo)體攜手百度共筑智能硬件產(chǎn)業(yè)新生態(tài)

NVIDIA Nemotron Nano 2推理模型發(fā)布

NVIDIA從云到邊緣加速OpenAI gpt-oss模型部署,實現(xiàn)150萬TPS推理

如何本地部署NVIDIA Cosmos Reason-1-7B模型

寧暢與與百度文心大模型展開深度技術(shù)合作

65%央企大模型落地首選百度智能云

百度文心大模型X1 Turbo獲得信通院當(dāng)前大模型最高評級證書

百度發(fā)布文心4.5 Turbo、X1 Turbo和多款A(yù)I應(yīng)用

百度地圖在汽車智能化領(lǐng)域的應(yīng)用實踐

百度飛槳框架3.0正式版發(fā)布

CNCC 論壇 | NVIDIA 攜手百度、京東、騰訊、小冰,共同解讀超大模型的推理和部署實踐

CNCC 論壇 | NVIDIA 攜手百度、京東、騰訊、小冰,共同解讀超大模型的推理和部署實踐

評論