3D成像方法匯總介紹:

這里要介紹的是真正的3D成像,得到物體三維的圖形,是立體的圖像。

而不是利用人眼視覺差異的特點,錯誤感知到的假三維信息。

原理上分類:主要常用有:

1、雙目立體視覺法(Stereo Vision)

2、激光三角法(Laser triangulation)

3、結構光3D成像(Structured light 3D imaging)

4、飛行時間法ToF(Time of flight)

5、光場成像法(Light field of imaging)

6、全息投影技術(Front-projected holographic display)

7、補充:戳穿假全息

上面原理之間可能會有交叉。

而激光雷達不是3D成像原理上的一個分類,而是一種具體方法。

激光雷達的3D成像原理有:三角測距法、飛行時間ToF法等。

激光雷達按照實現方式分類有:機械式、混合固態、基于光學相控陣固態 、基于MEMS式混合固態、基于FLASH式固態等。

一、雙目立體視覺法:

就和人的兩個眼睛一樣,各種兩個攝像頭的手機大都會用這種方法來獲得深度信息,從而得到三維圖像。但深度受到兩個攝像頭之間距離的限制。

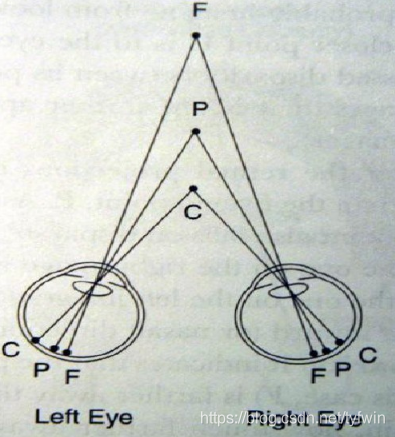

視差圖:雙目立體視覺融合兩只眼睛獲得的圖像并觀察它們之間的差別,使我們可以獲得明顯的深度感,建立特征間的對應關系,將同一空間物理點在不同圖像中的映像點對應起來,這個差別,我們稱作視差(Disparity)圖

像。對于視差的理解可以自己體驗一下:將手指頭放在離眼睛不同距離的位置,并輪換睜、閉左右眼,可以發現手指在不同距離的位置,視覺差也不同,且距離越近,視差越大。

提到視差圖,就有深度圖,深度圖像也叫距離影像,是指將從圖像采集器到場景中各點的距離(深度)值作為像素值的圖像。

深度圖與點云的區別,點云:當一束激光照射到物體表面時,所反射的激光會攜帶方位、距離等信息。若將激光束按照某種軌跡進行掃描,便會邊掃描邊記錄到反射的激光點信息,由于掃描極為精細,則能夠得到大量的激光點,因而就可形成激光點云。深度圖像經過坐標轉換可以計算為點云數據;有規則及必要信息的點云數據可以反算為深度圖像。兩者在一定條件下是可以相互轉化的。

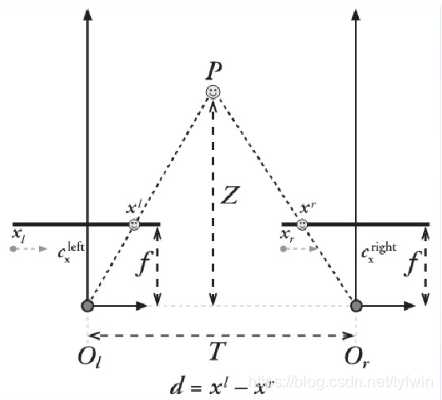

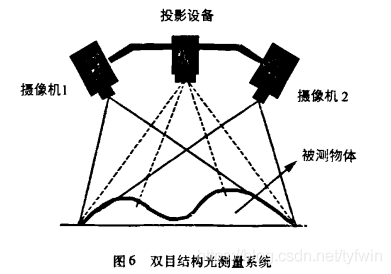

雙目立體視覺由三角法原理進行三維信息的獲取,即由兩個攝像機的圖像平面和被測物體之間構成一個三角形。已知兩個攝像機之間的位置關系和物體在左右圖像中的坐標,便可以獲得兩攝像機公共視場內物體的三維尺寸及空間物體特征點的三維坐標。所以,雙目視覺系統一般由兩個攝像機構成。

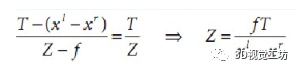

深度和視差成反比。

二、激光三角法

單點激光測距原理:(同屬于下面結構光原理)

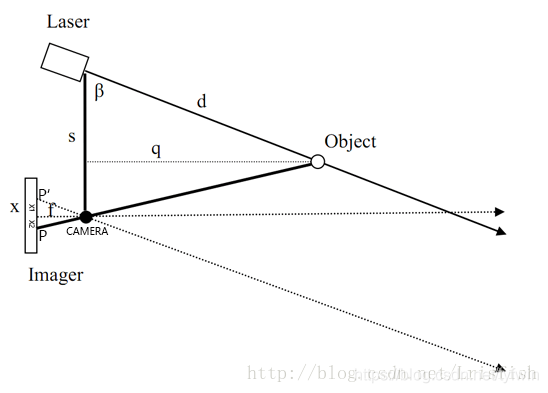

單點激光測距原理圖如下圖。

激光頭Laser與攝像頭在同一水平線(稱為基準線)上,其距離為s,攝像頭焦距為f,激光頭與基準線的夾角為β。激光頭Laser與攝像頭在同一水平線(稱為基準線)上,其距離為s,攝像頭焦距為f,激光頭與基準線的夾角為

β。假設目標物體Object在點狀激光器的照射下,反射回攝像頭成像平面的位置為點P。假設目標物體Object在點狀激光器的照射下,反射回攝像頭成像平面的位置為點P。

由幾何知識可作相似三角形,激光頭、攝像頭與目標物體組成的三角形,相似于攝像頭、成像點P與輔助點P′。P與輔助點P′。

設 PP′=x,q、d如圖所示,則由相似三角形可得:PP′=x,q、d如圖所示,則 由相似三角形可得:f/x=q/s ==》 q=fs/x

X可分為兩部分計算:X=x1+x2= f/tanβ + pixelSize* position

其中pixelSize是像素單位大小, position是成像的像素坐標相對于成像中心的位置。

最后,可求得距離d: d=q/sinβ

線狀激光三角測距原理:(同屬于下面結構光原理)

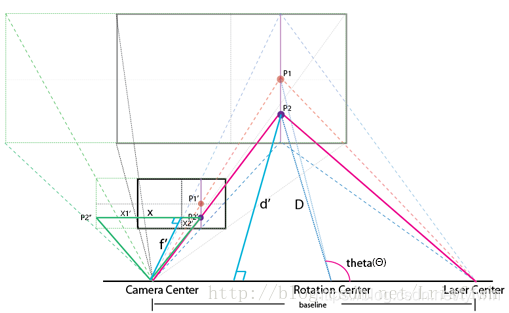

將激光光條的中心點P1、成像點P1′、攝像頭、激光頭作為基準面,中心點P1就符合單點結構光測距。對于任一點(該點不在基準面上),也可由三角測距得出。將激光光條的中心點P1、成像點P1′、攝像頭、激光頭作為基準面,中心點P1就符合單點結構光測距。對于任一點(該點不在基準面上),也可由三角測距得出。

如上圖所示,將成像平面鏡像到另一側。其中P1′,P2′和分別是P1和P2的成像位置,對于點P2、成像點P2′、攝像頭、激光頭所形成的平面,與基準面存在夾角θ,也符合單點結構光測距。此時的焦距為f′,x的幾何意義同單點激光測距原理。如上圖所示,將成像平面鏡像到另一側。其中P1′,P2′和分別是P1和P2的成像位置,對于點P2、成像點P2′、攝像頭、激光頭所形成的平面,與基準面存在夾角θ,也符合單點結構光測距。此時的焦距為f′,x的幾何意義同單點激光測距原理。

d‘/baseline=f’/x

d′是P2與baseline所成平面上P2到底邊的高(類比于單點激光測距原理中的q)。同樣x可分為兩部分計算d′是P2與baseline所成平面上P2到底邊的高(類比于單點激光測距原理中的q)。同樣x可分為兩部分計算:

x=f‘/tanβ + pixelSize* position

上述中的平面與基準面的夾角為θ上述中的平面與基準面的夾角為θ:

f’/f=cosθ tanθ=(|P2‘.y-P1’.y|)/f

可求得f′:可求得f′:f‘=f/cos(arctan((P2’.y-P1‘.y)/f))

三、結構光3D成像法

OPPO Find X和IphoneX等手機的前置攝像頭紛紛搭載。

單從光源本身理解什么是結構光:就是帶有一定結構的,而且我們自己是知道光源的這種結構的。

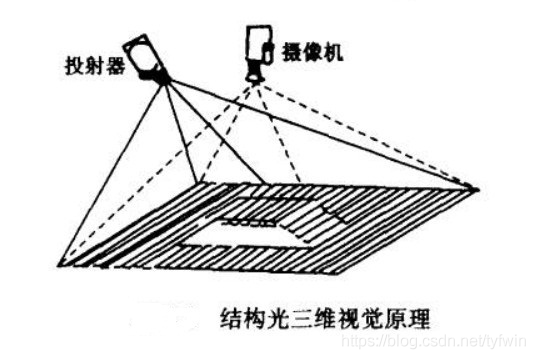

結構光三維視覺是基于光學三角測量原理。光學投射器將一定模式的結構光透射于物體表面,在表面上形成由被測物體表面形狀所調制的光條三維圖像。該三維圖像由處于另一位置的攝像機探測,從而獲得光條二維畸變圖像。光條的畸變程度取決于光學投射器與攝像機之間的相對位置和物體表面形狀輪廓(高度)。直觀上,沿著光條顯示出的位移(或者偏移)與物體表面高度成比例,扭結表示了平面的變化,不連續顯示了表面的物理間隙。當光學投射器與攝像機之間的相對位置一定時,由畸變的二維光條圖像坐標便可重現物體表面三維形狀輪廓。由光學投射器、攝像機、計算機系統即構成了結構光三維視覺系統。

根據光學投射器所投射的光束模式的不同,結構光模式又可分為點結構光模式、線結構光模式、多線結構光模式、面結構光模式、相位法等。

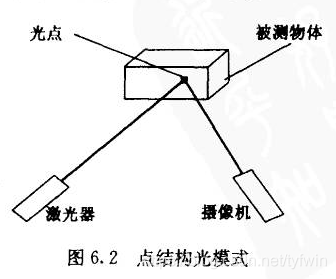

點結構光模式:(和上面介紹的三角測距一樣)如圖所示,激光器發出的光束投射到物體上產生一個光點,光點經攝像機的鏡頭成像在攝像機的像平面上,形成一個二維點。攝像機的視線和光束在空間中于光點處相交,形成一種簡單的三角幾何關系。通過一定的標定可以得到這種三角幾何約束關系,并由其可以唯一確定光點在某一已知世界坐標系中的空間位置。

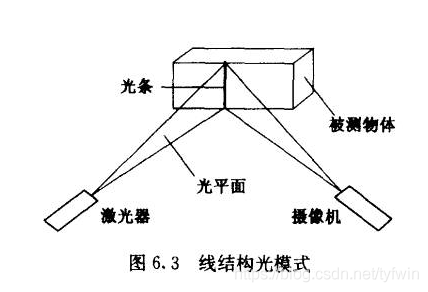

線結構光模式:(和上面介紹的三角測距一樣)線結構光模式是向物體投射一條光束,光條由于物體表面深度的變化以及可能的間隙而受到調制,表現在圖像中則是光條發生了畸變和不連續,畸變的程度與深度成正比,不連續則顯示出了物體表面的物理間隙。任務就是從畸變的光條圖像信息中獲取物體表面的三維信息;實際上,線結構光模式也可以說是點結構模式的擴展。過相機光心的視線束在空間中與激光平面相交產生很多交點,在物體表面處的交點則是光條上眾多的光點,因而便形成了點結構光模式中類似的眾多的三角幾何約束。很明顯,與點結構光模式相比較,線結構光模式的測量信息量大大增加,而其實現的復雜性并沒有增加,因而得到廣泛應用。

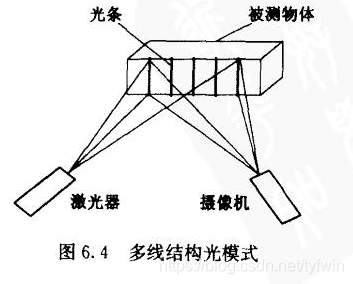

多線結構光模式:多線結構光模式是光帶模式的擴展。如圖,由光學投射器向物體表面投射了多條光條,其目的的一方面是為了在一幅圖像中可以處理多條光條,提高圖像的處理效率,另一方面是為了實現物體表面的多光條覆蓋從而增加測量的信息量,以獲得物體表面更大范圍的深度信息。也就是所謂的“光柵結構模式”,多光條可以采用投影儀投影產生一光柵圖樣,也可以利用激光掃描器來實現。

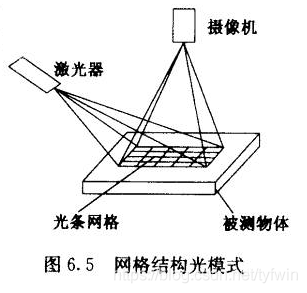

面結構光模式:當采用面結構光時,將二維的結構光圖案投射到物體表面上,這樣不需要進行掃描就可以實現三維輪廓測量,測量速度很快,光面結構光中最常用的方法是投影光柵條紋到物體表面。當投影的結構光圖案比較復雜時,為了確定物體表面點與其圖像像素點之間的對應關系,需要對投射的圖案進行編碼,因而這類方法又稱為編碼結構光測量法。圖案編碼分為空域編碼和時域編碼。空域編碼方法只需要一次投射就可獲得物體深度圖,適合于動態測量,但是目前分辨率和處理速度還無法滿足實時三維測量要求,而且對譯碼要求很高。時域編碼需要將多個不同的投射編碼圖案組合起來解碼,這樣比較容易實現解碼。主要的編碼方法有二進制編碼、二維網格圖案編碼、隨機圖案編碼、彩色編碼、灰度編碼、鄰域編碼、相位編碼以及混合編碼。

相位法:近年來基于相位的光柵投影三維輪廓測童技術有了很大的發展,將光柵圖案投射到被測物表面,受物體高度的調制,光柵條紋發生形變,這種變形條紋可解釋為相位和振幅均被調制的空間載波信號。采集變形條紋并且對其進行解調可以得到包含高度信息的相位變化,最后根據三角法原理計算出高度,這類方法又稱為相位法。基于相位測量的三維輪廓測量技術的理論依據也是光學三角法,但與光學三角法的輪廓術有所不同,它不直接去尋找和判斷由于物體高度變動后的像點,而是通過相位測量間接地實現,由于相位信息的參與,使得這類方法與單純光學三角法有很大區別。

四、飛行時間法ToF

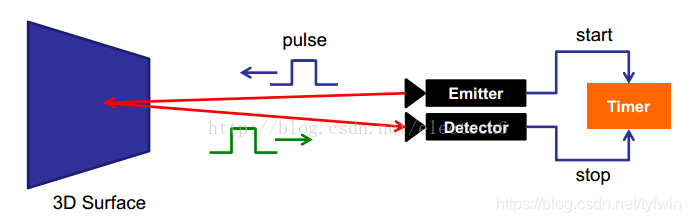

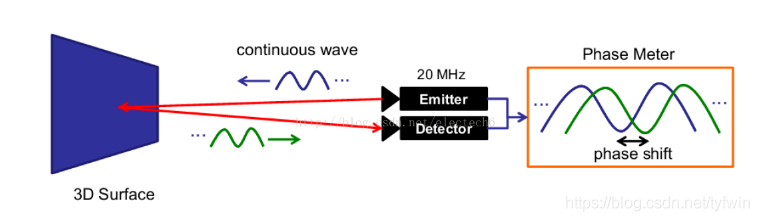

飛行時間是從Time of Flight直譯過來的,簡稱TOF。其基本原理是通過連續發射光脈沖(一般為不可見光)到被觀測物體上,然后用傳感器接收從物體返回的光,通過探測光脈沖的飛行(往返)時間來得到目標物距離。TOF法根據調制方法的不同,一般可以分為兩種:脈沖調制(Pulsed Modulation)和連續波調制(Continuous Wave Modulation)。

脈沖調制:脈沖調制方案的原理比較簡單,如下圖所示。它直接根據脈沖發射和接收的時間差來測算距離。

連續波調制:實際應用中,通常采用的是正弦波調制。由于接收端和發射端正弦波的相位偏移和物體距離攝像頭的距離成正比,因此可以利用相位偏移來測量距離。

目前的消費級TOF深度相機主要有:微軟的Kinect 2、MESA的SR4000 、Google Project Tango 中使用的PMD Tech 的TOF深度相機等。這些產品已經在體感識別、手勢識別、環境建模等方面取得了較多的應用,最典型的就是微軟的Kinect 2。

TOF深度相機對時間測量的精度要求較高,即使采用最高精度的電子元器件,也很難達到毫米級的精度。因此,在近距離測量領域,尤其是1m范圍內,TOF深度相機的精度與其他深度相機相比還具有較大的差距,這限制它在近距離高精度領域的應用。

但是,TOF深度相機可以通過調節發射脈沖的頻率改變相機測量距離;TOF深度相機與基于特征匹配原理的深度相機不同,其測量精度不會隨著測量距離的增大而降低,其測量誤差在整個測量范圍內基本上是固定的;TOF深度相機抗干擾能力也較強。因此,在測量距離要求比較遠的場合(如無人駕駛),TOF深度相機具有非常明顯的優勢。

五、光場成像法(Light field of imaging)

光場就是光輻射在空間各個位置各個方向的傳播。

全光函數:全光函數包含7個變量。

空間位置(3D)、特定方向(2D)、特定時刻(1D)、特定波長(1D)

L=p(x, y, z, θ, φ ,t, λ)

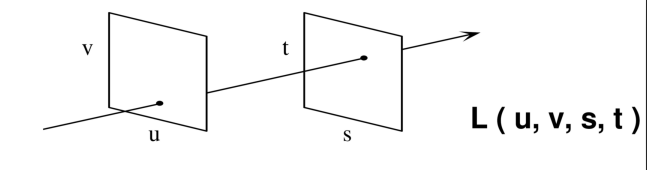

如圖所示:

若一條光線通過兩個平面UV和ST所產生的交點坐標分別為(u,v)和(s,t),此時就可以通過光場函數L(u,v,s,t)來表示這條光線的分布。L代表光線的強度,而(u,v)和(s,t)共同確定了光線在空間中分布的位置和方向。在四維(u,v,s,t)空間中:一條光線對應光場的一個采樣點。

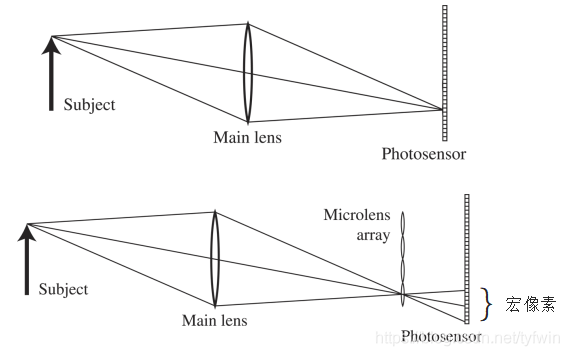

為什么要用這種雙平面的方式來確定光場的分布呢?這是因為常規的相機一般都可以簡化成兩個互相平行的平面——鏡頭的光瞳面和圖像傳感器所在的像平面。對于常規的相機來說,每個像素記錄了整個鏡頭所出射光線會聚在一個位置上的強度。

所以,傳統的相機只能獲取一個像平面的圖像。而如果能夠獲取到整個相機內的光場分布情況,我們就可以將光線重新投影到一個虛擬的像平面上,計算出這個新的像平面上所產生的圖像。光場相機的目的就在于對相機的光場分布進行記錄。

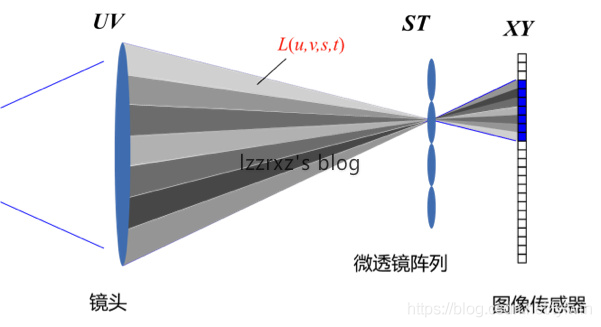

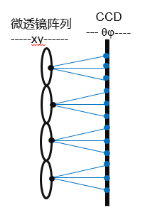

光場相機工作原理:光場相機由鏡頭、微透鏡陣列和圖像傳感器組成,其中微透鏡陣列是多個微透鏡單元所組成的二維陣列。鏡頭的光瞳面(UV面)和圖像傳感器的光敏面(XY面)關于微透鏡陣列(ST)成共軛關系,也就是說,鏡頭經過每個微透鏡單元都會投影到圖像傳感器上形成一個小的微透鏡子圖像。每個微透鏡子圖像包含了若干個像素,此時各像素所記錄的光線強度就來自于一個微透鏡和鏡頭的一個子孔徑區域之間所限制的細光束,如下圖。

這里的細光束也就是光場的離散采樣形式,通過微透鏡單元的坐標ST和鏡頭子孔徑的坐標UV即能夠確定每個細光束的位置和方向,獲得L(u,v,s,t)的分布。

如下圖:每個宏像素對應于光場的一個位置采樣。宏像素內的每一點對應于光場在該位置的一個方向采樣。光場的位置分辨率由采樣問隔決定。光場的方向分辨率由每個宏像素內所包含的像元數所決定的。

怎么實現數字對焦:正如前面所說,獲得相機內的光場分布后,就可以重新選擇一個虛擬的像平面,如上圖。

可以選擇更遠或更近的像面位置,計算出所有的光線在這個平面上的交點位置和能量分布,從而就得到了一幅新像面上的圖像。這個過程等價于傳統相機的調焦過程,只不過是通過數字計算來實現,因而被稱為數字調焦。

利用光場相機的數字調焦能力,只需要一次曝光就可以計算出不同像平面位置的圖像,能夠實現大光圈條件下的快速對焦。更進一步,利用不同深度平面的圖像序列,可以完成全景深圖像合成、三維深度估計等功能。

六、全息投影技術

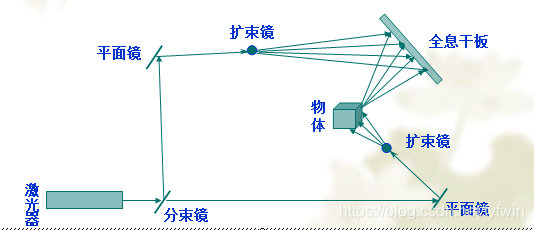

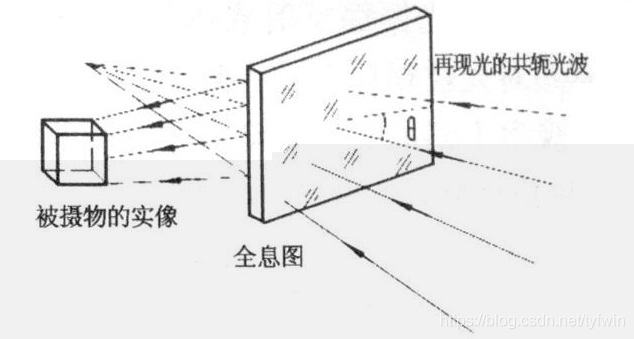

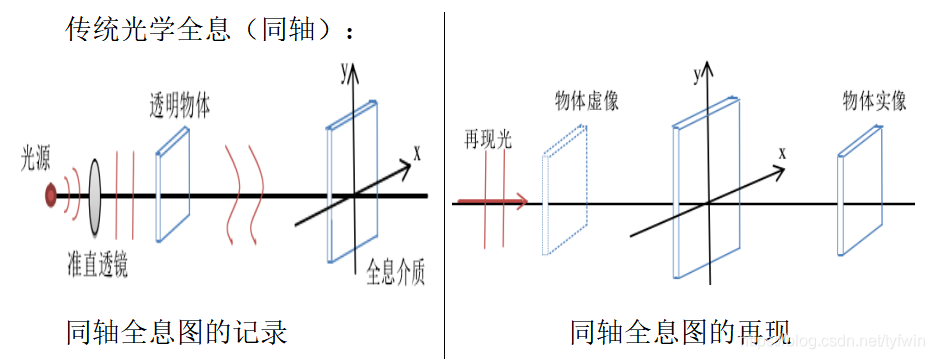

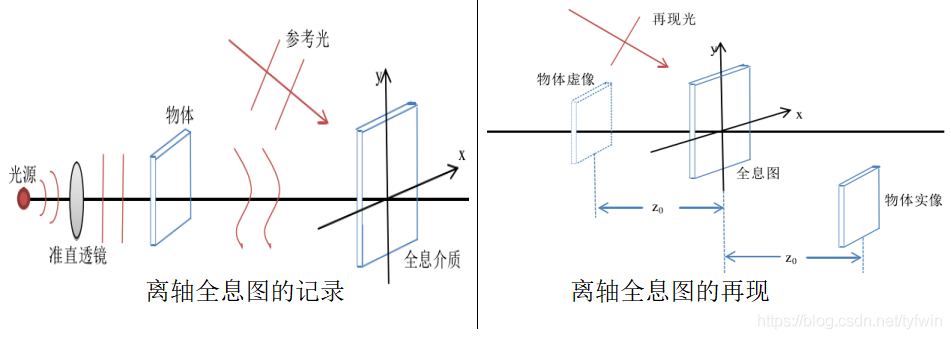

全息投影技術是利用干涉和衍射原理記錄并再現物體真實的三維圖像的記錄和再現的技術。

其第一步是利用干涉原理記錄物體光波信息,此即拍攝過程:被攝物體在激光輻照下形成漫射式的物光束;另一部分激光作為參考光束射到全息底片上,和物光束疊加產生干涉,把物體光波上各點的位相和振幅轉換成在空間上變化的強度,從而利用干涉條紋間的反差和間隔將物體光波的全部信息記錄下來。記錄著干涉條紋的底片經過顯影、定影等處理程序后,便成為一張諾利德全息圖,或稱全息照片。

其第二步是利用衍射原理再現物體光波信息,這是成象過程:全息圖猶如一個復雜的光柵,在相干激光照射下,一張線性記錄的正弦型全息圖的衍射光波一般可給出兩個象,即原始象(又稱初始象)和共軛象。再現的圖像立體感強,具有真實的視覺效應。全息圖的每一部分都記錄了物體上各點的光信息,故原則上它的每一部分都能再現原物的整個圖像,通過多次曝光還可以在同一張底片上記錄多個不同的圖像,而且能互不干擾地分別顯示出來。

如下圖。離軸全息和同軸全息。

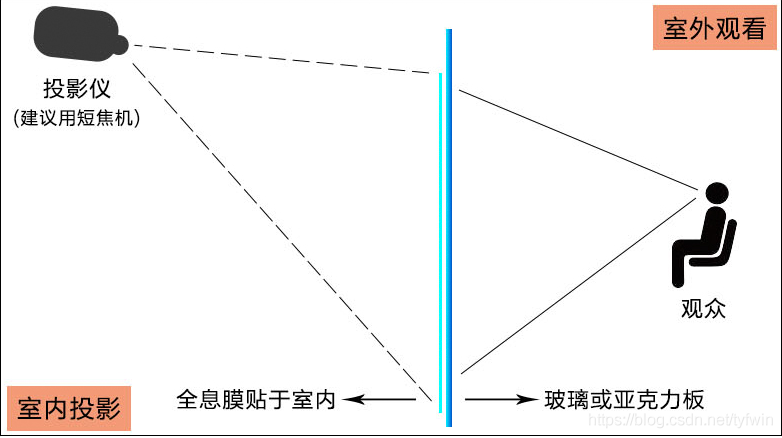

七、其他補充這里要解釋一下,人們看到的舞臺上的立體的效果,不是真正的全息,一般來說,只是一層介質膜,被商家炒概念為全息,只是偽全息。

電影院的3D眼鏡和全息更是半毛錢關系也沒有,原理是利用了人眼的視差。3D眼鏡有:互補色、偏振光、時分式。

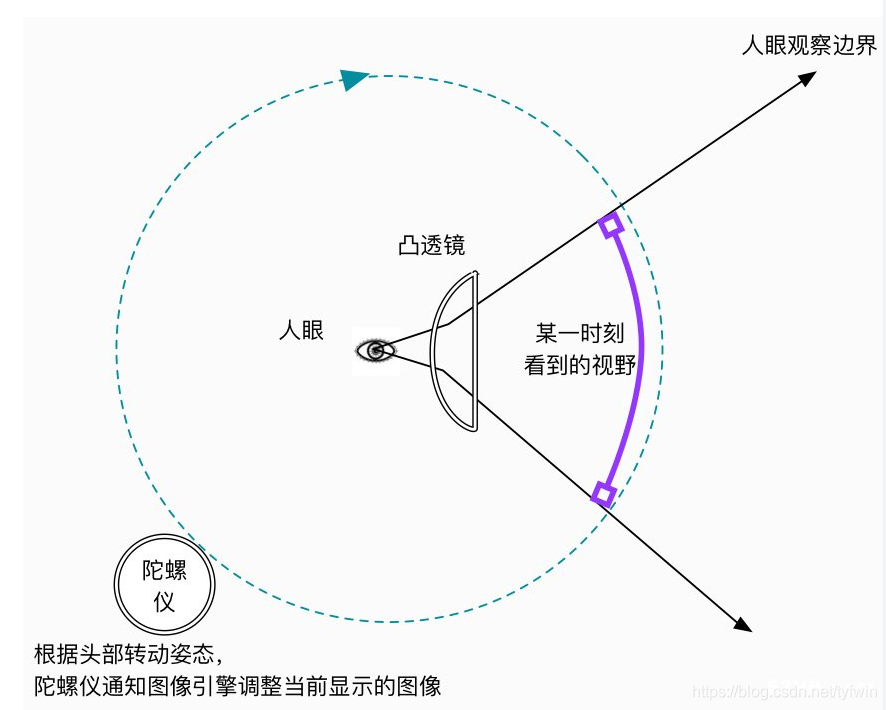

AR、VR技術和全息關系也不大。

VR虛擬現實就不說了,只是前期把各個位置各個角度的內容錄制合成,后期通過傳感器探測人的動作來對應的切換內容。

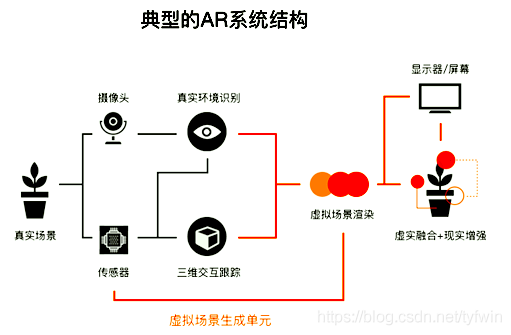

AR增強現實,如下圖分兩步,先獲取周圍世界的三維信息,

AR增強現實,如下圖分兩步,先獲取周圍世界的三維信息,再把虛擬的物體添加到上面,獲取三維世界的方法一般是:雙目、TOF、結構光。

各種3D眼鏡也沒有真全息成像技術。審核編輯:郭婷

-

mems

+關注

關注

129文章

4475瀏覽量

198814 -

激光雷達

+關注

關注

979文章

4470瀏覽量

196547

原文標題:3D成像方法匯總(原理解析):雙目視覺、激光三角、結構光、ToF、光場、全息

文章出處:【微信號:3D視覺工坊,微信公眾號:3D視覺工坊】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

禾賽科技2025年割草機器人3D激光雷達出貨量第一

3D雷達料位計應用行業有哪些

全球體積最小4D FMCW激光雷達亮相!

什么是激光雷達 3D SLAM技術?

多線激光雷達 3D SLAM 無人叉車系統解決方案:開啟工業物流新變革

從3D傳感器到立體相機,解鎖工業應用新可能

【CIE全國RISC-V創新應用大賽】+基于MUSE Pi Pro的3d激光里程計實現

洛微科技攜4D FMCW激光雷達與3D感知方案閃耀光博會,引領行業新趨勢

奧比中光發布最新一代3D激光雷達及雙目深度相機

海伯森面陣固態激光雷達產品概述

為什么割草機都在轉向3D激光雷達技術

激光雷達調研紀要

一徑科技NZ1全場景廣角3D激光雷達,面向泛機器人應用場景

激光雷達技術在自動駕駛汽車中的應用

激光雷達的3D成像原理及應用分類

激光雷達的3D成像原理及應用分類

評論