發布人:技術推廣工程師 Khanh LeViet,代表 TensorFlow Lite 團隊

在今年的 Google I/O 大會上,我們很高興地宣布推出了多項產品更新。這些更新可以幫助簡化移動設備上,目標檢測模型的訓練和部署的過程:

設備端 ML 學習路徑:關于如何在移動設備上,訓練和部署自定義目標檢測模型的分步教程,無需機器學習專業知識。

設備端 ML 學習路徑

https://developers.google.com/learn/pathways/going-further-object-detection

EfficientDet-Lite:針對移動設備優化的精尖目標檢測模型架構。

EfficientDet-Lite

https://hub.tensorflow.google.cn/s?deployment-format=lite&q=efficientdet-lite

用于目標檢測的 TensorFlow Lite Model Maker:只需幾行代碼即可訓練自定義模型

目標檢測

http://tensorflow.google.cn/lite/tutorials/model_maker_object_detection

TensorFlow Lite Metadata Writer API:簡化元數據創建以生成與 TFLite Task Library 兼容的自定義目標檢測模型。

Metadata Writer API

http://tensorflow.google.cn/lite/convert/metadata_writer_tutorial

TFLite Task Library

http://tensorflow.google.cn/lite/inference_with_metadata/task_library/object_detector

盡管目標檢測是非常常見的 ML 用例,但可能也是最難執行的用例之一。我們一直致力于為您簡化相關操作。在這篇文章中,我們將向您介紹如何利用 TensorFlow Lite 的最新產品、通過使用您自己的訓練數據構建最先進的移動端目標檢測。

設備端 ML 學習路徑:

在 12 分鐘內了解如何訓練和部署自定義 TensorFlow Lite 目標檢測模型

有了 TensorFlow Lite,訓練自定義目標檢測模型并將其部署到 Android 應用變得非常容易。我們已經發布了學習路徑,可指導您按步驟順利完成相關操作。

您可以通過視頻了解構建自定義目標檢測器的具體步驟:

1. 準備訓練數據。

2. 使用 TensorFlow Lite Model Maker 訓練自定義目標檢測模型。

3. 使用 TensorFlow Lite Task Library 在您的移動應用上部署模型。

我們還在 GitHub 上提供了帶有源代碼的 Codelab,供您自行試運行代碼。請嘗試一下,并告訴我們您的反饋!

Codelab

https://codelabs.developers.google.com/tflite-object-detection-android

告訴我們

https://github.com/googlecodelabs/odml-pathways/issues

EfficientDet-Lite:

移動端設備目標檢測最優模型架構之一

在移動設備上運行機器學習模型意味著我們始終需要在模型精度、推理速度和模型大小之間進行權衡。最優的移動端模型不僅需要更加精準,還需要更快地運行速度和更小的體積。我們采用了 EfficientDet 論文中發布的神經架構搜索技術,并優化了在移動設備上運行的模型架構,最終推出了名為 EfficientDet-Lite 的新型移動設備目標檢測模型系列。

EfficientDet

https://arxiv.org/abs/1911.09070

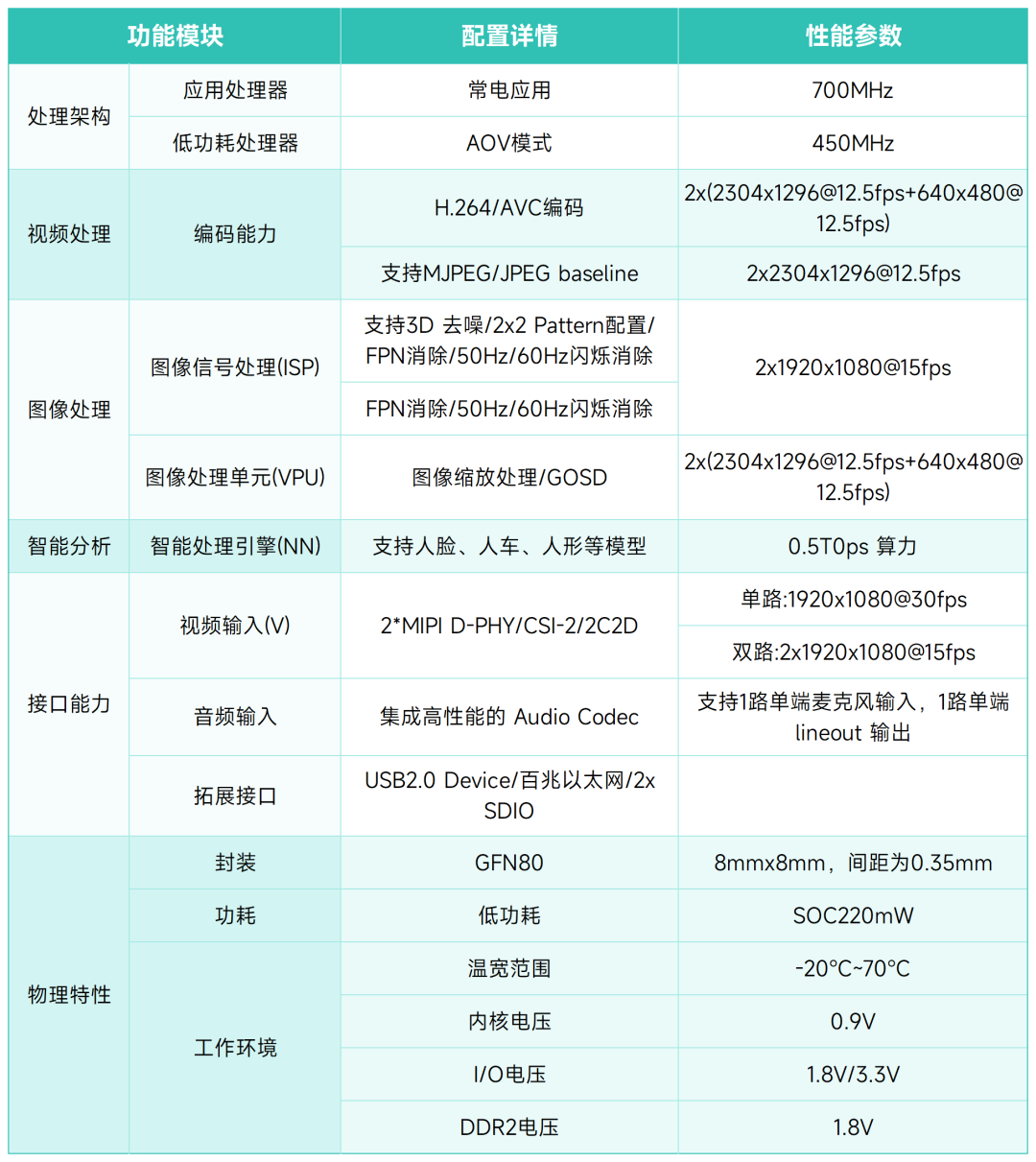

EfficientDet-Lite 有 5 個不同的版本:從 Lite0 到 Lite4。較小的版本運行速度更快,而較大的版本精度更高。您可以先用多個版本的 EfficientNet-Lite 進行試驗,然后選擇最適合您用例的版本。

* 整型量化模型的大小

** 在 Pixel 4 上使用 4 個 CPU 線程測量得出的延遲時間

*** 平均精度是 COCO 2017 驗證數據集上的 mAP(平均精度均值)

我們已將在 COCO 數據集上訓練的 EfficientDet-Lite 模型發布到 TensorFlow Hub。您還可以使用自己的訓練數據,通過 TensorFlow Lite Model Maker 訓練 EfficientDet-Lite 自定義模型。

TensorFlow Hub

https://hub.tensorflow.google.cn/s?q=efficientdet/lite

TensorFlow Lite Model Maker:幾行代碼使用遷移學習訓練自定義目標檢測模型

TensorFlow Lite Model Maker 是 Python 庫,可顯著簡化使用自定義數據集訓練機器學習模型的過程。該庫利用遷移學習,僅使用少量圖像即可訓練高質量模型。

TensorFlow Lite Model Maker

http://tensorflow.google.cn/lite/guide/model_maker

Model Maker 接受 PASCAL VOC 格式和 Cloud AutoML 的 CSV 格式的數據集。和使用 LabelImg 或 makesense.ai 等開源 GUI 工具創建自己的數據集一樣,每位開發者都可以創建用于 Model Maker 的訓練數據,且無需編寫任何代碼。

CSV

https://cloud.google.com/vision/automl/object-detection/docs/csv-format

LabelImg

https://github.com/tzutalin/labelImg

makesense.ai

https://github.com/SkalskiP/make-sense

獲得訓練數據后,您就可以開始訓練自定義的 TensorFlow Lite 目標檢測模型了。

# Step 1: Choose the model architecture

spec = model_spec.get(‘efficientdet_lite2’)

# Step 2: Load your training data

train_data, validation_data, test_data = object_detector.DataLoader.from_csv(‘gs://cloud-ml-data/img/openimage/csv/salads_ml_use.csv’)

# Step 3: Train a custom object detector

model = object_detector.create(train_data, model_spec=spec, validation_data=validation_data)

# Step 4: Export the model in the TensorFlow Lite format

model.export(export_dir=‘。’)

# Step 5: Evaluate the TensorFlow Lite model

model.evaluate_tflite(‘model.tflite’, test_data)

查看此 Codelab 了解詳情。

Codelab

http://tensorflow.google.cn/lite/tutorials/model_maker_object_detection

TensorFlow Lite Task Library:使用幾行代碼在移動設備上部署目標檢測模型

TensorFlow Lite Task Library 是跨平臺庫,它簡化了 TensorFlow Lite 模型在移動設備上的部署。使用 TensorFlow Lite Model Maker 訓練的自定義目標檢測模型只需使用幾行 Kotlin 代碼即可部署到 Android 應用:

// Step 1: Load the TensorFlow Lite model

val detector = ObjectDetector.createFromFile(context, “model.tflite”)

// Step 2: Convert the input Bitmap into a TensorFlow Lite‘s TensorImage object

val image = TensorImage.fromBitmap(bitmap)

// Step 3: Feed given image to the model and get the detection result

val results = detector.detect(image)

您可參閱一下文檔,了解有關 Task Library 中,包括如何配置最小檢測閾值或最大檢測對象數量等更多自定義選項信息。

文檔

https://tensorflow.google.cn/lite/inference_with_metadata/task_library/object_detector

TensorFlow Lite Metadata Writer API:

用于簡化使用 TensorFlow Object Detection API 訓練的自定義模型的部署

Task Library 依賴 TensorFlow Lite 模型中捆綁的模型元數據來執行必要的預處理和后處理邏輯,以便使用該模型來運行推理。這其中包括如何將輸入圖像歸一化,或如何將類 ID 映射到可人工讀取的標簽。因為使用 Model Maker 訓練的模型會默認包含此類元數據,所以它能夠與 Task Library 兼容。但是,如果您使用除 Model Maker 以外的訓練流水線,來訓練 TensorFlow Lite 目標檢測,則可以使用 TensorFlow Lite Metadata Writer API 來添加元數據。

模型元數據

https://tensorflow.google.cn/lite/convert/metadata

例如,如果您使用 TensorFlow Object Detection API 來訓練模型,則可以使用以下 Python 代碼將元數據添加到 TensorFlow Lite 模型:

LABEL_PATH = ’label_map.txt‘

MODEL_PATH = “ssd_mobilenet_v2_fpnlite_640x640_coco17_tpu-8/model.tflite”

SAVE_TO_PATH = “ssd_mobilenet_v2_fpnlite_640x640_coco17_tpu-8/model_with_metadata.tflite”# Step 1: Specify the preprocessing parameters and label file

writer = object_detector.MetadataWriter.create_for_inference(

writer_utils.load_file(MODEL_PATH), input_norm_mean=[0],

input_norm_std=[255], label_file_paths=[LABEL_PATH])

# Step 2: Export the model with metadata

writer_utils.save_file(writer.populate(), SAVE_TO_PATH)

在示例中,我們指定歸一化參數 (input_norm_mean=[0], input_norm_std=[255]) ,以便將輸入圖像歸一化到 [0..1] 范圍內。您需要指定與模型訓練期間使用的預處理邏輯中相同的歸一化參數。

歸一化

http://tensorflow.google.cn/lite/convert/metadata#normalization_and_quantization_parameters

參閱此 Colab,獲取有關如何將使用 TensorFlow Object Detection API 訓練的模型轉換為 TensorFlow Lite 模型并添加元數據的完整教程。

Colab

https://colab.research.google.com/github/tensorflow/models/blob/master/research/object_detection/colab_tutorials/convert_odt_model_to_TFLite.ipynb

未來計劃

我們的目標是讓每位開發者(無論是否具備機器學習專業知識)都能更輕松使用機器學習。目前,我們正在與 TF Model Garden 團隊合作,希望推出更多適用于 Model Maker 的目標檢測模型架構。

未來,我們還將繼續與 Google 研究人員合作,通過 Model Maker 提供更多面向未來的更優秀的目標檢測模型,縮短從前沿研究到投入實際應用并且供所有開發者使用的整個流程。敬請關注更多動態!

編輯:jq

-

Google

+關注

關注

5文章

1807瀏覽量

60510 -

ML

+關注

關注

0文章

154瀏覽量

35476 -

目標檢測

+關注

關注

0文章

233瀏覽量

16492 -

GitHub

+關注

關注

3文章

488瀏覽量

18660

原文標題:使用 TensorFlow Lite 簡化移動端目標檢測

文章出處:【微信號:yingjiansanrenxing,微信公眾號:硬件三人行】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

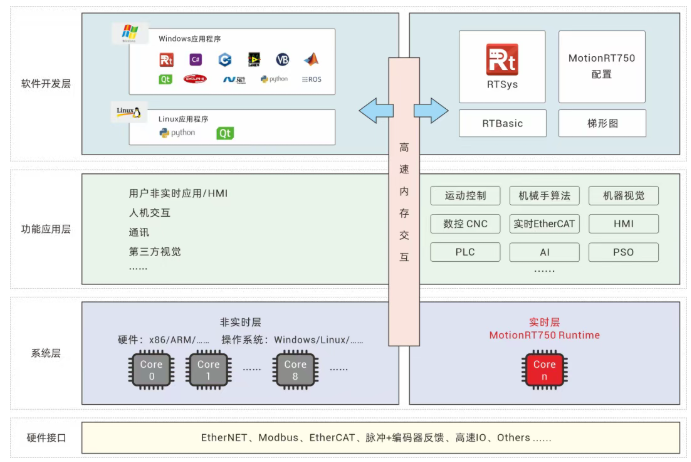

如何訓練自己的AI模型——RT-Thread×富瀚微FH8626V300L模型訓練部署教程 | 技術集結

AMD利用可重構FPGA設備Moku實現自定義激光探測解決方案

如何在e203 SOC中添加自定義外設

完整指南:如何使用樹莓派5、Hailo AI Hat、YOLO、Docker進行自定義數據集訓練?

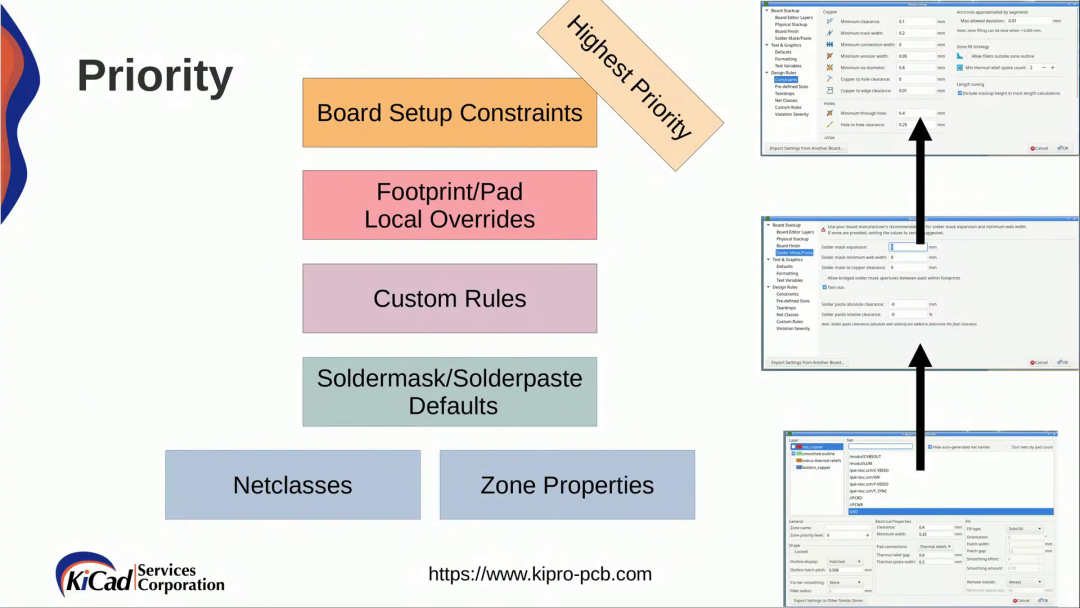

KiCad 中的自定義規則(KiCon 演講)

如何在移動設備上訓練和部署自定義目標檢測模型

如何在移動設備上訓練和部署自定義目標檢測模型

評論