在深度學習領域,有一個名詞正在被越來越地關注:遷移學習。它相比效果表現好的監督學習來說,可以減去大量的枯燥標注過程,簡單來說就是在大數據集訓練的預訓練模型上進行小數據集的遷移,以獲得對新數據較好的識別效果,因其能夠大量節約新模型開發的成本,在實際應用中被更廣泛地關注。EasyDL 專業版在最新上線的版本中,就引入了百度超大規模視覺預訓練模型,結合遷移學習工具,幫助開發者使用少量數據,快速定制高精度 AI 模型。

在訓練一個深度學習模型時,通常需要大量的數據,但數據的采集、標注等數據準備過程會耗費大量的人力、金錢和時間成本。為解決此問題,我們可以使用預訓練模型。以預訓練模型 A 作為起點,在此基礎上進行重新調優,利用預訓練模型及它學習的知識來提高其執行另一項任務 B 的能力,簡單來說就是在大數據集訓練的預訓練模型上進行小數據集的遷移,以獲得對新數據較好的識別效果,這就是遷移學習(Transfer Learning)。

遷移學習作為一種機器學習方法,廣泛應用于各類深度學習任務中。在具體實現遷移學習時,有多種深度網絡遷移方法,其中的 Fine-tune(微調)是最簡單的一種深度網絡遷移方法,它主要是將已訓練好的模型參數遷移到新的模型來幫助新模型訓練。

針對一個具體的模型開發任務,我們通常會選擇在公開的大數據集上訓練收斂、且效果較好的模型,作為預訓練權重,在此基礎上使用業務數據對模型進行 Fine-tune。在 Fine-tune 時,默認源域(預訓練模型)、目標域數據集(用戶業務數據集)需要具有較強相關性,即數據同分布,這樣我們才能利用預訓練模型的大量知識儲備,快速高效地訓練出針對特定業務場景并具有優秀效果的模型。

但在實際應用場景中,很多用戶會面臨數據集與源數據集分布不同的問題。比如,預訓練模型的數據都是自然風景,但用戶的數據集都是動漫人物。類似這種源數據集和目標數據差別較大的問題,在具體應用中較易導致負向遷移,具體表現為訓練收斂慢,模型效果差等。

因此,一個包含各類場景、覆蓋用戶各類需求的超大規模數據集就十分重要,通過這個包羅萬象的超大規模數據集訓練所得的模型,才能夠更好地適應來自各行各業用戶的需求,更好地 Fine-tune 用戶的業務數據集,幫助用戶在自己的數據集上得到效果更好的模型。

百度超大規模預訓練模型便在此背景下產生,覆蓋自然語言處理和視覺兩大方向。

在自然語言處理方向,百度自研了業界效果最好的預訓練模型 ERNIE,開創性地將大數據預訓練與多源豐富知識相結合,持續學習海量數據中的知識,將機器語義理解水平提升到一個新的高度。ERNIE 在中英文的16個任務上已經超越了業界最好模型,全面適用于各類 NLP 應用場景。目前,EasyDL 專業版已預置了領先的預訓練模型 ERNIE2.0,并配套了多種 NLP 經典算法網絡,支持了文本分類、短文本匹配和序列標注等典型文本處理任務。

視覺方向,百度自研超大規模視覺預訓練模型覆蓋圖像分類與物體檢測兩個方向。圖像分類的預訓練模型,用海量互聯網數據,包括10萬+的物體類別,6500萬的超大規模圖像數量,進行大規模訓練所得,適應于各類圖像分類場景;物體檢測的預訓練模型,用800+的類別,170萬張圖片以及1000萬+物體框的數據集,進行大規模訓練所得,適應于各類物體檢測應用場景。相對于普通使用公開數據集訓練的預訓練模型,在各類數據集上都有不同程度效果提升,模型效果和泛化性都有顯著提升。

- 以下實驗數據集均來自不同行業

圖像分類

在圖像分類模型中,使用百度超大規模預訓練模型的 Resnet50_vd 相比普通模型在各類數據集上平均提升12.76%,使用百度超大規模預訓練模型的 Resnet101_vd,相比于普通預訓練模型,平均提升13.03%,使用百度超大規模預訓練模型的 MobilenetV3_large_1x,相比于普通預訓練模型,平均提升8.04%。

并且,在圖像分類方向,還新增了11個模型,包括:EffcientNetB0_small,EfficientNetB4,MobileNetV3_large_x1_0,ResNet18_vd, ResNeXt101_32x16d_wsl, Res2Net101_vd_26w_4s, SE_ResNet18_vd, Xception71,還有基于百度超大規模預訓練模型訓練出來的 ResNet50_vd,ResNet101_vd 和 MobileNetV3_large_x1_0,其中比較特殊的幾個模型,EffcientNetB0_small 是去掉 SE 模塊的 EffcientNetB0,在保證精度變化不大的同時,大幅提升訓練和推理速度,ResNeXt101_32x16d_wsl 是基于超大量圖片的弱監督預訓練模型,準確率高,但預測時間相對增加,Res2Net101_vd_26w_4s 則是在單個殘差塊內進一步構造了分層的殘差類連接,比 ResNet101 準確度更高。

新增的分類模型的推理時間、效果,以及支持的部署方式如下表所示:

注:以上模型均基于 ImageNet1k 分類數據集訓練和測試

更多預置模型,參見 EasyDL 官網

https://ai.baidu.com/ai-doc/E...

更多模型效果,參見 PaddleClas

https://paddleclas.readthedoc...

并且,為了進一步提升圖像分類模型的模型效果,在訓練層面,圖像分類新增了 mix_up 和 label_smoothing 功能,可以在單標簽分類任務中,根據模型的訓練情況選擇開啟或者關閉。

mix_up 是一種數據增強方式,它從訓練樣本中隨機抽取了兩個樣本進行簡單的隨機加權求和,并保存這個權重,同時樣本的標簽也對應地用相同的權重加權求和,然后預測結果與加權求和之后的標簽求損失,通過混合不同樣本的特征,能夠減少模型對錯誤標簽的記憶力,增強模型的泛化能力。

Label_smoothing 是一種正則化的方法,增加了類間的距離,減少了類內的距離,避免模型對預測結果過于 confident 而導致對真實情況的預測偏移,一定程度上緩解由于 label 不夠 soft 導致過擬合的問題。

物體檢測

在物體檢測模型中,使用百度超大規模預訓練模型的 YOLOv3_DarkNet 相比普通模型在各類數據集上平均提升4.53%,使用百度超大規模預訓練模型的 Faster_RCNN,相比于普通預訓練模型,平均提升1.39%。

并且,在物體檢測方向,新增了 Cascade_Rcnn_ResNet50_FPN、YOLOv3_ResNet50vd_DCN、YOLOv3_MobileNetv1 網絡,以及基于百度超大規模預訓練模型訓練出來的 YOLOv3_Darknet、Faster_R-CNN_ResNet50_FPN,其中,Cascade_Rcnn_ResNet50_FPN 通過級聯多個檢測器以及設置不同 IOU 的重采樣機制,使得檢測器的精度、和定位的準確度進一步提升。

此外,針對用戶的需求,新增兩種 YOLOv3 的變種模型,其中,YOLOv3_MobileNetv1 是將原來的 YOLOv3 骨架網絡替換為 MobileNetV1,相比 YOLOv3_DarkNet,新模型在 GPU 上的推理速度提升約73%。而 YOLOv3_ResNet50vd_DCN 是將骨架網絡更換為 ResNet50-VD,相比原生的 DarkNet53 網絡在速度和精度上都有一定的優勢,在保證 GPU 推理速度基本不變的情況下,提升了1%的模型效果,同時,因增加了可形變卷積,對不規則物體的檢測效果也有一定的正向提升。

各檢測模型的效果,以及支持的部署方式如下表所示:

注:以上模型均基于 COCO17 數據集訓練和測試

更多預置模型,參見 EasyDL 官網

https://ai.baidu.com/ai-doc/E...

更多模型效果,參見 PaddleDetection

https://github.com/PaddlePadd...

各模型的推理時間如下表所示:

注:以上模型均基于 coco17 訓練所得

更多模型速度詳情,參見 PaddleDetection

https://github.com/PaddlePadd...

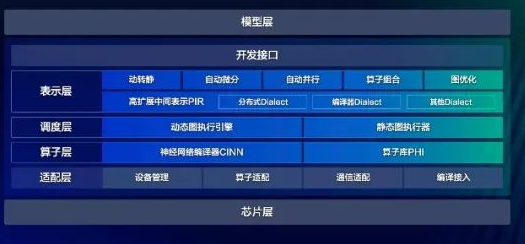

百度超大規模視覺預訓練模型對比公開數據集訓練的預訓練模型,效果提升明顯,目前這些模型已經預置在 EasyDL 專業版中正式發布。EasyDL 專業版是面向專業算法工程師群體專門推出的 AI 模型開發與服務平臺。支持視覺及自然語言處理兩大技術方向,可靈活支持腳本調參及 Notebook 兩類開發方式,預置了幾十種經典網絡和百度海量數據訓練的預訓練模型,模型效果在業界保持領先,同時支持公有云/私有化/設備端等靈活的部署方案,開發效率高、訓練速度快,同時設備端輕量級部署和加速方案使得顯存占用更少,預測速度更快。

開發者可以搜索進入 EasyDL 平臺,選擇專業版,選擇【新建任務】-【配置任務】-【選擇預訓練模型】處選擇【百度超大規模數據集 通用分類預訓練模型】

零門檻 AI 開發平臺 EasyDL,面向 AI 開發全流程提供靈活易用的一站式平臺方案。包含了 AI 開發過程中的三大流程:數據服務、訓練與開發、模型部署。

在數據服務上,剛剛上線的 EasyData 智能數據服務平臺覆蓋了數據采集、管理、清洗、標注、安全,并支持接入 EasyDL 進行訓練,在模型訓練部署之后,在云服務授權的前提下完成數據回流,針對性地進行難例挖掘,獲得更有助于模型效果提升的高質量數據。

EasyData 是業內首家推出了軟硬一體、端云協同自動數據采集方案的平臺,有離線視頻數據采集的用戶,可以下載 EasyData 的數據采集 SDK,通過定時拍照、視頻抽幀等方式,實時統計到云端進行處理。

在訓練與開發上,除了剛剛提到的大規模預訓練模型來提升模型性能,EasyDL 還采用了 AutoDL 自動搜索最優網絡及超參數,以及自動數據增強、自動超參搜索來增加數據量和多樣性、分布式訓練加速等豐富的訓練機制提升模型的訓練速度。

在模型部署上,EasyDL 提供端云協同的多種靈活部署方式,包括公有云 API、設備端 SDK、本地服務器部署、軟硬一體產品。值得關注的是,在 EasyDL 軟硬一體產品矩陣方案中,提供了六款軟硬一體方案,覆蓋超高性能,高性能和低成本小功耗三種不同形態,滿足開發者的各類業務需求,已經在幾十個行業上百個場景中落地應用。

點擊鏈接進入 EasyDL 專業版,感受預訓練模型的強大效果吧!

審核編輯:符乾江

-

AI

+關注

關注

91文章

39878瀏覽量

301530 -

人工智能

+關注

關注

1817文章

50106瀏覽量

265561

發布評論請先 登錄

中科曙光scaleX萬卡超集群重塑超大規模算力基礎設施

基于大規模人類操作數據預訓練的VLA模型H-RDT

寧暢與與百度文心大模型展開深度技術合作

偉創力高效電源模塊在超大規模數據中心的應用

華為正式開源盤古7B稠密和72B混合專家模型

65%央企大模型落地首選百度智能云

納微半導體推出12kW超大規模AI數據中心電源

百度文心大模型X1 Turbo獲得信通院當前大模型最高評級證書

AI原生架構升級:RAKsmart服務器在超大規模模型訓練中的算力突破

用PaddleNLP為GPT-2模型制作FineWeb二進制預訓練數據集

EasyDL上線百度超大規模預訓練模型,模型效果顯著提升

EasyDL上線百度超大規模預訓練模型,模型效果顯著提升

評論