近期,上海交通大學(xué)盧策吾團(tuán)隊(duì)在《自然 - 機(jī)器智能》子刊上發(fā)表了關(guān)于高維度視覺(jué)序列理解的研究成果《Complex sequential understanding through the awareness of spatial and temporal concepts》。

與此同時(shí),該團(tuán)隊(duì)將論文代碼與近兩年在視頻理解領(lǐng)域的先進(jìn)成果開源為視頻理解工具箱 AlphaVideo。

AlphaVideo 在物體跟蹤任務(wù)(MOT)和行為理解(AVA 單模型)上都達(dá)到最高準(zhǔn)確率,相比 SlowFast (AVA 單模型)有 12.6% 的性能提升。

動(dòng)作理解任務(wù)的時(shí)空信息特征圖。左:輸入序列;右:空間特征更關(guān)注物體形狀,時(shí)間特征更關(guān)注物體運(yùn)動(dòng)趨勢(shì)。

AlphaVideo 中的行為理解(Alphaction)

時(shí)空概念提取展示

人類視覺(jué)理解機(jī)理

在人類的視覺(jué)認(rèn)知過(guò)程中,時(shí)間和空間概念是解耦的。神經(jīng)科學(xué)領(lǐng)域的研究發(fā)現(xiàn)在人類的記憶形成過(guò)程中,時(shí)間信息與空間上下文信息通過(guò)兩個(gè)相對(duì)獨(dú)立的信息通路到達(dá)海馬體,進(jìn)而形成完整的記憶。

新技能:自主學(xué)習(xí)時(shí)空概念

通過(guò)模仿人類的認(rèn)知機(jī)制,盧策吾團(tuán)隊(duì)提出了應(yīng)用于高維度信息的半耦合結(jié)構(gòu)模型(SCS)。

SCS 自主發(fā)掘(awareness)時(shí)間 - 空間概念,并讓他們耦合協(xié)作以理解序列信息。這種能力代表著機(jī)器學(xué)習(xí)模型自主掌握了時(shí)空的概念,這是一種更高層的智能。更進(jìn)一步,時(shí)空信息概念的分離也讓「概念編輯」成為可能。

半耦合結(jié)構(gòu)模型(SCS)

半耦合結(jié)構(gòu)首先解耦時(shí)空信息(模仿人腦中的兩條信息通路),并在分別處理時(shí)間和空間信息之后將二者耦合(模仿海馬體):

該研究通過(guò)堆疊這種半耦合的元結(jié)構(gòu)來(lái)構(gòu)建深度模型,其中時(shí)空信息始終以先解耦再融合的模式向后流動(dòng)。

為了讓 h_s 和 h_t 各司其職,研究者將 h_s 和 h_t 設(shè)計(jì)為不對(duì)稱的結(jié)構(gòu),同時(shí),使用兩個(gè)特殊的監(jiān)督目標(biāo) r_s、r_t 來(lái)進(jìn)一步約束二者關(guān)注各自的工作。

該研究進(jìn)一步提出了一種訓(xùn)練注意力機(jī)制。這種注意力機(jī)制控制模型在優(yōu)化過(guò)程中學(xué)習(xí)哪種信息。例如在視頻信息中,模型可以優(yōu)先將注意力集中在空間信息上,待空間信息有效且穩(wěn)定時(shí),再逐步將模型訓(xùn)練的注意力轉(zhuǎn)換到時(shí)間信息上。

SCS 的表現(xiàn)如何?

該研究展示了 SCS 在多項(xiàng)任務(wù)中與傳統(tǒng) LSTM 的性能對(duì)比結(jié)果:

SCS 在視頻動(dòng)作分類、自動(dòng)駕駛、天氣預(yù)報(bào)等 4 個(gè)任務(wù)上的性能均超越傳統(tǒng)的序列模型。

概念編輯

有了時(shí)空分離的能力,SCS 就可以初步做到「概念編輯」。比如,通過(guò)編輯空間概念且保留時(shí)間概念,我們可以讓一個(gè)原本用于預(yù)測(cè)狗運(yùn)動(dòng)軌跡的模型來(lái)預(yù)測(cè)貓的軌跡。這樣就能以較小的代價(jià)實(shí)現(xiàn)模型的泛化,同時(shí)也拓寬了模型的使用場(chǎng)景,降低了部署難度。

概念編輯 demo

研究者讓計(jì)算機(jī)看 Flappy Bird 的視頻,然后看一張靜態(tài)的 Mario 圖片(外觀形象)。在這個(gè)過(guò)程中,模型并沒(méi)有接觸到任何 Mario 在管道中穿梭的運(yùn)動(dòng)信息。但通過(guò)「概念編輯」,在測(cè)試時(shí) SCS 可以準(zhǔn)確地預(yù)測(cè) Mario 的運(yùn)動(dòng)軌跡。

視頻理解工具箱 AlphaVideo

在視頻理解工具箱 AlphaVideo 中,除了上述 SCS 時(shí)空概念分解,研究者還提供了單階段端對(duì)端訓(xùn)練的多目標(biāo)跟蹤模型 TubeTK 和視頻動(dòng)作檢測(cè)模型 AlphAction。使用一行代碼,即可調(diào)用預(yù)訓(xùn)好的各類模型。

AlphAction

AlphAction 是面向行為理解的開源系統(tǒng),基于 MVIG 提出的交互理解與異步訓(xùn)練策略 在 AVA 數(shù)據(jù)集上達(dá)到最優(yōu)準(zhǔn)確率,速度達(dá)到 10 幀每秒。其中包含的 15 個(gè)開源常見(jiàn)行為基本模型的 mAP 達(dá)到約 70%,接近可以商用的水平。

TubeTK

TubeTK 是上海交大 MVIG 組提出的基于 Bounding-Tube 的單階段訓(xùn)練模型(CVPR2020-oral),是首個(gè)單階段端對(duì)端訓(xùn)練的多目標(biāo)跟蹤模型。它在 MOT-16 數(shù)據(jù)集上達(dá)到了 66.9 MOTA 的精度,是目前 online 模型僅在 MOT 訓(xùn)練數(shù)據(jù)下達(dá)到的最高精度 。

TubeTK 可視化結(jié)果

Bounding-Tube 示意圖。使用 bounding-tube 可以輕松跟蹤到 bounding-box 無(wú)法檢測(cè)到的被遮擋目標(biāo)(圖中黃色框)。

責(zé)任編輯:pj

-

解耦

+關(guān)注

關(guān)注

0文章

43瀏覽量

12216 -

自動(dòng)駕駛

+關(guān)注

關(guān)注

793文章

14880瀏覽量

179798 -

機(jī)器智能

+關(guān)注

關(guān)注

0文章

55瀏覽量

8930

發(fā)布評(píng)論請(qǐng)先 登錄

機(jī)器視覺(jué)系統(tǒng)之工業(yè)相機(jī)解讀

迷人的相似之處:人類內(nèi)耳與村田MEMS傳感器

安防監(jiān)控系統(tǒng)如何成為城市的“智慧視覺(jué)中樞”

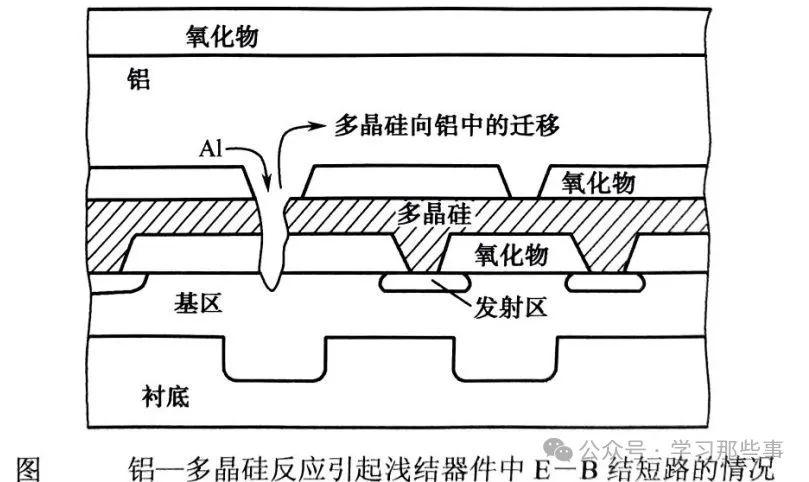

集成電路制造中封裝失效的機(jī)理和分類

iTOF技術(shù),多樣化的3D視覺(jué)應(yīng)用

機(jī)器視覺(jué)系統(tǒng)工業(yè)相機(jī)的成像原理及如何選型

勵(lì)展博覽集團(tuán)與機(jī)器視覺(jué)產(chǎn)業(yè)聯(lián)盟(CMVU)關(guān)于VisionChina(深圳)達(dá)成戰(zhàn)略合作

一文帶你了解什么是機(jī)器視覺(jué)網(wǎng)卡

自動(dòng)駕駛純視覺(jué)方案到底有哪些弊端?

基于LockAI視覺(jué)識(shí)別模塊:C++圖像的基本運(yùn)算

基于MindSpeed MM玩轉(zhuǎn)Qwen2.5VL多模態(tài)理解模型

?VLM(視覺(jué)語(yǔ)言模型)?詳細(xì)解析

工業(yè)自動(dòng)化中機(jī)器視覺(jué)技術(shù)的演變和未來(lái)發(fā)展趨勢(shì)

關(guān)于人類視覺(jué)理解機(jī)理

關(guān)于人類視覺(jué)理解機(jī)理

評(píng)論