NVIDIA CUDA 深度神經(jīng)網(wǎng)絡庫(cuDNN)是一個 GPU 加速的深度神經(jīng)網(wǎng)絡基元庫,能夠以高度優(yōu)化的方式實現(xiàn)標準例程(如前向和反向卷積、池化層、歸一化和激活層)。

2022-07-23 11:04:34 1920

1920 在兩層神經(jīng)網(wǎng)絡之間,必須有激活函數(shù)連接,從而加入非線性因素,提高神經(jīng)網(wǎng)絡的能力。所以,我們先從激活函數(shù)學起,一類是擠壓型的激活函數(shù),常用于簡單網(wǎng)絡的學習;另一類是半線性的激活函數(shù),常用于深度網(wǎng)絡的學習。

2023-08-07 10:02:29 1208

1208

在如今的網(wǎng)絡時代,錯綜復雜的大數(shù)據(jù)和網(wǎng)絡環(huán)境,讓傳統(tǒng)信息處理理論、人工智能與人工神經(jīng)網(wǎng)絡都面臨巨大的挑戰(zhàn)。近些年,深度學習逐漸走進人們的視線,通過深度學習解決若干問題的案例越來越多。一些傳統(tǒng)的圖像

2024-01-11 10:51:32 3474

3474

英特爾正與百度合作開發(fā)英特爾? Nervana?神經(jīng)網(wǎng)絡訓練處理器(NNP-T)。這一合作包括全新定制化加速器,以實現(xiàn)極速訓練深度學習模型的目的。

2019-07-05 17:25:00 1207

1207 深度學習的概念源于人工神經(jīng)網(wǎng)絡的研究。含多隱層的多層感知器就是一種深度學習結構。深度學習通過組合低層特征形成更加抽象的高層表示屬性類別或特征,以發(fā)現(xiàn)數(shù)據(jù)的分布式特征表示。晦澀難懂的概念,略微有些難以

2018-07-04 16:07:53

多層感知機 深度神經(jīng)網(wǎng)絡in collaboration with Hsu Chung Chuan, Lin Min Htoo, and Quah Jia Yong. 與許忠傳,林敏濤和華佳勇合作

2021-07-12 06:35:22

03_深度學習入門_神經(jīng)網(wǎng)絡和反向傳播算法

2019-09-12 07:08:05

神經(jīng)元 第3章 EBP網(wǎng)絡(反向傳播算法) 3.1 含隱層的前饋網(wǎng)絡的學習規(guī)則 3.2 Sigmoid激發(fā)函數(shù)下的BP算法 3.3 BP網(wǎng)絡的訓練與測試 3.4 BP算法的改進 3.5 多層

2012-03-20 11:32:43

制造業(yè)而言,深度學習神經(jīng)網(wǎng)絡開辟了令人興奮的研究途徑。為了實現(xiàn)從諸如高速公路全程自動駕駛儀的短時輔助模式到專職無人駕駛旅行的自動駕駛,汽車制造業(yè)一直在尋求讓響應速度更快、識別準確度更高的方法,而深度

2017-12-21 17:11:34

基于深度學習的神經(jīng)網(wǎng)絡算法

2019-05-16 17:25:05

最簡單的神經(jīng)網(wǎng)絡

2019-09-11 11:57:36

CV之YOLOv3:深度學習之計算機視覺神經(jīng)網(wǎng)絡Yolov3-5clessses訓練自己的數(shù)據(jù)集全程記錄

2018-12-24 11:51:47

CV之YOLO:深度學習之計算機視覺神經(jīng)網(wǎng)絡tiny-yolo-5clessses訓練自己的數(shù)據(jù)集全程記錄

2018-12-24 11:50:57

遞歸網(wǎng)絡newelm 創(chuàng)建一Elman遞歸網(wǎng)絡2. 網(wǎng)絡應用函數(shù)sim 仿真一個神經(jīng)網(wǎng)絡init 初始化一個神經(jīng)網(wǎng)絡adapt 神經(jīng)網(wǎng)絡的自適應化train 訓練一個神經(jīng)網(wǎng)絡3. 權函數(shù)dotprod

2009-09-22 16:10:08

NMSIS NN 軟件庫是一組高效的神經(jīng)網(wǎng)絡內核,旨在最大限度地提高 Nuclei N 處理器內核上的神經(jīng)網(wǎng)絡的性能并最??大限度地減少其內存占用。

該庫分為多個功能,每個功能涵蓋特定類別

2025-10-29 06:08:21

,高度模塊化,可擴展性)。 ? 同時支持卷積神經(jīng)網(wǎng)絡和循環(huán)神經(jīng)網(wǎng)絡,以及兩者的組合。? 在 CPU 和 GPU 上無縫運行。--摘自《Keras:基于-Python-的深度學習庫》

2018-06-04 22:32:12

最近發(fā)現(xiàn)Qualcomm推出了一款神經(jīng)處理引擎,因為好奇就去了解了一下。 這個比較強勢,它可以不依賴云而是依賴平臺的異構計算能力在設備上就可以直接跑被訓練過的神經(jīng)網(wǎng)絡。這個Neural

2018-09-27 09:58:39

元結構,用計算機構造的簡化了的人腦神經(jīng)網(wǎng)絡模型,其主要用于圖像分類和識別。labview是一個廣泛應用于工業(yè)自動化測控領域的編程平臺,其具有很多不同行業(yè)的算法庫,例如vision視覺庫,集成了常用的視覺

2020-07-23 20:33:10

習神經(jīng)神經(jīng)網(wǎng)絡,對于神經(jīng)網(wǎng)絡的實現(xiàn)是如何一直沒有具體實現(xiàn)一下:現(xiàn)看到一個簡單的神經(jīng)網(wǎng)絡模型用于訓練的輸入數(shù)據(jù):對應的輸出數(shù)據(jù):我們這里設置:1:節(jié)點個數(shù)設置:輸入層、隱層、輸出層的節(jié)點

2021-08-18 07:25:21

`本篇主要介紹:人工神經(jīng)網(wǎng)絡的起源、簡單神經(jīng)網(wǎng)絡模型、更多神經(jīng)網(wǎng)絡模型、機器學習的步驟:訓練與預測、訓練的兩階段:正向推演與反向傳播、以TensorFlow + Excel表達訓練流程以及AI普及化教育之路。`

2020-11-05 17:48:39

項目名稱:基于PYNQ-Z2的神經(jīng)網(wǎng)絡圖形識別試用計劃:申請理由:本人為一名嵌入式軟件工程師,對FPGA有一段時間的接觸,基于FPGA設計過簡單的ASCI數(shù)字芯片。目前正好在學習基于python

2019-01-09 14:48:59

元,它決定了該輸入向量在地位空間中的位置。SOM神經(jīng)網(wǎng)絡訓練的目的就是為每個輸出層神經(jīng)元找到合適的權向量,以達到保持拓撲結構的目的。SOM的訓練過程其實很簡單,就是接收到一個訓練樣本后,每個輸出層神經(jīng)

2019-07-21 04:30:00

這個網(wǎng)絡輸入和相應的輸出來“訓練”這個網(wǎng)絡,網(wǎng)絡根據(jù)輸入和輸出不斷地調節(jié)自己的各節(jié)點之間的權值來滿足輸入和輸出。這樣,當訓練結束后,我們給定一個輸入,網(wǎng)絡便會根據(jù)自己已調節(jié)好的權值計算出一個輸出。這就是神經(jīng)網(wǎng)絡的簡單原理。 神經(jīng)網(wǎng)絡原理下載-免費

2008-06-19 14:40:42

,如何用一個神經(jīng)網(wǎng)絡,寫出一套機器學習算法,來自動識別未知的圖像。一個 4 層的神經(jīng)網(wǎng)絡輸入層經(jīng)過幾層算法得到輸出層 實現(xiàn)機器學習的方法有很多,近年被人們討論得多的方法就是深度學習。 深度學習是一種實現(xiàn)

2018-05-11 11:43:14

準確的模型。有了上述機制,現(xiàn)在可以通過讓神經(jīng)網(wǎng)絡模型學習各種問題來自動解決問題,創(chuàng)建高精度模型,并對新數(shù)據(jù)進行推理。然而,由于單個神經(jīng)網(wǎng)絡只能解決簡單的問題,人們嘗試通過構建深度神經(jīng)網(wǎng)絡 (DNN

2023-02-17 16:56:59

簡單理解LSTM神經(jīng)網(wǎng)絡

2021-01-28 07:16:57

通過堆疊卷積層使得模型更深更寬,同時借助GPU使得訓練再可接受的時間范圍內得到結果,推動了卷積神經(jīng)網(wǎng)絡甚至是深度學習的發(fā)展。下面是AlexNet的架構:AlexNet的特點有:1.借助擁有1500萬標簽

2018-05-08 15:57:47

優(yōu)化神經(jīng)網(wǎng)絡訓練方法有哪些?

2022-09-06 09:52:36

進行訓練。我們還研究了使用合成數(shù)據(jù) 集如何影響網(wǎng)絡性能。

我們建議使用深度循環(huán)去噪神經(jīng)網(wǎng)絡(DRDNN) 對心電圖信號進行去噪。它們是一種深度循環(huán)神經(jīng) 網(wǎng)絡(DRNN),因此具有兩個不同的特征。第

2024-05-15 14:42:46

抑制任務是語音增強領域的一個重要學科, 隨著深度神經(jīng)網(wǎng)絡的興起,提出了幾種基于深度模型的音頻處理新方法[1,2,3,4]。然而,這些通常是為離線處理而開發(fā)的,不需要考慮實時性。當使用神經(jīng)網(wǎng)絡

2024-05-11 17:15:32

【深度學習】卷積神經(jīng)網(wǎng)絡CNN

2020-06-14 18:55:37

《深度學習工程師-吳恩達》03卷積神經(jīng)網(wǎng)絡—深度卷積網(wǎng)絡:實例探究 學習總結

2020-05-22 17:15:57

卷積神經(jīng)網(wǎng)絡模型發(fā)展及應用轉載****地址:http://fcst.ceaj.org/CN/abstract/abstract2521.shtml深度學習是機器學習和人工智能研究的最新趨勢,作為一個

2022-08-02 10:39:39

復雜數(shù)據(jù)中提取特征的強大工具。例如,這包括音頻信號或圖像中的復雜模式識別。本文討論了 CNN 相對于經(jīng)典線性規(guī)劃的優(yōu)勢。后續(xù)文章“訓練卷積神經(jīng)網(wǎng)絡:什么是機器學習?——第2部分”將討論如何訓練CNN

2023-02-23 20:11:10

本帖欲分享在Ubuntu20.04系統(tǒng)中訓練神經(jīng)網(wǎng)絡模型的一些經(jīng)驗。我們采用jupyter notebook作為開發(fā)IDE,以TensorFlow2為訓練框架,目標是訓練一個手寫數(shù)字識別的神經(jīng)網(wǎng)絡

2025-10-22 07:03:26

基于光學芯片的神經(jīng)網(wǎng)絡訓練解析,不看肯定后悔

2021-06-21 06:33:55

FPGA 上實現(xiàn)卷積神經(jīng)網(wǎng)絡 (CNN)。CNN 是一類深度神經(jīng)網(wǎng)絡,在處理大規(guī)模圖像識別任務以及與機器學習類似的其他問題方面已大獲成功。在當前案例中,針對在 FPGA 上實現(xiàn) CNN 做一個可行性研究

2019-06-19 07:24:41

現(xiàn)有的圖數(shù)據(jù)規(guī)模極大,導致時序圖神經(jīng)網(wǎng)絡的訓練需要格外長的時間,因此使用多GPU進行訓練變得成為尤為重要,如何有效地將多GPU用于時序圖神經(jīng)網(wǎng)絡訓練成為一個非常重要的研究議題。本文提供了兩種方式來

2022-09-28 10:37:20

當訓練好的神經(jīng)網(wǎng)絡用于應用的時候,權值是不是不能變了????就是已經(jīng)訓練好的神經(jīng)網(wǎng)絡是不是相當于得到一個公式了,權值不能變了

2016-10-24 21:55:22

來說,提升算法性能的更加可靠的方法仍然是訓練更大的網(wǎng)絡以及獲取更多的數(shù)據(jù)。完成 1 和 2 的過程異常復雜,本書將對其中的細節(jié)作進一步的討論。我們將從傳統(tǒng)學習算法與神經(jīng)網(wǎng)絡中都起作用的通用策略入手,循序漸進地講解至最前沿的構建深度學習系統(tǒng)的策略。``

2018-11-30 16:45:03

嵌入式設備自帶專用屬性,不適合作為隨機性很強的人工智能深度學習訓練平臺。想象用S3C2440訓練神經(jīng)網(wǎng)絡算法都會頭皮發(fā)麻,PC上的I7、GPU上都很吃力,大部分都要依靠服務器來訓練。但是一旦算法訓練

2021-08-17 08:51:57

脈沖神經(jīng)網(wǎng)絡的學習方式有哪幾種?

2021-10-26 06:58:01

解析深度學習:卷積神經(jīng)網(wǎng)絡原理與視覺實踐

2020-06-14 22:21:12

CV之YOLOv3:深度學習之計算機視覺神經(jīng)網(wǎng)絡Yolov3-5clessses訓練自己的數(shù)據(jù)集全程記錄(第二次)——Jason niu

2018-12-24 11:52:25

我在matlab中訓練好了一個神經(jīng)網(wǎng)絡模型,想在labview中調用,請問應該怎么做呢?或者labview有自己的神經(jīng)網(wǎng)絡工具包嗎?

2018-07-05 17:32:32

微軟研究人員在深度神經(jīng)網(wǎng)絡(deep neural network)上取得突破,

使其在性能上能趕上目前最先進的語音識別技術。

2016-08-17 11:54:06 49

49 《神經(jīng)網(wǎng)絡與深度學習》講義

2017-07-20 08:58:24 0

0 神經(jīng)網(wǎng)絡模型的每一類學習過程通常被歸納為一種訓練算法。訓練的算法有很多,它們的特點和性能各不相同。問題的抽象人們把神經(jīng)網(wǎng)絡的學習過程轉化為求損失函數(shù)f的最小值問題。一般來說,損失函數(shù)包括誤差項和正則

2017-11-16 15:30:54 13897

13897 學習率(learning rate)是調整深度神經(jīng)網(wǎng)絡最重要的超參數(shù)之一,本文作者Pavel Surmenok描述了一個簡單而有效的辦法來幫助你找尋合理的學習率。 我正在舊金山大學的 fast.ai

2017-12-07 11:05:42 2667

2667 計基于GPU的加速庫 。cuDNN為深度神經(jīng)網(wǎng)絡中的標準流程提供了高度優(yōu)化的實現(xiàn)方式,例如convolution、pooling、normalization以及activation layers的前向以及后向過程。 cuDNN只是NVIDIA深度神經(jīng)網(wǎng)絡軟件開發(fā)包中的其中一種加速庫。

2017-12-08 10:40:02 2557

2557 針對深度神經(jīng)網(wǎng)絡在分布式多機多GPU上的加速訓練問題,提出一種基于虛擬化的遠程多GPU調用的實現(xiàn)方法。利用遠程GPU調用部署的分布式GPU集群改進傳統(tǒng)一對一的虛擬化技術,同時改變深度神經(jīng)網(wǎng)絡在分布式

2018-03-29 16:45:25 0

0 深度學習和人工智能是 2017 年的熱詞;2018 年,這兩個詞愈發(fā)火熱,但也更加容易混淆。我們將深入深度學習的核心,也就是神經(jīng)網(wǎng)絡。

2018-04-02 09:47:09 10661

10661

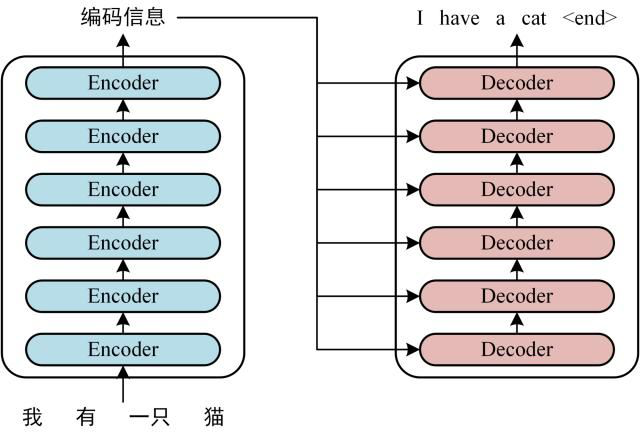

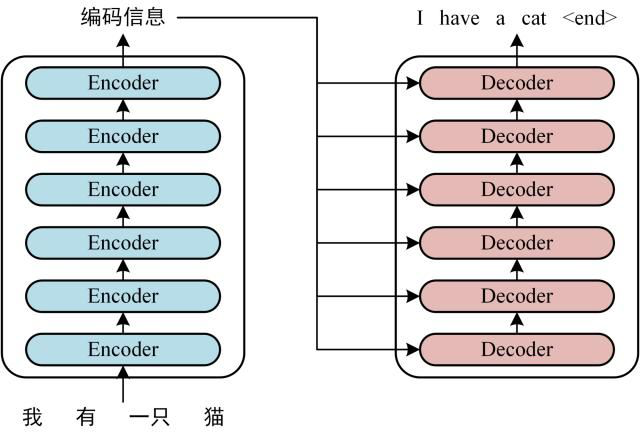

本文檔的詳細介紹的是快速了解神經(jīng)網(wǎng)絡與深度學習的教程資料免費下載主要內容包括了:機器學習概述,線性模型,前饋神經(jīng)網(wǎng)絡,卷積神經(jīng)網(wǎng)絡,循環(huán)神經(jīng)網(wǎng)絡,網(wǎng)絡優(yōu)化與正則化,記憶與注意力機制,無監(jiān)督學習,概率圖模型,玻爾茲曼機,深度信念網(wǎng)絡,深度生成模型,深度強化學習

2019-02-11 08:00:00 33

33 ,以手寫數(shù)字數(shù)據(jù)庫為例,構建了一個深度神經(jīng)網(wǎng)絡,并對比各種訓練算法.實驗表明,NBP學習算法對于深度神經(jīng)網(wǎng)絡具有良好的學習效果,明顯優(yōu)于傳統(tǒng)的反向傳播算法,并且在精度上與深度學習算法相當,但是速度快.

2020-01-07 15:10:00 9

9 深度神經(jīng)網(wǎng)絡與其他很多機器學習模型一樣,可分為訓練和推理兩個階段。訓練階段根據(jù)數(shù)據(jù)學習模型中的參數(shù)(對神經(jīng)網(wǎng)絡來說主要是網(wǎng)絡中的權重);推理階段將新數(shù)據(jù)輸入模型,經(jīng)過計算得出結果。

2020-03-27 15:50:17 3572

3572 1986年Rumelhart等人提出了人工神經(jīng)網(wǎng)絡的反向傳播算法,掀起了神經(jīng)網(wǎng)絡在機器學習中的熱潮,神經(jīng)網(wǎng)絡中存在大量的參數(shù),存在容易發(fā)生過擬合、訓練時間長的缺點,但是對比Boosting

2020-08-24 15:57:52 6804

6804 微軟和谷歌一直在積極研究用于訓練深度神經(jīng)網(wǎng)絡的新框架,并且在最近將各自的成果開源微軟的 PipeDream 和谷歌的 GPipe。 原則上看,他們都遵循了類似的原則來訓練深度學習模型。這兩個項目已在

2020-11-01 10:49:41 2500

2500

梯度計算 Part3:使用PyTorch構建一個神經(jīng)網(wǎng)絡 Part4:訓練一個神經(jīng)網(wǎng)絡分類器 Part5:數(shù)據(jù)并行化 本文是關于Part4的內容。 Part4:訓練一個神經(jīng)網(wǎng)絡分類器 前面已經(jīng)介紹了

2021-02-15 09:47:00 2557

2557 隨著深度學習技術的快速發(fā)展,許多研究者嘗試利用深度學習來解決文本分類問題,特別是在卷積神經(jīng)網(wǎng)絡和循環(huán)神經(jīng)網(wǎng)絡方面,出現(xiàn)了許多新穎且有效的分類方法。對基于深度神經(jīng)網(wǎng)絡的文本分類問題進行分析,介紹

2021-03-10 16:56:56 37

37 3小時學習神經(jīng)網(wǎng)絡與深度學習課件下載

2021-04-19 09:36:55 0

0 隨著深度學習的不斷發(fā)展,卷積神經(jīng)網(wǎng)絡(CNN)在目標檢測與圖像分類中受到研究者的廣泛關注。CNN從 Lenet5網(wǎng)絡發(fā)展到深度殘差網(wǎng)絡,其層數(shù)不斷增加。基于神經(jīng)網(wǎng)絡中“深度”的含義,在確保感受野相同

2021-05-19 16:11:00 5

5 使用脈沖序列進行數(shù)據(jù)處理的脈沖神經(jīng)網(wǎng)絡具有優(yōu)異的低功耗特性,但由于學習算法不成熟,多層網(wǎng)絡練存在收斂困難的問題。利用反向傳播網(wǎng)絡具有學習算法成熟和訓練速度快的特點,設計一種遷移學習算法。基于反向

2021-05-24 16:03:07 15

15 ,LSTM)正是為了解決梯度消失問題而設計的一種特殊的RNN結構。 深度神經(jīng)網(wǎng)絡的困擾:梯度爆炸與梯度消失 在此前的普通深度神經(jīng)網(wǎng)絡和深度卷積網(wǎng)絡的講解時,圖1就是一個簡單的兩層普通網(wǎng)絡,但當網(wǎng)絡結構變深時,神經(jīng)網(wǎng)絡在訓練時碰到梯度爆炸或者梯度消失的

2021-08-23 09:12:58 5424

5424

深度學習是推動當前人工智能大趨勢的關鍵技術。在 MATLAB 中可以實現(xiàn)深度學習的數(shù)據(jù)準備、網(wǎng)絡設計、訓練和部署全流程開發(fā)和應用。聯(lián)合高性能 NVIDIA GPU 加快深度神經(jīng)網(wǎng)絡訓練和推斷。

2022-02-18 13:31:44 2702

2702 深度學習是機器學習的一個子集,它使用神經(jīng)網(wǎng)絡來執(zhí)行學習和預測。深度學習在各種任務中都表現(xiàn)出了驚人的表現(xiàn),無論是文本、時間序列還是計算機視覺。

2022-04-07 10:17:05 2221

2221 神經(jīng)網(wǎng)絡(CNN)、長短期記憶(LSTM)和自動編碼器)徹底改變了。曾有學者將本次人工智能浪潮的興起歸因于三個條件,分別是: ·?計算資源的快速發(fā)展(如GPU) ·?大量訓練數(shù)據(jù)的可用性 ·?深度學習從歐氏空間數(shù)據(jù)中提取潛在特征

2022-09-22 10:16:34 2834

2834

在介紹卷積神經(jīng)網(wǎng)絡之前,我們先回顧一下神經(jīng)網(wǎng)絡的基本知識。就目前而言,神經(jīng)網(wǎng)絡是深度學習算法的核心,我們所熟知的很多深度學習算法的背后其實都是神經(jīng)網(wǎng)絡。

2023-02-23 09:14:44 4833

4833 來源:青榴實驗室1、引子深度神經(jīng)網(wǎng)絡(DNNs)最近在圖像分類或語音識別等復雜機器學習任務中表現(xiàn)出的優(yōu)異性能令人印象深刻。在本文中,我們將了解深度神經(jīng)網(wǎng)絡的基礎知識和三個最流行神經(jīng)網(wǎng)絡:多層神經(jīng)網(wǎng)絡

2023-05-17 09:59:19 4321

4321

卷積神經(jīng)網(wǎng)絡模型訓練步驟? 卷積神經(jīng)網(wǎng)絡(Convolutional Neural Network, CNN)是一種常用的深度學習算法,廣泛應用于圖像識別、語音識別、自然語言處理等諸多領域。CNN

2023-08-21 16:42:00 2660

2660 卷積神經(jīng)網(wǎng)絡如何識別圖像? 卷積神經(jīng)網(wǎng)絡(Convolutional Neural Network, CNN)由于其出色的圖像識別能力而成為深度學習的重要組成部分。CNN是一種深度神經(jīng)網(wǎng)絡,其結構為

2023-08-21 16:49:27 2655

2655 深度神經(jīng)網(wǎng)絡是一種基于神經(jīng)網(wǎng)絡的機器學習算法,其主要特點是由多層神經(jīng)元構成,可以根據(jù)數(shù)據(jù)自動調整神經(jīng)元之間的權重,從而實現(xiàn)對大規(guī)模數(shù)據(jù)進行預測和分類。卷積神經(jīng)網(wǎng)絡是深度神經(jīng)網(wǎng)絡的一種,主要應用于圖像和視頻處理領域。

2023-08-21 17:07:36 5026

5026 深度神經(jīng)網(wǎng)絡是深度學習的一種框架,它是一種具備至少一個隱層的神經(jīng)網(wǎng)絡。與淺層神經(jīng)網(wǎng)絡類似

2023-10-11 09:14:33 1896

1896

。訓練神經(jīng)網(wǎng)絡的挑戰(zhàn)在訓練數(shù)據(jù)集的新示例之間取得平衡。七個具體的技巧,可幫助您更快地訓練出更好的神經(jīng)網(wǎng)絡模型。學習和泛化使用反向傳播設計和訓練網(wǎng)絡需要做出許多看似任

2023-12-30 08:27:54 1071

1071

神經(jīng)網(wǎng)絡是人工智能領域的重要分支,廣泛應用于圖像識別、自然語言處理、語音識別等多個領域。然而,要使神經(jīng)網(wǎng)絡在實際應用中取得良好效果,必須進行有效的訓練和優(yōu)化。本文將從神經(jīng)網(wǎng)絡的訓練過程、常用優(yōu)化算法、超參數(shù)調整以及防止過擬合等方面,詳細闡述如何訓練和優(yōu)化神經(jīng)網(wǎng)絡。

2024-07-01 14:14:06 1459

1459 、Sigmoid或Tanh。 卷積神經(jīng)網(wǎng)絡(Convolutional Neural Networks,CNN): 卷積神經(jīng)網(wǎng)絡是深度學習中最重

2024-07-02 10:00:01 3226

3226 隨著人工智能技術的飛速發(fā)展,深度學習和卷積神經(jīng)網(wǎng)絡(Convolutional Neural Network, CNN)作為其中的重要分支,已經(jīng)在多個領域取得了顯著的應用成果。從圖像識別、語音識別

2024-07-02 18:19:17 1852

1852 、訓練過程以及應用場景。 1. 卷積神經(jīng)網(wǎng)絡的基本概念 1.1 卷積神經(jīng)網(wǎng)絡的定義 卷積神經(jīng)網(wǎng)絡是一種前饋深度學習模型,其核心思想是利用卷積操作提取輸入數(shù)據(jù)的局部特征,并通過多層結構進行特征的逐層抽象和組合,最終實現(xiàn)對輸入數(shù)據(jù)的分類或回歸。 1.2 卷積神經(jīng)網(wǎng)絡的特

2024-07-03 09:15:28 1337

1337 BP神經(jīng)網(wǎng)絡(Backpropagation Neural Network)是一種常見的前饋神經(jīng)網(wǎng)絡,它使用反向傳播算法來訓練網(wǎng)絡。雖然BP神經(jīng)網(wǎng)絡在某些方面與深度神經(jīng)網(wǎng)絡(Deep Neural

2024-07-03 10:14:30 1801

1801 在探討深度神經(jīng)網(wǎng)絡(Deep Neural Networks, DNNs)與基本神經(jīng)網(wǎng)絡(通常指傳統(tǒng)神經(jīng)網(wǎng)絡或前向神經(jīng)網(wǎng)絡)的區(qū)別時,我們需要從多個維度進行深入分析。這些維度包括網(wǎng)絡結構、訓練機制、特征學習能力、應用領域以及計算資源需求等方面。以下是對兩者區(qū)別的詳細闡述。

2024-07-04 13:20:36 2554

2554 人工神經(jīng)網(wǎng)絡(Artificial Neural Networks,簡稱ANNs)是一種受生物神經(jīng)網(wǎng)絡啟發(fā)而構建的數(shù)學模型,用于模擬人腦處理信息的方式。它在機器學習和深度學習領域具有廣泛的應用,包括

2024-07-05 09:16:18 1848

1848 ,使得神經(jīng)網(wǎng)絡的創(chuàng)建、訓練和仿真變得更加便捷。本文將詳細介紹如何利用Matlab進行神經(jīng)網(wǎng)絡訓練,包括網(wǎng)絡創(chuàng)建、數(shù)據(jù)預處理、訓練過程、參數(shù)調整以及仿真預測等步驟。

2024-07-08 18:26:20 4699

4699 神經(jīng)網(wǎng)絡作為深度學習的重要組成部分,其訓練方式多樣,其中無監(jiān)督學習是一種重要的訓練策略。無監(jiān)督學習旨在從未標記的數(shù)據(jù)中發(fā)現(xiàn)數(shù)據(jù)內在的結構、模式或規(guī)律,從而提取有用的特征表示。這種訓練方式對于大規(guī)模未

2024-07-09 18:06:59 2098

2098 PyTorch,作為一個廣泛使用的開源深度學習庫,提供了豐富的工具和模塊,幫助開發(fā)者構建、訓練和部署神經(jīng)網(wǎng)絡模型。在神經(jīng)網(wǎng)絡模型中,輸出層是尤為關鍵的部分,它負責將模型的預測結果以合適的形式輸出。以下將詳細解析PyTorch中神經(jīng)網(wǎng)絡輸出層的特性及整個模型的構建過程。

2024-07-10 14:57:33 1362

1362 (Backpropagation Algorithm,簡稱BP算法)來不斷調整網(wǎng)絡的權重和閾值,以最小化網(wǎng)絡輸出與目標值之間的誤差。本文將從BP神經(jīng)網(wǎng)絡的基本原理、學習機制、訓練過程以及應用等方面進行詳細闡述。

2024-07-10 15:49:29 1916

1916 深度神經(jīng)網(wǎng)絡(Deep Neural Networks, DNNs)作為機器學習領域中的一種重要技術,特別是在深度學習領域,已經(jīng)取得了顯著的成就。它們通過模擬人類大腦的處理方式,利用多層神經(jīng)元結構

2024-07-10 18:23:31 2814

2814 當然,PyTorch是一個廣泛使用的深度學習框架,它提供了許多預訓練的神經(jīng)網(wǎng)絡模型。 PyTorch中的神經(jīng)網(wǎng)絡模型 1. 引言 深度學習是一種基于人工神經(jīng)網(wǎng)絡的機器學習技術,它在圖像識別、自然語言

2024-07-11 09:59:53 2576

2576 重新訓練神經(jīng)網(wǎng)絡是一個復雜的過程,涉及到多個步驟和考慮因素。 引言 神經(jīng)網(wǎng)絡是一種強大的機器學習模型,廣泛應用于圖像識別、自然語言處理、語音識別等領域。然而,隨著時間的推移,數(shù)據(jù)分布可能會

2024-07-11 10:25:02 1273

1273 殘差網(wǎng)絡(Residual Network,通常簡稱為ResNet) 是深度神經(jīng)網(wǎng)絡的一種 ,其獨特的結構設計在解決深層網(wǎng)絡訓練中的梯度消失和梯度爆炸問題上取得了顯著的突破,并因此成為圖像處理、語音識別等多個領域的重要模型。以下是對殘差網(wǎng)絡作為深度神經(jīng)網(wǎng)絡的詳細闡述。

2024-07-11 18:13:43 2112

2112 脈沖神經(jīng)網(wǎng)絡(SNN, Spiking Neural Network)的訓練是一個復雜但充滿挑戰(zhàn)的過程,它模擬了生物神經(jīng)元通過脈沖(或稱為尖峰)進行信息傳遞的方式。以下是對脈沖神經(jīng)網(wǎng)絡訓練過程的詳細闡述。

2024-07-12 10:13:51 1731

1731 人工神經(jīng)網(wǎng)絡(ANN)是機器學習中一種重要的模型,它模仿了人腦神經(jīng)元的工作方式,通過多層節(jié)點(神經(jīng)元)之間的連接和權重調整來學習和解決問題。Python由于其強大的庫支持(如TensorFlow、PyTorch等),成為了實現(xiàn)和訓練ANN的首選語言。

2024-07-19 11:54:14 990

990 深度學習中,神經(jīng)網(wǎng)絡是核心模型。今天我們用 Python 和 NumPy 構建一個簡單的神經(jīng)網(wǎng)絡。 神經(jīng)網(wǎng)絡由多個神經(jīng)元組成,神經(jīng)元之間通過權重連接。我們構建一個包含輸入層、隱藏層和輸出層的簡單

2025-01-23 13:52:15 915

915 ),是一種多層前饋神經(jīng)網(wǎng)絡,它通過反向傳播算法進行訓練。BP神經(jīng)網(wǎng)絡由輸入層、一個或多個隱藏層和輸出層組成,通過逐層遞減的方式調整網(wǎng)絡權重,目的是最小化網(wǎng)絡的輸出誤差。 二、深度學習的定義與發(fā)展 深度學習是機器學習的一個子集,指的是那些包含多個處理層的復雜網(wǎng)絡模

2025-02-12 15:15:21 1519

1519 優(yōu)化BP神經(jīng)網(wǎng)絡的學習率是提高模型訓練效率和性能的關鍵步驟。以下是一些優(yōu)化BP神經(jīng)網(wǎng)絡學習率的方法: 一、理解學習率的重要性 學習率決定了模型參數(shù)在每次迭代時更新的幅度。過大的學習率可能導致模型在

2025-02-12 15:51:37 1536

1536

電子發(fā)燒友App

電子發(fā)燒友App

評論