2018,仍是AI領(lǐng)域激動人心的一年。

這一年成為NLP研究的分水嶺,各種突破接連不斷;CV領(lǐng)域同樣精彩紛呈,與四年前相比GAN生成的假臉逼真到讓人不敢相信;新工具、新框架的出現(xiàn),也讓這個領(lǐng)域的明天特別讓人期待……

近日,Analytics Vidhya發(fā)布了一份2018人工智能技術(shù)總結(jié)與2019趨勢預測報告,原文作者PRANAV DAR。量子位在保留這個報告架構(gòu)的基礎(chǔ)上,對內(nèi)容進行了重新編輯和補充。

這份報告總結(jié)和梳理了全年主要AI技術(shù)領(lǐng)域的重大進展,同時也給出了相關(guān)的資源地址,以便大家更好的使用、查詢。

報告共涉及了五個主要部分:

自然語言處理(NLP)

工具和庫

強化學習

AI道德

下面,我們就逐一來盤點和展望,嘿喂狗~

自然語言處理(NLP)

2018年在NLP歷史上的特殊地位,已經(jīng)毋庸置疑。

這份報告認為,這一年正是NLP的分水嶺。2018年里,NLP領(lǐng)域的突破接連不斷:ULMFiT、ELMo、最近大熱的BERT……

遷移學習成了NLP進展的重要推動力。從一個預訓練模型開始,不斷去適應新的數(shù)據(jù),帶來了無盡的潛力,甚至有“NLP領(lǐng)域的ImageNet時代已經(jīng)到來”一說。

■ ULMFiT

這個縮寫,代表“通用語言模型的微調(diào)”,出自ACL 2018論文:Universal Language Model Fine-tuning for Text Classification。

正是這篇論文,打響了今年NLP遷移學習狂歡的第一槍。

論文兩名作者一是Fast.ai創(chuàng)始人Jeremy Howard,在遷移學習上經(jīng)驗豐富;一是自然語言處理方向的博士生Sebastian Ruder,他的NLP博客幾乎所有同行都在讀。

兩個人的專長綜合起來,就有了ULMFiT。想要搞定一項NLP任務,不再需要從0開始訓練模型,拿來ULMFiT,用少量數(shù)據(jù)微調(diào)一下,它就可以在新任務上實現(xiàn)更好的性能。

他們的方法,在六項文本分類任務上超越了之前最先進的模型。

詳細的說明可以讀他們的論文:

https://arxiv.org/abs/1801.06146

Fast.ai網(wǎng)站上放出了訓練腳本、模型等:

http://nlp.fast.ai/category/classification.html

■ ELMo

這個名字,當然不是指《芝麻街》里那個角色,而是“語言模型的詞嵌入”,出自艾倫人工智能研究院和華盛頓大學的論文Deep contextualized word representations,NLP頂會NAACL HLT 2018的優(yōu)秀論文之一。

ELMo用語言模型(language model)來獲取詞嵌入,同時也把詞語所處句、段的語境考慮進來。

這種語境化的詞語表示,能夠體現(xiàn)一個詞在語法語義用法上的復雜特征,也能體現(xiàn)它在不同語境下如何變化。

當然,ELMo也在試驗中展示出了強大功效。把ELMo用到已有的NLP模型上,能夠帶來各種任務上的性能提升。比如在機器問答數(shù)據(jù)集SQuAD上,用ELMo能讓此前最厲害的模型成績在提高4.7個百分點。

這里有ELMo的更多介紹和資源:

https://allennlp.org/elmo

■ BERT

說BERT是2018年最火的NLP模型,一點也不為過,它甚至被稱為NLP新時代的開端。

它由Google推出,全稱是BidirectionalEncoderRepresentations fromTransformers,意思是來自Transformer的雙向編碼器表示,也是一種預訓練語言表示的方法。

從性能上來看,沒有哪個模型能與BERT一戰(zhàn)。它在11項NLP任務上都取得了最頂尖成績,到現(xiàn)在,SQuAD 2.0前10名只有一個不是BERT變體:

如果你還沒有讀過BERT的論文,真的應該在2018年結(jié)束前補完這一課:

https://arxiv.org/abs/1810.04805

另外,Google官方開源了訓練代碼和預訓練模型:

https://github.com/google-research/bert

如果你是PyTorch黨,也不怕。這里還有官方推薦的PyTorch重實現(xiàn)和轉(zhuǎn)換腳本:

https://github.com/huggingface/pytorch-pretrained-BERT

■ PyText

BERT之后,NLP圈在2018年還能收獲什么驚喜?答案是,一款新工具。

就在上周末,F(xiàn)acebook開源了自家工程師們一直在用的NLP建模框架PyText。這個框架,每天要為Facebook旗下各種應用處理超過10億次NLP任務,是一個工業(yè)級的工具包。

(Facebook開源新NLP框架:簡化部署流程,大規(guī)模應用也OK)

PyText基于PyTorch,能夠加速從研究到應用的進度,從模型的研究到完整實施只需要幾天時間。框架里還包含了一些預訓練模型,可以直接拿來處理文本分類、序列標注等任務。

想試試?開源地址在此:

https://github.com/facebookresearch/pytext

■Duplex

如果前面這些研究對你來說都太抽象的話,Duplex則是NLP進展的最生動例證。

名字有點陌生?不過這個產(chǎn)品你一定聽說過,它就是Google在2018年I/O開發(fā)者大會上展示的“打電話AI”。

它能主動打電話給美發(fā)店、餐館預約服務,全程流暢交流,簡直以假亂真。Google董事長John Hennessy后來稱之為“非凡的突破”,還說:“在預約領(lǐng)域,這個AI已經(jīng)通過了圖靈測試。”

Duplex在多輪對話中表現(xiàn)出的理解能力、合成語音的自然程度,都是NLP目前水平的體現(xiàn)。

■2019年展望

NLP在2019年會怎么樣?我們借用一下ULMFiT作者Sebastian Ruder的展望:

預訓練語言模型嵌入將無處不在:不用預訓練模型,從頭開始訓練達到頂尖水平的模型,將十分罕見。

能編碼專業(yè)信息的預訓練表示將會出現(xiàn),這是語言模型嵌入的一種補充。到時候,我們就能根據(jù)任務需要,把不同類型的預訓練表示結(jié)合起來。

在多語言應用、跨語言模型上,將有更多研究。特別是在跨語言詞嵌入的基礎(chǔ)上,深度預訓練跨語言表示將會出現(xiàn)。

計算機視覺

今年,無論是圖像還是視頻方向都有大量新研究問世,有三大研究曾在CV圈掀起了集體波瀾。

■ BigGAN

今年9月,當搭載BigGAN的雙盲評審中的ICLR 2019論文現(xiàn)身,行家們就沸騰了:簡直看不出這是GAN自己生成的。

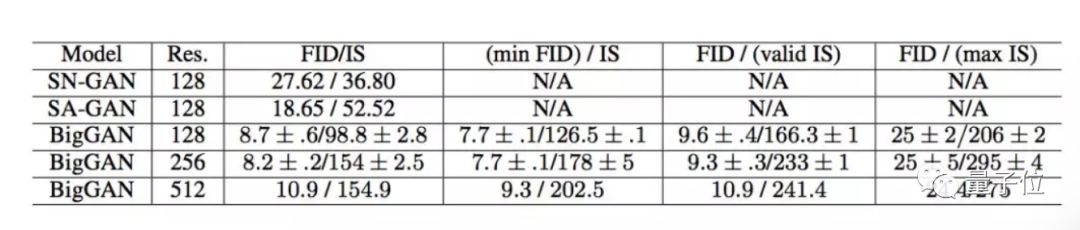

在計算機圖像研究史上,BigGAN的效果比前人進步了一大截。比如在ImageNet上進行128×128分辨率的訓練后,它的Inception Score(IS)得分166.3,是之前最佳得分52.52分3倍。

除了搞定128×128小圖之外,BigGAN還能直接在256×256、512×512的ImageNet數(shù)據(jù)上訓練,生成更讓人信服的樣本。

在論文中研究人員揭秘,BigGAN的驚人效果背后,真的付出了金錢的代價,最多要用512個TPU訓練,費用可達11萬美元,合人民幣76萬元。

不止是模型參數(shù)多,訓練規(guī)模也是有GAN以來最大的。它的參數(shù)是前人的2-4倍,批次大小是前人的8倍。

■ Fast.ai 18分鐘訓練整個ImageNet

在完整的ImageNet上訓練一個模型需要多久?各大公司不斷下血本刷新著記錄。

不過,也有不那么燒計算資源的平民版。

今年8月,在線深度學習課程Fast.ai的創(chuàng)始人Jeremy Howard和自己的學生,用租來的亞馬遜AWS的云計算資源,18分鐘在ImageNet上將圖像分類模型訓練到了93%的準確率。

前前后后,F(xiàn)ast.ai團隊只用了16個AWS云實例,每個實例搭載8塊英偉達V100 GPU,結(jié)果比Google用TPU Pod在斯坦福DAWNBench測試上達到的速度還要快40%。

這樣拔群的成績,成本價只需要40美元,F(xiàn)ast.ai在博客中將其稱作人人可實現(xiàn)。

相關(guān)地址:

Fast.ai博客介紹:https://www.fast.ai/2018/08/10/fastai-diu-imagenet/

■vid2vid技術(shù)

今年8月,英偉達和MIT的研究團隊高出一個超逼真高清視頻生成AI。

只要一幅動態(tài)的語義地圖,就可獲得和真實世界幾乎一模一樣的視頻。換句話說,只要把你心中的場景勾勒出來,無需實拍,電影級的視頻就可以自動P出來:

除了街景,人臉也可生成:

這背后的vid2vid技術(shù),是一種在生成對抗性學習框架下的新方法:精心設計的生成器和鑒別器架構(gòu),再加上時空對抗目標。

這種方法可以在分割蒙版、素描草圖、人體姿勢等多種輸入格式上,實現(xiàn)高分辨率、逼真、時間相干的視頻效果。

好消息,vid2vid現(xiàn)已被英偉達開源。

相關(guān)地址

研究論文:https://tcwang0509.github.io/vid2vid/paper_vid2vid.pdf

GitHub地址https://github.com/NVIDIA/vid2vid

■2019趨勢展望

Analytics Vidhya預計,明年在計算機視覺領(lǐng)域,對現(xiàn)有方法的改進和增強的研究可能多于創(chuàng)造新方法。

在美國,政府對無人機的限令可能會稍微“松綁”,開放程度可能增加。而今年大火的自監(jiān)督學習明年可能會應用到更多研究中。

Analytics Vidhya對視覺領(lǐng)域也有一些期待,目前來看,在CVPR和ICML等國際頂會上公布最新研究成果,在工業(yè)界的應用情況還不樂觀。他希望在2019年,能看到更多的研究在實際場景中落地。

Analytics Vidhya預計,視覺問答(Visual Question Answering,VQA)技術(shù)和視覺對話系統(tǒng)可能會在各種實際應用中首次亮相。

工具和框架

哪種工具最好?哪個框架代表了未來?這都是一個個能永遠爭論下去的話題。

沒有異議的是,不管爭辯的結(jié)果是什么,我們都需要掌握和了解最新的工具,否則就有可能被行業(yè)所拋棄。

今年,機器學習領(lǐng)域的工具和框架仍在快速的發(fā)展,下面就是這方面的總結(jié)和展望。

■ PyTorch 1.0

根據(jù)10月GitHub發(fā)布的2018年度報告,PyTorch在增長最快的開源項目排行上,名列第二。也是唯一入圍的深度學習框架。

作為谷歌TensorFlow最大的“勁敵”,PyTorch其實是一個新兵,2017年1月19日才正式發(fā)布。2018年5月,PyTorch和Caffe2整合,成為新一代PyTorch 1.0,競爭力更進一步。

相較而言,PyTorch速度快而且非常靈活,在GitHub上有越來越多的開碼都采用了PyTorch框架。可以預見,明年P(guān)yTorch會更加普及。

至于PyTorch和TensorFlow怎么選擇?在我們之前發(fā)過的一篇報道里,不少大佬站PyTorch。

實際上,兩個框架越來越像。前Google Brain深度學習研究員,Denny Britz認為,大多數(shù)情況下,選擇哪一個深度學習框架,其實影響沒那么大。

相關(guān)地址

PyTorch官網(wǎng):https://pytorch.org/

■ AutoML

很多人將AutoML稱為深度學習的新方式,認為它改變了整個系統(tǒng)。有了AutoML,我們就不再需要設計復雜的深度學習網(wǎng)絡。

今年1月17日,谷歌推出Cloud AutoML服務,把自家的AutoML技術(shù)通過云平臺對外發(fā)布,即便你不懂機器學習,也能訓練出一個定制化的機器學習模型。

不過AutoML并不是谷歌的專利。過去幾年,很多公司都在涉足這個領(lǐng)域,比方國外有RapidMiner、KNIME、DataRobot和H2O.ai等等。

除了這些公司的產(chǎn)品,還有一個開源庫要介紹給大家:

Auto Keras!

這是一個用于執(zhí)行AutoML任務的開源庫,意在讓更多人即便沒有人工智能的專家背景,也能搞定機器學習這件事。

這個庫的作者是美國德州農(nóng)工大學(Texas A&M University)助理教授胡俠和他的兩名博士生:金海峰、Qingquan Song。Auto Keras直擊谷歌AutoML的三大缺陷:

第一,還得付錢。

第二,因為在云上,還得配置Docker容器和Kubernetes。

第三,服務商(Google)保證不了你數(shù)據(jù)安全和隱私。

相關(guān)地址

官網(wǎng):https://autokeras.com/

GitHub:https://github.com/jhfjhfj1/autokeras

■ TensorFlow.js

今年3月底的TensorFlow開發(fā)者會峰會2018上,TensorFlow.js正式發(fā)布。

這是一個面向JavaScript開發(fā)者的機器學習框架,可以完全在瀏覽器中定義和訓練模型,也能導入離線訓練的TensorFlow和Keras模型進行預測,還對WebGL實現(xiàn)無縫支持。

在瀏覽器中使用TensorFlow.js可以擴展更多的應用場景,包括展開交互式的機器學習、所有數(shù)據(jù)都保存在客戶端的情況等。

實際上,這個新發(fā)布的TensorFlow.js,就是基于之前的deeplearn.js,只不過被整合進TensorFlow之中。

谷歌還給了幾個TensorFlow.js的應用案例。比如借用你的攝像頭,來玩經(jīng)典游戲:吃豆人(Pac-Man)。

相關(guān)地址

官網(wǎng):https://js.tensorflow.org/

■2019趨勢展望

在工具這個主題中,最受關(guān)注的就是AutoML。因為這是一個真正會改變游戲規(guī)則的核心技術(shù)。在此,引用H2O.ai的大神Marios Michailidis(KazAnova)對明年AutoML領(lǐng)域的展望。

以智能可視化、提供洞見等方式,幫助描述和理解數(shù)據(jù)

為數(shù)據(jù)集發(fā)現(xiàn)、構(gòu)建、提取更好的特征

快速構(gòu)建更強大、更智能的預測模型

通過機器學習可解釋性,彌補黑盒建模帶來的差距

推動這些模型的產(chǎn)生

強化學習

強化學習還有很長的路要走。

除了偶爾成為頭條新聞之外,目前強化學習領(lǐng)域還缺乏真正的突破。強化學習的研究非常依賴數(shù)學,而且還沒有形成真正的行業(yè)應用。

希望明年可以看到更多RL的實際用例。現(xiàn)在我每個月都會特別關(guān)注一下強化學習的進展,以期看到未來可能會有什么大事發(fā)生。

■ OpenAI的強化學習入門教程

全無機器學習基礎(chǔ)的人類,現(xiàn)在也可以迅速上手強化學習。

11月初,OpenAI發(fā)布了強化學習 (RL) 入門教程:Spinning Up。從一套重要概念,到一系列關(guān)鍵算法實現(xiàn)代碼,再到熱身練習,每一步都以清晰簡明為上,全程站在初學者視角。

團隊表示,目前還沒有一套比較通用的強化學習教材,RL領(lǐng)域只有一小撮人進得去。這樣的狀態(tài)要改變啊,因為強化學習真的很有用。

相關(guān)地址

教程入口:https://spinningup.openai.com/en/latest/index.html

GitHub傳送門:https://github.com/openai/spinningup

■ 谷歌的強化學習新框架「多巴胺」

Dopamine(多巴胺),這是谷歌今年8月發(fā)布的強化學習開源框架,基于TensorFlow。

新框架在設計時就秉承著清晰簡潔的理念,所以代碼相對緊湊,大約是15個Python文件,基于Arcade Learning Environment (ALE)基準,整合了DQN、C51、 Rainbow agent精簡版和ICML 2018上的Implicit Quantile Networks。

為了讓研究人員能快速比較自己的想法和已有的方法,該框架提供了DQN、C51、 Rainbow agent精簡版和Implicit Quantile Networks的玩ALE基準下的那60個雅達利游戲的完整訓練數(shù)據(jù)。

另外,還有一組Dopamine的教學colab。

相關(guān)地址

Dopamine谷歌博客:https://ai.googleblog.com/2018/08/introducing-new-framework-for-flexible.html

Dopamine github下載:https://github.com/google/dopamine/tree/master/docs#downloads

colabs:https://github.com/google/dopamine/blob/master/dopamine/colab/README.md

游戲訓練可視化網(wǎng)頁:https://google.github.io/dopamine/baselines/plots.html

■2019趨勢展望

DataHack Summit 2018發(fā)言人、ArxivInsights創(chuàng)始人Xander Steenbrugge,也是一名強化學習專家,以下是來自他的總結(jié)和展望。

1、由于輔助學習任務越來越多,增加了稀疏的外在獎勵,樣本的復雜性將繼續(xù)提高。在非常稀疏的獎勵環(huán)境中,效果非常好。

2、正因如此,直接在物理世界訓練將越來越可行,替代當前大多先在虛擬環(huán)境中訓練的方法。我預測2019年,會出現(xiàn)第一個只由深度學習訓練,沒有人工參與而且表現(xiàn)出色的機器人demo出現(xiàn)。

3、在DeepMind把AlphaGo的故事延續(xù)到生物領(lǐng)域之后(AlphaFold),我相信強化學習將逐步在學術(shù)領(lǐng)域外創(chuàng)造實際的商業(yè)價值。例如新藥探索、電子芯片架構(gòu)優(yōu)化、車輛等等……

4、強化學習會有一個明顯的轉(zhuǎn)變,以前在訓練數(shù)據(jù)上測試智能體的行為將不再視為“允許”。泛化指標將成為核心,就像監(jiān)督學習一樣。

AI道德

AI被濫用事故在2018年被頻頻爆出:Facebook AI助特朗普當選美國總統(tǒng)、Goggle與美國軍方聯(lián)手開發(fā)AI武器、微軟為移民和海關(guān)執(zhí)法局(ICE)提供云計算和人臉識別服務……

每一次事故都會重新掀起一波對AI道德準則的討論高潮,一些硅谷科技公司也再次期間制定了企業(yè)AI準則。

Analytics Vidhya認為,AI道德現(xiàn)在還是一個灰色地帶,目前還沒有所有人可以遵循的框架,2019年將有更多企業(yè)和政府制定相關(guān)條例。

AI道德規(guī)范的制定,現(xiàn)在才剛剛起步。

-

ai技術(shù)

+關(guān)注

關(guān)注

1文章

1313瀏覽量

25754 -

自然語言處理

+關(guān)注

關(guān)注

1文章

630瀏覽量

14673

原文標題:一文看盡2018全年AI技術(shù)大突破

文章出處:【微信號:AI_Career,微信公眾號:人工智能見聞】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

CANopen協(xié)議核心秘籍:NMT、SDO、PDO、心跳報文一網(wǎng)打盡

【「芯片設計基石——EDA產(chǎn)業(yè)全景與未來展望」閱讀體驗】跟著本書來看EDA的奧秘和EDA發(fā)展

【「芯片設計基石——EDA產(chǎn)業(yè)全景與未來展望」閱讀體驗】+ 全書概覽

惠山經(jīng)開區(qū)舉辦“機器人未來技術(shù)展望”專題講座 丁漢院士解析前沿趨勢

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+內(nèi)容總覽

AI工藝優(yōu)化與協(xié)同應用的未來發(fā)展趨勢是什么?

鋁電解電容的行業(yè)發(fā)展現(xiàn)狀與未來趨勢展望

AI的未來,屬于那些既能寫代碼,又能焊電路的“雙棲人才”

【書籍評測活動NO.64】AI芯片,從過去走向未來:《AI芯片:科技探索與AGI愿景》

人工智能技術(shù)的現(xiàn)狀與未來發(fā)展趨勢

一文讀懂超聲波換能器:原理、應用與未來趨勢

4G DTU未來發(fā)展趨勢與展望

淺談虛擬電廠技術(shù)現(xiàn)狀及展望

工業(yè)電機行業(yè)現(xiàn)狀及未來發(fā)展趨勢分析

恩智浦智能家電創(chuàng)新方案一文看盡 恩智浦智能家電技術(shù)日給你答案

一文看盡2018看盡AI現(xiàn)狀,展望未來趨勢

一文看盡2018看盡AI現(xiàn)狀,展望未來趨勢

評論