電子發(fā)燒友網(wǎng)綜合報道 近期,半導(dǎo)體研究機(jī)構(gòu)SemiAnalysis發(fā)布的“H100一年期租賃合約價格指數(shù)”顯示,英偉達(dá)四年前發(fā)布的H100芯片租賃費用近半年飆升近40%。這款“老芯片”租賃合約價格從2025年10月的每小時1.7美元,在今年3月漲至每小時每塊GPU 2.35美元。

H100租賃費用飆升的背后

SemiAnalysis的指數(shù)基于對100多家云服務(wù)提供商、算力資源買家和賣家的直接調(diào)查數(shù)據(jù)構(gòu)建,每月采集一次。最新報告指出,按需租用的GPU算力在所有類型中均已售罄,即便價格上漲,已鎖定按需實例的客戶也不愿釋放算力。該機(jī)構(gòu)比喻,2026年初尋找GPU算力,如同預(yù)訂“最后一班離開航班”的機(jī)票,價格高昂且資源稀缺。

研究人員補(bǔ)充,客戶正爭相以每塊GPU每小時14美元的價格搶購亞馬遜云服務(wù)的p6 - b200競價實例,一些新興云服務(wù)巨頭甚至不再提供單節(jié)點銷售。部分英偉達(dá)H100 GPU仍按2 - 3年前簽訂的原價續(xù)約,有些合同直接續(xù)簽到2028年。

至于架構(gòu)更先進(jìn)的Blackwell芯片,由于對開放權(quán)重模型的強(qiáng)勁需求以及推理需求持續(xù)激增,新部署B(yǎng)lackwell的交付周期延長至6到7個月。2025年晚些時候,市場曾預(yù)期隨著性能更強(qiáng)、算力成本更低的Blackwell芯片加速部署,Hopper芯片(H100、H200)租賃價格會大幅下降,但實際情況相反,H100需求不僅堅挺,許多情況下還在增強(qiáng)。

H100芯片推理需求高漲的原因

首先是應(yīng)用場景驅(qū)動,過去幾年,AI行業(yè)的主旋律是“大模型訓(xùn)練”,各大科技公司競相投入,比拼誰能訓(xùn)練出參數(shù)更多、能力更強(qiáng)的模型。然而,進(jìn)入2026年,行業(yè)重心正以前所未有的速度從模型訓(xùn)練大規(guī)模轉(zhuǎn)向?qū)嶋H應(yīng)用和部署,這一轉(zhuǎn)變直接引爆了推理需求的“核聚變”。

AI原生應(yīng)用的普及讓推理需求無處不在。以字節(jié)跳動的“即夢”(Seedance)、谷歌的“Nano Banana”為代表的AI視頻和圖像生成工具,正迅速成為普通用戶內(nèi)容創(chuàng)作的新寵。用戶不再滿足于簡單的濾鏡和模板,而是希望通過自然語言描述,實時生成高質(zhì)量的個性化視頻和圖像。每一次點擊“生成”按鈕,背后都是一次復(fù)雜的AI模型推理過程,需要消耗海量算力來理解用戶意圖、生成內(nèi)容并進(jìn)行優(yōu)化。這些應(yīng)用的病毒式傳播,使得推理請求量呈指數(shù)級增長。

多智能體(Multi - agent)工作負(fù)載的興起,成為算力消耗增長最快的領(lǐng)域。與傳統(tǒng)的單次問答不同,多智能體系統(tǒng)(如近期火熱的“龍蝦”模型)模擬了多個AI智能體協(xié)同工作的復(fù)雜場景。例如,一個智能體負(fù)責(zé)理解用戶指令,另一個負(fù)責(zé)規(guī)劃任務(wù),還有一個負(fù)責(zé)調(diào)用工具執(zhí)行,最后再由一個智能體整合結(jié)果并反饋給用戶。這種“團(tuán)隊協(xié)作”模式功能更強(qiáng)大,但也導(dǎo)致詞元(token)的消耗量呈拋物線式增長,對推理算力的要求遠(yuǎn)超單一模型。

此外,爆款大模型應(yīng)用的持續(xù)火爆,帶來了穩(wěn)定且高頻的推理需求。Anthropic的Claude系列、Kimi、GLM等熱門大模型,已經(jīng)深度融入了程序員、研究人員、內(nèi)容創(chuàng)作者等群體的實際工作流中。每天都有海量的日常推理請求涌入,這種需求是持續(xù)性的,而非像模型訓(xùn)練那樣是一次性的投入。

其次是H100有它的技術(shù)優(yōu)勢,應(yīng)用場景的爆發(fā)是需求側(cè)的“拉力”,而H100芯片自身在推理方面的顛覆性技術(shù)優(yōu)勢,則是供給側(cè)的“推力”,使其成為處理海量請求的理想選擇。

H100內(nèi)置的專用Transformer引擎,是其架構(gòu)的核心創(chuàng)新,堪稱“為推理而生”。大語言模型的計算瓶頸主要集中在注意力機(jī)制上,而Transformer引擎能夠智能地優(yōu)化這部分計算。它通過硬件級的動態(tài)稀疏計算,自動識別并跳過權(quán)重矩陣中大量的無效運算(即接近零值的計算),從而將千億參數(shù)模型的推理延遲從秒級壓縮到毫秒級,極大地提升了處理效率。

同時,H100是首批支持FP8(8位浮點)精度的芯片之一,這是其提速降本的關(guān)鍵。與傳統(tǒng)的FP16精度相比,F(xiàn)P8格式在幾乎不損失模型精度的前提下,能將數(shù)據(jù)帶寬需求降低一半,顯著提升推理速度并降低能耗。這意味著在相同的硬件成本和功耗預(yù)算下,企業(yè)可以部署更少的H100芯片來處理更多的用戶請求,實現(xiàn)經(jīng)濟(jì)效益的最大化。

最后,H100的動態(tài)批處理技術(shù),像一位高明的“交通指揮官”,最大化了GPU的吞吐量。面對高并發(fā)、大小不一的實時請求,該技術(shù)能夠智能地將多個請求合并成一個批次進(jìn)行處理,將GPU算力資源的利用率提升至92%以上。這就像高效的拼車系統(tǒng),在保證每個乘客(請求)都能快速到達(dá)目的地(低延遲)的同時,讓車輛(GPU)始終保持滿載運行,避免了算力資源的浪費。

未來GPU租賃價格走勢觀察

展望未來,研究人員給出三個關(guān)鍵觀察點判斷GPU租賃價格是否維持高位。首先,隨著GB300集群在2026年逐步放量,市場關(guān)注新增供給能否緩解算力緊張局面。GB300是英偉達(dá)推出的新一代人工智能計算平臺,于2025年5月19日由首席執(zhí)行官黃仁勛宣布,計劃2025年第三季度量產(chǎn),2026年第二季度大規(guī)模交付。相比前代,GB300在算力、內(nèi)存和散熱能效方面有改進(jìn),算力為前代36倍,搭載288GB HBM3e內(nèi)存,單GPU容量從192GB增至288GB,可支持參數(shù)規(guī)模達(dá)1.2萬億的AI模型運行,采用全液冷散熱方案,可將數(shù)據(jù)中心能耗降低30%以上。

其次,需關(guān)注芯片短缺是否進(jìn)一步惡化。最后,要觀察各大AI巨頭的年度經(jīng)常性收入擴(kuò)張情況,以及AI應(yīng)用的普及速度和詞元消耗規(guī)模的持續(xù)增長節(jié)奏。

總之,當(dāng)前GPU市場在需求、供應(yīng)、價格等方面都處于動態(tài)變化中,未來走向充滿不確定性,各方都在密切關(guān)注市場動態(tài),以應(yīng)對可能出現(xiàn)的各種情況。

-

英偉達(dá)

+關(guān)注

關(guān)注

23文章

4112瀏覽量

99563

發(fā)布評論請先 登錄

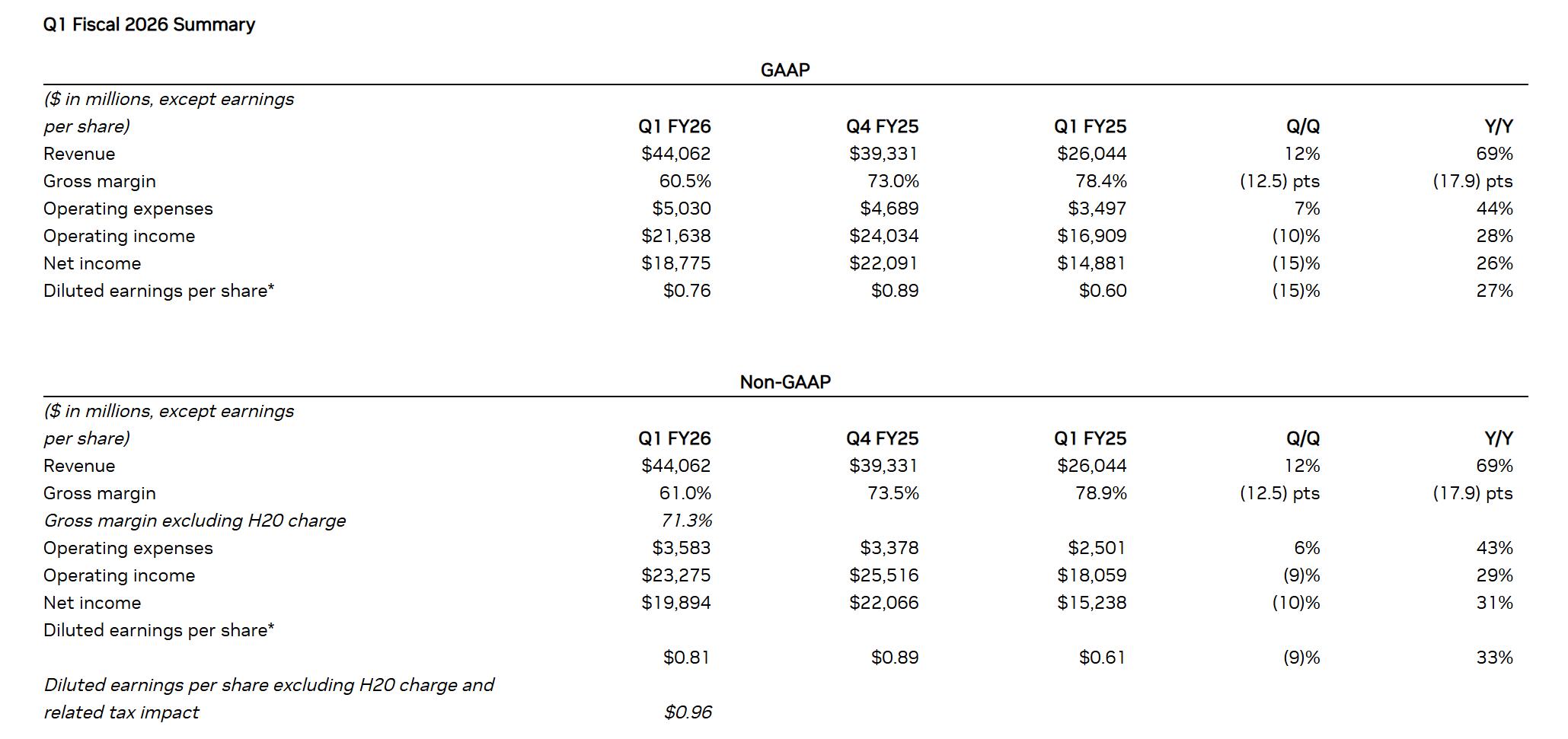

AI推理需求井噴!英偉達(dá)Q1營收大漲,H20禁售難擋增長步伐

從英偉達(dá)電話會看Agentic AI推理與FPGA價值

美對華芯片出口“松綁”:英偉達(dá)H200獲準(zhǔn)進(jìn)入中國市場#AI芯片#英偉達(dá)#H200芯片

羅姆強(qiáng)勢入局AI服務(wù)器800VDC電源方案 原創(chuàng)

羅姆強(qiáng)勢入局AI服務(wù)器800VDC電源方案

英偉達(dá) Q3 狂攬 308 億

黃仁勛:英偉達(dá)AI芯片訂單排到2026年 英偉達(dá)上季營收加速增長62%再超預(yù)期

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+AI芯片的需求和挑戰(zhàn)

英偉達(dá) H100 GPU 掉卡?做好這五點,讓算力穩(wěn)如泰山!

搞定英偉達(dá) H100 ECC 報錯:從原理到維修,一步到位解煩憂

H20中國區(qū)賣爆!英偉達(dá)緊急向臺積電加訂30萬塊

施耐德電氣與英偉達(dá)深化合作

今日看點丨英偉達(dá)將為中國市場推出新AI芯片 售價大幅低于H20;中科曙光與海光信息宣布戰(zhàn)略重組

GPU 維修干貨 | 英偉達(dá) GPU H100 常見故障有哪些?

AI爆款應(yīng)用驅(qū)動需求增長,英偉達(dá)H100租賃費用飆升40%

AI爆款應(yīng)用驅(qū)動需求增長,英偉達(dá)H100租賃費用飆升40%

評論