作者:Oyindamola Omotuyi

構建強大的智能機器人需要在復雜環境中進行測試。然而,在現實世界中收集數據不僅成本高昂、耗時漫長,還常常伴隨高風險。針對關鍵危險場景(例如高速碰撞或硬件故障)進行安全訓練幾乎是不可能的。更嚴重的是,現實世界的數據往往偏向“正常”運行條件,導致機器人在面對突發狀況時缺乏應對能力。

模擬對于彌合這一差距至關重要,可為嚴格的開發提供無風險的環境。然而,傳統流水線難以滿足現代機器人的復雜需求。當今的多面手機器人必須掌握多模態學習,融合視覺、觸覺和本體感知等多種輸入,才能在混亂且非結構化的環境中有效導航。這對仿真技術提出了新的要求:必須在緊湊的訓練循環中實現規模性、真實感以及多模態感知能力,而這些正是受 CPU 限制的傳統模擬器難以高效應對的挑戰。

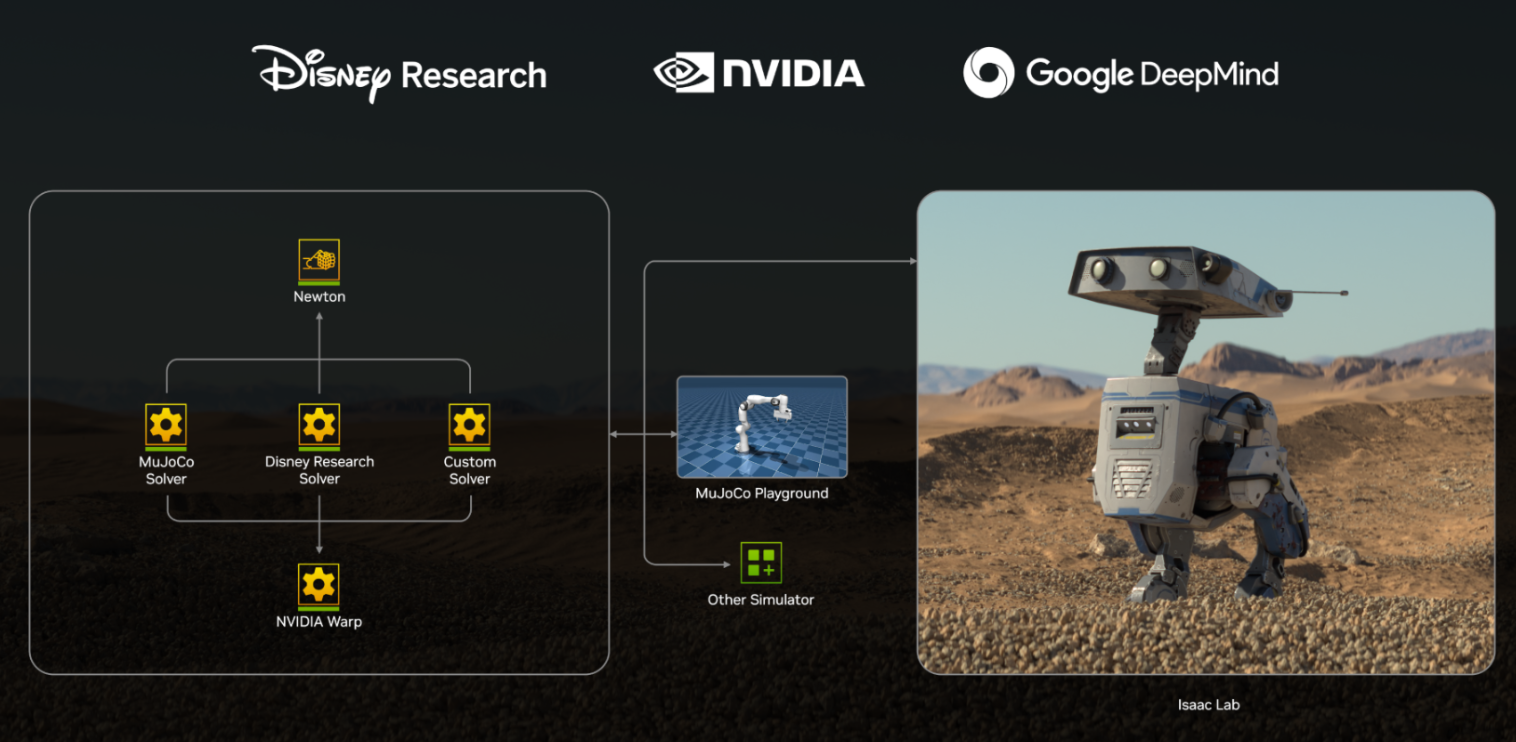

本期NVIDIA 機器人研發摘要 (R2D2)介紹了NVIDIA Isaac Lab,一個來自NVIDIA Research的開源 GPU 原生仿真框架,如何將這些功能整合到一個專為大規模多模態機器人學習設計的統一堆棧中。

機器人學習的主要挑戰

仿真中的現代機器人學習將仿真基礎設施推向極限。為高效訓練出穩健的策略,研究人員必須克服以下關鍵障礙:

將模擬擴展到數千個并行環境,以解決 CPU 受限工具訓練耗時過長的問題

集成多種傳感器模式(視覺、力覺和本體感知),形成同步的高保真數據流

建模真實執行器與控制頻率,以捕捉物理硬件的細微特性

通過可靠的域隨機化與精確的物理屬性,縮小仿真與現實世界部署之間的差距

Isaac Lab:一個用于機器人學習的統一開源框架

Isaac Lab 是一個用于多模態機器人學習的GPU 加速仿真框架。作為一個統一的 GPU 原生平臺,它致力于應對現代機器人學習中的各項挑戰。通過將物理仿真、渲染、感知與學習整合至單一架構中,該平臺為研究人員提供了訓練具備大規模與高保真度的通用智能體的技術支持。

圖 1. Isaac Lab 仿真框架支持多種機器人應用

Isaac Lab 核心元件

Isaac Lab 的關鍵元素包括:

GPU 原生架構:通過端到端 GPU 加速支持物理特性和渲染,實現大規模并行計算,顯著縮短訓練時間

模塊化和可組合設計:提供適用于多種應用場景(如人形機器人、機械手)的靈活組件與可復用環境,加快開發進程

多模態仿真:結合分塊 RTX 渲染與基于 Warp 的傳感器模擬,生成豐富的同步觀測數據(視覺、深度、觸覺),并支持逼真的多頻率控制回路

集成工作流:原生支持強化學習(RL)與模仿學習(IL),簡化大規模數據收集、域隨機化及策略評估流程;無縫對接主流 RL 庫(包括 SKRL、RSL-RL、RL-Games、SB3 和 Ray),并可與NVIDIA Cosmos生成的數據高效集成,提升模仿學習效果

Isaac Lab 框架內部:模塊化工具包

Isaac Lab 將機器人學習分解為可組合的基礎模塊,幫助您構建復雜且可擴展的任務,而無需重復造輪子。

圖 2. Isaac Lab 包含多種材質、多模態傳感器和標準控制器

功能包括基于管理器的工作流、程序化場景生成等。

基于管理器的工作流程

Isaac Lab 將您的環境分解為獨立的“管理器”,分別用于觀察、操作、獎勵和事件,而非編寫融合物理與邏輯的單一腳本。這種設計使代碼更具模塊化和可重用性。例如,您可以更換機器人的獎勵功能,而無需修改其傳感器配置。

|

@configclass class MyRewardsCfg: # Define rewards as weighted terms track_lin_vel = RewTerm(func=mdp.track_lin_vel_xy_exp, weight=1.0, params={"std": 0.5}) penalty_lin_vel_z = RewTerm(func=mdp.lin_vel_z_l2, weight=-2.0) @configclass class MyEnvCfg(ManagerBasedRLEnvCfg): # Plug in the reward config cleanly rewards: MyRewardsCfg = MyRewardsCfg() # ... other managers for actions, observations, etc. |

程序化場景生成

為防止過擬合,通常不建議在單一靜態場景上進行訓練。借助 Isaac Lab 場景生成工具,您可以通過程序化定義規則來生成多樣化的環境。無論是為導航任務隨機散布障礙物,還是為運動生成粗糙地形,只需定義一次邏輯,框架便能在 GPU 上高效生成數千種環境變體。

|

# Configure a terrain generator with diverse sub-terrains terrain_cfg = TerrainGeneratorCfg( sub_terrains={ "pyramid_stairs": MeshPyramidStairsTerrainCfg( proportion=0.2, step_height_range=(0.05, 0.2) ), "rough_ground": MeshRandomGridTerrainCfg( proportion=0.8, noise_scale=0.1 ), } ) |

更多功能

此外,Isaac Lab 還提供:

統一的資產 API,支持從 USD、URDF 或 MJCF 導入任意機器人

逼真的執行器模型,用于電機動力學仿真,并提供包括 IMU 到真實感 RTX 攝像頭在內的十余種傳感器類型

內置遠程操作堆棧,進一步簡化數據采集流程

這些功能共同提供了從原型到部署高效策略所需的完整支持。

大規模提供 GPU 加速性能

Isaac Lab 可提供現代機器人學習所需的巨大吞吐量,在人形機器人運動(Unitree H1)中實現 135000 FPS,在操作任務(Franka Cabinet)中實現超過 150000 FPS——訓練策略可在數分鐘內完成,而非數天。其統一的 GPU 架構消除了 CPU 瓶頸,即使在 4096 個環境中啟用復雜的 RGB-D 傳感器,仍能保持高吞吐量。

基準測試證實了使用 VRAM 可實現線性擴展,并成功實現了零樣本遷移,適用于多種具身形態,包括靈巧手、多智能體蜂群以及 H1 人形機器人在戶外的穩健行走。

標準機器人學習工作流程

Isaac Lab 將機器人學習循環標準化為一個清晰的、以 Python 優先的工作流。無論您是在訓練運動策略還是操作技能,該流程均遵循相同的四個步驟:設計、隨機化、訓練和驗證。

要運行一個完整的示例(訓練人形機器人行走),請按以下步驟操作。

第 1 步:設計和配置

首先,在 Python 中定義您的環境。通過配置類來選擇機器人(例如 Unitree H1)、傳感器以及隨機化邏輯:

|

# pseudo-code representation of a config @configclass class H1FlatEnvCfg(ManagerBasedRLEnvCfg): scene = InteractiveSceneCfg(num_envs=4096, env_spacing=2.5) robot = ArticulationCfg(prim_path="{ENV_REGEX_NS}/Robot", spawn=...) # Randomization and rewards are defined here |

有關更多詳細信息,請參閱 isaac-sim/IsaacLab GitHub 倉庫中的H1 人形機器人環境配置。此外,您還可以添加其他傳感器。傳感器的配置過程十分簡便。

配置平鋪攝像頭:

|

from isaaclab.sensors import TiledCameraCfg # Define a camera attached to the robot's head tiled_camera: TiledCameraCfg = TiledCameraCfg( prim_path="{ENV_REGEX_NS}/Robot/head/camera", offset=TiledCameraCfg.OffsetCfg( pos=(-7.0, 0.0, 3.0), rot=(0.9945, 0.0, 0.1045, 0.0), convention="world"), data_types=["rgb"], spawn=sim_utils.PinholeCameraCfg( focal_length=24.0, focus_distance=400.0, horizontal_aperture=20.955, clipping_range=(0.1, 20.0) ), width=80, height=80, ) |

配置光線投射器 (LiDAR) :

|

from isaaclab.sensors import RayCasterCfg, patterns # Define a 2D LiDAR scanner lidar = RayCasterCfg( prim_path="{ENV_REGEX_NS}/Robot/base_link/lidar", update_period=0.1, # Run at 10Hz offset=RayCasterCfg.OffsetCfg(pos=(0.0, 0.0, 0.2)), attach_yaw_only=True, # Stabilize against robot tilt pattern_cfg=patterns.LidarPatternCfg( channels=32, vertical_fov_range=(-15.0, 15.0), horizontal_fov_range=(-180.0, 180.0) ) ) |

第 2 步:訓練策略

接下來,啟動訓練腳本以開始學習。Isaac Lab 采用 Gymnasium 接口,因此能夠便捷地與 RSL-RL 或 SKRL 等強化學習庫進行連接。

|

# Train a policy for the Unitree H1 humanoid # This runs 4096 environments in parallel on your GPU python source/standalone/workflows/rsl_rl/train.py --task=Isaac-Velocity-Flat-H1-v0 |

第 3 步:播放并可視化

訓練完成后,請在推理模式下運行策略以驗證其效果。該過程將加載已訓練好的檢查點并渲染結果。

|

# Run the trained policy and visualize the robot walking python source/standalone/workflows/rsl_rl/play.py --task=Isaac-Velocity-Flat-H1-v0 |

第 4 步:從仿真到現實的部署

驗證后,可將策略導出為 ONNX 或 TorchScript 格式,以便在物理硬件上部署時利用訓練過程中應用的域隨機化。如需查看實際示例,請參閱仿真到現實部署指南。

采用生態系統

人形機器人、具身 AI 和腿部運動領域的領先機構與研究實驗室正在部署 Isaac Lab,以加速通用機器人策略及基礎模型的開發,涵蓋以下方面:

Agility Robotics的通用人形機器人 Digit 采用 Isaac Lab 框架,通過數百萬個強化學習場景優化全身控制,加速技能組合的提升,例如在制造和物流設施等高度動態環境中,實現從外部干擾中快速恢復步伐的能力。

Skild AI正在開發一個適用于有腿、輪式及人形機器人的通用機器人基礎模型,利用 Isaac Lab 訓練運動與靈巧操作任務,并借助NVIDIA Cosmos 世界基礎模型生成訓練所需的數據集。

FieldAI正在訓練跨形態的具身機器人智能體,用于建筑、制造以及石油和天然氣等環境中的監測與巡檢任務,采用 Isaac Lab 進行強化學習訓練,同時使用NVIDIA Isaac Sim生成合成數據并完成軟件在環驗證。

機器人與 AI 研究機構正基于 NVIDIA Isaac Lab 訓練高性能的強化學習控制器,以實現敏捷的腿部運動、動態的全身操作能力,并適配多種自定義機器人平臺;在將策略部署至波士頓動力的 Spot 和 Atlas 以及 RAI 的 Ultra Mobile Vehicle (UMV) 之前,通過優化模擬器參數,有效縮小仿真與現實之間的差距。

加州大學河濱分校(UCR)正在 NVIDIA Isaac 平臺上研發適用于重工業的堅固型人形機器人,利用 Isaac GR00T 的合成數據流水線 Isaac Lab 與 Isaac Sim,訓練端到端的移動策略,并持續迭代以縮小仿真與現實的差異,確保 Moby 能在嚴苛的建筑與工業場景中穩定可靠地運行。

開始使用多模態機器人學習

準備好使用 Isaac Lab 擴展您自己的多模態機器人學習工作負載了嗎?從核心資源入手,進階到高級工作流程的前沿研究。

使用 Isaac Lab快速入門指南安裝并運行您的首個環境。

探索Isaac Lab GitHub 存儲庫,了解示例、環境和問題。

按照Isaac Lab 學習路徑開始學習。

查閱Isaac Lab 文檔,掌握相關概念和 API 參考。

使用快速入門指南并設置 Isaac Sim 作為底層模擬器。

詳細了解研究人員如何運用模擬與生成式 AI 推動機器人學習的發展:

Harmon:結合語言模型與物理特性,直接從文本生成富有表現力的全身人形機器人動作。

MaskedMimic:一種通用控制策略,通過運動模仿學習多種技能,簡化人形機器人控制,無需依賴復雜的獎勵設計。

SIMPLER:用于評估仿真中真實操作策略(如 RT-1、Octo)的框架,可可靠預測其在真實環境中的物理表現。

NVIDIA GTC AI 大會將于 2026 年 3 月 16 日至 19 日在圣何塞舉行,首席執行官黃仁勛將于太平洋時間 3 月 16 日上午 11 點在SAP 中心發表備受矚目的主題演講。歡迎探索GTC 機器人會議,深入了解 AI、仿真和加速計算如何賦能機器人實現高效感知、學習與實時決策。

本文是NVIDIA 機器人研發摘要 (R2D2)系列文章的一部分,該系列旨在幫助開發者深入理解NVIDIA Research在物理 AI與機器人應用領域的前沿突破。

關于作者

Oyindamola Omotuyi 是 NVIDIA 的產品營銷經理實習生,專注于機器人開發社區。在之前的 NVIDIA 實習期間,她撰寫了 NVIDIA 對話 AI 電子書的介紹。 Oyindamola Omotuyi 擁有尼日利亞拉各斯大學系統工程學士學位和辛辛那提大學機械工程碩士學位。她目前正在辛辛那提大學攻讀博士學位,專注于多智能體深度強化學習和機器人感知。

-

機器人

+關注

關注

213文章

31200瀏覽量

222971 -

NVIDIA

+關注

關注

14文章

5661瀏覽量

109940 -

gpu

+關注

關注

28文章

5223瀏覽量

135782

原文標題:R2D2:基于 NVIDIA Isaac Lab 拓展多模態機器人學習

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

NVIDIA Isaac Lab可用環境與強化學習腳本使用指南

基于NVIDIA Isaac Lab拓展多模態機器人學習

基于NVIDIA Isaac Lab拓展多模態機器人學習

評論