每天,數億用戶與大語言模型(LLM)對話時,一場悄無聲息的能源消耗正在全球數據中心上演。行業數據顯示,OpenAI運營ChatGPT的日成本高達70萬美元,其中電費是主要支出。放眼全球,所有大語言模型的年耗電量已攀升至24.97-41.1 TWh,相當于三峽工程年發電量的40%,其碳排放量最高可達1861萬噸。

這張沉重的能源賬單背后,是一個深層次的產業悖論:我們想要AI更“聰明”,它反而變得越“笨重”:反應慢、費用高、特費電。

天價電費賬單

從何而來?

巨額的能源消耗源于大模型運行的兩個核心階段:訓練與推理。

訓練:即讓AI“博覽群書”。 這是一個一次性但極其耗能的過程。而訓練一個萬億參數的頂級模型,單次能耗更為驚人——例如,訓練GPT-4約需95天,總能耗高達38.2吉瓦時(GWh),相當于日均消耗40萬度電,這約等于4萬戶家庭一天的用電總量。國際能源署(IEA)預測,到2030年,全球數據中心的耗電量將比2024年翻倍以上,達到驚人的945 TWh。

推理:即AI“學以致用”,處理用戶實時請求。這是持續性的“能耗無底洞”。每一次看似簡單的問答,需調動千億級參數進行實時計算。一次典型的AI推理請求能耗約在0.3至3瓦時之間。國際能源署的數據顯示,一次ChatGPT請求的耗電量(2.9瓦時)約為一次谷歌搜索(0.3瓦時)的10倍。當日均請求量達到數十億次時,其累積的電力需求極為龐大。

AI算力競賽的下半場,儼然成了一場對電網承受力的極限測試。

效率困境 :

“精度”與“能效”為何不可兼得?

當前AI算力陷入一個根本性矛盾:為確保模型輸出的質量和可靠性(高精度),必須使用FP16/BF16等高精度格式計算,但這如同用顯微鏡觀測整片沙漠,緩慢且耗能。若為追求速度與節能而采用INT4等低精度格式,又會導致模型精度嚴重受損,出現“大模型幻覺”。

其根源在于主流計算硬件(如:GPU)的“一刀切”的計算模式:硬件無法智能地區分關鍵數據與冗余信息,對所有數據施加相同強度的處理,造成了巨大的算力與電力浪費。

學術研究精準指出了這一瓶頸。研究論文《SQ-format: A Unified Sparse-Quantized Hardware-friendly Data Format for Large Language Models》指出,盡管現代GPU具備低精度計算單元,但缺乏對“混合精度”操作的原生支持。這意味著,即便算法層知道哪些計算可以簡化,硬件執行時仍不得不調用高精度計算路徑來模擬,導致絕大部分潛在的能效收益被抵消。硬件與算法間的這道“鴻溝”,鎖死了能效提升的天花板。

破局之鑰 :

智能稀疏化,讓計算學會 “ 精打細算 ”

破局的關鍵在于讓計算本身變得“智能”且有“選擇性”。以“稀疏計算”(Sparsity)和“稀疏量化格式”(SQ-format)為代表的等創新的AI計算和先進的數據格式,正引領這場變革。其核心思想是,模仿人腦的運作機制,不再對所有數據一視同仁,而是創建了一個智能調度系統:

動態識別:在計算瞬間,實時分析并識別出對結果影響微乎其微的冗余計算(占比常超50%)。

區別處理:對冗余部分進行大幅簡化或極低精度處理;同時將高精度計算資源集中供給至關重要的核心數據。

統一格式:通過如SQ-format這樣的硬件友好型數據格式,將這種混合精度的計算模式高效地映射到硬件上執行,從而真正打破“一刀切”的瓶頸。

這是一種從算法到硬件協同設計的根本性范式重構。它使大模型能在更少或更具成本效益的硬件上高效運行,其“訓后量化(PTQ)”特性也允許對預訓練模型直接優化,避免了昂貴的重新訓練所帶來的額外能耗。

效益驗證 :

從能效突破到可量化的商業價值

這種“區別對待”帶來了效率質變。研究表明,通過硬件友好的稀疏化方案,可以在幾乎不損失精度的前提下,實現計算量的大幅削減。以LIama-3-70B大模型為例,SQ-format實現了1.71x的加速比,達到理論W4A4加速的89%,同時保持了更高的模型性能。理論上,先進的稀疏計算技術可將大模型推理的計算量減少70%以上,從而成比例降低能耗與硬件需求。

這一技術突破直接轉化為可量化的商業價值與總擁有成本(TCO)的優化。以一個日均處理1億次請求的大型AI服務為例進行理論推演:

更重要的是,這種優化提升了“推理電效”——即每消耗一度電能完成的AI任務量,這正成為評估AI模型競爭力的新關鍵指標。企業運營成本得以降低,同時也為AI技術的大規模、可持續普及掃清了關鍵障礙。

未來之戰 :

千萬億級模型時代,稀疏計算技術或從“可選項”成為“必選項”

近期,月之暗面最新發布的Kimi 2.5和深度求索即將發布的DeepSeek V4模型,預示著一個新常態來臨:模型的參數量級正在從千億、萬億,邁向千萬億(百萬億)級別。模型尺寸爆炸式增長,使得此前討論的能效比問題,從一個“優化項”演變為關乎商業模式存亡的“生死線”。

在千萬億參數時代,純粹依靠擴大GPU集群規模,所帶來的電力與資本支出將呈指數級攀升,形成難以承受的成本黑洞。據行業分析,頂尖AI公司年算力投入已達數十億美元量級,這種“瘋狂砸錢”的模式既不節能,也不經濟,已無法支撐大模型技術向更深、更廣的行業應用持續發展。千萬億級大模型若仍沿用傳統稠密計算范式,難以實現能效價值的可持續性。

作為通用性更強、適用范圍更廣、儲存格式更靈活的廣義稀疏計算,可為這類大模型有效提升能效比提供新范式:

指數級放大的能效收益:模型規模越大,數據中可利用的稀疏性潛力就越大。廣義稀疏計算開啟“智能計算”模式,針對高精度計算進行“精工細作”(即:高精度稀疏),確保計算結果誤差極小;對于低精度計算采用“批量快銷”(即:低比特量化),快速且低能耗。這使實際計算量增長遠低于參數量的線性增長,從而在千萬億級大模型上實現能效節省的指數級放大。

提供極致能效比:軟硬件協同,通過硬件原生支持動態稀疏與混合精度計算,能夠將每一瓦特電力都轉化為有效的智能計算(OPS/W),數倍甚至數十倍地提升現有算力集群在運行超大規模模型時的能效比,破解“電費抵營收”的困局。

定義可持續的商業模型:唯有將單位智能的能耗與成本降至商業可承受范圍內,超大規模模型的訓練與普惠式推理服務才成為可能。廣義稀疏計算不再是一種優化選項,而是支撐AI未來十年發展的必備基礎設施。

從 “ 暴力堆砌 ” 到“ 智慧節能 ”的算力革命

綜上所述,AI算力正站在從“暴力堆砌”向“智慧節能”演進的關鍵十字路口。以“稀疏計算”和“稀疏量化格式”(SQ-format)為代表的稀疏化技術,不僅僅是算法優化,更是一場旨在打通軟硬件隔閡、重構計算范式的深度革命。它致力于將AI芯片從“一視同仁的苦力”,進化為“懂得取舍的智者”。

未來,決定AI競爭力的將不僅是模型有多“大”,更在于模型有多“綠”——單位能源消耗所能產生的智能,將成為衡量技術先進性的核心標尺。在這場掙脫“能耗黑洞”的戰役中,每一次讓計算變得更精簡、更智能的突破,都是在為邁向一個更強大、更可持續的智能未來鋪路。

-

能源

+關注

關注

3文章

2383瀏覽量

46078 -

模型

+關注

關注

1文章

3778瀏覽量

52195 -

算力

+關注

關注

2文章

1584瀏覽量

16811

原文標題:精疲力盡的巨人:當大語言模型變得“又慢又貴”,AI算力如何破局提效?

文章出處:【微信號:墨芯人工智能,微信公眾號:墨芯人工智能】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

邊緣AI算力臨界點:深度解析176TOPS香橙派AI Station的產業價值

Hailo-8算力卡 + RK3588實測!26TOPS加持,助力AI視覺升級!

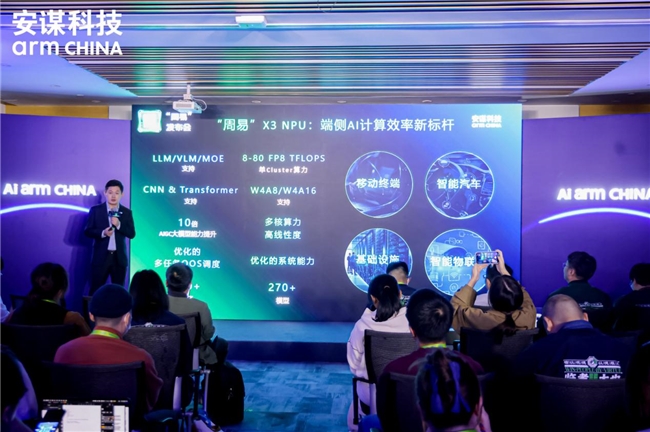

應對端側AI算力、內存、功耗“三堵墻”困境,安謀科技Arm China “周易”X3給出技術錦囊

安謀發布“周易”X3 NPU,破局AI算力,智繪未來藍圖

先進稀疏計算技術助力AI大模型算力破局提效

先進稀疏計算技術助力AI大模型算力破局提效

評論