電子發(fā)燒友網(wǎng)報(bào)道(文/李彎彎)全球算力基建敘事生變,正從GPU時(shí)代邁向連接為王的通信時(shí)代。算力Scaling-law邊際效益放緩,芯片間連接通信成系統(tǒng)算力釋放的核心瓶頸,光互聯(lián)逐漸替代銅連接,成為構(gòu)建高性能AI網(wǎng)絡(luò)的關(guān)鍵。

近期阿里、騰訊均推出NPO(近封裝光學(xué))重大成果,其中阿里云全光Scale-up網(wǎng)絡(luò)架構(gòu)UPN512通過(guò)光互連直接連接xPU與交換機(jī),采用單層CLOS拓?fù)鋵?shí)現(xiàn)512顆xPU的全互聯(lián),該方案徹底消除機(jī)柜內(nèi)高速銅纜,顯著降低布線(xiàn)復(fù)雜度、散熱負(fù)擔(dān)、供電需求及運(yùn)維成本,功耗降低50%,成本下降30%。

近封裝光學(xué)NPO技術(shù)優(yōu)勢(shì)

首先我們來(lái)看看什么是NPO及其優(yōu)勢(shì)。中國(guó)移動(dòng)云能力中心此前發(fā)布過(guò)一份《云智算光互連發(fā)展報(bào)告》,該報(bào)告介紹,NPO的核心思想是,將光引擎非常靠近電芯片放置,但并不像CPO那樣與電芯片共封裝在同一基板或中介層上。它通常將光引擎安裝在同一基板上,通過(guò)極短的高性能電氣鏈路與電芯片相連,形成一個(gè)高度集成的系統(tǒng),如下圖所示。

NPO將光引擎與電芯片物理分離,避免了電芯片的高溫?zé)崃恐苯記_擊光器件,散熱設(shè)計(jì)更簡(jiǎn)單、高效。由于電芯片本身是巨大的熱源,工作時(shí)溫度很高,而激光器等光器件對(duì)溫度極其敏感,所以,光引擎與電芯片共封裝會(huì)導(dǎo)致波長(zhǎng)漂移和性能下降。同時(shí),由于光引擎未與電芯片共封裝,NPO在可維護(hù)性層面具有優(yōu)勢(shì),如果光引擎失效,只需更換光引擎子模塊即可,避免了大量的維護(hù)成本。

相比激進(jìn)的CPO技術(shù),NPO技術(shù)是一種更務(wù)實(shí)、風(fēng)險(xiǎn)更低的路徑。并且,NPO與傳統(tǒng)光模塊相比,其性能遠(yuǎn)超傳統(tǒng)光模塊,其主要優(yōu)勢(shì)包括以下幾點(diǎn):

lNPO的光引擎擁有更大的可布置面積和更靈活的走線(xiàn)方案,可以方便地使用LGA封裝,且有利于光引擎散熱;

lNPO不影響電芯片原有設(shè)計(jì),只對(duì)PCB或基板做差異設(shè)計(jì)即可滿(mǎn) 足不同需求;

lNPO與電芯片解耦,能夠避免形成電芯片壟斷問(wèn)題;

lNPO可單獨(dú)測(cè)試 TP1 的電信號(hào)質(zhì)量,可歸一化設(shè)備的驅(qū)動(dòng)與固件,可測(cè)試性更好。

產(chǎn)業(yè)界正在形成共識(shí),未來(lái)光互聯(lián)由Scale-up、Scale-out、Scale-across等多元網(wǎng)絡(luò)連接場(chǎng)景共同驅(qū)動(dòng),各技術(shù)路線(xiàn)長(zhǎng)期共存、并行發(fā)展。

Scale-Up 即垂直擴(kuò)展,通過(guò)向單個(gè)節(jié)點(diǎn)添加更多硬件提升處理能力。在 AI 大模型訓(xùn)練里,它借助高速互聯(lián)技術(shù)將單個(gè)節(jié)點(diǎn)多塊 GPU 緊密相連,形成有超大共享顯存池的“超級(jí)節(jié)點(diǎn)”,讓單個(gè)模型能在統(tǒng)一顯存空間高效訓(xùn)練,無(wú)需跨節(jié)點(diǎn)通信,是解決“內(nèi)存墻”瓶頸的關(guān)鍵。

Scale-Out 是水平擴(kuò)展,通過(guò)增加節(jié)點(diǎn)組成集群提升整體處理能力。當(dāng)單個(gè)“超級(jí)節(jié)點(diǎn)”算力不夠時(shí),將成百上千個(gè)節(jié)點(diǎn)用高速網(wǎng)絡(luò)連接成龐大計(jì)算集群,讓模型訓(xùn)練任務(wù)可并行分布在眾多 GPU 上。

Scale-Across(跨區(qū)域擴(kuò)展)是應(yīng)對(duì)超大規(guī)模 AI 計(jì)算需求提出的“第三大支柱”范式。隨著 AI 模型對(duì)算力需求爆炸式增長(zhǎng),單個(gè)數(shù)據(jù)中心在電力、散熱、空間上接近極限,Scale-Across 便是將不同城市、國(guó)家甚至大洲的多個(gè)數(shù)據(jù)中心用高速網(wǎng)絡(luò)連接,形成協(xié)同工作的“超級(jí)巨型工廠”。

隨著AI大模型向千億、萬(wàn)億參數(shù)規(guī)模突破,訓(xùn)練與推理場(chǎng)景的高并發(fā)數(shù)據(jù)傳輸需求呈指數(shù)級(jí)增長(zhǎng),Scaleup網(wǎng)絡(luò)作為支撐算力高效釋放的核心基礎(chǔ)設(shè)施,規(guī)模也在迅速擴(kuò)大。目前,Scale out層面可插拔光模塊仍是首選,Scale up層面作為新興光模塊市場(chǎng),技術(shù)高速迭代,NPO、CPO 等方案同步演進(jìn)。

全球首款3.2T NPO模塊成功點(diǎn)亮

2025年10月,阿里云正式發(fā)布UPN512全光Scale-up架構(gòu)白皮書(shū),提出基于單層以太網(wǎng)光互連的全新設(shè)計(jì),旨在打造“大規(guī)模、高性能、高可靠、低成本、易擴(kuò)展”的xPU互聯(lián)系統(tǒng)。

UPN512通過(guò)光互連直接連接xPU與交換機(jī),采用單層CLOS拓?fù)鋵?shí)現(xiàn)512顆xPU全互聯(lián),還為擴(kuò)展至1K +節(jié)點(diǎn)預(yù)留架構(gòu)空間。此方案消除機(jī)柜內(nèi)高速銅纜,大幅降低布線(xiàn)復(fù)雜度、散熱負(fù)擔(dān)、供電需求及運(yùn)維成本。

NPO是UPN512架構(gòu)的核心使能技術(shù)。它將光電引擎靠近主芯片部署,采用線(xiàn)性直驅(qū)技術(shù),省去傳統(tǒng)DSP芯片,實(shí)現(xiàn)功耗降低50%以上、成本下降30%、端到端時(shí)延與銅互連相當(dāng),且供應(yīng)鏈更安全可控。與LPO相比,NPO帶寬密度更高,對(duì)主芯片SerDes性能要求更低;和CPO相比,NPO采用標(biāo)準(zhǔn)LGA連接器,保持光模塊開(kāi)放解耦特性,更易被用戶(hù)采納。

阿里云從3.2T NPO切入研發(fā),基于OIF標(biāo)準(zhǔn)封裝,在22.5mm×35.1mm尺寸內(nèi)實(shí)現(xiàn)3.2Tb/s傳輸帶寬。通過(guò)標(biāo)準(zhǔn)LGA連接器,光引擎與主芯片物理和電氣解耦,延續(xù)開(kāi)放生態(tài)。該模塊支持硅光與VCSEL兩種技術(shù)路線(xiàn),適配不同場(chǎng)景。

近日,阿里云宣布全球首款基于OIF標(biāo)準(zhǔn)封裝的3.2T NPO模塊成功點(diǎn)亮,標(biāo)志著全光Scale-up進(jìn)入工程落地新階段。該模塊基于兩顆16通道收發(fā)一體硅光芯片,搭配線(xiàn)性直驅(qū)Driver/TIA芯片,采用2D封裝工藝,具備快速量產(chǎn)潛力。其關(guān)鍵性能指標(biāo)優(yōu)異:發(fā)送端光眼圖性能好,符合IEEE 802.3bs DR4標(biāo)準(zhǔn),可與傳統(tǒng)帶DSP的DR4光模塊無(wú)縫互通;接收端在1E - 6誤碼率下,所有通道靈敏度優(yōu)于 - 5dBm;典型功耗約20W,低于同帶寬DSP方案。

阿里云將3.2T NPO技術(shù)率先應(yīng)用于新一代國(guó)產(chǎn)四芯片交換機(jī)。該設(shè)備單機(jī)集成4顆25.6T國(guó)產(chǎn)交換芯片,總交換容量達(dá)102.4T,可平滑演進(jìn)至409.6T平臺(tái)。目前,該交換機(jī)已完成整機(jī)上電與核心功能驗(yàn)證,進(jìn)入長(zhǎng)期可靠性測(cè)試階段。

寫(xiě)在最后

在算力需求持續(xù)增長(zhǎng)的當(dāng)下,全球算力基建正經(jīng)歷深刻變革。算力中心多元網(wǎng)絡(luò)連接場(chǎng)景驅(qū)動(dòng)光互連技術(shù)發(fā)展。從目前的情況來(lái)看,可插拔光模塊在未來(lái)幾年仍是需求主力;NPO/CPO 在柜內(nèi)全光連接領(lǐng)域加速滲透,CPO進(jìn)展超預(yù)期。此前市場(chǎng)對(duì)NPO較少關(guān)注,隨著近期阿里云、騰訊在NPO方面的動(dòng)作和進(jìn)展,其技術(shù)優(yōu)勢(shì)想必會(huì)更多的被業(yè)界關(guān)注。整體來(lái)看,光互連行業(yè)市場(chǎng)空間將持續(xù)擴(kuò)大。

近期阿里、騰訊均推出NPO(近封裝光學(xué))重大成果,其中阿里云全光Scale-up網(wǎng)絡(luò)架構(gòu)UPN512通過(guò)光互連直接連接xPU與交換機(jī),采用單層CLOS拓?fù)鋵?shí)現(xiàn)512顆xPU的全互聯(lián),該方案徹底消除機(jī)柜內(nèi)高速銅纜,顯著降低布線(xiàn)復(fù)雜度、散熱負(fù)擔(dān)、供電需求及運(yùn)維成本,功耗降低50%,成本下降30%。

近封裝光學(xué)NPO技術(shù)優(yōu)勢(shì)

首先我們來(lái)看看什么是NPO及其優(yōu)勢(shì)。中國(guó)移動(dòng)云能力中心此前發(fā)布過(guò)一份《云智算光互連發(fā)展報(bào)告》,該報(bào)告介紹,NPO的核心思想是,將光引擎非常靠近電芯片放置,但并不像CPO那樣與電芯片共封裝在同一基板或中介層上。它通常將光引擎安裝在同一基板上,通過(guò)極短的高性能電氣鏈路與電芯片相連,形成一個(gè)高度集成的系統(tǒng),如下圖所示。

NPO將光引擎與電芯片物理分離,避免了電芯片的高溫?zé)崃恐苯記_擊光器件,散熱設(shè)計(jì)更簡(jiǎn)單、高效。由于電芯片本身是巨大的熱源,工作時(shí)溫度很高,而激光器等光器件對(duì)溫度極其敏感,所以,光引擎與電芯片共封裝會(huì)導(dǎo)致波長(zhǎng)漂移和性能下降。同時(shí),由于光引擎未與電芯片共封裝,NPO在可維護(hù)性層面具有優(yōu)勢(shì),如果光引擎失效,只需更換光引擎子模塊即可,避免了大量的維護(hù)成本。

相比激進(jìn)的CPO技術(shù),NPO技術(shù)是一種更務(wù)實(shí)、風(fēng)險(xiǎn)更低的路徑。并且,NPO與傳統(tǒng)光模塊相比,其性能遠(yuǎn)超傳統(tǒng)光模塊,其主要優(yōu)勢(shì)包括以下幾點(diǎn):

lNPO的光引擎擁有更大的可布置面積和更靈活的走線(xiàn)方案,可以方便地使用LGA封裝,且有利于光引擎散熱;

lNPO不影響電芯片原有設(shè)計(jì),只對(duì)PCB或基板做差異設(shè)計(jì)即可滿(mǎn) 足不同需求;

lNPO與電芯片解耦,能夠避免形成電芯片壟斷問(wèn)題;

lNPO可單獨(dú)測(cè)試 TP1 的電信號(hào)質(zhì)量,可歸一化設(shè)備的驅(qū)動(dòng)與固件,可測(cè)試性更好。

產(chǎn)業(yè)界正在形成共識(shí),未來(lái)光互聯(lián)由Scale-up、Scale-out、Scale-across等多元網(wǎng)絡(luò)連接場(chǎng)景共同驅(qū)動(dòng),各技術(shù)路線(xiàn)長(zhǎng)期共存、并行發(fā)展。

Scale-Up 即垂直擴(kuò)展,通過(guò)向單個(gè)節(jié)點(diǎn)添加更多硬件提升處理能力。在 AI 大模型訓(xùn)練里,它借助高速互聯(lián)技術(shù)將單個(gè)節(jié)點(diǎn)多塊 GPU 緊密相連,形成有超大共享顯存池的“超級(jí)節(jié)點(diǎn)”,讓單個(gè)模型能在統(tǒng)一顯存空間高效訓(xùn)練,無(wú)需跨節(jié)點(diǎn)通信,是解決“內(nèi)存墻”瓶頸的關(guān)鍵。

Scale-Out 是水平擴(kuò)展,通過(guò)增加節(jié)點(diǎn)組成集群提升整體處理能力。當(dāng)單個(gè)“超級(jí)節(jié)點(diǎn)”算力不夠時(shí),將成百上千個(gè)節(jié)點(diǎn)用高速網(wǎng)絡(luò)連接成龐大計(jì)算集群,讓模型訓(xùn)練任務(wù)可并行分布在眾多 GPU 上。

Scale-Across(跨區(qū)域擴(kuò)展)是應(yīng)對(duì)超大規(guī)模 AI 計(jì)算需求提出的“第三大支柱”范式。隨著 AI 模型對(duì)算力需求爆炸式增長(zhǎng),單個(gè)數(shù)據(jù)中心在電力、散熱、空間上接近極限,Scale-Across 便是將不同城市、國(guó)家甚至大洲的多個(gè)數(shù)據(jù)中心用高速網(wǎng)絡(luò)連接,形成協(xié)同工作的“超級(jí)巨型工廠”。

隨著AI大模型向千億、萬(wàn)億參數(shù)規(guī)模突破,訓(xùn)練與推理場(chǎng)景的高并發(fā)數(shù)據(jù)傳輸需求呈指數(shù)級(jí)增長(zhǎng),Scaleup網(wǎng)絡(luò)作為支撐算力高效釋放的核心基礎(chǔ)設(shè)施,規(guī)模也在迅速擴(kuò)大。目前,Scale out層面可插拔光模塊仍是首選,Scale up層面作為新興光模塊市場(chǎng),技術(shù)高速迭代,NPO、CPO 等方案同步演進(jìn)。

全球首款3.2T NPO模塊成功點(diǎn)亮

2025年10月,阿里云正式發(fā)布UPN512全光Scale-up架構(gòu)白皮書(shū),提出基于單層以太網(wǎng)光互連的全新設(shè)計(jì),旨在打造“大規(guī)模、高性能、高可靠、低成本、易擴(kuò)展”的xPU互聯(lián)系統(tǒng)。

UPN512通過(guò)光互連直接連接xPU與交換機(jī),采用單層CLOS拓?fù)鋵?shí)現(xiàn)512顆xPU全互聯(lián),還為擴(kuò)展至1K +節(jié)點(diǎn)預(yù)留架構(gòu)空間。此方案消除機(jī)柜內(nèi)高速銅纜,大幅降低布線(xiàn)復(fù)雜度、散熱負(fù)擔(dān)、供電需求及運(yùn)維成本。

NPO是UPN512架構(gòu)的核心使能技術(shù)。它將光電引擎靠近主芯片部署,采用線(xiàn)性直驅(qū)技術(shù),省去傳統(tǒng)DSP芯片,實(shí)現(xiàn)功耗降低50%以上、成本下降30%、端到端時(shí)延與銅互連相當(dāng),且供應(yīng)鏈更安全可控。與LPO相比,NPO帶寬密度更高,對(duì)主芯片SerDes性能要求更低;和CPO相比,NPO采用標(biāo)準(zhǔn)LGA連接器,保持光模塊開(kāi)放解耦特性,更易被用戶(hù)采納。

阿里云從3.2T NPO切入研發(fā),基于OIF標(biāo)準(zhǔn)封裝,在22.5mm×35.1mm尺寸內(nèi)實(shí)現(xiàn)3.2Tb/s傳輸帶寬。通過(guò)標(biāo)準(zhǔn)LGA連接器,光引擎與主芯片物理和電氣解耦,延續(xù)開(kāi)放生態(tài)。該模塊支持硅光與VCSEL兩種技術(shù)路線(xiàn),適配不同場(chǎng)景。

近日,阿里云宣布全球首款基于OIF標(biāo)準(zhǔn)封裝的3.2T NPO模塊成功點(diǎn)亮,標(biāo)志著全光Scale-up進(jìn)入工程落地新階段。該模塊基于兩顆16通道收發(fā)一體硅光芯片,搭配線(xiàn)性直驅(qū)Driver/TIA芯片,采用2D封裝工藝,具備快速量產(chǎn)潛力。其關(guān)鍵性能指標(biāo)優(yōu)異:發(fā)送端光眼圖性能好,符合IEEE 802.3bs DR4標(biāo)準(zhǔn),可與傳統(tǒng)帶DSP的DR4光模塊無(wú)縫互通;接收端在1E - 6誤碼率下,所有通道靈敏度優(yōu)于 - 5dBm;典型功耗約20W,低于同帶寬DSP方案。

阿里云將3.2T NPO技術(shù)率先應(yīng)用于新一代國(guó)產(chǎn)四芯片交換機(jī)。該設(shè)備單機(jī)集成4顆25.6T國(guó)產(chǎn)交換芯片,總交換容量達(dá)102.4T,可平滑演進(jìn)至409.6T平臺(tái)。目前,該交換機(jī)已完成整機(jī)上電與核心功能驗(yàn)證,進(jìn)入長(zhǎng)期可靠性測(cè)試階段。

寫(xiě)在最后

在算力需求持續(xù)增長(zhǎng)的當(dāng)下,全球算力基建正經(jīng)歷深刻變革。算力中心多元網(wǎng)絡(luò)連接場(chǎng)景驅(qū)動(dòng)光互連技術(shù)發(fā)展。從目前的情況來(lái)看,可插拔光模塊在未來(lái)幾年仍是需求主力;NPO/CPO 在柜內(nèi)全光連接領(lǐng)域加速滲透,CPO進(jìn)展超預(yù)期。此前市場(chǎng)對(duì)NPO較少關(guān)注,隨著近期阿里云、騰訊在NPO方面的動(dòng)作和進(jìn)展,其技術(shù)優(yōu)勢(shì)想必會(huì)更多的被業(yè)界關(guān)注。整體來(lái)看,光互連行業(yè)市場(chǎng)空間將持續(xù)擴(kuò)大。

聲明:本文內(nèi)容及配圖由入駐作者撰寫(xiě)或者入駐合作網(wǎng)站授權(quán)轉(zhuǎn)載。文章觀點(diǎn)僅代表作者本人,不代表電子發(fā)燒友網(wǎng)立場(chǎng)。文章及其配圖僅供工程師學(xué)習(xí)之用,如有內(nèi)容侵權(quán)或者其他違規(guī)問(wèn)題,請(qǐng)聯(lián)系本站處理。

舉報(bào)投訴

-

阿里云

+關(guān)注

關(guān)注

3文章

1041瀏覽量

45786 -

AI算力

+關(guān)注

關(guān)注

1文章

151瀏覽量

9970

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

熱點(diǎn)推薦

時(shí)延小于1毫秒,工信部發(fā)布全光算力網(wǎng)絡(luò)重磅利好政策

信號(hào)傳輸物理瓶頸限制,存在時(shí)延高、帶寬不足、擴(kuò)展性差等問(wèn)題,難以支撐未來(lái)百萬(wàn)卡級(jí)智算集群的規(guī)模化部署。在此形勢(shì)下,光通信技術(shù)憑借超低時(shí)延、超大帶寬和協(xié)議透明性等優(yōu)勢(shì),成為突破算

邊緣AI算力臨界點(diǎn):深度解析176TOPS香橙派AI Station的產(chǎn)業(yè)價(jià)值

310P芯片的底層架構(gòu),深度剖析這款產(chǎn)品的技術(shù)細(xì)節(jié)、算力門(mén)檻及其在實(shí)際產(chǎn)業(yè)落地中的真實(shí)價(jià)值。

一、176TOPS的產(chǎn)業(yè)門(mén)檻:為何這是邊緣算力

發(fā)表于 03-10 14:19

如何突破AI存儲(chǔ)墻?深度解析ONFI 6.0高速接口與Chiplet解耦架構(gòu)

1. 行業(yè)核心痛點(diǎn):AI“存儲(chǔ)墻”危機(jī)在大模型訓(xùn)練與推理場(chǎng)景中,算力演進(jìn)速度遠(yuǎn)超存儲(chǔ)帶寬,計(jì)算與存儲(chǔ)之間的性能鴻溝(存儲(chǔ)墻)已成為限制系統(tǒng)能效的關(guān)鍵瓶頸。? Scale-up需求:?jiǎn)喂?jié)

發(fā)表于 01-29 17:32

睿海光電推出新一代光互聯(lián)解決方案 加速AI算力基礎(chǔ)設(shè)施升級(jí)

睿海光電推出新一代光互聯(lián)解決方案 加速AI算力基礎(chǔ)設(shè)施升級(jí) ? 在全球算

400G QSFP-DD SR4 光模塊:構(gòu)筑 AI 智算網(wǎng)絡(luò)的高速光互聯(lián)核心

在數(shù)字化轉(zhuǎn)型與 AI 算力需求爆發(fā)的疊加驅(qū)動(dòng)下,400G QSFP-DD SR4 光模塊憑借短距高效傳輸特性與全場(chǎng)景適配能力,已成為數(shù)據(jù)中心、云

睿海光電800G光模塊助力全球AI基建升級(jí)

在全球數(shù)字化轉(zhuǎn)型加速的背景下,超高速光模塊作為數(shù)據(jù)中心與AI算力網(wǎng)絡(luò)的核心部件,正經(jīng)歷從400G向800G、1.6T的迭代浪潮。在這一賽道中,深圳市睿海光電科技有限公司(以下簡(jiǎn)稱(chēng)“睿海

發(fā)表于 08-13 19:05

睿海光電領(lǐng)航AI光模塊:超快交付與全場(chǎng)景兼容賦能智算時(shí)代——以創(chuàng)新實(shí)力助力全球客戶(hù)構(gòu)建高效算力底座

一、AI算力革命催生光模塊新需求,睿海光電以技術(shù)優(yōu)勢(shì)搶占制高點(diǎn)

人工智能、超大規(guī)模數(shù)據(jù)中心和云計(jì)算的高速發(fā)展,對(duì)光模塊的傳輸效率、兼容性及交付周期提出更高要求。作為全球

發(fā)表于 08-13 19:03

睿海光電以高效交付與廣泛兼容助力AI數(shù)據(jù)中心800G光模塊升級(jí)

引領(lǐng)AI時(shí)代網(wǎng)絡(luò)變革:睿海光電的核心競(jìng)爭(zhēng)力

在AI時(shí)代,數(shù)據(jù)中心正經(jīng)歷從傳統(tǒng)架構(gòu)向AI工廠與AI

發(fā)表于 08-13 19:01

加速AI未來(lái),睿海光電800G OSFP光模塊重構(gòu)數(shù)據(jù)中心互聯(lián)標(biāo)準(zhǔn)

在人工智能算力需求呈指數(shù)級(jí)增長(zhǎng)的2025年,數(shù)據(jù)傳輸效率已成為制約AI發(fā)展的關(guān)鍵瓶頸。作為全球AI光

發(fā)表于 08-13 16:38

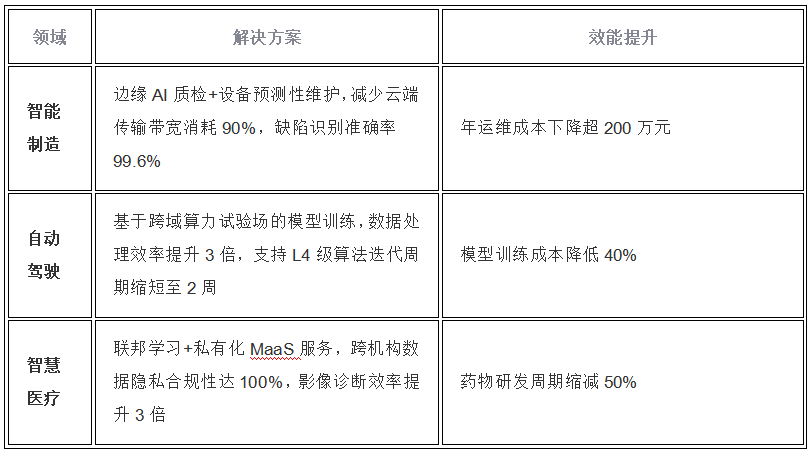

AIGC算力基礎(chǔ)設(shè)施技術(shù)架構(gòu)與行業(yè)實(shí)踐

AIGC算力基礎(chǔ)設(shè)施技術(shù)架構(gòu)與行業(yè)實(shí)踐 一、硬件層:AI算力的物理載體 芯片技術(shù)升級(jí)? 國(guó)際前沿

AI原生架構(gòu)升級(jí):RAKsmart服務(wù)器在超大規(guī)模模型訓(xùn)練中的算力突破

近年來(lái),隨著千億級(jí)參數(shù)模型的崛起,AI訓(xùn)練對(duì)算力的需求呈現(xiàn)指數(shù)級(jí)增長(zhǎng)。傳統(tǒng)服務(wù)器架構(gòu)在應(yīng)對(duì)分布式訓(xùn)練、高并發(fā)計(jì)算和顯存優(yōu)化等場(chǎng)景時(shí)逐漸顯露瓶頸

RAKsmart智能算力架構(gòu):異構(gòu)計(jì)算+低時(shí)延網(wǎng)絡(luò)驅(qū)動(dòng)企業(yè)AI訓(xùn)練范式升級(jí)

在AI大模型參數(shù)量突破萬(wàn)億、多模態(tài)應(yīng)用爆發(fā)的今天,企業(yè)AI訓(xùn)練正面臨算力效率與成本的雙重挑戰(zhàn)。RAKsmart推出的智能

華為助力中國(guó)移動(dòng)全面升級(jí)“九州”算力互聯(lián)網(wǎng)

在中國(guó)移動(dòng)云智算大會(huì)期間,以“智算啟新,安全筑基“為主題的智算基礎(chǔ)設(shè)施及安全峰會(huì)成功舉辦。會(huì)上,中國(guó)移動(dòng)聯(lián)合華為等重磅發(fā)布了《“九州”算

廣和通亮相阿里云AI創(chuàng)造力大展

4月9日-12日,2025 AI“巨”場(chǎng)· 中國(guó)AI創(chuàng)造力大展在北京首創(chuàng)·郎園Station盛大啟幕。作為阿里云的重要合作伙伴,廣和通攜融合

阿里云全光互聯(lián)架構(gòu),突破AI算力瓶頸

阿里云全光互聯(lián)架構(gòu),突破AI算力瓶頸

評(píng)論