過去兩年,具身智能幾乎成了全球機器人領域最不缺討論、卻最難落地的方向。

在北美,Embodied AI被頻繁寫進通往AGI的路線圖;在歐洲,實驗室里的機器人已經能完成越來越復雜的多步操作;而在中國,從大廠到創業公司,幾乎所有與智能有關的發布里都開始出現“embodied”“VLA”“世界模型”等關鍵詞。

IDC預測,2026年的全球人形機器人市場將翻倍,中國具身智能支出規模或將超過110億美元,從千臺級向萬臺級躍遷。

2026春節前夕已經傳出多家具身智能企業的機器人將集體上春晚斗舞的消息。

看上去,一切都在加速。但一個略顯尷尬的現實是,熱度雖高,真正能穩定跑在真實場景里的系統卻寥寥無幾,大多數方案仍是在通用大模型上拼湊感知、控制和執行模塊。

行業逐漸意識到,研發新技術并不意味著真實的量產能力,具身智能的瓶頸正從算力Infra轉向算法Infra,也就是支撐開發、驗證和持續迭代的底層工具鏈。有沒有好用的開發框架?有沒有統一的評測標準?模型能不能在真實環境中越用越聰明?

換句話說,具身智能要走向大規模部署,需要的不是更多單點技術,而是一套原生的、端到端的系統。

那么,這套系統應該如何構建?實驗室到量產之間還有哪些鴻溝需要跨越?

在剛剛結束的Dexmal Open Day 2026上,原力靈機發布的系列產品給出了一些不同的答案。

明明技術和發布會層出不窮,大規模部署卻遲遲難以落地,具身智能究竟被困在了哪里?

如果回顧過去兩年具身智能的技術脈絡,會發現幾乎所有玩家都走上了同一條路——拼湊主義。

簡單來說,拼湊主義就是從大模型出發,引入視覺、語言,再試圖通過動作頭或策略網絡,把智能延伸到物理世界。這種方式能讓機器人快速學會看圖說話,卻難以讓它進行常識推理。一旦現場環境發生變化,或遇到訓練數據中未覆蓋的長尾場景,系統就會失效。

模型技術之外,另一個阻礙行業爆發的頑疾是行業碎片化。現在具身智能的開發就像是在原始森林里開路,各家的感知、規劃和控制模塊深度綁定。如果想給機器人換一個更好的視覺方案,就需要把整套控制邏輯重寫一遍。極高的重復造輪子成本讓很多初創團隊還沒走到交付階段就耗盡了資源。在這個節點上,開發者們真正渴望的,其實是一個像PyTorch那樣統一、開放且解耦的開發底座。

除了技術和開發工具,目前行業還缺乏一套能夠將技術轉化為經濟價值的衡量標準。目前主流的具身智能公司都無法回答客戶最關心的指標問題。而缺乏指標,自然難有客戶愿意為大規模量產買單。

正因如此,行業逐漸意識到:具身智能不能被視為大模型的下游應用,而必須是一套具備原生技術、開發工具和商業評估標準的面向物理世界的系統工程。

面對碎片化的難題,誰能給出新解法?

一個值得注意的變化是,在這輪具身智能討論中,中國團隊的身影愈發清晰。

早期,中國公司更多被視為快速部署和落地的代表,而具身智能的底層范式往往由海外實驗室主導。但在最近一兩年,這種分工正在被打破。

從跨機型VLA訓練到真機評測基準、再到開源框架和數據標準,越來越多中國團隊開始直接參與到方法論層的構建。

但這些構建大多還停留在爭論用哪個大模型改,那么能不能直接跳出這個問題,從第一行代碼就直接為機器人而寫呢?

在剛剛結束的 Dexmal Open Day 2026 上,這個問題已經有了一些新的思考。

Dexmal Open Day2026 是原力靈機成立之后首次面向行業專家、技術開發者、媒體等舉行的技術開放日。

開放日上,原力靈機給出的答案可以概括為一個關鍵點——以infra為底座構建具身原生。該系統以DM0為原生智能內核,以Dexbotic 2.0為算法開發Infra,以RoboChallenge為評測Infra,再以DFOL為持續進化引擎,四者共同構成一套自洽、可擴展、可進化的具身智能基礎設施體系。

這一思路最直接的體現是其具身原生大模型DM0。與行業中常見的單任務訓練方式不同,DM0是從0開始訓練的具身原生大模型。其在預訓練階段就引入多任務、跨機型的混合訓練,覆蓋抓取、導航、全身控制等核心能力,并橫跨8種結構差異顯著的機器人本體。例如,在A平臺上學會處理易碎品的經驗,能夠有效遷移到B平臺處理類似物體,無需重新標注海量數據。

有意思的是,DM0只有2.4 B參數,卻在真機測評里拿了單任務和多任務雙項第一。為什么?關鍵在于它用了一種叫空間推理思維鏈(Spatial CoT) 的方式來思考。

舉個例子,“把桌上的商品掃個碼計價”這句話其實很模糊,桌上可能有好幾個商品,有的被遮擋,有的反光,掃碼槍的角度也得對。DM0能夠像人一樣一步步拆解:先看清楚有哪些東西,判斷哪個是目標商品,再想“我該從哪邊靠近?手怎么動才能穩穩拿起它并轉到掃碼位置?”接著生成一條平滑的視覺軌跡,最后轉換成機械臂能執行的三維動作。正因如此,它不僅能完成特定任務,還能內化物理常識,具備更強的泛化能力和魯棒性。

目前,DM0 2.4B版本代碼、模型已分別在GitHub、Hugging Face開源,模型測試任務RoboChallenge Table30的全部30個任務的參數和推理代碼也同步開源。

如果說DM0解決的是底層技術,Dexbotic 2.0解決的就是如何讓能力被復用。

作為全球首個具身原生開發框架,Dexbotic 2.0的出現某種程度上解決了開發碎片化的難題。過去,感知、規劃與控制模塊往往深度耦合,換一個視覺模型可能就得重寫整套控制邏輯。而Dexbotic 2.0通過模塊化設計,將整個系統清晰拆解為三大可插拔組件:V(Vision Encoder)、L(LLM )和A(Action Expert),實現真正的解耦。

在此基礎上,它還統一了數據格式、訓練流程和評測標準。無論是模仿學習還是強化學習,都能在同一個框架內高效協同,仿真訓練的結果也能無縫遷移到真機部署。這種端到端打通的思路顯著降低了具身智能系統的工程復雜度。

但研發與開發之后,什么能讓具身智能真正被大規模復制、走向實際生產生活場景?

真正將這一切推向商業語境的是具身原生應用量產工作流DFOL(Distributed Field Online Learning)。傳統模式中,真實場景只是模型的考場,系統部署后,表現好就留下,表現差就退貨。DFOL構建了一個“云端-現場”協同的持續學習閉環,將成功率、動作精度、節拍(吞吐效率)等工業客戶最關心的指標直接嵌入學習目標中。

這樣一來,具身智能不再是交付即終結的一次性產品,而變成一種可進化、可度量、可解鎖具身應用量產工作流。客戶按效果付費,廠商通過數據飛輪持續優化體驗,形成正向商業循環。

當然,要讓這一模式被廣泛采納,還需要行業共識。原力靈機聯合Hugging Face共同發起RoboChallenge,旨在建立全球首個聚焦真機性能的大規模評測平臺。未來,各家公司不再自說自話,而是用同一套標準衡量成功率、精度與節拍,推動行業透明化與良性競爭。

這樣一來,從模型、研發到商業化、評測,具身智能就有了自己的一套原生系統。

站在今天回看具身智能,競爭焦點已經發生了變化。

具身智能的上半場,拼的是單點突破,語言理解、視覺識別、運動控制輪番登場,每一項技術進步都足以掀起一輪融資熱潮。

但熱潮褪去,客戶開始更加關注技術落地能力和算法層面的開發框架。

在下半場,具身智能不再比誰的單項技術最亮眼,而是比誰擁有更強的系統能力、誰有更強的開發基礎設施。所謂系統能力,不是模塊的簡單堆砌,而是感知、決策、執行、反饋各環節能否在真實物理世界中形成高效、魯棒、可進化的閉環。

2026年不是具身智能的元年,而是具身原生的元年。

所謂具身原生,意味著不再將通用AI“外掛”到機器人上,而是從第一行代碼起,就讓智能在物理交互中生長,理解重力、摩擦、碰撞,適應光照變化、物料變異與環境擾動。

在這一意義上,原力靈機的技術產品矩陣提供了一條值得被認真審視的樣本路徑:用具身原生大模型彌合語義與動作的鴻溝,用開源框架降低創新門檻,再通過DFOL這樣的閉環機制,將工業客戶關心的成功率、精度與節拍直接轉化為可優化的學習目標。而RoboChallenge作為真機評測Infra,用統一標準衡量實效,確保所有技術進步可驗證、可比較、可對齊商業需求。

歷史經驗表明,真正的技術革命往往始于Infra的成熟。深度學習因PyTorch而爆發,自動駕駛因CARLA而加速。如今,具身智能正站在自己的Infra拐點上。得Infra者,得天下。誰構建了更開放、更高效、更貼近物理世界的基礎設施,誰就掌握了定義下一代智能體的能力。

而這,或許正是克服具身智能“最后一公里”難題的關鍵解法。

-

機器人

+關注

關注

213文章

31263瀏覽量

223194 -

AI

+關注

關注

91文章

40578瀏覽量

302210 -

具身智能

+關注

關注

0文章

439瀏覽量

895

發布評論請先 登錄

具身智能交流會

資訊速遞 | 具身智能PMC(籌)發布“零成本”開源鴻蒙智能機器人系統

2025開放原子開發者大會具身智能分論壇成功舉辦

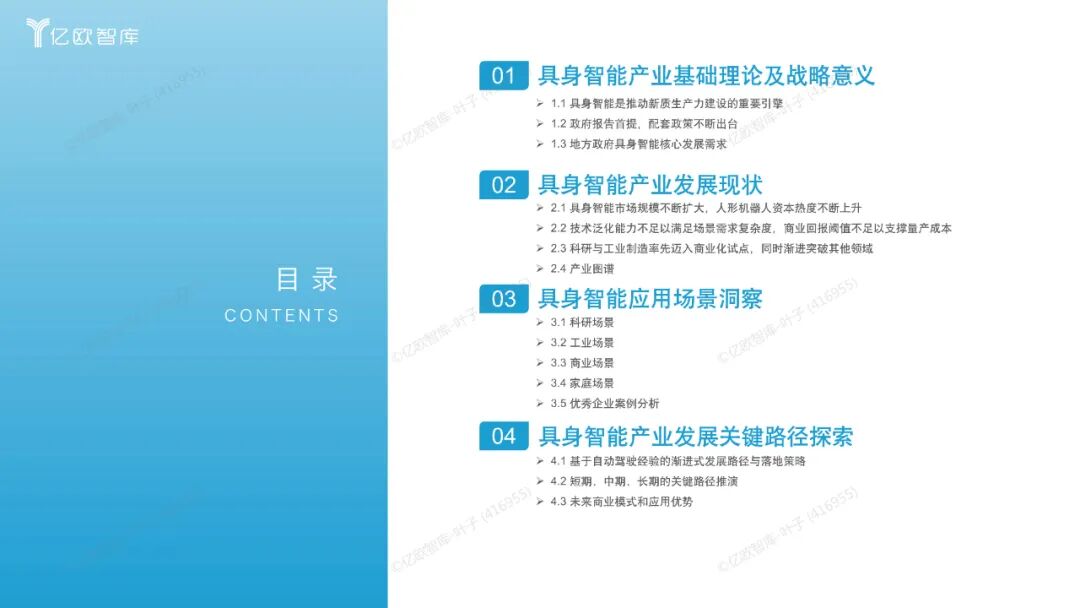

2025年中國具身智能產業發展規劃與場景應用洞察

什么樣的智能體才能稱為具身智能?

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+具身智能芯片

中國具身智能的機遇與挑戰

英特爾? 具身智能大小腦融合方案發布:構建具身智能落地新范式

具身智能的PyTorch時刻,還需要哪些“原力”?

具身智能的PyTorch時刻,還需要哪些“原力”?

評論