1、背景

在 AI 問世的兩年里,我們習慣了把它當作一個超級百科全書:如果你問它一個事實,它會給出答案;如果你給它一段文字,它會幫你總結(jié)。然而,當我們面對“分析某行業(yè)未來五年的趨勢”或“撰寫一份詳盡的技術(shù)競品調(diào)研報告”這樣復雜的任務時,傳統(tǒng)的 LLM 往往顯得力不從心——它們?nèi)狈ι疃龋菀桩a(chǎn)生幻覺,且受限于上下文長度。

Deep Research正是為了解決這一痛點而生。它不再是一個簡單的聊天機器人,而是具備自主推理能力的“AI 研究員”。

我將會在下面的內(nèi)容中深入剖析 Deep Research 的運行機制、其背后的工程挑戰(zhàn)以及它如何通過“ReAct 范式”重塑信息獲取的方式。

2、什么是 Deep Research

Deep Research 是 專為網(wǎng)頁瀏覽、數(shù)據(jù)分析和復雜任務處理而優(yōu)化的全新功能。與普通 LLM “問什么答什么”的被動模式不同,Deep Research 具備主動規(guī)劃和深度推理的能力。

它的核心特征可以概括為:

1.自主性(Autonomy): 它可以一邊思考,一邊“查資料”。它不僅是檢索信息,還能自主判斷信息是否足夠,如果不足,它會主動調(diào)整搜索關鍵詞再次檢索。

2.長鏈條推理(Long-chain Reasoning): 基于 LLM的推理能力,它能將一個模糊的龐大需求拆解為多個子步驟,分階段執(zhí)行。

3.專業(yè)報告生成: 最終輸出的不是零散的對話,而是包含邏輯摘要、清晰引用來源和完整文檔的專業(yè)級研究報告。

為什么我們需要它?當前的信息需求往往需要跨越多個來源、閱讀大量非結(jié)構(gòu)化數(shù)據(jù)。Deep Research 實際上降低了“海量信息收集”與“高質(zhì)量推理整合”之間的壁壘,尤其擅長挖掘那些需要瀏覽數(shù)十個網(wǎng)頁才能拼湊出的小眾或非直觀信息。

3、核心原理:從 DeepSearch 到 DeepResearch

要理解 Deep Research,通過兩個層級來看:底層的搜索循環(huán)(DeepSearch)和上層的報告框架(DeepResearch)。

3.1 核心引擎:DeepSearch(循環(huán)與迭代)

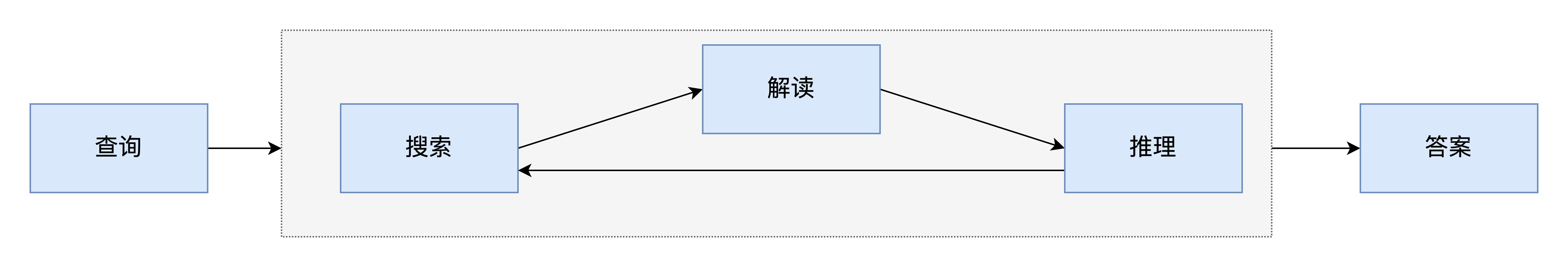

DeepSearch 的本質(zhì)是一個“搜索 - 閱讀 - 推理”的無限循環(huán)。這與我們熟悉的ReAct Agent范式高度相似,但通過強化學習(RL)不僅學會了推理,更學會了“搜索策略”:

?搜索(Search): 探索互聯(lián)網(wǎng),獲取原始信息。

?閱讀(Read): 對特定網(wǎng)頁進行詳盡分析,提取關鍵片段。

?推理(Think): 這是最關鍵的一步。模型會評估當前收集到的信息是否足以回答問題。如果不夠,它會決定是將問題拆解為更小的子問題,還是嘗試全新的搜索關鍵詞。

這種 → → → → 的模式,讓 AI 具備了“自我糾錯”和“追根究底”的能力。

3.2 上層框架:DeepResearch(結(jié)構(gòu)化輸出)

DeepSearch 負責找答案,而 DeepResearch 負責寫報告。它在 DeepSearch 的基礎上增加了一個結(jié)構(gòu)化框架:

1.用戶意圖理解 & 目錄生成(TOC): 接收指令后,首先生成報告目錄(如引言、方法論、相關工作、結(jié)論)。

2.分章節(jié)執(zhí)行: 系統(tǒng)性地將 DeepSearch 引擎應用到報告的每一個章節(jié)中。每個章節(jié)都是一個獨立的研究任務。

3.全局整合: 最后將所有章節(jié)內(nèi)容整合,進行連貫性潤色,生成最終報告。

整個執(zhí)行過程通常耗時 5 到 30 分鐘,這在以前的即時問答中是不可想象的,但對于深度研究來說,卻是極高的效率。

讓 LLM 在自身推理過程中與搜索引擎交替交互。用戶輸入query,LLM產(chǎn)生TOC,然后進入循環(huán):查找、讀取和推理,直到達到結(jié)束的條件,然后再通過LLM做總結(jié),最終給用戶輸出完整的研究報告( → → → → )的模式,已經(jīng)非常接近我們熟悉的 ReAct Agent 范式。不同的是,這里的 Agent 不依賴提示詞,而是通過 RL 真正“學會了”搜索策略。實質(zhì)上就是一個 “帶搜索能力的 ReAct Agent”,只不過不再依賴提示詞工程,而是直接通過強化學習學會何時搜索、何時推理。注意,它是主動認知到何時需要檢索信息,這是一個非常顯著的特點和不同。

4、 工程化挑戰(zhàn)與解決方案

Deep Research 之所以能超越普通的 RAG(檢索增強生成),在于它解決了一系列棘手的工程問題。通過對技術(shù)細節(jié)的復盤,我們可以了解到其背后的技術(shù)實現(xiàn)。

4.1 解決“垃圾進,垃圾出”:URL 排序與清洗

4.1.1 問題

Deep Research 在一次任務中可能掃描數(shù)百個 URL。如果把這些內(nèi)容一股腦塞給 LLM,不僅浪費 Token,還會導致模型“瞎選”答案。在每一次 DeepReSearch 漫長過程中,你可能會從搜索引擎結(jié)果頁(SERP)里收集一堆 URL,每打開一個網(wǎng)頁,又能順藤摸瓜找出不少新鏈接,就算是去重后,也是輕輕松松幾百個網(wǎng)址。同樣的,一股腦兒全塞給 LLM 肯定不行,浪費寶貴的上下文長度不說,更要命的是,我們發(fā)現(xiàn) LLM 基本上就是瞎選。所以,得想辦法引導 LLM 去挑出那些最有可能包含答案的 URL。

4.1.2 解決方案:兩階段重排序(Re-ranking)

URL 排序打分評測是 Deep Research 系統(tǒng)中的關鍵技術(shù)環(huán)節(jié),它直接影響到信息獲取的效率和質(zhì)量。系統(tǒng)采用了多層次、多維度的排序策略,確保能夠從海量的搜索結(jié)果中快速定位最有價值的信息源。

綜合評分機制是 URL 排序的核心。系統(tǒng)會綜合考慮多個因素:最后更新時間、域名出現(xiàn)的頻率、網(wǎng)頁路徑結(jié)構(gòu),以及最重要的與問題的語義相關性,算出一個綜合評分。這種多維度的評分機制能夠全面評估 URL 的價值,避免了單一維度排序的局限性。

具體的評分因素包括:

1.頻率信號:如果某個 URL 在不同的信息源中多次出現(xiàn),它的權(quán)重就會更高。另外,如果某個域名在搜索結(jié)果中經(jīng)常出現(xiàn),來自這個域名的 URL 也會被加分。因為一般來說,熱門域名往往包含更權(quán)威的內(nèi)容。

2.路徑結(jié)構(gòu):會分析 URL 的路徑結(jié)構(gòu),來判斷哪些內(nèi)容是聚集在一起的。如果多個網(wǎng)址都屬于同一個路徑層級,它們的分數(shù)會更高;但路徑越深,分數(shù)加成會逐漸減少。

3.語義相關性:使用 小模型(例如:jina-reranker-v2-base-multilingual)或者大模型 來評估問題和每個 URL 的文本信息(例如標題和摘要)的語義相關性,這是一個典型的重排序問題。每個 URL 的文本信息來自搜索引擎結(jié)果頁(SERP)API 返回的標題和摘要,以及頁面上 URL 的錨文本。

4.最后更新時間:有些查詢對時效性要求很高,所以一般來說,越新的 URL 價值越高。系統(tǒng)采用一套組合拳,綜合考慮 SERP API 提供的篩選功能、HTTP Header 信息分析、元數(shù)據(jù)提取、內(nèi)容模式識別等,最終給出一個帶有置信度評分的時間戳。

5.受限內(nèi)容識別:某些社交媒體平臺的內(nèi)容是受限的,或者需要付費才能訪問。系統(tǒng)會積極維護一份黑名單,把這些有問題的 URL 和域名都記錄下來,降低它們的排名,避免在這些無法訪問的內(nèi)容上浪費計算資源。

6.域名多樣性:為了提高結(jié)果的多樣性,避免陷入 "局部最優(yōu)",系統(tǒng)采用 "探索 - 利用" 的策略:從每個域名下選擇排名 Top K 的 URL。

粗排和精排:

?粗排: 快速篩選,追求召回率。

?精排: 針對粗排結(jié)果進行深度評估。這里通常采用基于重排模型(Cross-Encoder)或基于 LLM 的重排序。利用 LLM 的語義理解能力,甚至使用滑動窗口算法(從后向前滑動),對候選段落進行相關性打分,確保只有含金量最高的信息進入下一步。

粗排檢索效率較快,但是召回的內(nèi)容并不一定強相關。而精排效率較低,因此適合在粗排的基礎上進行進一步優(yōu)化。重排的任務就是評估這些上下文的相關性,優(yōu)先考慮那些最有可能提供準確和相關信息的內(nèi)容。

重排方法主要分為以下兩類:

基于重排模型:這些模型可以輸出文檔與查詢之間的相關性;夠針對一個查詢和文檔對,輸出它們的相似度分數(shù)。我們利用這個分數(shù)對文檔按照與查詢的相關性進行重新排序。解決傳統(tǒng)檢索方法(如BM25、向量檢索)的局限性,例如語義模糊性、長尾關鍵詞漏檢、多模態(tài)意圖理解不足等問題。優(yōu)化檢索結(jié)果的Top-K排序,提升后續(xù)LLM生成答案的準確性和效率

基于 LLM:由于大模型可以更全面地捕捉語義信息,也可被用于重排序。使用 Prompt 的方式引導 LLM 進行重排序。直接利用 LLM 的語義理解能力對所有候選段落進行相關性程度排名。如果文檔的數(shù)量通常非常大,而 LLM 可能無法一次性處理所有的文本數(shù)據(jù)。使用滑動窗口算法原理,滑順序是從后向前的,將前一個窗口中的前兩個段落參與下一個窗口的重排序。

4.2 解決“大海撈針”與“上下文丟失”:長網(wǎng)頁內(nèi)容提取

4.2.1 問題

讀取網(wǎng)頁內(nèi)容后,我們需要把它作為一條知識,放到 Agent 的上下文里,供它推理。雖然把全部內(nèi)容一股腦塞進 LLM 的上下文是最省事的辦法,但考慮到 Token 成本和生成速度,這肯定不是最好的選擇。在實際應用里,我們需要找出內(nèi)容中與問題最相關的部分,只把這些部分作為知識添加到 Agent 的上下文里。

我們一邊是問題(原始查詢或“信息差”問題),另一邊是大量的 Markdown 內(nèi)容,其中大部分內(nèi)容都是無關緊要的。我們需要選出與問題最相關的片段。

有限數(shù)量文檔中的有限數(shù)量的文本塊:假設每個塊大約有 500 個 Token,那么一個典型的長網(wǎng)頁文檔大約有 20 萬 Token(中位數(shù))到 100 萬 Token。我們每一步抓取 4-5 個 URL,這樣大概會產(chǎn)生幾百個文本塊。也就是說,幾百個向量和幾百個余弦相似度。在內(nèi)存里就能輕松處理,根本不需要向量數(shù)據(jù)庫。

我們需要連續(xù)的文本塊來形成有效的知識摘要:我們不能接受由分散的句子組成的摘要。更有用的知識摘要,更能保持文本的連貫性。這樣 LLM 更容易從知識源中復制和引用,也能減少“幻覺”。

網(wǎng)頁內(nèi)容動輒數(shù)萬 Token,且充滿噪音。如何提取有效信息且保持上下文連貫?

4.2.2 解決方案:遲分算法(Late Chunking)

傳統(tǒng)的 RAG 會直接把文檔切塊(Chunking)然后向量化,但這會導致切塊丟失全局上下文(例如一個代詞“它”在切塊后不知道指代誰)。

?Late Chunking(遲分):這是一個極其精妙的優(yōu)化。它不急著切塊,而是先用支持超長上下文的模型(如 jina-embeddings-v3)對整個文檔進行編碼,保留全局語義。

長文檔切塊,有倆個問題,第一個問題是:文本塊分割得準不準,這不僅關系到搜索結(jié)果好不好讀,還關系到做 RAG 的時候,給 LLM 喂進去的文本塊是不是正好,不多不少;第二個問題是:每個分塊里的上下文信息容易丟失。文檔切完之后,下一步就是把每個分塊拿去批量向量化。但這么做容易把原文檔里的全局上下文信息給丟了。

遲分(Late Chunking)主要就是解決第二個問題 —— 上下文丟失。它不是用來找最佳斷點或者語義邊界的。該用正則表達式,啟發(fā)式方法,或者其他技術(shù)來分塊,還是得用。

但遲分不一樣的地方是,它不是一切完就立馬把每個塊拿去向量化,而是先把整個文檔在一個上下文窗口里編碼了(jina-embeddings-v3最新 SOTA 向量模型,支持 8192 Token 的長輸入),然后再根據(jù)邊界線索去進行均值池化操作。

它的工作原理類似于一維卷積(Conv1D)。這個過程首先把一個長文檔分割成固定長度的塊,然后用開啟了遲分的 jina-embeddings-v3 向量化這些文本塊。計算完每個塊和問題之間的相似度分數(shù)后,一個滑動窗口會在這些相似度分數(shù)上移動,以找到平均值最高的窗口。

用遲分和類似“一維卷積”的平均池化,挑出跟問題最相關的段落。

?均值池化:在生成向量后,再根據(jù)邊界線索進行切分和均值池化。 這就像是先讀完一整本書理解了全意,再回過頭去摘錄段落,而不是每讀一段就摘錄一段。這樣提取出的“知識塊”既精準又保留了上下文,極大減少了 LLM 的幻覺。

4.3 解決“寫不長”:突破 Token 輸出限制

4.3.1 問題

上下文窗口的根本性限制:大部分模型,例如:DeepSeek-V3,單次輸出通常限制在 8K Token(約 8000 字)以內(nèi),難以一次性生成數(shù)萬字的詳盡報告。(可能有人會提出好多模型輸出幾萬字或者幾十萬字,例如GPT-5和Claude Opus等,但是又會出現(xiàn)下面"上下文腐爛" 現(xiàn)象的問題)。

"上下文腐爛" 現(xiàn)象:當智能體開始頻繁調(diào)用多次工具,每次調(diào)用返回的 "觀察結(jié)果" 都會追加到對話歷史中,導致上下文長度爆炸式增長。這不僅帶來高昂的計算成本,更會導致 "上下文腐爛" (Context Rot)—— 隨著上下文變長,模型性能反而下降。

具體表現(xiàn)為:

1.性能下降:隨著上下文長度增加,模型性能會明顯下降。Anthropic 把這個現(xiàn)象稱為 "上下文腐爛"(context rot)。具體表現(xiàn)是模型開始重復輸出、推理速度變慢、回答質(zhì)量下降。

2.注意力分散:Agent 的上下文隨時間推移必然熵增,導致注意力機制分散。

3.信息利用效率降低:研究發(fā)現(xiàn),當相關信息位于長輸入上下文的開頭或結(jié)尾時,模型的性能表現(xiàn)最佳,而當信息被放置在中間位置時,性能會顯著下降。此外,在長上下文任務中,模型有時會傾向于直接依賴其預訓練的參數(shù)知識來回答問題,而不是有效利用所提供的外部長文本,這進一步加劇了性能的下降。

4.3.2 解決方案:雙層級 Agent 架構(gòu)(Planner + Workers)

Deep Research 實際上采用了一種“規(guī)劃-執(zhí)行”的分離架構(gòu):

?規(guī)劃 Agent (Planner): 它是“包工頭”。負責理解任務,生成詳細的 JSON 格式大綱,并分配每個章節(jié)的字數(shù)預算。

?執(zhí)行 Agent 集群 (Workers): 它是“建筑工”。多個 Agent 并行工作,每個 Agent 認領一個章節(jié)的標題,獨立去搜索、閱讀和寫作。

?聚合器: 最后由一個模塊像拼積木一樣將各章節(jié)拼接,并進行邏輯順滑和長度控制。

雙層架構(gòu)的核心設計包括:

1.監(jiān)督者層級:作為系統(tǒng)的 "大腦",負責將模糊需求轉(zhuǎn)化為可執(zhí)行計劃。在 prompts.py 中定義的結(jié)構(gòu)化提示模板指導規(guī)劃器完成三項核心任務:需求澄清(通過 clarify_with_user 節(jié)點實現(xiàn))、子主題分解(最大支持 5 個并行子任務)、以及資源分配(根據(jù)主題復雜度選擇模型與工具)。

2.執(zhí)行者層級:負責具體的信息檢索、內(nèi)容提取和初步分析工作。執(zhí)行者層級包含多個專門的 Agent,如搜索 Agent、閱讀 Agent、分析 Agent 等,每個 Agent 負責特定的任務。

3.狀態(tài)機控制:基于 LangGraph 構(gòu)建的狀態(tài)機實現(xiàn)了復雜流程的精確控制。狀態(tài)機能夠跟蹤研究過程的每個步驟,確保任務執(zhí)行的有序性和完整性。

上下文管理的創(chuàng)新方案:

為了緩解上下文腐爛問題,系統(tǒng)采用了多種上下文管理策略:

1.上下文卸載技術(shù):系統(tǒng)采用 "上下文卸載"來緩解上下文污染,這能幫 agent 保持在正確軌道上。上下文卸載就是把信息存在語言模型的 "活躍上下文窗口" 之外。把關鍵信息卸載出去,只在需要時檢索,我們就避免了模型工作內(nèi)存的 "過載"。

2.分級存儲架構(gòu):在于引入分級存儲架構(gòu)。通過將信息按照重要性和使用頻率進行分級存儲,系統(tǒng)能夠在有限的上下文中保留最重要的信息,同時在需要時快速檢索其他信息。

3.智能剪枝策略:系統(tǒng)采用上下文剪枝技術(shù)。這個技巧是在 RAG 的基礎上做的優(yōu)化。它的核心是在將檢索到的信息交給主模型之前,先進行一次 "剪枝"。具體做法是:先檢索出相關文檔,然后使用一個更小、更快的模型,讓它讀一遍這些文檔,這個小模型的任務是,根據(jù)用戶的原始問題,只從文檔中提取最核心、最相關的信息。

長文檔處理的技術(shù)突破:

1.分段處理策略:系統(tǒng)將長文檔分成多個段落或章節(jié),每個部分獨立處理,然后通過監(jiān)督者層級進行整合。這種方法避免了一次性處理整個長文檔帶來的上下文限制問題。

2.增量生成機制:系統(tǒng)采用增量生成的方式處理長篇報告。監(jiān)督者層級負責制定整體結(jié)構(gòu)和各部分的生成順序,執(zhí)行者層級按照順序逐步生成各部分內(nèi)容。這種方式不僅避免了輸出長度限制,還提高了生成內(nèi)容的連貫性。

3.智能整合算法:在各部分內(nèi)容生成后,監(jiān)督者層級會對內(nèi)容進行智能整合。這包括檢查邏輯一致性、消除重復內(nèi)容、優(yōu)化章節(jié)順序等,確保最終報告的質(zhì)量。

4.4 生成內(nèi)容打分

Deep Research 在生成內(nèi)容的質(zhì)量控制方面采用了多層次、多維度的評分和優(yōu)化機制,確保最終輸出的內(nèi)容既準確又有價值。

自適應評估框架是內(nèi)容評分的基礎。包括兩個互補的評估框架來評估 DRA 能力:RACE(基于參考的自適應標準驅(qū)動評估框架,具有動態(tài)加權(quán))用于評估生成研究報告的質(zhì)量,F(xiàn)ACT(事實豐富性和引用可信度框架)用于評估信息檢索有效性和引用準確性。

RACE 框架的核心特點包括:

1.動態(tài)權(quán)重分配:對于每個任務,評判 LLM 通過多次試驗獲得每個維度的權(quán)重,并取平均值作為最終權(quán)重,確保評估與任務意圖一致。所有維度的生成標準被聚合到一個綜合列表中,評判 LLM 然后根據(jù)每個標準分析目標報告和參考報告,為兩份報告生成每個標準的分數(shù)列表,用于最終得分計算。

2.多維度評估:框架首先基于領域知識確立四個頂層評測維度:全面性(COMP)、洞察力 / 深度(DEPTH)、指令遵循(INST)和可讀性(READ)。對于每個具體任務,評判 LLM 會動態(tài)計算各維度的權(quán)重,并為每個維度生成一組定制化的評測標準。

3.自適應逐點質(zhì)量評估:評估模塊包含自適應逐點質(zhì)量評估和主動事實核查兩大核心組件,既解決了 "判分死板" 的問題,又實現(xiàn)了 "全面查錯" 的目標。自適應逐點質(zhì)量評估打破了固定維度的限制,為每個任務量身定制評分標準。該組件首先保留 4 個通用評估維度,同時針對每個具體任務自動生成 1-3 個專屬評估維度。

主動事實核查機制確保了內(nèi)容的準確性。系統(tǒng)不會只傻傻地檢查報告里標出來的引用來源,而是會像一個偵探一樣主動去網(wǎng)上搜索交叉驗證報告里的每一個說法,不管你有沒有給出處,這就保證了評分的絕對嚴格。

這種機制的實現(xiàn)包括:

1.自動識別關鍵陳述:系統(tǒng)會自動識別報告中的關鍵陳述和數(shù)據(jù),包括事實性描述、數(shù)值數(shù)據(jù)、因果關系等。

2.多源交叉驗證:對于每個關鍵陳述,系統(tǒng)會從多個獨立來源進行驗證,確保其準確性。

3.置信度評估:系統(tǒng)會為每個驗證結(jié)果給出置信度評分,高置信度的內(nèi)容會被保留,低置信度的內(nèi)容會被標記為需要進一步核實。

內(nèi)容修改與優(yōu)化策略:基于評分結(jié)果,系統(tǒng)會采用多種策略對內(nèi)容進行修改和優(yōu)化:

1.基于評分的自動修正:當系統(tǒng)發(fā)現(xiàn)內(nèi)容存在事實錯誤或邏輯問題時,會自動進行修正。這種修正不是簡單的替換,而是基于多個可靠來源的信息進行綜合判斷。

2.人工干預機制:對于復雜的問題或存在爭議的內(nèi)容,系統(tǒng)會提示用戶進行人工干預,確保最終內(nèi)容的準確性和客觀性。

3.風格一致性優(yōu)化:系統(tǒng)會檢查整篇報告的語言風格、術(shù)語使用、格式規(guī)范等,確保全文的一致性和專業(yè)性。

4.結(jié)構(gòu)優(yōu)化:根據(jù)內(nèi)容的邏輯關系,系統(tǒng)會對報告的結(jié)構(gòu)進行優(yōu)化,確保章節(jié)安排合理、層次分明。

5、 Deep Research vs Manus

Manus 更像是一個高度工程化的 Agent 平臺,它整合了大量工具(瀏覽器、代碼解釋器等),強在“調(diào)度”。而 Deep Research 是模型層面和架構(gòu)層面的進化,它通過強化學習或者架構(gòu)優(yōu)化讓模型了解“如何搜索”和“如何推理”的策略,是一種更原生和自主的智能。所以Deep Research可以進行撰寫文獻綜述、市場與競品分析、行業(yè)研報、投融資研報、市場調(diào)研、新聞熱點追蹤、生活決策等,也可以在檢索時沉淀有用信息。

6、總結(jié)

Deep Research是我在25年年中接觸的,當時感覺就很驚艷,感覺正在跨越到一個新的門檻:從信息的搬運工,變成了信息的加工者。它不再需要用戶費盡心思想 Prompt,也不需要用戶去點擊一個個的鏈接。它展示了 AI 作為一個“思考者”的潛力——它知道自己不知道什么,并且知道去哪里找到答案。對于使用者而言,這意味著我們可以將最耗時的“信息收集與整理”階段外包給 AI,從而專注于更高維度的決策與創(chuàng)新。

后面會繼續(xù)寫我怎么在真實業(yè)務中利用DeepResearch的能力,最后祝大家早安、午安、晚安。

審核編輯 黃宇

-

AI

+關注

關注

91文章

39768瀏覽量

301371 -

LLM

+關注

關注

1文章

346瀏覽量

1329

發(fā)布評論請先 登錄

2025年中科曙光DeepAI深算智能引擎完成全面進化

NXP TJA14xx評估板使用指南:從硬件到軟件的全面解析

應對極端低溫:Amphenol Deep Space 38999連接器解析

AI資訊:前DeepSeek研究員羅福莉已加入小米 英偉達一夜蒸發(fā)超萬億元

巴西研究團隊推進鈉離子電池電解質(zhì)計算研究

安富利推出基于英飛凌產(chǎn)品的智能座艙解決方案

工業(yè)電腦的進化從基礎控制到智能決策的跨越

聚徽智控——從嵌入式到邊緣計算:平板工控電腦的技術(shù)進化論

老文章新視角:從靜態(tài)測試到CI/CT生態(tài)的進化

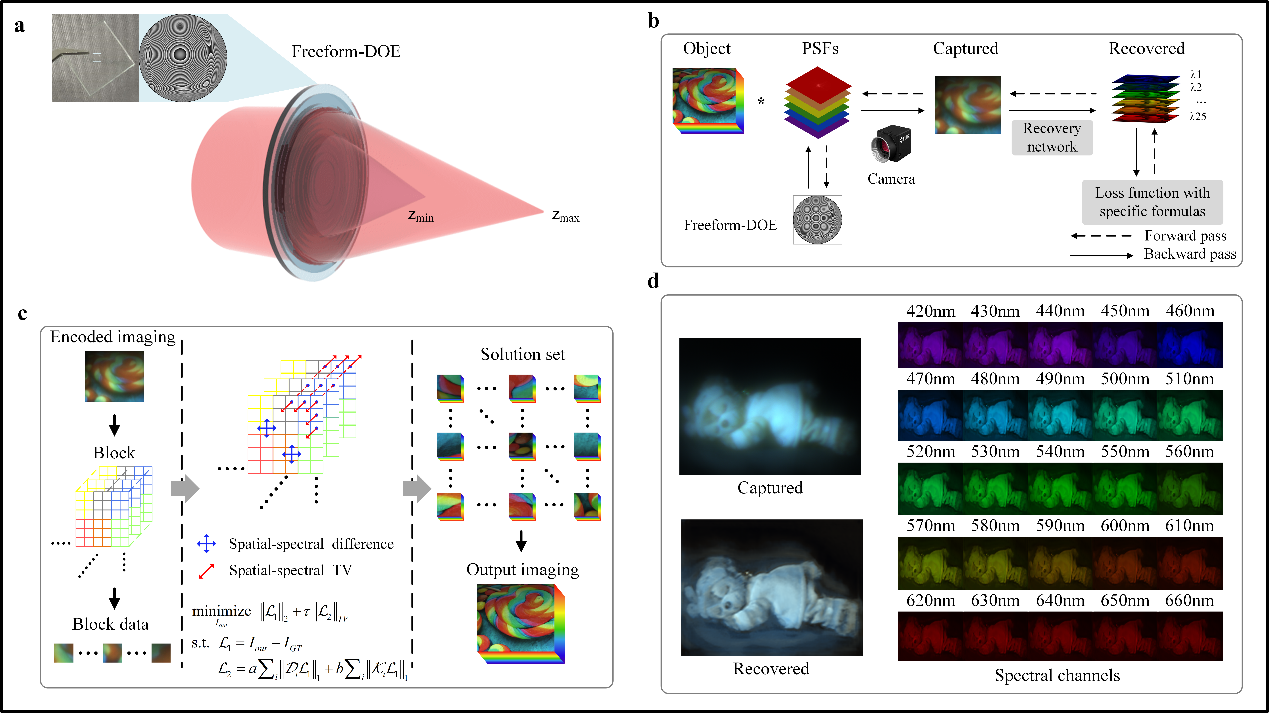

上海光機所在基于空-譜稀疏深度學習設計的自由曲面透鏡實現(xiàn)超景深高光譜成像研究方面取得進展

從“回答者”進化為“研究員”:全面解析 Deep Research

從“回答者”進化為“研究員”:全面解析 Deep Research

評論