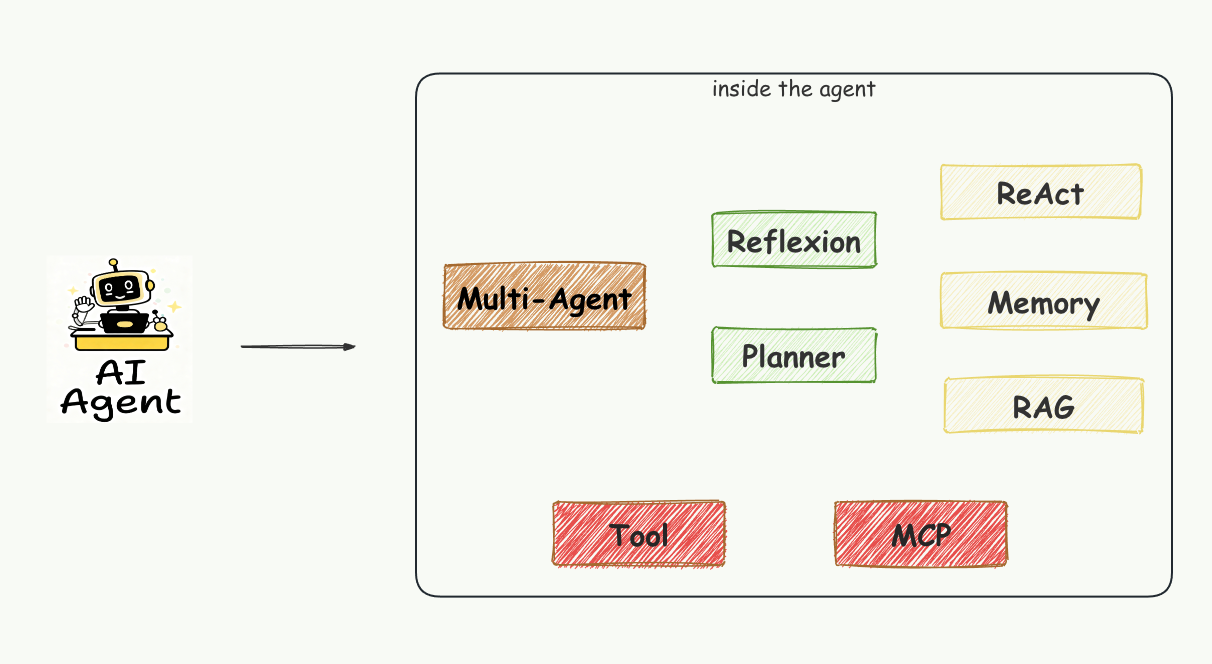

在 AI 智能體的世界中,速度、質(zhì)量和可靠性 不僅僅是特性,它們是必備條件。一個(gè)單一、順序執(zhí)行的智能體可能速度慢、容易出錯(cuò),并且解決問題的能力有限。解決方案是采用并行思維:設(shè)計(jì)一個(gè)系統(tǒng),讓多個(gè)智能體、流程或任務(wù)可以同時(shí)執(zhí)行,以實(shí)現(xiàn)共同的目標(biāo)。

大規(guī)模的智能體系統(tǒng)通常受到兩個(gè)主要因素的瓶頸:

- I/O 延遲:等待網(wǎng)絡(luò)、數(shù)據(jù)庫和外部 API 調(diào)用。

- 質(zhì)量與可靠性:單一的推理路徑可能導(dǎo)致次優(yōu)或錯(cuò)誤的輸出。

智能體并行化通過重疊等待時(shí)間、探索多種解決方案路徑和創(chuàng)建彈性、自校正系統(tǒng)來正面應(yīng)對(duì)這些挑戰(zhàn)。

核心能力1:并行工具使用

并行工具使用是構(gòu)建高性能、低延遲智能體系統(tǒng)的核心模式之一。它解決的主要問題是 I/O 延遲,這是大多數(shù)依賴外部服務(wù)的 AI 應(yīng)用的性能瓶頸。

該模式的核心在于允許 大型語言模型 (LLM) 在單次調(diào)用中識(shí)別并規(guī)劃多個(gè)獨(dú)立的工具調(diào)用,然后由執(zhí)行器同時(shí)啟動(dòng)這些調(diào)用。

- 傳統(tǒng)(順序)模式:LLM 規(guī)劃工具 A → 等待 A 執(zhí)行完畢 → LLM 規(guī)劃工具 B → 等待 B 執(zhí)行完畢。

- 并行模式:LLM 規(guī)劃 工具 A 和 工具 B → 同時(shí)執(zhí)行 A 和 B → 收集所有結(jié)果。

LLM 通過 工具綁定(Tool Binding) 機(jī)制,接收到所有可用工具的 Schema(即函數(shù)簽名和 Docstring)。當(dāng)用戶查詢(例如:“告訴我蘋果的股價(jià)和最近的新聞”)需要多個(gè)工具時(shí),LLM 會(huì)在一次 AIMessage 響應(yīng)中生成一個(gè)包含多個(gè) tool_calls 對(duì)象的列表。這是并行執(zhí)行的信號(hào)。

并行執(zhí)行帶來的性能提升主要體現(xiàn)在 I/O 耗時(shí)的重疊上。如果兩個(gè)工具調(diào)用都需要 3 秒的網(wǎng)絡(luò)等待時(shí)間,順序執(zhí)行的總耗時(shí)為 6 秒(忽略中間 LLM 的思考時(shí)間),而并行執(zhí)行的總耗時(shí)將接近 3 秒。

核心能力2:并行假設(shè)生成

并行假設(shè)生成(或稱“分支思維”)是一種高級(jí)的智能體并行模式,旨在通過探索多條推理路徑來提高 AI 系統(tǒng)的決策質(zhì)量、魯棒性和創(chuàng)造力。它將單一、線性的思維過程轉(zhuǎn)化為多維度、并發(fā)的戰(zhàn)略探索。

此模式的價(jià)值在于從執(zhí)行層面轉(zhuǎn)向戰(zhàn)略層面的優(yōu)化:

1. 策略探索:智能體首先充當(dāng)“規(guī)劃者”(Planner),根據(jù)初始問題生成 個(gè)不同的、獨(dú)立的潛在解決方案或視角(即假設(shè))。

2. 并行深化:個(gè)獨(dú)立的“工作者”(Worker)智能體同時(shí)被激活,每個(gè)工作者負(fù)責(zé)深化其中一個(gè)假設(shè),獨(dú)立生成一個(gè)完整的輸出(例如,基于某一營銷角度生成口號(hào))。

3. 收斂與優(yōu)化:所有并行結(jié)果被收集,然后由一個(gè)“裁判”(Judge)智能體進(jìn)行批判性評(píng)估和綜合,最終選出或合成最優(yōu)解。

核心能力3:并行評(píng)估與反思

并行評(píng)估與多批評(píng)家反思是一種高級(jí)智能體架構(gòu)模式,專注于在高風(fēng)險(xiǎn)、高標(biāo)準(zhǔn)的生產(chǎn)環(huán)境中實(shí)現(xiàn)穩(wěn)健、全面和高效的質(zhì)量保證(QA)和 AI 治理。

此模式的核心在于用一組專業(yè)化智能體取代單一、通用的評(píng)估器,并讓它們同時(shí)工作。

1. 專業(yè)化(Specialization):每個(gè)“批評(píng)家”(Critic Agent)都被賦予一個(gè)特定的專業(yè)領(lǐng)域和一套嚴(yán)格的評(píng)估標(biāo)準(zhǔn)。例如:

- 事實(shí)核查員(Fact-Checker):專注于驗(yàn)證內(nèi)容中陳述的客觀準(zhǔn)確性,可調(diào)用外部搜索工具。

- 品牌聲音分析師(Brand Voice Analyst):專注于評(píng)估內(nèi)容的語氣、風(fēng)格和對(duì)品牌指南的遵循情況。

- 風(fēng)險(xiǎn)評(píng)估員(Risk Assessor):專注于識(shí)別潛在的法律、倫理或聲譽(yù)風(fēng)險(xiǎn)。

2. 并行化 (Parallelism):通過 LangGraph 的 Fan-Out (分散) 機(jī)制,將同一份內(nèi)容同時(shí)發(fā)送給所有批評(píng)家。所有批評(píng)家同時(shí)獨(dú)立運(yùn)行,以墻鐘時(shí)間(Wall-Clock Time) 最長(zhǎng)的任務(wù)為準(zhǔn)完成評(píng)估階段。

3. 聚合與反思(Aggregation & Reflection): 最后,一個(gè)中心化的 總編輯(Chief Editor) 智能體接收所有批評(píng)家提供的結(jié)構(gòu)化反饋(通過 Pydantic 模型確保格式統(tǒng)一),進(jìn)行綜合判斷、制定最終決策,并輸出清晰的修訂指令。

核心能力4:推測(cè)性執(zhí)行與預(yù)取

推測(cè)性執(zhí)行與預(yù)取是一種旨在隱藏延遲 (Latency Hiding)、優(yōu)化用戶體驗(yàn)的高級(jí)并行模式。其核心目標(biāo)是讓 AI 智能體的交互感更加即時(shí)和主動(dòng),將系統(tǒng)的響應(yīng)性提升至超響應(yīng)級(jí)別。

該模式利用了智能體工作流中固有的時(shí)間差,通過提前行動(dòng)來抵消耗時(shí)的 I/O 操作。

1. 時(shí)序分析:典型的智能體工作流包含兩個(gè)連續(xù)的耗時(shí)階段:

- 思考 (Thinking):LLM 推理時(shí)間(例如 3-5 秒)。

- 行動(dòng) (Acting):工具調(diào)用(I/O 延遲,例如數(shù)據(jù)庫查詢 3 秒)。

- 順序總耗時(shí):思考時(shí)間 + 行動(dòng)時(shí)間。

2. 推測(cè)與并行:系統(tǒng)在接收到用戶輸入后,無需等待 LLM 完成推理,即可基于上下文(例如,在客服場(chǎng)景中是用戶 ID)推測(cè)智能體最可能需要的工具調(diào)用(例如,get_order_history(user_id))。

核心能力5:分層智能體團(tuán)隊(duì)

分層智能體團(tuán)隊(duì),即**“指揮官-工作者”(Orchestrator-Worker)** 模型,是構(gòu)建能夠處理復(fù)雜、多領(lǐng)域任務(wù)的可擴(kuò)展智能體系統(tǒng)的基石。它模仿了人類組織中管理層分解任務(wù)、專家團(tuán)隊(duì)并行執(zhí)行的模式,以同時(shí)優(yōu)化系統(tǒng)的質(zhì)量、準(zhǔn)確性和速度。

1. 指揮官 (Orchestrator):

職責(zé):接收復(fù)雜的初始請(qǐng)求(例如,“撰寫投資報(bào)告”)。其核心價(jià)值在于任務(wù)分解,即將復(fù)雜請(qǐng)求拆解為一組簡(jiǎn)單、清晰、可并行執(zhí)行的子任務(wù)(例如,"獲取財(cái)務(wù)數(shù)據(jù)" 和 "分析市場(chǎng)新聞")。

工具:通常不直接使用 I/O 工具,而是使用 Pydantic 結(jié)構(gòu)化輸出來定義和傳遞任務(wù)。

2. 工作者 (Worker):

職責(zé):每個(gè)工作者都是一個(gè)高度專業(yè)化的智能體,只負(fù)責(zé)一個(gè)子任務(wù)(例如,F(xiàn)inancial Analyst 只負(fù)責(zé)財(cái)務(wù)數(shù)據(jù))。它們被賦予專用的工具和聚焦的提示詞。

工具:直接使用 I/O 工具(如 yfinance 或 Tavily)高效執(zhí)行其專業(yè)任務(wù)。

3. 合成 (Synthesis):

工作者并行完成后,指揮官(或另一個(gè)專門的合成節(jié)點(diǎn))將所有結(jié)構(gòu)化結(jié)果匯集,并將其整合為一個(gè)連貫、統(tǒng)一的最終產(chǎn)品。

分層團(tuán)隊(duì)帶來的優(yōu)勢(shì)是復(fù)合的,尤其在質(zhì)量方面超越了單體智能體。單體智能體(Monolithic Agent)在面對(duì)多步驟任務(wù)時(shí),容易在工具調(diào)用、數(shù)據(jù)處理和最終合成之間產(chǎn)生認(rèn)知負(fù)荷,導(dǎo)致輸出質(zhì)量不穩(wěn)定。專業(yè)工作者(Specialist Worker)由于提示詞和工具的限制,任務(wù)焦點(diǎn)更集中,其輸出(如結(jié)構(gòu)化的 FinancialData)更準(zhǔn)確可靠。

核心能力6:競(jìng)爭(zhēng)性智能體集成

競(jìng)爭(zhēng)性智能體集成模式通過多樣化生成和裁判評(píng)估來解決復(fù)雜或高風(fēng)險(xiǎn)任務(wù)的魯棒性和質(zhì)量問題。它模仿了人類組織中的“競(jìng)爭(zhēng)設(shè)計(jì)”或“評(píng)審委員會(huì)”流程。

該模式旨在通過多樣性來克服單一 LLM 的固有偏差和局限性。

1. 多樣性(Diversity):團(tuán)隊(duì)由多個(gè)智能體組成,它們具有不同的模型(如 Llama 3 vs. Claude Sonnet)、視角(如創(chuàng)意 vs. 直率)或提示詞。這種差異確保了對(duì)同一問題產(chǎn)生多維度的解決方案。

2. 并行生成(Parallel Generation):利用 LangGraph 的 Fan-Out (分散) 機(jī)制,所有競(jìng)爭(zhēng)者同時(shí)獨(dú)立工作,生成各自的完整解決方案。

效率提升:如示例所示,串行執(zhí)行可能需要 19 秒以上,而并行執(zhí)行的總耗時(shí)僅為 7.33 秒(由最慢的 Agent 決定),大大提高了效率。

3. 裁判仲裁(Judge Arbitration):一個(gè)專門的裁判(Judge) 智能體接收所有并行輸出。裁判被賦予一個(gè)客觀的評(píng)估標(biāo)準(zhǔn)(如清晰度、創(chuàng)造力、影響力),并負(fù)責(zé):

批判 (Critique):對(duì)每個(gè)解決方案進(jìn)行詳細(xì)、公正的評(píng)估。

選擇 (Selection):選出最符合標(biāo)準(zhǔn)的最終贏家,并提供結(jié)構(gòu)化、可追溯的理由。

核心能力7:智能體流水線

智能體流水線(或稱高吞吐量管道化 Pipelining)是一種專注于最大化系統(tǒng)吞吐量的并行模式。它將復(fù)雜的任務(wù)處理流程分解為一系列連續(xù)、專業(yè)化的處理階段,使得不同階段的智能體可以同時(shí)處理不同的任務(wù)項(xiàng),從而實(shí)現(xiàn)高效的批量數(shù)據(jù)處理。

該模式模仿了現(xiàn)實(shí)世界中的工廠流水線,其中每個(gè)工作站都有一個(gè)特定、重復(fù)的任務(wù)。

1. 專業(yè)化(Specialization): 整個(gè)任務(wù)(例如,Review Processing)被分解為 個(gè)順序的、專業(yè)化的子任務(wù)(例如:Triage→Summarize→Extract Data)。每個(gè)智能體(工位)只負(fù)責(zé)一個(gè)階段,減少了其認(rèn)知負(fù)荷。

2. 管道化(Pipelining):一旦 Agent A 完成對(duì) Item 1 的工作,它立即將 Item 1 傳遞給 Agent B,并開始處理 Item 2。

在穩(wěn)定狀態(tài)下,所有工位 Agent A,B,C,… 都在并行工作,但它們分別處理 Item 1,Item 2,Item 3,…。

并行目標(biāo):不是縮短單個(gè)任務(wù)的**延遲 (Latency),而是最大化單位時(shí)間內(nèi)的吞吐量 (Throughput)**。

3. 批量并行(Intra-Node Parallelism): 在工業(yè)實(shí)現(xiàn)中,為了加速單個(gè)階段,每個(gè)節(jié)點(diǎn)內(nèi)部通常會(huì)使用 ThreadPoolExecutor 等工具來并行處理批次 (Batch) 中的所有任務(wù)項(xiàng)(例如,Triage 節(jié)點(diǎn)同時(shí)對(duì)所有 10 份評(píng)論進(jìn)行分類)。

核心能力8:分散式協(xié)作

分散式黑板協(xié)作是一種靈活、強(qiáng)大的多智能體架構(gòu)模式,它通過一個(gè)共享數(shù)據(jù)空間(黑板) 和一個(gè)中央路由器,實(shí)現(xiàn)了智能體之間的解耦(Decoupling) 和事件驅(qū)動(dòng)(Event-Driven) 的協(xié)作。該模式適用于解決方案路徑不確定或需要多方專家貢獻(xiàn)知識(shí)、共同構(gòu)建復(fù)雜解決方案的場(chǎng)景。

黑板系統(tǒng)的核心在于智能體之間不直接通信,而是通過修改和讀取共享的中央狀態(tài)來協(xié)作。

1. 黑板(The Blackboard):

在 LangGraph 中,黑板就是Graph State(例如 BlackboardState)。它存儲(chǔ)了問題的原始信息和所有智能體貢獻(xiàn)的中間成果(結(jié)構(gòu)化數(shù)據(jù))。

智能體通過寫入黑板來共享信息,通過讀取黑板來獲取所需的輸入。

2. 專業(yè)化知識(shí)源(Knowledge Sources):

每個(gè)智能體(例如 Analyzer、Retriever、Draftsman)都是一個(gè)獨(dú)立、專業(yè)的知識(shí)源,只關(guān)注黑板上的特定信息變化。

3. 中央路由器(The Central Router):

路由器是系統(tǒng)的決策大腦。它在每個(gè)步驟后檢查黑板的當(dāng)前狀態(tài),并根據(jù)“當(dāng)前需要什么信息”來機(jī)會(huì)主義地激活最相關(guān)的智能體。

例如: 如果黑板上有 analysis 但沒有 solution,路由器就激活 Retriever。

核心能力9:冗余執(zhí)行與容錯(cuò)

冗余執(zhí)行是一種高可靠性架構(gòu)模式,旨在通過并行運(yùn)行多個(gè)相同任務(wù)來消除單點(diǎn)故障和長(zhǎng)尾延遲的影響。其核心原則是,對(duì)于關(guān)鍵步驟,系統(tǒng)不依賴于任何單個(gè)實(shí)例,而是選擇最快且成功的結(jié)果。

該模式利用并行計(jì)算的優(yōu)勢(shì),將潛在的不可靠因素轉(zhuǎn)化為確定性的高成功率和低延遲。

1. 容錯(cuò)性(Fault Tolerance):

當(dāng)一個(gè)任務(wù)被并行提交給 N 個(gè)相同的智能體或工具實(shí)例時(shí),只要其中一個(gè)實(shí)例成功,整個(gè)任務(wù)就成功。

即使其中 N-1 個(gè)實(shí)例因網(wǎng)絡(luò)錯(cuò)誤、資源競(jìng)爭(zhēng)或其他隨機(jī)故障而失敗,只要剩下一個(gè)成功,系統(tǒng)即可繼續(xù)運(yùn)行。

示例: 簡(jiǎn)單 Agent 的 5 次嘗試中失敗了 2 次(40% 失敗率)。冗余 Agent 僅失敗了 1 次(20% 失敗率),在實(shí)際環(huán)境中,兩個(gè)獨(dú)立故障同時(shí)發(fā)生的概率極低,成功率會(huì)更高。

2. 延遲一致性(Latency Consistency):

長(zhǎng)尾延遲(Long-Tail Latency) 是指少數(shù)任務(wù)因網(wǎng)絡(luò)抖動(dòng)或服務(wù)過載而耗時(shí)過長(zhǎng)。

冗余執(zhí)行確保任務(wù)完成時(shí)間取決于最快完成的實(shí)例,而不是最慢的實(shí)例。

示例: 在嘗試 3 中,慢速實(shí)例耗時(shí) **≈6.78s**,導(dǎo)致簡(jiǎn)單 Agent 總耗時(shí) **≈11.99s**。但在 Redundant Agent 的嘗試 3 中,快速實(shí)例率先完成,總耗時(shí)僅 **≈6.25s**,成功隱藏了慢速實(shí)例的延遲。

核心能力10:RAG 并行查詢擴(kuò)展

并行查詢擴(kuò)展是一種預(yù)檢索(Pre-retrieval) 策略,用于解決 RAG 系統(tǒng)中最常見的故障模式之一:詞匯不匹配問題(Vocabulary Mismatch)。該模式通過利用 LLM 的生成能力,將用戶的原始查詢轉(zhuǎn)化為多個(gè)多樣化的搜索視角,從而最大限度地提高檢索召回率(Recall)。

該模式的核心在于不依賴用戶的單一、原始查詢,而是同時(shí)使用 LLM 生成的多種查詢類型進(jìn)行并行搜索。

1. 查詢轉(zhuǎn)換(Query Transformation):* 在一個(gè)結(jié)構(gòu)化輸出步驟中,LLM 根據(jù)用戶查詢生成以下多個(gè)搜索項(xiàng):

假設(shè)文檔 (HyDE - Hypothetical Document): 生成一個(gè)貌似真實(shí)的、直接回答問題的長(zhǎng)文本段落。由于向量嵌入基于語義相似性,搜索這個(gè)“假設(shè)答案”可以更好地匹配知識(shí)庫中真正答案的語義空間。

子問題 (Sub-Questions): 將一個(gè)復(fù)雜的、多方面的查詢分解成幾個(gè)更簡(jiǎn)單、更具體的問題。

關(guān)鍵詞與實(shí)體 (Keywords & Entities): 提取核心名詞和技術(shù)術(shù)語,用于精確的關(guān)鍵詞搜索(尤其適用于稀有實(shí)體)。

2. 并行檢索(Parallel Retrieval):

使用 ThreadPoolExecutor 等并發(fā)機(jī)制,同時(shí)將所有生成的查詢(HyDE、子問題、關(guān)鍵詞等)提交給向量檢索器。

召回率 (Recall) 提升:任何一個(gè)查詢命中了相關(guān)文檔,該文檔就會(huì)被收集。這種多重搜索機(jī)制確保了系統(tǒng)能從知識(shí)庫中找到所有相關(guān)的文檔。

3. 最終合成(Synthesis):* 將所有并行檢索到的(并去重后的)文檔集合提供給最后的生成智能體,從而產(chǎn)出更全面、準(zhǔn)確的答案。

核心能力11:RAG 分片與分散式檢索

分片與分散式檢索(Sharded & Scattered Retrieval)是一種關(guān)鍵的基礎(chǔ)設(shè)施模式,用于解決企業(yè)級(jí) RAG 系統(tǒng)中知識(shí)庫達(dá)到數(shù)百萬或數(shù)十億文檔時(shí)的低延遲和高可擴(kuò)展性挑戰(zhàn)。該模式通過將龐大的知識(shí)庫拆分為多個(gè)獨(dú)立、可并行檢索的子索引,來保證系統(tǒng)的性能和準(zhǔn)確性。

該模式將檢索系統(tǒng)的瓶頸——單一巨大索引的檢索延遲——轉(zhuǎn)化為多個(gè)小索引的并行檢索。

1. 知識(shí)庫分片(Sharding):

將一個(gè)巨大的單體(Monolithic) 向量存儲(chǔ)庫按邏輯維度(如主題、數(shù)據(jù)源、產(chǎn)品線、時(shí)間)分割成多個(gè)更小、更易于管理的**分片 (Shards)**。

優(yōu)勢(shì): 檢索延遲主要與索引大小相關(guān)。在小型索引上搜索總是比在大型索引上快得多。

2. 分散式查詢(Scattered Query):

當(dāng)用戶查詢到來時(shí),一個(gè)元檢索器 (Meta-Retriever) 或中央編排器將相同的查詢同時(shí)發(fā)送給所有分片進(jìn)行并行搜索。

3. 結(jié)果匯聚與重排序(Gather & Re-rank):

所有分片并行返回它們認(rèn)為最相關(guān)的文檔。

系統(tǒng)匯聚 (Gather) 這些結(jié)果,并執(zhí)行一個(gè)最終的重排序(Re-ranking) 步驟(本例中為去重),以確定全局最相關(guān)的文檔集合。

核心能力12:RAG 并行混合搜索融合

并行混合搜索融合是一種先進(jìn)的 RAG 檢索模式,旨在通過同時(shí)結(jié)合詞匯(Keyword)和語義(Vector)搜索的優(yōu)勢(shì)來最大化檢索的準(zhǔn)確性(Accuracy) 和精確性(Precision)。它解決了單一搜索方法在復(fù)雜、多樣化知識(shí)庫中普遍存在的盲點(diǎn)問題。

該模式通過在檢索階段的并行執(zhí)行,確保系統(tǒng)能找到所有類型的相關(guān)信息,無論用戶使用的是描述性語言還是精確的標(biāo)識(shí)符。

1. 語義搜索 (Semantic Search / Vector):

能力:捕捉查詢的概念和意圖。即使文檔和查詢使用的詞匯完全不同,只要它們含義相似,也能被找到。

優(yōu)勢(shì):適用于描述性問題,例如“我們公司在節(jié)能方面做了哪些努力?”(與文檔中的“綠色計(jì)算戰(zhàn)略”匹配)。

2. 詞匯搜索 (Lexical Search / Keyword):

能力:擅長(zhǎng)精確匹配查詢中的特定術(shù)語、數(shù)字、代碼和專有名詞。

優(yōu)勢(shì):適用于查找特定標(biāo)識(shí)符,例如“ERR_THROTTLE_900”或產(chǎn)品型號(hào)。

3. 并行與融合 (Parallel & Fusion):

并行執(zhí)行:兩種搜索方法同時(shí)獨(dú)立運(yùn)行,互不干擾,保證了效率。

結(jié)果融合:將兩種搜索方法找到的所有文檔匯集起來,進(jìn)行去重。最終的上下文集合既具有語義的廣度,又具備詞匯的精確度。

核心能力13:RAG 并行上下文預(yù)處理

并行上下文預(yù)處理是一種后檢索(Post-retrieval) RAG 模式,旨在解決高召回率檢索帶來的問題:將大量原始、嘈雜的文檔直接輸入給最終的生成 LLM 會(huì)導(dǎo)致成本高、延遲長(zhǎng),并易引發(fā) LLM 的**“迷失在中間”(Lost in the Middle)** 認(rèn)知偏差。

該模式的核心思想是:**先精煉,后合成 (Distill Before You Synthesize)**。

該模式在檢索和最終生成之間插入了一個(gè)關(guān)鍵的并行蒸餾(Parallel Distillation) 步驟,用于將大量的原始上下文(高召回)壓縮為少量但信息密集的精煉上下文(Distilled Context)。

1. 高召回檢索 (High Recall Retrieval):第一步是故意檢索一個(gè)大的文檔集(例如 或更高),以確保包含答案的文檔被找到。

2. 并行蒸餾 (Parallel Distillation):

相關(guān)性過濾 (Relevance Check):判斷文檔是否真正相關(guān)。

摘要提煉 (Summarization):將長(zhǎng)文檔壓縮成關(guān)鍵要點(diǎn)。

將原始文檔集分成多個(gè)子集(本例中是將每個(gè)文檔視為一個(gè)任務(wù))。

使用多個(gè)并行、輕量級(jí)的 LLM 調(diào)用,對(duì)每個(gè)子集執(zhí)行高度集中的任務(wù),如:

優(yōu)勢(shì):多個(gè)輕量級(jí) LLM 并行執(zhí)行,總耗時(shí)遠(yuǎn)小于用一個(gè) LLM 順序處理。

3. 最終生成 (Final Generation):只將精煉后的、高質(zhì)量的上下文(distilled_docs)傳遞給最終的生成 LLM。

核心能力14:并行多跳檢索

并行多跳檢索是一種高度復(fù)雜的 RAG 架構(gòu),它將 RAG 系統(tǒng)從簡(jiǎn)單的問答工具提升為具備多步驟推理和信息綜合能力的 AI 研究助理。該模式專為解決需要綜合多個(gè)非關(guān)聯(lián)事實(shí)才能回答的復(fù)雜、比較或多步問題而設(shè)計(jì)。

多跳檢索的流程完美模仿了人類專家面對(duì)復(fù)雜問題時(shí)的解決思路:分解、并行探索、最終綜合。

1. 問題分解(Decomposition / First Hop):

一個(gè)高級(jí)的元智能體(Meta-Agent) 首先分析復(fù)雜的原始查詢,并將其分解成 個(gè)簡(jiǎn)單、相互獨(dú)立的子問題。

結(jié)構(gòu)化輸出:LLM 被要求以結(jié)構(gòu)化的方式(例如 Pydantic 模型)輸出這些子問題列表。

2. 并行檢索與回答(Parallel Retrieval / Second Hop):

利用 ThreadPoolExecutor 等并發(fā)機(jī)制,為每個(gè)子問題啟動(dòng)一個(gè)獨(dú)立的 RAG 流程(Retrieval Agent)。

每個(gè) Retrieval Agent 專注于回答自己的簡(jiǎn)單子問題,進(jìn)行獨(dú)立的檢索(找到其所需的事實(shí) A、事實(shí) B 等)。

優(yōu)勢(shì): 確保即使單個(gè)檢索無法找到所有信息,并行檢索也能從知識(shí)庫的不同角落獲取所需的證據(jù)。

3. 最終綜合(Synthesis / Final Hop):

元智能體收集所有子問題得到的答案,而不是原始文檔。

它使用這些高質(zhì)量的、已回答的子問題作為上下文,執(zhí)行一個(gè)最終的推理和綜合步驟,生成對(duì)原始復(fù)雜查詢的全面、有洞察力的回答。

原文鏈接:https://github.com/FareedKhan-dev/agentic-parallelism

文章來源:Coggle數(shù)據(jù)科學(xué)

-

AI

+關(guān)注

關(guān)注

91文章

40578瀏覽量

302172 -

智能體

+關(guān)注

關(guān)注

1文章

526瀏覽量

11631 -

復(fù)雜系統(tǒng)

+關(guān)注

關(guān)注

0文章

9瀏覽量

7065

發(fā)布評(píng)論請(qǐng)先 登錄

【2025夏季班正課】大模型Agent智能體開發(fā)實(shí)戰(zhàn) 課分享

尋找對(duì)RISCV眾核并行計(jì)算感興趣的伙伴、朋友

尋找對(duì)RISCV眾核并行計(jì)算感興趣的伙伴

小藝開放平臺(tái)鴻蒙智能體開發(fā)智能體配置-基礎(chǔ)信息

小藝開放平臺(tái)平臺(tái)功能

多控制模式的智能家居系統(tǒng)設(shè)計(jì)

一文說透了如何實(shí)現(xiàn)單片機(jī)的多任務(wù)并發(fā)!

多智能體設(shè)計(jì)模式和智能體框架,你會(huì)了么?

Swift 的并發(fā)系統(tǒng)并行運(yùn)行多個(gè)任務(wù)

如何有效管理和部署的AI智能體

AI智能體管理系統(tǒng)構(gòu)建企業(yè)級(jí)應(yīng)用的管理框架

百度發(fā)布全球首個(gè)全端通用智能體GenFlow 2.0

鴻蒙5開發(fā)寶藏案例分享---應(yīng)用并發(fā)設(shè)計(jì)

什么是AI智能體

并行智能體:洞察復(fù)雜系統(tǒng)的 14 種并發(fā)設(shè)計(jì)模式

并行智能體:洞察復(fù)雜系統(tǒng)的 14 種并發(fā)設(shè)計(jì)模式

評(píng)論