雖然5G已深刻改變世界,并兌現了高速率、低延遲、高密度連接的承諾,但也伴隨著一項隱性代價:不容忽視的能耗成本。據愛立信預測,到本十年末,5G用戶數量將達到67億。然而,盡管5G的數據傳輸效率遠超4G網絡,但由于承載的數據量更大,5G的能耗將比傳統網絡高出4至5倍。

這一挑戰的核心在于無線接入網(RAN)的功耗。RAN網絡消耗了絕大部分電力,尤其是在功率放大器(PA)環節。為了在能效比與信號失真、更寬工作帶寬及更快速信號變化之間尋求平衡,RAN開發者如今對靈活性、智能化和實時優化提出了更高要求。簡而言之,RAN設備需要具備更強的適應性。

面對5G系統在適應性與能效方面的新壓力,技術人員已將目光投向快速發展的人工智能(AI),探索AI有望帶來的新能力。除了備受關注的大語言模型,AI在真實的本地決策領域也正涌現新機遇,能夠借助AI的分析優勢,實時應對各類復雜應用場景。無線通信領域的技術人員已著手研究如何運用AI的能力來優化RAN功耗,并從中看到了機遇。

對于移動運營商而言,推動AI融合的舉措可謂恰逢其時。事實上,麥肯錫的研究發現,能耗對運營商凈利潤的影響比銷售額增長高出50%。與此同時,Verizon、T-Mobile、Bharti Airtel等眾多通信運營商均已承諾在2050年前實現凈零排放目標。

在5G時代,網絡能效問題愈發嚴峻。盡管4G網絡的能耗成本已占網絡總擁有成本的20%至25%,但向5G的過渡大大加劇了這一壓力。在某些場景下,高性能5G部署(尤其是疊加在傳統2G、3G和4G基礎設施之上時)可能導致能源需求增幅高達140%。

引發5G時代功耗上升的三大因素

大規模MIMO

相較于當前的2×2或4×4 MIMO配置,5G大規模MIMO (M-MIMO)基站“信號塔”規模更大、性能更強,最大支持64×64配置(規模較傳統方案高16倍),能耗也顯著增加。例如,一座5G基站的耗電量是4G基站的3倍。

基站數量增多

進入5G時代,城市區域需通過新增宏基站與小型基站實現網絡密集化,這將進一步推高總能耗。

移動數據流量增長

結合“比特驅動瓦特”的理念,不難發現:即便5G在單位比特能效比上表現更出色,但受移動數據流量高達50%的增長幅度影響,整體網絡的功耗仍會隨之攀升。

運營商能源使用情況資料來源:全球移動通信系統協會(GSMA)

5G的能源挑戰

5G能耗問題的核心在于一種微妙的權衡:功率放大器(PA)在接近滿負荷運行時能效最高,但這種運行模式會導致信號失真,進而引發合規問題并降低性能。為規避此類風險,大多數PA會采用回退模式,以犧牲能效為代價來維持信號保真度。

“記憶效應”進一步加劇了PA的非線性問題。PA包含一些響應速度較慢的元件,它們會“記住”先前的輸入信號,導致PA的非線性程度取決于流經自身的過往信號。

數字預失真(DPD)技術可解決此類問題。DPD的工作機制是:預先對信號進行失真處理,且失真方向與PA通常產生的失真方向相反。這類似于裁縫縫制衣物時會預留額外尺寸,因為知道衣物洗滌后會縮水;DPD則會預先調整信號,使得信號流經PA時,兩種失真能夠相互抵消,從而保證傳輸的信號清晰且準確。

未來的演進方向十分明確:借助AI實現更智能的DPD。當前的DPD解決方案依賴于一種基于數學模型的方法,即基于沃爾泰拉的線性化,用于對PA的特性進行建模。在5G傳輸場景中,這類模型的復雜度會呈指數級增長,進而需要更多的計算資源和存儲資源,導致芯片面積和能耗大幅增加,最終削弱DPD帶來的能效收益和應用價值。

新范式:基于機器學習的數字預失真

如今,新興技術開始借助機器學習(ML)取代傳統DPD中固定的數學模型。工程師無需手動調整信號校正算法,而是可以利用經真實波形數據訓練的神經網絡,對PA的非線性特性進行動態建模與實時校正。這些模型可通過反向傳播算法優化,并直接映射到現有硬件結構中。

基于機器學習的數字預失真(ML-DPD)應運而生。ML-DPD的優勢具有深刻影響:優化時間可從數天縮短至數小時;在各類信號條件下,模型性能均有所提升;節能不再停留在理論層面,而是具備了實際意義。最重要的是,這類解決方案具備自適應能力,能夠從實時工況中學習,并隨硬件與環境的變化而動態調整。

中期數字預失真(MT-DPD)

盡管當前的DPD技術已具備一定效果,但不斷發展的蜂窩通信需求正不斷挑戰DPD的性能邊界。為實現更大數據量、更快速度的傳輸,功率放大器(PA)必須在更寬的帶寬范圍內工作,而這會導致信號快速變化。這種快速變化可能引發電氣不穩定和信號失真,存在超出美國聯邦通信委員會(FCC)發射限值的風險。

為解決這一問題,研究人員開發了一種基于神經網絡的新模型,能更好地理解并應對信號的動態變化。通過將這種模型與在系統采樣率下運行的基于沃爾泰拉的DPD模型相結合,中期數字預失真(MT-DPD)技術得以誕生。這種技術專門針對持續時間在100納秒至10微秒之間的信號記憶效應所導致的失真。早期測試表明,這種技術能顯著降低失真程度。展望未來,研究重點可能會轉向解決電荷俘獲問題,這是氮化鎵(GaN)器件面臨的另一大性能障礙。

長期解決方案

如今,PA面臨的挑戰不僅限于靜態失真。5G中的動態流量加劇了長期記憶效應,尤其是基于GaN的高效率PA中因電荷俘獲導致的問題。AI驅動的方法同樣能夠對這些特性進行建模,將DPD的能力擴展到新領域。

分層神經網絡如今能夠同時校正和適應由即時非線性、快速變化的瞬態和緩慢漂移效應導致的失真。由此打造出一套統一的系統,能夠在實際場景中提供高信號保真度,同時保持高水平的PA效率。

ML-DPD:移動運營商的高能效未來

ML-DPD解決了行業的一項實際需求:提升基站能效。這對移動運營商而言至關重要,他們在5G基礎設施上投入巨大,必須通過降低成本來提升競爭力。在保持合規的同時以最優容量傳輸信號,是一項重要優勢,讓我們得以享受高速的移動互聯網體驗。

信號優化已不再僅僅是工程層面的考量,更成為業務層面的一項必然要求。ML-DPD為控制5G能耗提供了一條可行路徑。

-

數字預失真

+關注

關注

3文章

26瀏覽量

13833 -

5G

+關注

關注

1366文章

49032瀏覽量

588910

原文標題:借助邊緣側AI與數字預失真提升5G能效

文章出處:【微信號:analog_devices,微信公眾號:analog_devices】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

5G RedCap加速邊緣AI革命:智能穿戴與AI眼鏡迎來“直連云端”新時代

AI賦能6G與衛星通信:開啟智能天網新時代

5G與6G:從“萬物互聯“到“智能無界“的跨越

愛立信展示AI賦能5G的創新成果

【下載】5G/6G 公開資料整理|AI/ML、NTN、ISAC 等方向(持續更新)

首創開源架構,天璣AI開發套件讓端側AI模型接入得心應手

5G網絡中,信令測試儀如何幫助提升用戶體驗?

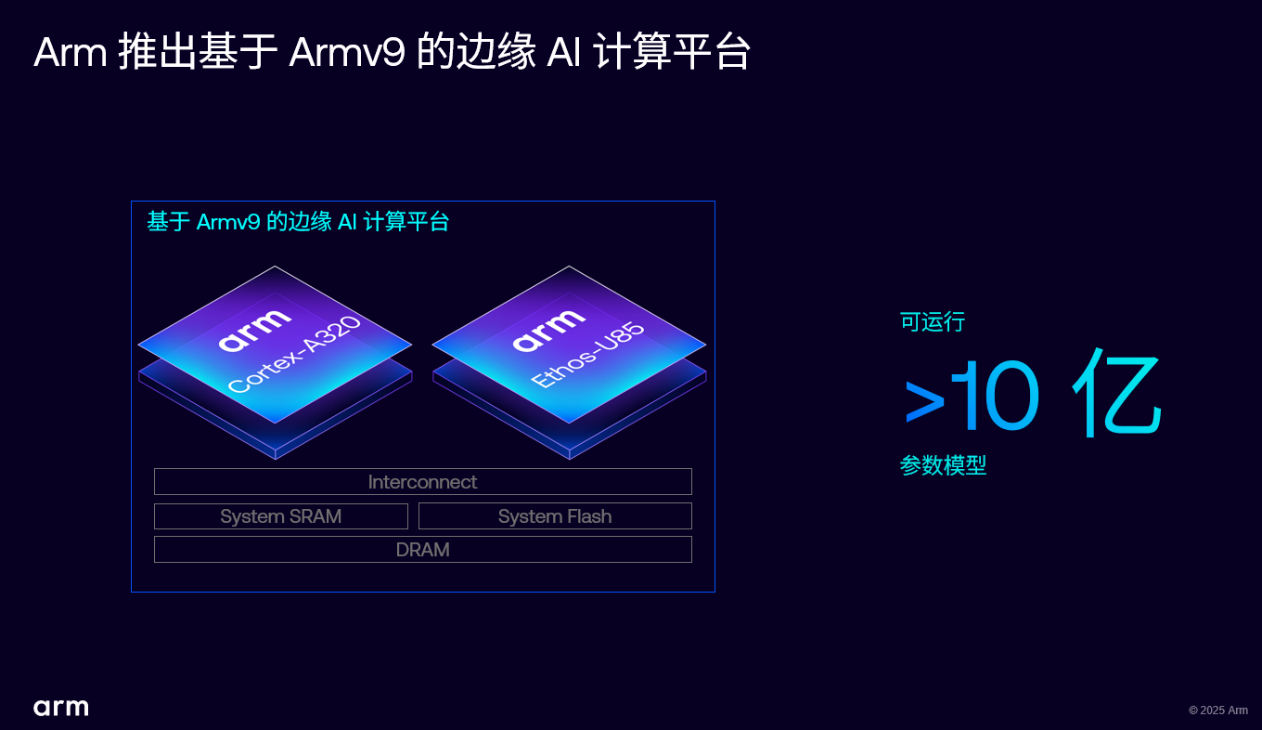

Arm 推出 Armv9 邊緣 AI 計算平臺,以超高能效與先進 AI 能力賦能物聯網革新

借助邊緣側AI與數字預失真提升5G能效

借助邊緣側AI與數字預失真提升5G能效

評論