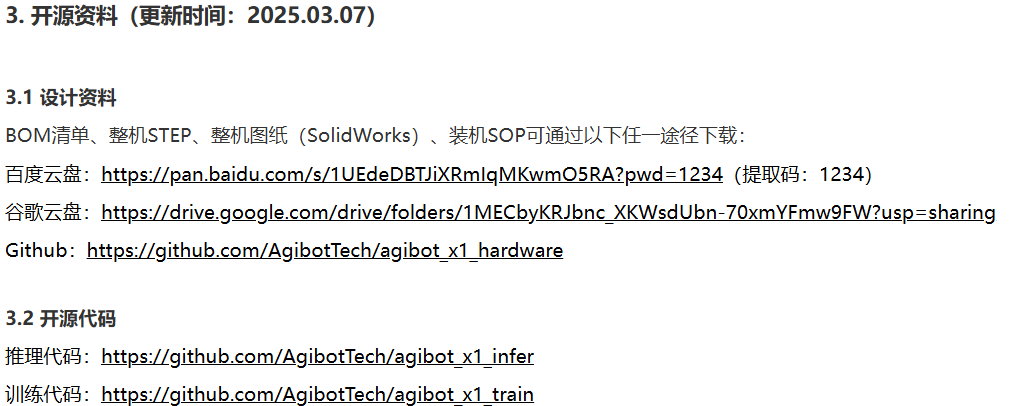

一、開源代碼

一、開源代碼路徑:https://www.zhiyuan-robot.com/DOCS/OS/X1-PDG

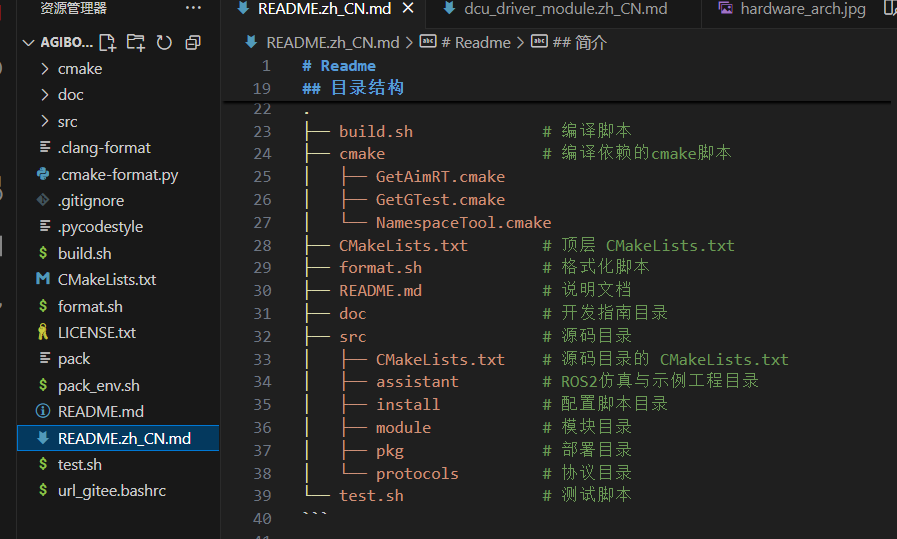

源碼結構:

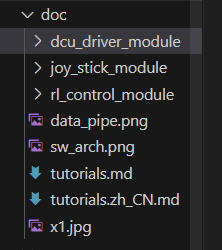

具體的操作步驟就在這個文件說明里README.zh_CN.md,根目錄下doc文件夾有各模塊說明文檔

官方資料:dcu_driver_module:驅動控制單元模塊,負責機器人底層硬件(如關節、電機等)的驅動與控制,處理硬件的指令交互、狀態反饋。joy_stick_module:操縱桿控制模塊,用于通過手柄等外設對機器人進行手動操控,將手柄輸入轉換為機器人的動作指令。rl_control_module:強化學習控制模塊(“rl” 為 Reinforcement Learning 縮寫),基于強化學習算法,讓機器人通過 “試錯 - 學習” 自主優化控制策略。

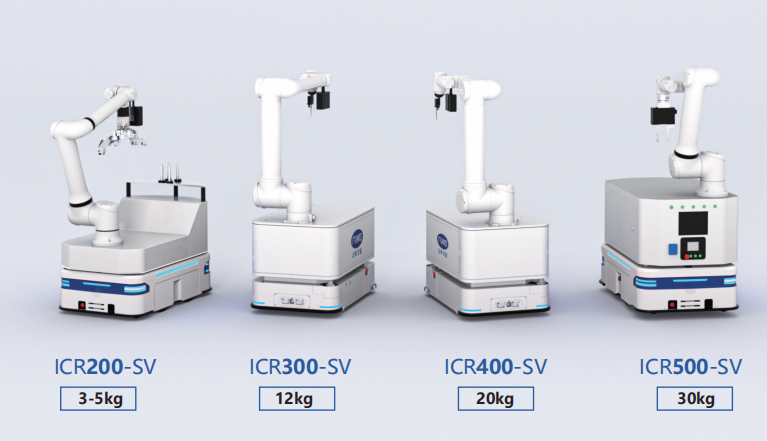

從事具身智能研發,需要掌握“底層硬件交互+中層感知控制+上層智能決策”的全鏈路技術能力,這些技術基礎相互支撐,最終實現機器人在物理世界中“感知環境、規劃動作、完成任務”的核心目標。以下從6個核心維度,拆解具身智能必備的技術基礎,結合靈犀X1具體說明:

二、機器人硬件與嵌入式基礎:解決“物理載體”問題

具身智能的核心是“有身體的智能”,必須先理解機器人的硬件構成與底層驅動邏輯,否則無法實現“智能”到“動作”的落地。

?核心內容:

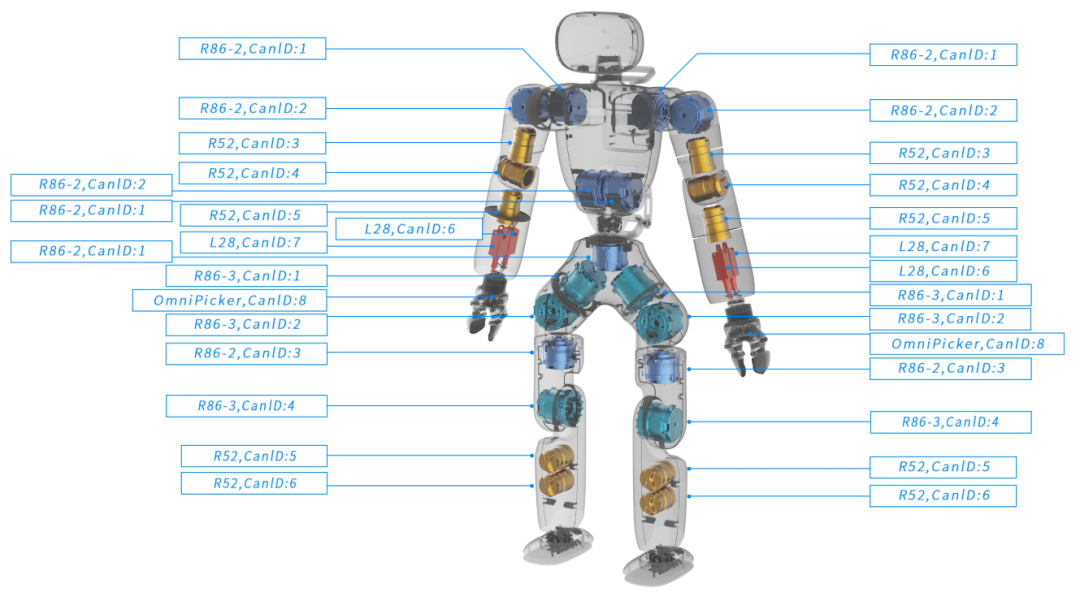

a.機器人硬件架構:理解機械結構(如靈犀X1的關節、軀干自由度)、執行器(電機、舵機)、傳感器(攝像頭、激光雷達、IMU慣性測量單元)的原理與選型;

b.嵌入式開發:掌握嵌入式芯片(如STM32、NVIDIA Jetson系列)的編程,能編寫驅動程序(對應靈犀X1開源代碼中的dcu_driver_module),實現“上層指令→底層硬件動作”的轉化;

c.硬件調試:能排查傳感器數據異常、電機卡頓等問題,比如校準IMU的姿態誤差,確保機器人運動精度。

三、感知技術:解決“看懂世界”問題

具身智能需要通過傳感器“感知環境”,才能做出合理決策——比如機器人要先識別“桌子上的杯子”,再規劃“拿起杯子”的動作。

?核心內容:

a.計算機視覺(CV):

基礎任務:目標檢測(如用YOLO識別物體)、語義分割(區分“桌子”“杯子”等不同類別)、深度估計(用雙目相機/ DepthAI獲取物體距離,對應靈犀X1的視覺模塊);

工具與框架:熟練使用OpenCV(圖像處理)、PyTorch/TensorFlow(訓練視覺模型)、PCL(點云處理,適配激光雷達數據);

a.多傳感器融合:

由于單一傳感器有局限(如攝像頭怕遮擋、激光雷達怕強光),需要用算法融合多源數據——比如用卡爾曼濾波、粒子濾波,將IMU的姿態數據與視覺的位置數據結合,提升機器人的定位精度。

四、控制與運動規劃:解決“精準動作”問題

感知到環境后,機器人需要“規劃運動路徑+控制關節動作”,比如靈犀X1要從“站立”到“彎腰撿東西”,需計算每個關節的轉動角度與速度。

?核心內容:

a.運動學與動力學:

運動學:計算機器人“關節角度→末端位置”(正運動學)、“末端目標位置→關節角度”(逆運動學,是機械臂/人形機器人動作控制的核心);

動力學:考慮重力、摩擦力等物理力的影響,用牛頓-歐拉方程、拉格朗日方程建模,避免機器人運動時“關節用力過猛”或“晃動”;

a.運動規劃算法:

路徑規劃:在復雜環境中找“無碰撞路徑”,如A*、RRT *算法(比如靈犀X1避開障礙物走到桌子前);

軌跡優化:將路徑轉化為平滑的關節運動軌跡(如用三次樣條插值),避免關節急剎急轉;

a.控制算法:

基礎控制:PID控制(最常用,比如控制電機轉速穩定在目標值);

進階控制:針對非線性場景(如機器人負載變化),用自適應控制、滑模控制,甚至結合強化學習的“智能控制”(對應靈犀X1的rl_control_module)。

五、人工智能(AI)與機器學習:解決“自主決策”問題

具身智能的“智能”核心來自AI——不僅能完成預設動作,還能通過學習優化策略(比如“多次拿杯子后,逐漸減少手抖”)。

?核心內容:

a.強化學習(RL):

核心邏輯:讓機器人在“試錯”中學習(比如拿杯子沒拿穩→懲罰,拿穩→獎勵),常用算法如DQN(離散動作)、PPO(連續動作,適合機器人關節控制)、TD3(解決探索與利用平衡);

場景適配:在靈犀X1上,可通過RL訓練“開門”“倒水”等復雜任務,對應開源代碼中的rl_control_module;

a.模仿學習(IL):

當強化學習“試錯成本高”時(比如機器人怕摔),讓機器人模仿人類操作(如人類示教“拿杯子”動作),常用算法如行為克隆(BC)、逆強化學習(IRL);

a.大模型與具身結合:

用大語言模型(LLM)做“任務規劃”:比如輸入自然語言指令“給我倒一杯水”,LLM拆解為“走到桌子前→拿起杯子→打開水龍頭→接水→遞給我”的步驟;

用視覺-語言模型(VLM,如GPT-4V、SAM)做“多模態理解”:讓機器人結合圖像(看到杯子)和文字(“杯子”指令),精準定位目標。

六、軟件工具鏈:解決“高效開發”問題

具身智能開發依賴成熟的工具鏈,尤其是機器人操作系統(ROS),能大幅降低“硬件適配+算法集成”的難度。

?核心內容:

a.機器人操作系統(ROS/ROS2):

核心能力:節點通信(如“感知節點”向“控制節點”發送物體位置)、話題/服務機制(標準化數據交互)、功能包復用(如用MoveIt!做運動規劃,直接適配靈犀X1的機械結構);

實戰場景:在ROS中集成joy_stick_module(操縱桿控制)、dcu_driver_module(驅動),實現“手柄操控機器人移動”的基礎功能;

a.編程與開發環境:

語言:C++(底層驅動、高性能控制)、Python(算法原型、數據分析);

系統:Linux(ROS、嵌入式開發的主流環境);

仿真工具:Gazebo、Webots(在虛擬環境中測試算法,比如先在Gazebo中訓練“拿杯子”,再部署到靈犀X1實物,降低損壞風險);

a.開源項目復用:

比如基于靈犀X1的開源代碼(https://www.zhiyuan-robot.com/DOCS/OS/X1-PDG),直接復用驅動模塊和控制框架,聚焦上層AI算法開發。

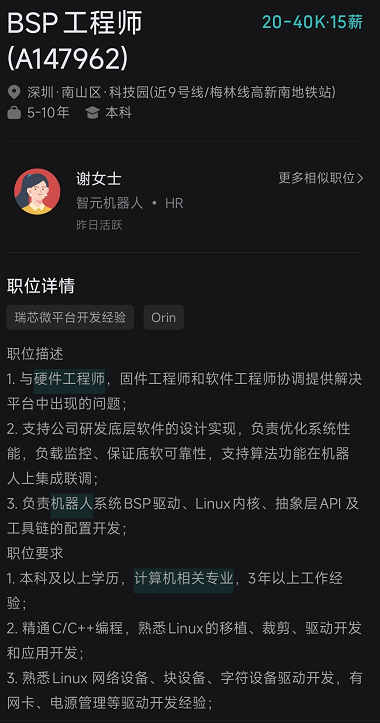

七、行業待遇:

看boss上的招聘信息,行業待遇也還行,兄弟們,上車吧。

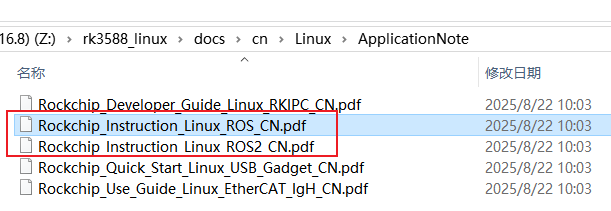

八、補充rk平臺資料

-

智元機器人

+關注

關注

1文章

33瀏覽量

1661 -

具身智能

+關注

關注

0文章

429瀏覽量

880

發布評論請先 登錄

解剖智元機器人(靈犀X1),入局具身智能

解剖智元機器人(靈犀X1),入局具身智能

評論