一、引言

在自動駕駛技術飛速發展的當下,高精度、高保真的仿真場景構建成為關鍵。3D Gaussian Splatting(3DGS)憑借高效渲染與逼真場景還原能力,逐漸成為三維重建與仿真領域的焦點。然而,實際應用中,如何將多源異構數據高效轉化為可用的 3DGS 場景,如何保障場景與真實環境的一致性,成為了行業難題。

針對3DGS 落地自動駕駛仿真的核心痛點,aiSim打造從原始數據標準化到高保真仿真驗證的全流程方案:用aiData 工具鏈讓多源數據有序協同;借算法組合保障場景高度逼真;以 GGSR 渲染器實現“高效 + 真實”渲染閉環;并能自由配置暴雨、夜晚等環境,模擬多模態傳感器,疊加虛擬交通流,覆蓋自動駕駛極端測試工況。

二、3DGS 底層技術剖析

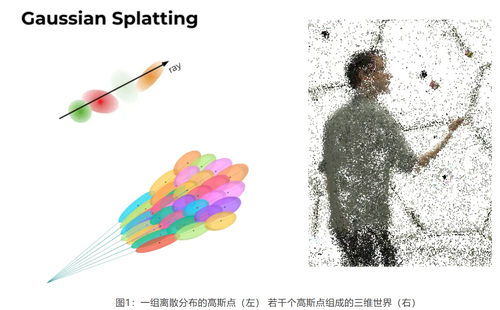

3DGS 是一種基于3D 高斯分布的三維場景表示方法,其核心在于將場景中的對象轉化為多個 3D 高斯點,每個高斯點就像一個攜帶豐富信息的 “數據膠囊”,囊括了位置、協方差矩陣和不透明度等關鍵信息 ,以此勾勒復雜場景的幾何輪廓與光照特性。

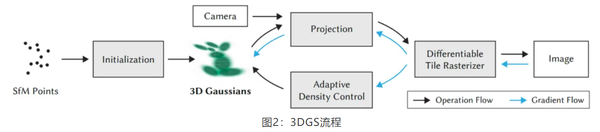

從構建流程來看,3DGS 首先借助SfM(Structure from Motion)技術開啟數據預處理征程。該技術通過對多視角圖像的分析,校準相機位置并精準恢復其內部和外部參數,進而生成稀疏點云,為后續的場景構建搭建起基礎框架。基于這些稀疏點云,一組 3D 高斯點被初始化,每個高斯點的位置、協方差矩陣和不透明度等初始值得以設定。

在訓練階段,3DGS 不斷對高斯點的位置、形狀和不透明度進行精細調校。3DGS 創新性地采用自適應密度控制策略,在每次反向傳播后,去除那些對場景表達貢獻較小的不重要高斯點,并依據場景細節的需求對高斯點進行分裂或克隆操作。

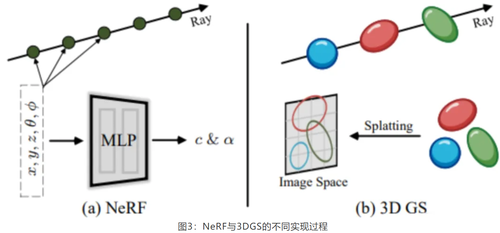

對比傳統的神經輻射場(NeRF)方法,3DGS 凸顯優勢。NeRF 雖能構建出具有高度真實感的連續、立體場景,實現空間坐標到圖像色彩及密度的直接映射,但計算強度極高,單一場景構建往往需要投入大量的算力資源與時間成本,尤其是在追求高分辨率輸出時,這一問題更為突出。

此外,NeRF 的可編輯性較差,單一場景的任何編輯都意味著要重新訓練整個流程。而 3DGS 通過顯式建模方法,巧妙避開了傳統神經網絡訓練中繁重的計算開銷,訓練速度大幅提升,渲染效率更高。同時,3D 高斯點能夠捕捉場景中的每一處細節,實現高精度的三維重建,并且支持實時渲染。

然而,3DGS 并非十全十美。在面對極為復雜的三維場景時,為了精準還原每一處細節,可能需要海量的高斯點,這無疑會顯著增加計算負擔與內存消耗。并且,當前 3DGS 的應用主要集中于靜態場景的重建,如何高效且精準地處理動態場景中的物體變化,使其能夠實時、準確地反映動態物體的位置、形狀及運動軌跡等信息,仍然是擺在科研人員與工程師面前的一道技術難題。

三、基于 aiSim 的 3DGS 方案全流程

1、原始數據輸入與標準化

以多源傳感器采集為起點,通過相機、激光雷達、自車運動傳感器捕獲真實道路的圖像、點云、位姿數據。針對這些數據格式、精度、時間戳異構的問題,aiData 工具鏈通過標準化算法將第三方數據轉換為統一格式,從而確保點云、圖像、標定信息協同工作,確保后續處理工作正確運行。

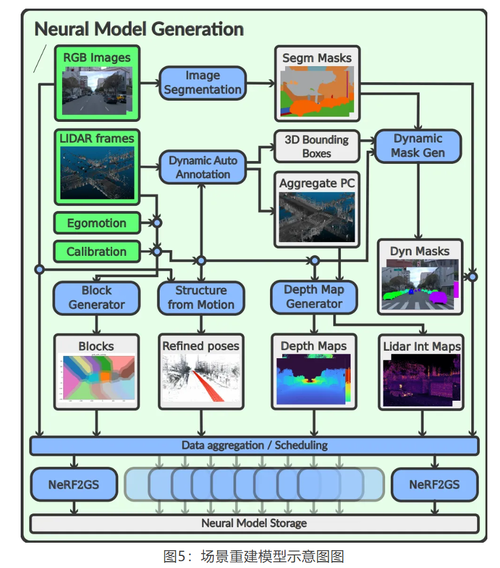

2、3D 場景預處理

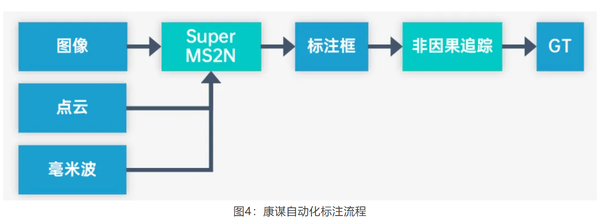

(1)3D 自動標注:在 aiData 工具鏈里,3D 自動標注依托多模態數據與算法流程實現。圖像、點云、毫米波作為多維度輸入,經核心算法模塊 Super MS2N 整合各模態特征,精準識別 3D 目標并生成標注框,明確目標邊界與類別,接著借 “非因果追蹤” 模塊跨幀關聯、優化軌跡,修正標注誤差,最終輸出高精度 GT 數據,為 3DGS 場景賦予準確語義關聯。

(2)2D 語義分割:針對圖像數據做語義分割,輸出分割標注,輔助 3D 場景的細節優化。

(3)相機位姿優化:校準、優化傳感器采集的位姿數據,確保 3D 重建時空間坐標的準確性,輸出精準位姿信息。

3、3DGS 場景重建

基于預處理后的 “干凈數據”,aiSim 啟動神經網絡重建流程:融合 NeRF 的幾何泛化能力與 3DGS 的實時渲染特性,構建跨模態信息傳遞機制(T-S 結構)—— 將 NeRF 學習的深度、法線、外觀等監督信號,通過多模態數據協同訓練(引入 LiDAR 深度約束),遷移至3DGS 的高斯參數優化中。最終,離散點云與圖像數據被轉化為連續的 3D 高斯場景表示,實現 “真實場景→數字孿生” 的高效映射。

在這個關鍵環節中,T-S 結構發揮著核心橋梁作用,它使 NeRF 在處理圖像數據時所學習到的深度、法線及外觀等關鍵監督信號,能夠順暢地傳遞至 3DGS 模型中。同時,引入LiDAR 深度約束,進一步提升了幾何建模的精準度。LiDAR 所獲取的精確深度信息,作為一種強約束條件,參與到多模態數據的協同訓練過程中,幫助 3DGS 更準確地優化高斯點的位置、協方差矩陣等參數,從而構建出與真實場景高度契合的 3D 高斯場景。

經過這一系列處理流程,原本離散、無序的點云與圖像數據,被成功轉化為連續、逼真的 3D 高斯場景表示,實現了從現實世界到數字孿生世界的高效、精準映射,為后續的場景編輯與仿真應用提供了優質的基礎場景。

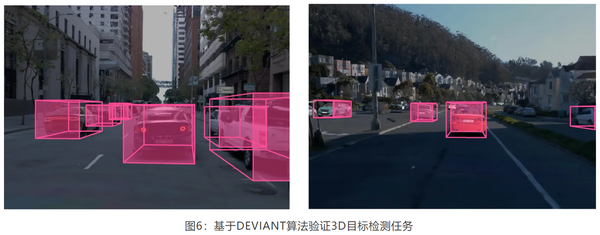

為驗證重建場景的一致性,aiSim 引入DEVIANT 算法與Mask2Former 算法形成雙重校驗。其中 DEVIANT 算法聚焦幾何精度。通過模擬單目 3D 目標檢測邏輯,對重建場景中車輛、行人等目標的深度、位置、尺寸進行校驗。利用算法的深度等變性(對投影流形中深度平移 tz 的精準約束),驗證 3D 高斯場景中目標的幾何參數是否與真實場景一致,避免因深度估計偏差導致目標漂移或變形。

驗證結果表明,該模型能夠成功檢測出由重建模型和基于網格的渲染引擎所渲染的車輛,這說明未引入明顯的領域差距。其中,遠處目標未被識別是由于模型本身的限制(檢測范圍小于50米)所致。

Mask2Former 算法則專注像素一致性。針對圖像語義分割維度,將重建場景的渲染圖像與真實場景圖像輸入 Mask2Former,對比道路、植被、建筑等區域的像素級標注。通過約束交叉注意力提取局部特征,校驗場景中紋理、邊界、語義區域的還原度,確保虛擬場景與真實環境在視覺細節與語義理解上高度匹配。

其中綠色區域代表兩種模型都檢測出的“car”類別區域,藍色區域代表僅公開模型檢測出的“car”類別區域,黃色區域代表僅aiSim模型檢測出的“car”類別區域。

從驗證結果可以看出,在原始軌跡場景中,道路及兩側可見車輛均被綠色區域覆蓋,模型對無遮擋、常規視角下的車輛檢測穩定;在極端新視角(3 米偏移)場景中,雖然視角的變化更新了部分環境元素(如左側垃圾桶等新物體出現),但車輛綠色檢測區域仍保持較好覆蓋,驗證模型在視角偏移場景下的適應性。此外,大多數黃色“誤差”來自于公開模型對目標邊界預測過于膨脹(dilated),而藍色區域通常出現在車輛被部分遮擋或距離較遠,導致aiSim未能識別。

通過 DEVIANT 算法與 Mask2Former 算法的協同驗證,aiSim 的 3DGS 重建場景在物體的幾何位置、形狀,以及像素級的顏色、紋理等方面,都能與真實場景高度契合,真正實現了 “形神兼備”,為自動駕駛系統的測試提供了極為真實、可靠的場景環境。

4、場景編輯與仿真閉環

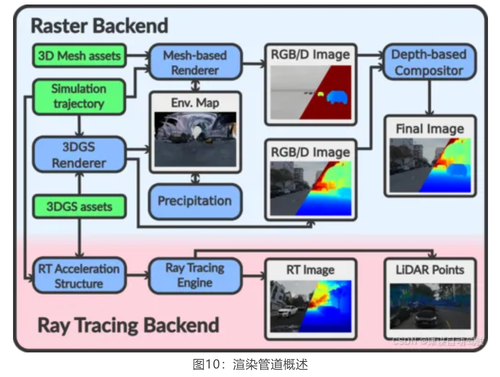

aiSim 的場景編輯工具賦予用戶強大的場景定制能力。用戶能夠在 3DGS 重建的基礎場景之上,靈活添加虛擬交通流,設置不同類型車輛的行駛路線、速度、密度等參數,模擬繁忙的城市交通或流暢的高速公路交通等多樣化場景 。同時,通過模擬極端天氣,如暴雨傾盆時路面的積水反光、暴雪天氣下的能見度降低、夜間的燈光照明效果等,為自動駕駛系統測試提供更具挑戰性與真實性的環境。

此外,部署多模態傳感器,能夠模擬不同傳感器在各種場景下的數據采集情況,全面測試自動駕駛系統對多源數據的融合與處理能力,極大地拓展了單一真實場景的應用價值,為自動駕駛算法的優化提供了豐富多樣的測試工況。

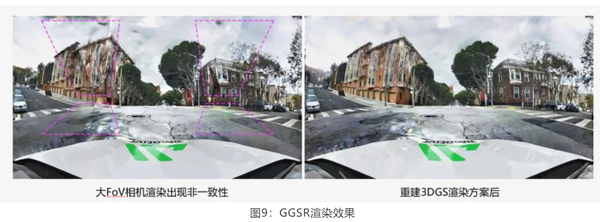

aiSim 新構建的GGSR(General Gaussian SplattingRenderer,通用高斯潑濺渲染器)是實現高保真渲染的關鍵組件。它針對傳統方案中廣角鏡頭渲染效果不佳的問題進行了深度優化,有效增強了廣角鏡頭渲染下的一致性。在處理 FOV 更大的鏡頭時,通過優化算法流程,顯著減少了近似誤差,避免了圖像變形、模糊等問題,使得渲染出的圖像在廣角視角下依然清晰、準確。同時,該渲染器能夠有效減少偽影的產生,無論是在復雜的城市街景還是開闊的高速公路場景中,都能實現高保真度的 3DGS 重建場景渲染。

此外,aiSim在渲染流程中支持任意相機畸變模型接入,能夠根據不同相機的特性對渲染過程進行精準適配,使得仿真數據在色彩、亮度、對比度以及畸變校正等方面,都能高度貼近真實傳感器的輸出。另外依托共享代碼庫的射線 - 高斯交互邏輯,能更真實地計算激光射線與場景高斯的碰撞、反射,為自動駕駛系統的功能測試與極限場景驗證提供了極為可靠的數據支持,成功打通了從數據采集到場景重建再到仿真驗證的完整閉環。

四、結論

aiSim的3DGS 方案通過全流程技術創新,構建起 “數據標準化 - 場景高保真 - 仿真全覆蓋” 的價值閉環,打通 3DGS 從技術潛力到工程實用的轉化路徑。

從痛點解決來看,方案以aiData 工具鏈讓多源數據有序協同,解決了 3DGS 輸入 “碎片化” 難題;通過 T-S 結構融合 NeRF 與 3DGS 優勢,結合 LiDAR 深度約束,實現場景幾何與外觀的精準重建;再經 DEVIANT 算法(幾何精度校驗)與 Mask2Former 算法(像素語義對齊)雙重驗證,確保重建場景與真實環境 “形神一致”,同時依托 GGSR 渲染器平衡高效渲染與高保真需求,讓 3DGS 真正適配自動駕駛仿真的嚴苛要求。

從應用價值來看,方案不僅提供了從真實場景到數字孿生的高效映射,更通過場景編輯工具支持極端天氣、虛擬交通流、多模態傳感器的靈活配置,讓單一場景衍生出多樣化測試工況。這種 “數據 - 場景 - 測試” 的閉環能力,既降低了對真實路測的依賴,又為自動駕駛算法迭代提供了高可信度的仿真環境。

▍參考資料

3DGS 綜述以及對 3DGS 的理解:A Survey on 3D Gaussian Splatting

Hybrid Rendering for Multimodal Autonomous Driving: Merging Neural and Physics-Based Simulation

3D Gaussian Splatting for Real-Time Radiance Field Rendering

-

3D

+關注

關注

9文章

2985瀏覽量

113643 -

數據

+關注

關注

8文章

7313瀏覽量

93839 -

仿真

+關注

關注

52文章

4393瀏覽量

137597 -

自動駕駛

+關注

關注

791文章

14641瀏覽量

175789

發布評論請先 登錄

康謀分享 | 3DGS:革新自動駕駛仿真場景重建的關鍵技術

谷歌的自動駕駛汽車是醬紫實現的嗎?

自動駕駛真的會來嗎?

自動駕駛的到來

UWB主動定位系統在自動駕駛中的應用實踐

如何讓自動駕駛更加安全?

自動駕駛汽車的處理能力怎么樣?

自動駕駛車的人車交互接口設計方案

自動駕駛系統要完成哪些計算機視覺任務?

網聯化自動駕駛的含義及發展方向

自動駕駛技術的實現

自動駕駛仿真工具

從“重建”到“可用”:aiSim3DGS方案如何閉環自動駕駛仿真場景?

講講如何閉環自動駕駛仿真場景,從重建到可用?

講講如何閉環自動駕駛仿真場景,從重建到可用?

評論