硬件冗余設(shè)計的核心目標(biāo)是應(yīng)對單點故障、保障系統(tǒng)連續(xù)運行,其有效性驗證需圍繞 “故障發(fā)生時的切換能力、數(shù)據(jù)完整性、業(yè)務(wù)連續(xù)性” 三大核心指標(biāo)展開,通過 “靜態(tài)配置檢查 + 動態(tài)故障模擬 + 長期穩(wěn)定性驗證” 的全流程方案實現(xiàn)。以下是具體驗證方法、關(guān)鍵指標(biāo)及實施步驟:

一、驗證前的核心準(zhǔn)備:明確目標(biāo)與范圍

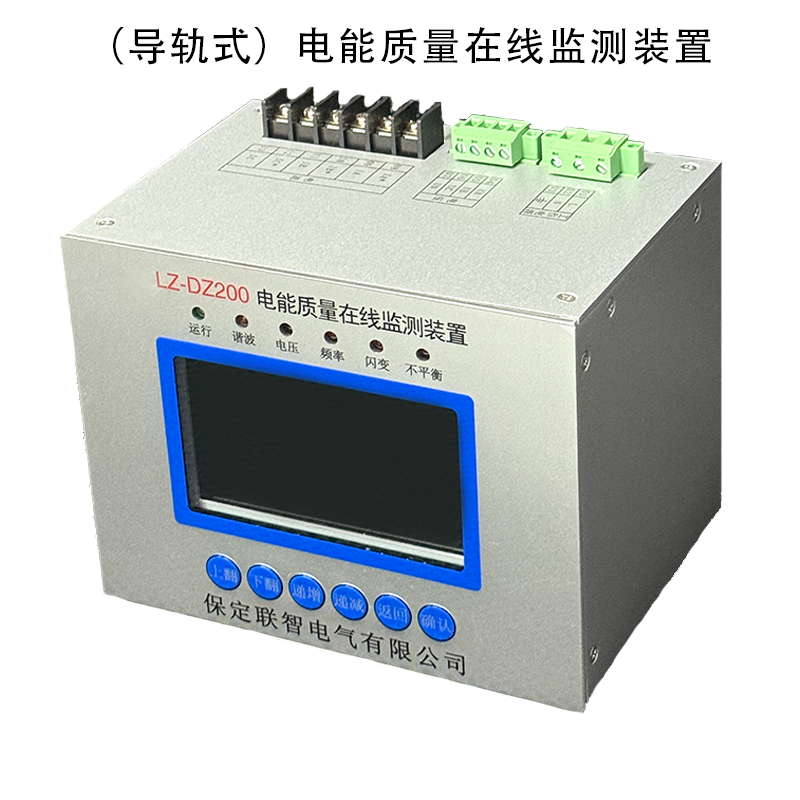

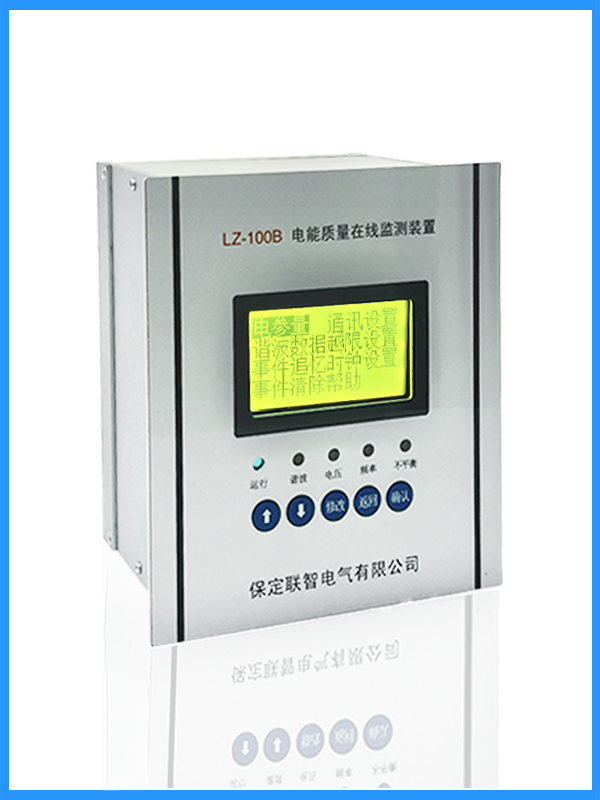

在驗證前需先界定冗余設(shè)計的類型與驗證邊界,避免遺漏關(guān)鍵部件。電能質(zhì)量監(jiān)測平臺的硬件冗余通常覆蓋以下模塊,需針對性明確驗證目標(biāo):

| 冗余硬件模塊 | 核心設(shè)計目標(biāo) | 驗證核心指標(biāo) |

|---|---|---|

| 電源冗余(雙電源) | 單電源故障時,備用電源無縫供電 | 供電切換時間、電壓穩(wěn)定性、無掉電 |

| 服務(wù)器冗余(雙機(jī)) | 主服務(wù)器故障時,備機(jī)接管數(shù)據(jù) / 業(yè)務(wù) | 主備切換時間、業(yè)務(wù)中斷時長、數(shù)據(jù)一致性 |

| 存儲冗余(RAID / 雙存儲) | 單磁盤 / 存儲故障時,數(shù)據(jù)不丟失、可讀寫 | 數(shù)據(jù)重建成功率、讀寫中斷時間、無數(shù)據(jù)損壞 |

| 網(wǎng)絡(luò)冗余(雙網(wǎng)卡 / 雙交換機(jī)) | 單網(wǎng)卡 / 交換機(jī)故障時,網(wǎng)絡(luò)不中斷 | 網(wǎng)絡(luò)切換時間、丟包率、連接穩(wěn)定性 |

| 采集模塊冗余(雙采集卡) | 單采集卡故障時,備用卡接管數(shù)據(jù)采集 | 采集中斷時長、數(shù)據(jù)連續(xù)性、無采集丟失 |

二、分階段驗證:從 “靜態(tài)檢查” 到 “動態(tài)故障”

階段 1:靜態(tài)配置驗證 —— 確保冗余設(shè)計 “配置正確”

冗余功能失效常源于 “硬件未正確部署” 或 “參數(shù)配置錯誤”,需先通過靜態(tài)檢查排除基礎(chǔ)問題:

硬件物理部署檢查

確認(rèn)冗余部件的物理連接完整性:如雙電源需分別接入獨立供電回路(避免同一路市電故障導(dǎo)致雙電源同時失效)、雙網(wǎng)卡需連接不同交換機(jī)、RAID 磁盤需正確插入插槽并被系統(tǒng)識別。

檢查冗余標(biāo)識與狀態(tài)燈:如服務(wù)器 “冗余就緒燈”(如華為服務(wù)器的 “HA 燈”)、RAID 控制器的 “冗余正常燈” 需處于常亮狀態(tài),無故障告警。

系統(tǒng)配置參數(shù)驗證

電源冗余:通過電源管理工具(如 IPMI、服務(wù)器 BMC 界面)確認(rèn) “冗余模式已啟用”(非 “獨立供電模式”),備用電源處于 “熱備狀態(tài)”(而非離線)。

服務(wù)器雙機(jī)冗余:檢查主備機(jī)的 “心跳鏈路”(如以太網(wǎng) / 光纖)是否連通、集群配置(如 VRRP 虛擬 IP、共享存儲掛載路徑)是否正確,確保備機(jī)已同步主機(jī)的系統(tǒng)參數(shù)(如 IP、端口、監(jiān)測閾值)。

存儲冗余:通過 RAID 管理工具(如 LSI MegaCLI、華為 Storage Manager)確認(rèn) RAID 級別(如 RAID5/6,需至少支持 1 塊磁盤故障)、“熱備盤” 已配置且處于 “待命狀態(tài)”,存儲卷的 “冗余保護(hù)標(biāo)志” 正常。

網(wǎng)絡(luò)冗余:通過操作系統(tǒng)(如 Linux 的bonding、Windows 的 “網(wǎng)卡聚合”)確認(rèn)雙網(wǎng)卡已綁定為 “主備模式” 或 “負(fù)載均衡模式”,虛擬網(wǎng)卡 IP 正常,鏈路狀態(tài)為 “up”。

階段 2:動態(tài)故障模擬 —— 驗證 “故障切換有效性”

靜態(tài)配置正確僅為基礎(chǔ),需通過主動模擬故障(接近真實失效場景)驗證冗余切換能力,這是驗證的核心環(huán)節(jié)。需針對不同冗余模塊設(shè)計故障場景,并實時監(jiān)測關(guān)鍵指標(biāo):

1. 電源冗余驗證

故障模擬方法:

手動斷開主電源回路(如拔插主電源插頭、關(guān)閉主電源開關(guān)),觀察備用電源是否自動啟動。

核心監(jiān)測指標(biāo):

切換時間:用示波器或電源監(jiān)測工具(如 Fluke 萬用表)測量供電中斷時長,要求**≤100ms**(避免服務(wù)器 / 采集模塊掉電重啟);

電壓穩(wěn)定性:切換后輸出電壓需維持在設(shè)備額定范圍(如 AC 220V±10%),無過壓 / 欠壓;

系統(tǒng)狀態(tài):監(jiān)測服務(wù)器、采集裝置是否重啟(正常應(yīng) “無重啟”),操作系統(tǒng) / 監(jiān)測軟件無崩潰。

2. 服務(wù)器雙機(jī)冗余驗證

故障模擬方法(覆蓋常見失效場景):

場景 1:主服務(wù)器 “軟故障”—— 關(guān)閉主服務(wù)器的監(jiān)測軟件進(jìn)程、斷開主服務(wù)器心跳鏈路(拔心跳網(wǎng)線);

場景 2:主服務(wù)器 “硬故障”—— 直接斷電主服務(wù)器、重啟主服務(wù)器;

核心監(jiān)測指標(biāo):

切換時間:通過監(jiān)控工具(如 Zabbix、Nagios)記錄從 “主服務(wù)器故障” 到 “備機(jī)接管業(yè)務(wù)” 的時長,要求**≤1s**(避免數(shù)據(jù)采集中斷);

業(yè)務(wù)連續(xù)性:驗證備機(jī)是否正常接收采集數(shù)據(jù)、存儲數(shù)據(jù)、觸發(fā)預(yù)警(如模擬電壓越限,備機(jī)需正常生成預(yù)警信息);

數(shù)據(jù)一致性:對比主備機(jī)切換前后的歷史數(shù)據(jù)(如 1 分鐘內(nèi)的電壓、電流數(shù)據(jù)),確保無數(shù)據(jù)丟失、無重復(fù)數(shù)據(jù)。

3. 存儲冗余驗證

故障模擬方法:

針對 RAID:通過 RAID 工具 “標(biāo)記某塊磁盤為失效”(或物理拔插某塊磁盤),模擬磁盤故障;

針對雙存儲:斷開主存儲的電源 / 網(wǎng)絡(luò),模擬主存儲離線;

核心監(jiān)測指標(biāo):

數(shù)據(jù)重建能力:RAID 磁盤故障后,觀察 “熱備盤是否自動激活”“數(shù)據(jù)重建進(jìn)度是否正常”(如 RAID5 重建時間≤2 小時 / 1TB),重建后通過md5sum等工具校驗數(shù)據(jù)文件,確認(rèn)無數(shù)據(jù)損壞;

讀寫連續(xù)性:在故障模擬過程中,通過dd(Linux)或 “文件拷貝工具” 持續(xù)向存儲寫入 / 讀取監(jiān)測數(shù)據(jù),記錄是否出現(xiàn) “讀寫中斷”(要求中斷時長≤100ms,無寫入失敗);

存儲狀態(tài)告警:系統(tǒng)需正確觸發(fā) “存儲冗余故障告警”(如磁盤失效告警、主存儲離線告警),告警信息準(zhǔn)確且無延遲。

4. 網(wǎng)絡(luò)冗余驗證

故障模擬方法:

場景 1:斷開主網(wǎng)卡的網(wǎng)線(或禁用主網(wǎng)卡);

場景 2:關(guān)閉主交換機(jī)電源,模擬交換機(jī)故障;

核心監(jiān)測指標(biāo):

網(wǎng)絡(luò)切換時間:通過ping命令(持續(xù)發(fā)送數(shù)據(jù)包,如ping -t IP)記錄丟包數(shù)與延遲變化,要求切換時間≤50ms,丟包數(shù)≤1 個;

業(yè)務(wù)連通性:故障期間,驗證遠(yuǎn)程客戶端(如運維終端)能否正常訪問平臺、采集裝置能否正常上傳數(shù)據(jù)(無數(shù)據(jù)斷連);

鏈路恢復(fù):故障排除后(如重新插上網(wǎng)線、開啟交換機(jī)),網(wǎng)絡(luò)是否自動恢復(fù)主備切換前的狀態(tài)(如主網(wǎng)卡重新接管流量),無手動干預(yù)需求。

階段 3:長期穩(wěn)定性驗證 —— 排除 “偶發(fā)失效風(fēng)險”

單次故障模擬可能無法暴露潛在問題(如長期運行后的冗余配置漂移、部件老化導(dǎo)致的切換失敗),需通過周期性、長時間驗證確保冗余設(shè)計的穩(wěn)定性:

周期性故障注入:

設(shè)定周期(如每周 1 次),自動 / 手動模擬關(guān)鍵冗余模塊的故障(如每周模擬 1 次主電源故障、每月模擬 1 次服務(wù)器主備切換),持續(xù) 3~6 個月,記錄每次切換的成功率(要求 100% 成功)。

極端條件驗證:

模擬高負(fù)載場景(如監(jiān)測裝置同時采集 100 + 測點數(shù)據(jù)、平臺并發(fā)處理 10 + 預(yù)警事件),再注入故障,驗證冗余切換是否正常(避免高負(fù)載下切換超時);

模擬環(huán)境干擾(如電壓波動、電磁干擾),觀察冗余部件是否誤觸發(fā)切換(要求無 “誤切換”)。

日志分析:

定期導(dǎo)出冗余模塊的運行日志(如電源切換日志、服務(wù)器集群日志、存儲故障日志),分析是否存在 “隱性故障”(如備用電源偶發(fā)電壓波動、主備機(jī)心跳鏈路間歇性中斷),并針對性優(yōu)化。

三、關(guān)鍵驗證工具與指標(biāo)量化

驗證需依賴專業(yè)工具確保數(shù)據(jù)準(zhǔn)確性,避免 “主觀判斷”,以下是核心工具與量化標(biāo)準(zhǔn):

| 驗證環(huán)節(jié) | 推薦工具 | 量化指標(biāo)標(biāo)準(zhǔn) |

|---|---|---|

| 電源切換測試 | 示波器、Fluke 1738 電能質(zhì)量分析儀 | 切換時間≤100ms,電壓波動 ±5% 以內(nèi) |

| 服務(wù)器切換測試 | Zabbix、Nagios(系統(tǒng)監(jiān)控) | 切換時間≤1s,業(yè)務(wù)中斷時長≤500ms |

| 存儲數(shù)據(jù)驗證 | md5sum(數(shù)據(jù)校驗)、IOzone(讀寫測試) | 數(shù)據(jù)重建成功率 100%,讀寫中斷≤100ms |

| 網(wǎng)絡(luò)切換測試 | ping、iperf(帶寬測試)、Wireshark | 丟包率≤0.1%,切換時間≤50ms,帶寬無衰減 |

| 系統(tǒng)狀態(tài)監(jiān)測 | top、vmstat(Linux)、任務(wù)管理器(Windows) | CPU 負(fù)載≤80%,內(nèi)存使用率≤70%(切換后) |

四、驗證后的閉環(huán):問題整改與文檔沉淀

問題整改:

若驗證中發(fā)現(xiàn)問題(如切換超時、數(shù)據(jù)丟失),需定位根因并優(yōu)化:

切換超時:檢查心跳鏈路帶寬(如升級為千兆鏈路)、優(yōu)化主備同步策略(如減少同步數(shù)據(jù)量);

數(shù)據(jù)丟失:確認(rèn)存儲冗余級別是否足夠(如從 RAID5 升級為 RAID6)、主備機(jī)數(shù)據(jù)同步機(jī)制是否為 “實時同步”。

文檔沉淀:

形成《硬件冗余有效性驗證報告》,記錄以下內(nèi)容:

驗證范圍、工具、步驟;

各冗余模塊的測試數(shù)據(jù)(如切換時間、丟包率);

發(fā)現(xiàn)的問題、整改措施及復(fù)測結(jié)果;

冗余設(shè)計的 “有效結(jié)論”(如 “雙電源切換正常,滿足≤100ms 要求;服務(wù)器主備切換無業(yè)務(wù)中斷”)。

總結(jié)

硬件冗余有效性的驗證核心是 “模擬真實故障、量化關(guān)鍵指標(biāo)、長期穩(wěn)定性驗證”—— 既要確保冗余部件在故障時能 “切得動”,也要保證切換后 “數(shù)據(jù)不丟、業(yè)務(wù)不斷、性能不降”。通過上述全流程方法,可徹底驗證冗余設(shè)計是否達(dá)到預(yù)期目標(biāo),為電能質(zhì)量監(jiān)測平臺的穩(wěn)定運行提供硬件層面的保障。

審核編輯 黃宇

-

冗余

+關(guān)注

關(guān)注

1文章

113瀏覽量

21326

發(fā)布評論請先 登錄

通過特定方法驗證T2PAK封裝散熱設(shè)計的有效性

電能質(zhì)量在線監(jiān)測裝置的以太網(wǎng)冗余備份功能是如何實現(xiàn)的?

確保X光設(shè)備檢測的有效性和準(zhǔn)確性的關(guān)鍵技巧

如何驗證電能質(zhì)量在線監(jiān)測裝置硬件層實時監(jiān)測冗余切換功能的有效性?

通信故障處理完成后如何驗證裝置是否恢復(fù)正常?

電能質(zhì)量在線監(jiān)測裝置自診斷功能的硬件層實時監(jiān)測的冗余切換是如何實現(xiàn)的?

如何保障電能質(zhì)量在線監(jiān)測裝置數(shù)據(jù)管理的安全要點的有效性?

如何確保電能質(zhì)量在線監(jiān)測裝置的數(shù)據(jù)管理平臺的硬件冗余設(shè)計有效?

看不見的安全防線:信而泰儀表如何驗證零信任有效性

如何判斷電能質(zhì)量在線監(jiān)測裝置認(rèn)證標(biāo)準(zhǔn)的有效性?

如何驗證硬件加速是否真正提升了通信協(xié)議的安全性?

如何驗證硬件冗余設(shè)計的有效性?

如何驗證硬件冗余設(shè)計的有效性?

評論